Generalizable Humanoid Manipulation with 3D Diffusion Policies

作者: Yanjie Ze, Zixuan Chen, Wenhao Wang, Tianyi Chen, Xialin He, Ying Yuan, Xue Bin Peng, Jiajun Wu

分类: cs.RO, cs.CV, cs.LG

发布日期: 2024-10-14 (更新: 2025-09-09)

备注: IROS 2025. Project website: https://humanoid-manipulation.github.io

💡 一句话要点

提出基于3D扩散策略的通用人形机器人操作方法,解决单场景泛化难题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人形机器人 操作技能学习 3D扩散策略 通用性 遥操作

📋 核心要点

- 人形机器人操作受限于特定场景,缺乏泛化能力,且真实环境数据采集成本高昂。

- 提出一种基于3D扩散策略的学习框架,结合遥操作数据和真实机器人平台,提升泛化性。

- 在真实机器人上进行了大量实验,验证了该方法在不同场景下的自主操作能力。

📝 摘要(中文)

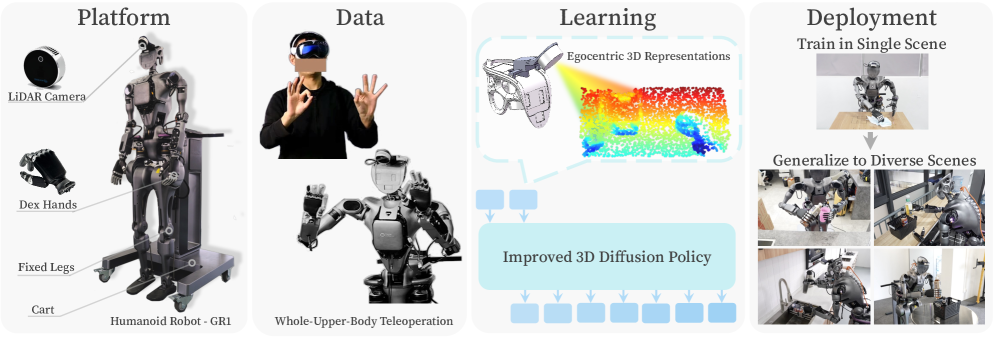

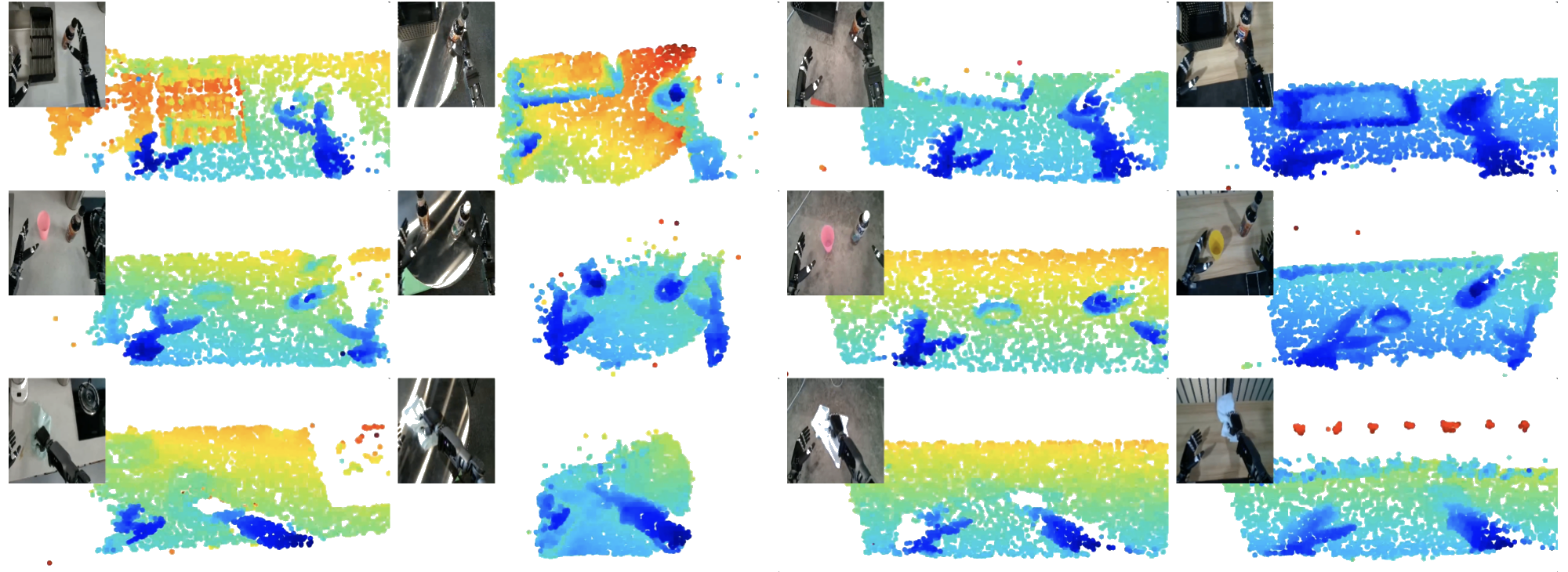

人形机器人能够在各种环境中自主操作一直是机器人学家的目标。然而,人形机器人的自主操作在很大程度上仅限于特定场景,这主要是由于难以获得可泛化的技能以及在真实环境中获取人形机器人数据的成本高昂。本文构建了一个真实的机器人系统来解决这个具有挑战性的问题。我们的系统主要集成了:1)一个全身上半身的机器人遥操作系统,用于获取类人机器人数据;2)一个具有高度可调小车和3D激光雷达传感器的25自由度人形机器人平台;3)一种改进的3D扩散策略学习算法,用于人形机器人从嘈杂的人类数据中学习。我们在真实机器人上进行了超过2000次的策略rollout,以进行严格的策略评估。借助该系统,我们证明了仅使用在单个场景中收集的数据,并且仅使用板载计算,一个全尺寸的人形机器人就可以在各种真实场景中自主执行技能。

🔬 方法详解

问题定义:论文旨在解决人形机器人在不同真实场景中进行通用操作的问题。现有方法通常依赖于特定场景的数据训练,导致模型泛化能力差,难以适应新的环境和任务。此外,获取高质量的真实人形机器人数据成本高昂,限制了算法的训练和部署。

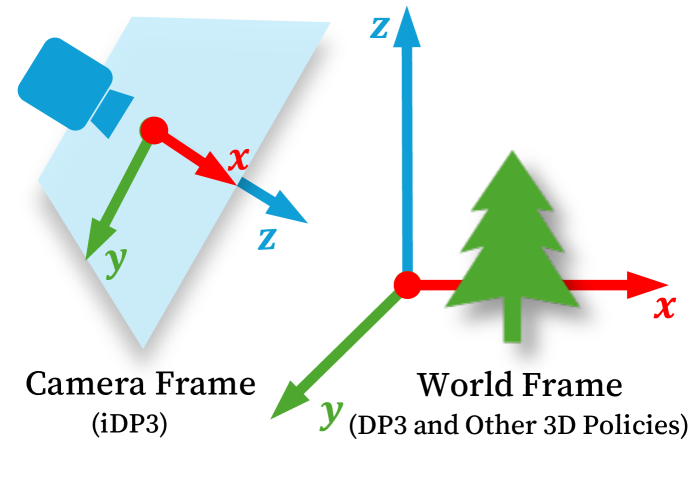

核心思路:论文的核心思路是利用3D扩散策略学习算法,结合遥操作系统采集的人类数据,使人形机器人能够从噪声数据中学习,并在真实环境中进行自主操作。通过在单个场景中收集数据,训练出一个具有泛化能力的策略,从而减少对大量特定场景数据的依赖。

技术框架:该系统主要包含三个部分:1) 全身上半身的机器人遥操作系统,用于采集类人机器人数据;2) 25自由度人形机器人平台,配备高度可调的小车和3D激光雷达传感器;3) 改进的3D扩散策略学习算法。首先,通过遥操作系统收集人类操作数据。然后,利用这些数据训练3D扩散策略模型。最后,将训练好的策略部署到人形机器人平台上,进行自主操作。

关键创新:该论文的关键创新在于将3D扩散策略学习算法应用于人形机器人操作,并结合遥操作数据和真实机器人平台,实现了在不同真实场景下的通用操作。与传统的基于强化学习的方法相比,扩散策略能够更好地处理高维连续动作空间,并从噪声数据中学习。

关键设计:论文中改进的3D扩散策略学习算法可能包含以下关键设计:1) 使用条件扩散模型,将环境状态作为条件输入,生成动作序列;2) 设计合适的损失函数,例如基于轨迹相似性的损失函数,以提高策略的泛化能力;3) 采用数据增强技术,例如添加噪声或进行数据变换,以提高模型的鲁棒性。具体的网络结构和参数设置在论文中可能有所详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

该研究在真实机器人上进行了超过2000次的策略rollout,验证了该方法在不同真实场景下的自主操作能力。实验结果表明,仅使用在单个场景中收集的数据,该方法训练的人形机器人可以在各种真实场景中自主执行技能。具体的性能数据(例如成功率、操作时间等)和对比基线(例如其他强化学习算法)的提升幅度在论文中可能有所详细描述(未知)。

🎯 应用场景

该研究成果可应用于各种需要人形机器人进行自主操作的场景,例如家庭服务、工业制造、医疗辅助和灾难救援等。通过提高人形机器人的泛化能力,可以使其更好地适应不同的环境和任务,从而实现更广泛的应用。未来,该技术有望推动人形机器人在真实世界中的普及和应用。

📄 摘要(原文)

Humanoid robots capable of autonomous operation in diverse environments have long been a goal for roboticists. However, autonomous manipulation by humanoid robots has largely been restricted to one specific scene, primarily due to the difficulty of acquiring generalizable skills and the expensiveness of in-the-wild humanoid robot data. In this work, we build a real-world robotic system to address this challenging problem. Our system is mainly an integration of 1) a whole-upper-body robotic teleoperation system to acquire human-like robot data, 2) a 25-DoF humanoid robot platform with a height-adjustable cart and a 3D LiDAR sensor, and 3) an improved 3D Diffusion Policy learning algorithm for humanoid robots to learn from noisy human data. We run more than 2000 episodes of policy rollouts on the real robot for rigorous policy evaluation. Empowered by this system, we show that using only data collected in one single scene and with only onboard computing, a full-sized humanoid robot can autonomously perform skills in diverse real-world scenarios. Videos are available at https://humanoid-manipulation.github.io .