EasyHeC++: Fully Automatic Hand-Eye Calibration with Pretrained Image Models

作者: Zhengdong Hong, Kangfu Zheng, Linghao Chen

分类: cs.RO

发布日期: 2024-10-11

备注: Accepted by IROS 2024

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

EasyHeC++:基于预训练图像模型的全自动手眼标定

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 手眼标定 机器人视觉 预训练模型 可微渲染 自动化 相机姿态估计 无标记

📋 核心要点

- 传统手眼标定方法依赖人工操作、特定标记物或针对特定机械臂的训练,通用性和易用性存在挑战。

- EasyHeC++利用预训练图像模型进行相机姿态初始化,并结合可微渲染进行姿态优化,实现全自动标定。

- 实验结果表明,EasyHeC++在多种机械臂和相机配置下,合成和真实数据集上均表现出优异的标定精度。

📝 摘要(中文)

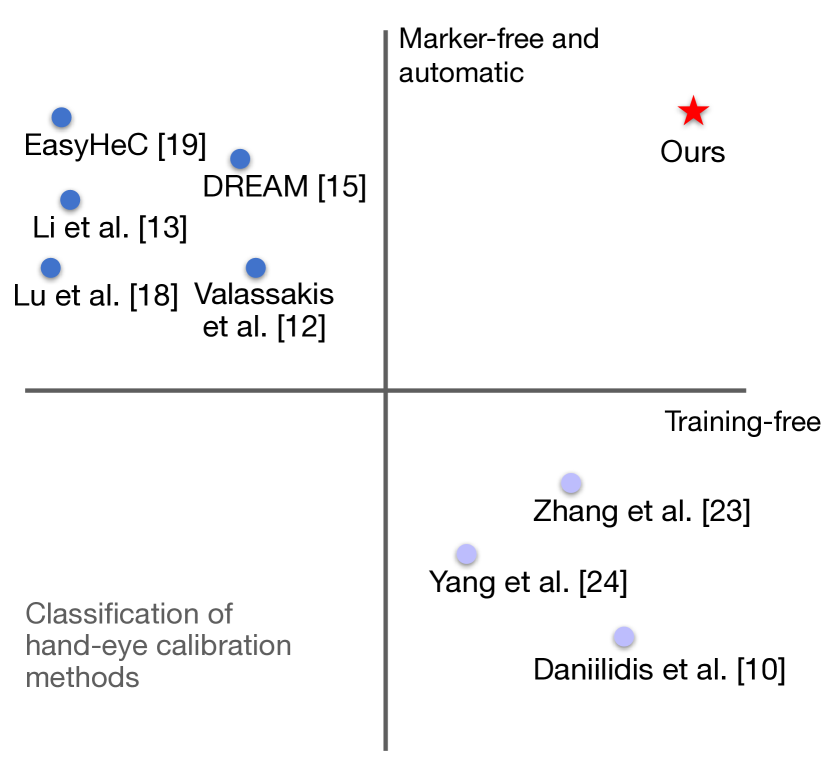

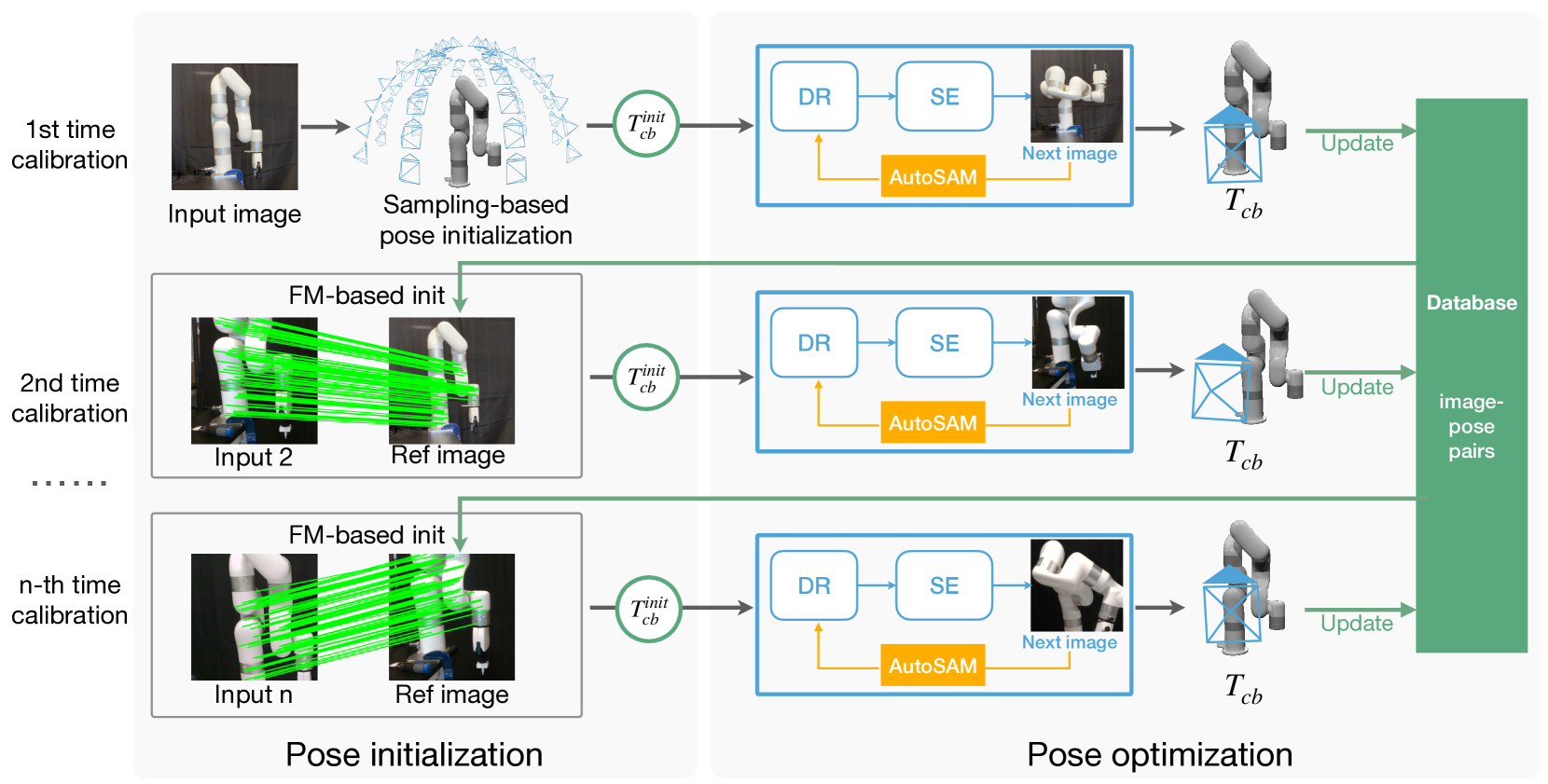

本文提出了一种名为EasyHeC++的全新框架,用于全自动手眼标定。与以往需要手动标定、专用标记或训练特定机械臂神经网络的方法不同,我们的方法是首个能够以无标记、免训练和全自动的方式精确标定任何机械臂的系统。我们的方法采用两步流程。首先,借助预训练图像模型,使用采样或基于特征匹配的方法初始化相机姿态。随后,通过可微渲染执行姿态优化。大量实验表明,该系统在各种机械臂和相机设置的合成和真实世界数据集中均具有卓越的精度。

🔬 方法详解

问题定义:手眼标定是机器人操作中的关键环节,直接影响抓取等操作的效率。现有方法通常需要人工干预、依赖特定标记物,或者需要针对特定机械臂进行训练,这限制了其通用性和易用性。因此,如何实现一种无需人工干预、无需特定标记物、且能适用于各种机械臂的全自动手眼标定方法是一个重要的挑战。

核心思路:EasyHeC++的核心思路是利用预训练图像模型的强大特征提取能力,结合可微渲染技术,实现相机姿态的自动初始化和优化。预训练模型能够提供对场景的先验知识,从而避免了对特定标记物的依赖。可微渲染则允许通过梯度下降的方式优化相机姿态,从而提高标定精度。

技术框架:EasyHeC++采用两阶段流程:1) 相机姿态初始化:利用预训练图像模型,通过采样或特征匹配的方法估计相机初始姿态。具体来说,可以随机采样多个相机姿态,并利用预训练模型提取图像特征,然后选择与真实图像特征最匹配的姿态作为初始值;或者直接利用预训练模型提取图像特征,并与已知的三维模型进行匹配,从而估计相机姿态。2) 姿态优化:利用可微渲染技术,将估计的相机姿态渲染成图像,并计算渲染图像与真实图像之间的差异。然后,通过梯度下降的方式优化相机姿态,使得渲染图像与真实图像尽可能相似。

关键创新:EasyHeC++的关键创新在于:1) 首次实现了完全自动的手眼标定,无需人工干预和特定标记物;2) 利用预训练图像模型进行相机姿态初始化,避免了对特定环境的依赖;3) 采用可微渲染技术进行姿态优化,提高了标定精度。与现有方法相比,EasyHeC++具有更高的通用性和易用性。

关键设计:在相机姿态初始化阶段,可以选择不同的预训练图像模型和特征匹配算法。在姿态优化阶段,需要选择合适的损失函数来衡量渲染图像与真实图像之间的差异。常用的损失函数包括像素级别的均方误差、结构相似性损失等。此外,还需要选择合适的优化算法,例如Adam、SGD等。可微渲染器的选择也很重要,需要考虑渲染速度和精度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EasyHeC++在合成和真实数据集上均取得了优异的标定精度。在真实数据集上,EasyHeC++的标定精度优于现有的基于标记物的方法,并且无需人工干预。此外,EasyHeC++还具有良好的鲁棒性,能够适应不同的机械臂和相机配置。

🎯 应用场景

EasyHeC++可广泛应用于各种机器人应用场景,如工业自动化、物流、医疗机器人等。它能够显著降低手眼标定的成本和复杂度,提高机器人系统的部署效率和精度。未来,该技术有望进一步推广到更复杂的机器人系统和应用场景中,例如无人驾驶、增强现实等。

📄 摘要(原文)

Hand-eye calibration plays a fundamental role in robotics by directly influencing the efficiency of critical operations such as manipulation and grasping. In this work, we present a novel framework, EasyHeC++, designed for fully automatic hand-eye calibration. In contrast to previous methods that necessitate manual calibration, specialized markers, or the training of arm-specific neural networks, our approach is the first system that enables accurate calibration of any robot arm in a marker-free, training-free, and fully automatic manner. Our approach employs a two-step process. First, we initialize the camera pose using a sampling or feature-matching-based method with the aid of pretrained image models. Subsequently, we perform pose optimization through differentiable rendering. Extensive experiments demonstrate the system's superior accuracy in both synthetic and real-world datasets across various robot arms and camera settings. Project page: https://ootts.github.io/easyhec_plus.