CE-MRS: Contrastive Explanations for Multi-Robot Systems

作者: Ethan Schneider, Daniel Wu, Devleena Das, Sonia Chernova

分类: cs.RO, cs.HC, cs.MA

发布日期: 2024-10-10

备注: Accepted to IEEE Robotics and Automation Letters

期刊: IEEE Robotics and Automation Letters. 9 (2024) 10121-10128

💡 一句话要点

提出CE-MRS:一种多机器人系统的对比解释方法,提升用户问题解决能力。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 多机器人系统 对比解释 可解释人工智能 人机协作 任务分配

📋 核心要点

- 多机器人系统日益复杂,其决策过程对用户而言变得难以理解和信任。

- 论文提出一种对比解释方法,通过自然语言解释系统行为,帮助用户理解系统决策。

- 用户研究表明,该方法显著提升了用户识别和解决系统错误的能力,提高了团队整体性能。

📝 摘要(中文)

随着多机器人系统复杂性的增加,包括机器人数量、任务复杂性和时间跨度,其解决方案往往变得过于复杂,人类用户难以完全理解。本文提出了一种生成自然语言解释的方法,用于证明系统解决方案的有效性,或帮助用户纠正导致次优系统解决方案的错误。为此,我们首先贡献了一种多机器人系统对比解释的通用形式化方法,然后提出了一种整体方法,用于生成多机器人场景的对比解释,该方法选择性地整合来自多机器人任务分配、调度和运动规划的数据,以解释系统行为。通过与人类操作员的用户研究,我们证明了我们集成的对比解释方法显著提高了用户识别和解决系统错误的能力,从而显著提高了整体多机器人团队的性能。

🔬 方法详解

问题定义:多机器人系统在执行复杂任务时,其决策过程往往难以被人类用户理解,导致用户难以信任系统或发现潜在错误。现有方法缺乏有效的解释机制,无法帮助用户理解系统行为背后的原因,从而限制了人机协作的效率和可靠性。

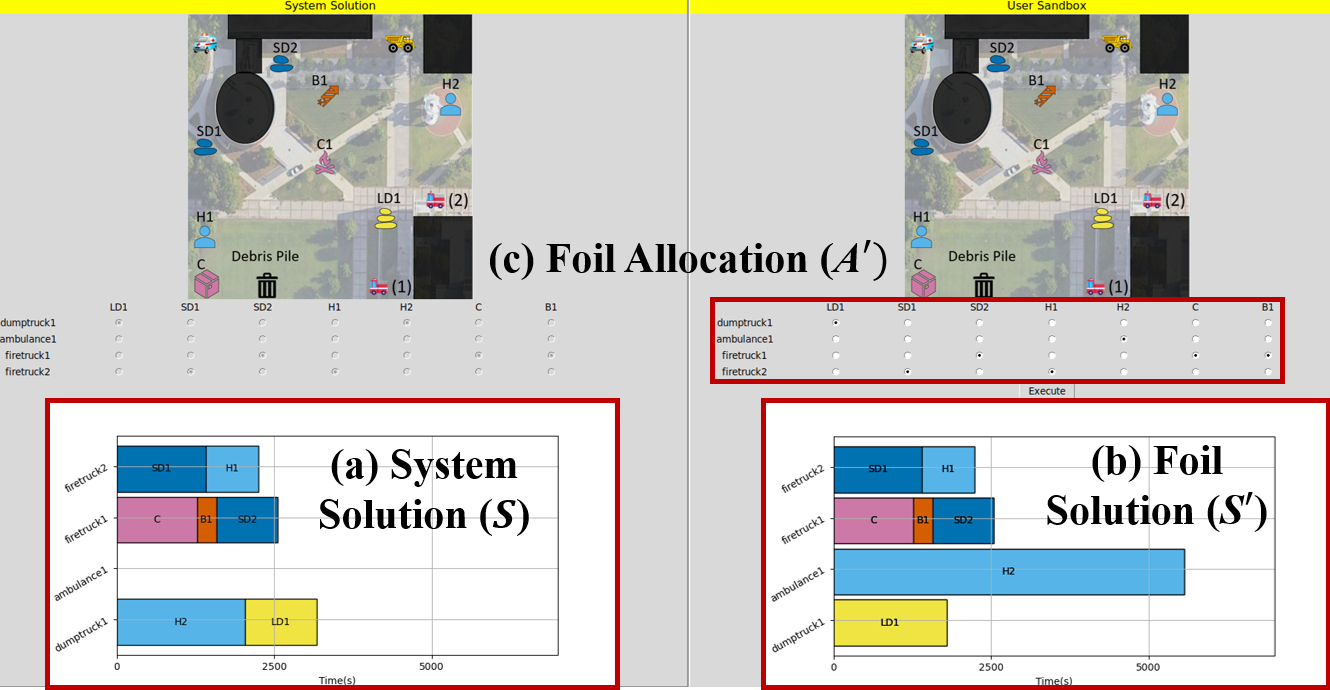

核心思路:论文的核心思路是生成对比解释,即解释系统为什么选择当前方案,而不是其他可能的方案。通过对比不同方案的优缺点,帮助用户理解系统决策的合理性,并发现潜在的错误或改进空间。这种对比解释能够提供更深入的理解,而不仅仅是简单的结果展示。

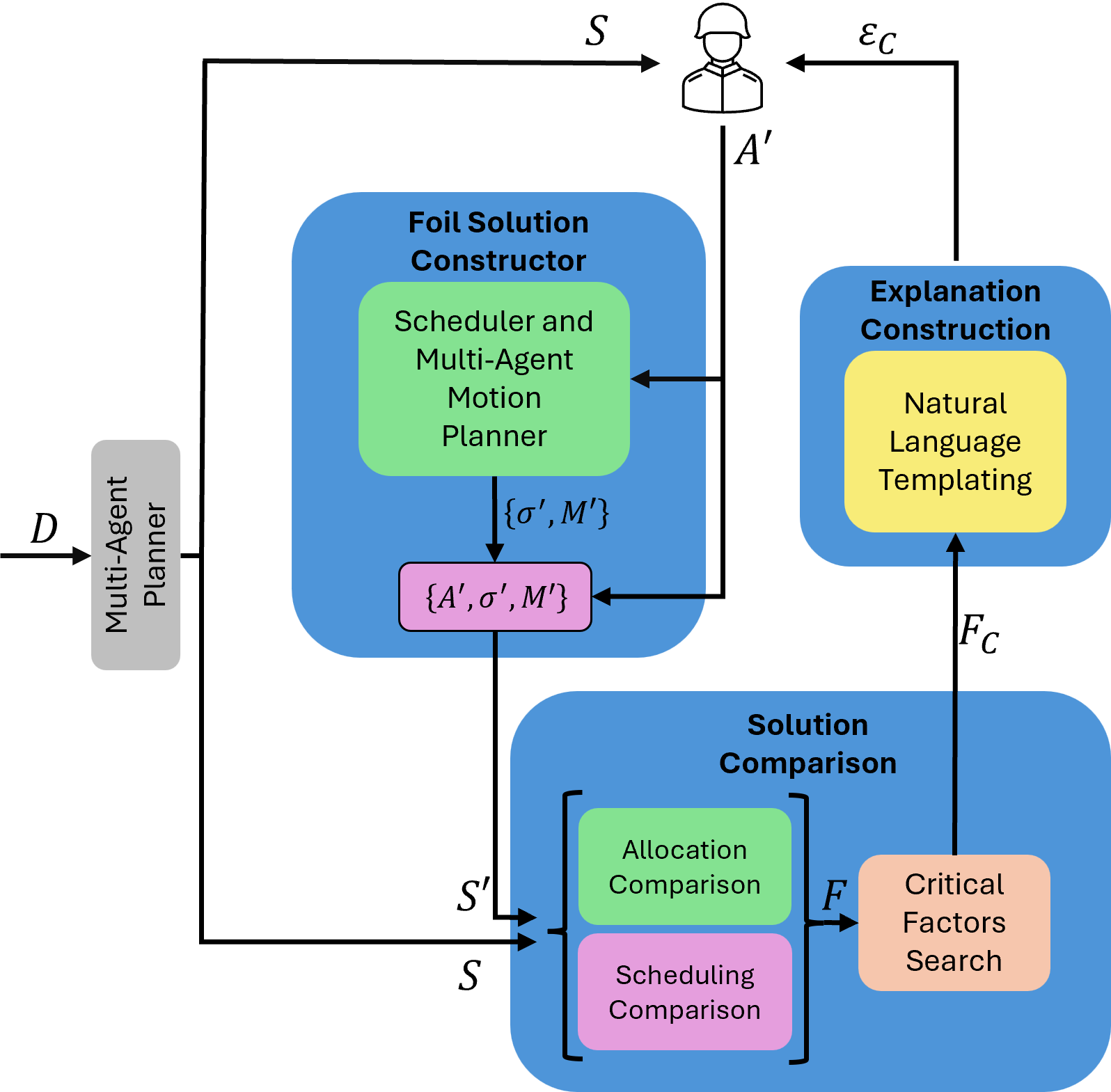

技术框架:该方法包含以下主要模块:1) 多机器人任务分配模块:负责将任务分配给不同的机器人;2) 调度模块:负责安排任务的执行顺序;3) 运动规划模块:负责规划机器人的运动轨迹;4) 对比解释生成模块:该模块整合来自前三个模块的数据,生成自然语言的对比解释。整体流程是:首先,系统生成一个解决方案;然后,对比解释生成模块分析该解决方案,并生成对比解释;最后,将解释呈现给用户。

关键创新:该方法的关键创新在于提出了一个通用的多机器人系统对比解释形式化方法,并将其应用于任务分配、调度和运动规划等多个领域。此外,该方法还提出了一种整体的解释生成方法,能够选择性地整合来自不同模块的数据,以生成更全面、更准确的解释。与现有方法相比,该方法能够提供更深入、更易于理解的解释,从而更好地支持人机协作。

关键设计:对比解释生成模块的关键设计包括:1) 选择合适的对比方案:选择与当前方案最相关的对比方案,以突出当前方案的优势;2) 设计清晰简洁的自然语言模板:使用户能够轻松理解解释的内容;3) 整合来自不同模块的数据:确保解释的全面性和准确性。具体的参数设置和损失函数等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

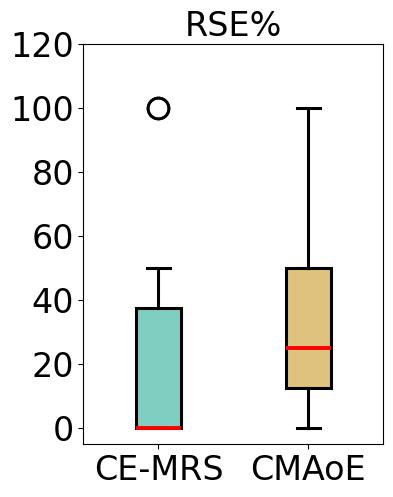

通过用户研究,论文证明了该方法能够显著提高用户识别和解决系统错误的能力,从而显著提高整体多机器人团队的性能。具体而言,用户在使用该方法后,能够更快地发现并纠正系统错误,从而减少了任务完成时间和资源消耗。具体的性能数据和提升幅度在摘要中提到“significant improvements”,但未给出具体数值。

🎯 应用场景

该研究成果可应用于各种多机器人协作场景,例如:仓库自动化、搜索救援、环境监测等。通过提供可解释的决策过程,该方法能够提高用户对多机器人系统的信任度,并促进人机协作,从而提高整体效率和安全性。未来,该方法有望应用于更复杂的机器人系统,并与其他解释性人工智能技术相结合,实现更智能、更可靠的人机交互。

📄 摘要(原文)

As the complexity of multi-robot systems grows to incorporate a greater number of robots, more complex tasks, and longer time horizons, the solutions to such problems often become too complex to be fully intelligible to human users. In this work, we introduce an approach for generating natural language explanations that justify the validity of the system's solution to the user, or else aid the user in correcting any errors that led to a suboptimal system solution. Toward this goal, we first contribute a generalizable formalism of contrastive explanations for multi-robot systems, and then introduce a holistic approach to generating contrastive explanations for multi-robot scenarios that selectively incorporates data from multi-robot task allocation, scheduling, and motion-planning to explain system behavior. Through user studies with human operators we demonstrate that our integrated contrastive explanation approach leads to significant improvements in user ability to identify and solve system errors, leading to significant improvements in overall multi-robot team performance.