Dynamic Object Catching with Quadruped Robot Front Legs

作者: André Schakkal, Guillaume Bellegarda, Auke Ijspeert

分类: cs.RO

发布日期: 2024-10-10

备注: Accepted to IROS 2024

💡 一句话要点

提出一种基于四足机器人前腿的动态物体抓取框架,解决运动物体拦截问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 四足机器人 动态抓取 计算机视觉 轨迹预测 运动控制 YOLOv8 高斯混合模型

📋 核心要点

- 现有方法难以让四足机器人动态抓取运动物体,尤其是在复杂环境中。

- 该论文提出结合视觉、轨迹预测和腿部控制的框架,使机器人能预测并拦截物体。

- 实验表明,基于高斯混合模型的方法效果最佳,抓取成功率达到80%。

📝 摘要(中文)

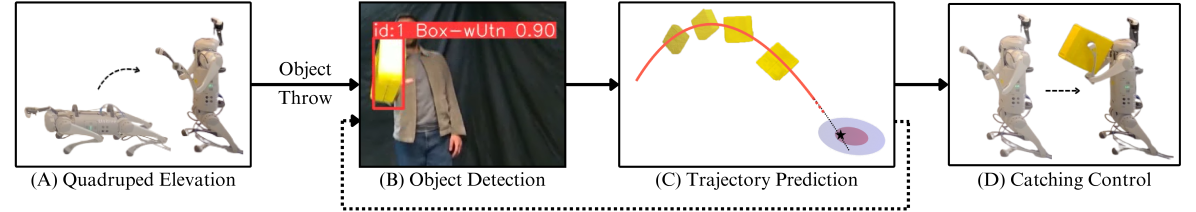

本文提出了一种利用四足机器人前腿进行动态物体抓取的框架,机器人依靠后腿站立。该系统集成了计算机视觉、轨迹预测和腿部控制,使四足机器人能够使用板载摄像头视觉检测、跟踪并成功抓取投掷的物体。通过利用微调的YOLOv8模型进行物体检测和基于回归的轨迹预测模块,四足机器人迭代地调整其前腿位置以预测和拦截物体。抓取动作包括识别最佳抓取位置,使用笛卡尔PD控制控制前腿,并在正确的时刻合拢双腿。我们提出并验证了三种不同的选择最佳抓取位置的方法:1)将预测轨迹与垂直平面相交,2)选择预测轨迹上与机器人腿部中心(在其标称位置)距离最小的点,3)选择预测轨迹上高斯混合模型(GMM)建模的机器人可达空间中可能性最高的点。实验结果表明,该系统在各种场景下都具有强大的抓取能力,其中GMM方法表现最佳,抓取成功率达到80%。

🔬 方法详解

问题定义:该论文旨在解决四足机器人动态抓取快速移动物体的问题。现有的机器人抓取系统通常依赖于静态或低速移动的物体,难以应对高速、无预知轨迹的动态物体。此外,四足机器人的运动控制和视觉感知的集成也带来了额外的挑战。

核心思路:论文的核心思路是利用计算机视觉技术实时感知物体的位置,然后通过轨迹预测算法预测物体未来的运动轨迹,最后通过腿部控制算法调整前腿的位置,使得前腿能够在最佳位置和时间拦截并抓取物体。这种思路的关键在于准确的物体检测、精确的轨迹预测和快速的腿部控制。

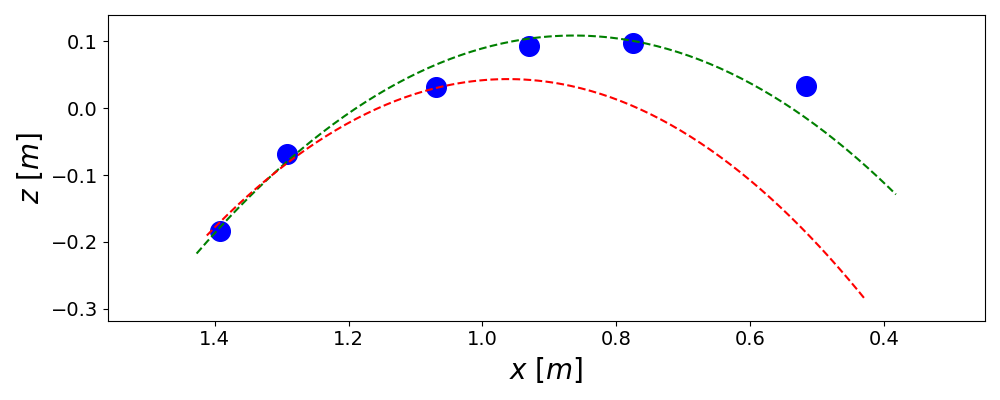

技术框架:整体框架包括以下几个主要模块:1) 物体检测模块:使用YOLOv8模型进行物体检测,识别并定位物体在图像中的位置。2) 轨迹预测模块:基于物体的位置信息,使用回归模型预测物体未来的运动轨迹。3) 抓取位置选择模块:根据预测的轨迹,选择最佳的抓取位置。论文提出了三种方法:轨迹与垂直平面相交、最小距离点和GMM方法。4) 腿部控制模块:使用笛卡尔PD控制算法控制前腿运动到抓取位置,并在合适的时机合拢双腿完成抓取动作。

关键创新:该论文的关键创新在于将计算机视觉、轨迹预测和腿部控制集成到一个完整的系统中,实现了四足机器人动态抓取运动物体的能力。此外,论文还提出了三种不同的抓取位置选择方法,并对它们进行了比较和分析。GMM方法是其中的一个创新点,它利用高斯混合模型对机器人的可达空间进行建模,从而选择最有可能成功抓取的位置。

关键设计:在物体检测模块中,使用了微调的YOLOv8模型,以提高物体检测的准确率和鲁棒性。在轨迹预测模块中,使用了回归模型,通过学习历史数据来预测物体未来的运动轨迹。在抓取位置选择模块中,GMM方法的关键在于高斯混合模型的参数设置,需要根据机器人的运动能力和环境特点进行调整。在腿部控制模块中,笛卡尔PD控制算法的关键在于PD参数的调整,需要根据机器人的动力学特性进行优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该系统在各种场景下都具有强大的抓取能力。其中,基于高斯混合模型(GMM)的抓取位置选择方法表现最佳,抓取成功率达到80%。这表明GMM方法能够有效地利用机器人的运动能力信息,选择最佳的抓取位置,从而提高抓取成功率。该研究为四足机器人在动态环境中的应用提供了有力的支持。

🎯 应用场景

该研究成果可应用于物流分拣、灾难救援、家庭服务等领域。例如,在物流分拣中,四足机器人可以抓取传送带上快速移动的包裹;在灾难救援中,可以抓取空投的物资;在家庭服务中,可以与人互动,抓取抛掷的玩具等。该技术的发展将提升机器人在动态环境中的适应性和操作能力。

📄 摘要(原文)

This paper presents a framework for dynamic object catching using a quadruped robot's front legs while it stands on its rear legs. The system integrates computer vision, trajectory prediction, and leg control to enable the quadruped to visually detect, track, and successfully catch a thrown object using an onboard camera. Leveraging a fine-tuned YOLOv8 model for object detection and a regression-based trajectory prediction module, the quadruped adapts its front leg positions iteratively to anticipate and intercept the object. The catching maneuver involves identifying the optimal catching position, controlling the front legs with Cartesian PD control, and closing the legs together at the right moment. We propose and validate three different methods for selecting the optimal catching position: 1) intersecting the predicted trajectory with a vertical plane, 2) selecting the point on the predicted trajectory with the minimal distance to the center of the robot's legs in their nominal position, and 3) selecting the point on the predicted trajectory with the highest likelihood on a Gaussian Mixture Model (GMM) modelling the robot's reachable space. Experimental results demonstrate robust catching capabilities across various scenarios, with the GMM method achieving the best performance, leading to an 80% catching success rate. A video demonstration of the system in action can be found at https://youtu.be/sm7RdxRfIYg .