A GPT-based Decision Transformer for Multi-Vehicle Coordination at Unsignalized Intersections

作者: Eunjae Lee, Minhee Kang, Yoojin Choi, Heejin Ahn

分类: cs.RO

发布日期: 2024-10-08

备注: 7 pages

💡 一句话要点

提出基于GPT的决策Transformer,用于无信号交叉口多车辆协同

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多车辆协同 决策Transformer GPT 序列预测 智能交通

📋 核心要点

- 现有交叉口车辆协同方法难以处理复杂交互和泛化到不同场景。

- 利用GPT强大的序列建模能力,将车辆轨迹规划建模为序列预测问题。

- 实验表明,该方法在总行程时间上优于训练数据,并具有良好的泛化能力。

📝 摘要(中文)

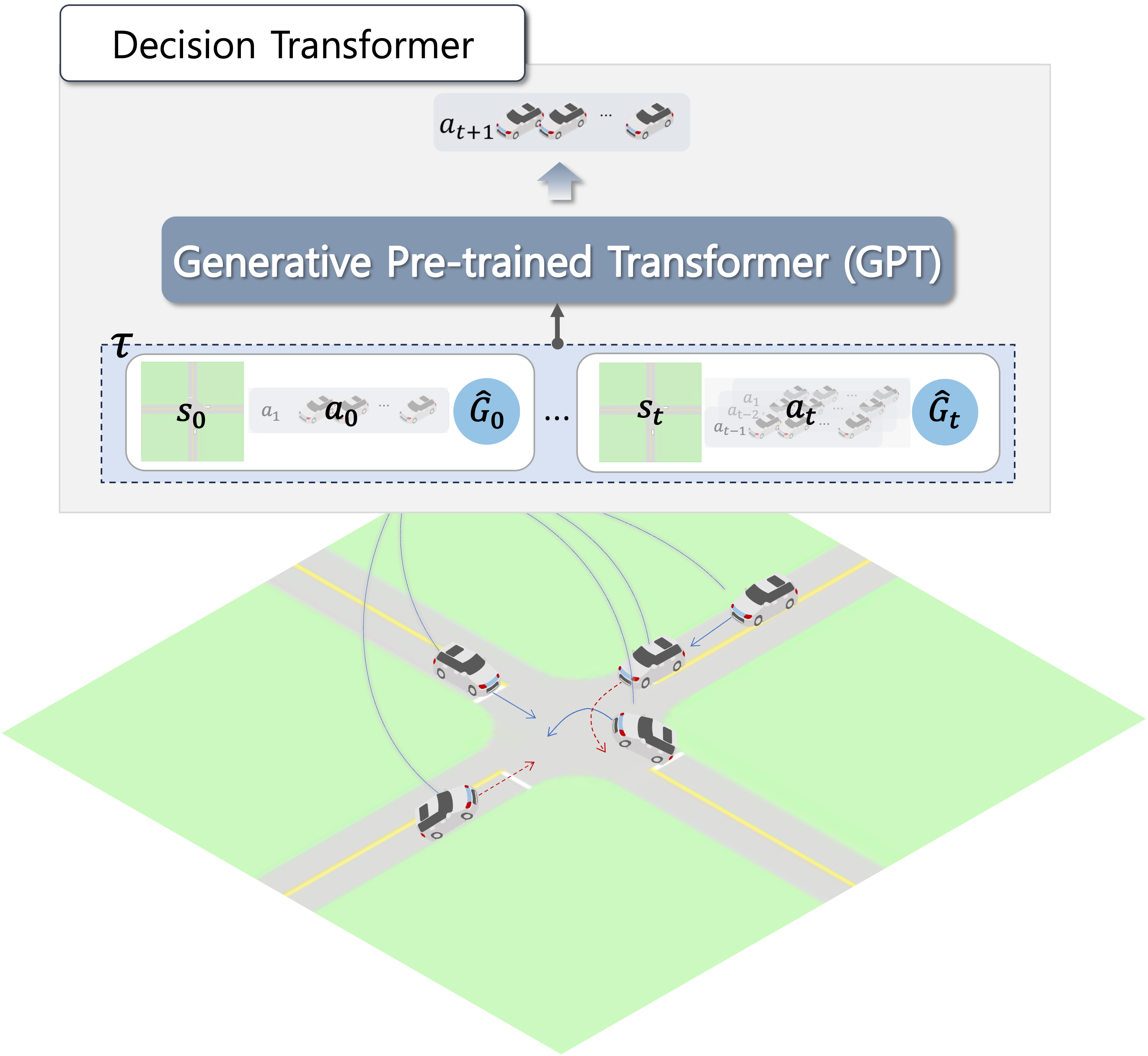

本文探索了基于生成式预训练Transformer (GPT) 架构的决策算法——决策Transformer在无信号交叉口多车辆协同中的应用。我们将协同问题建模为序列预测任务,旨在寻找交叉口多车辆的最优轨迹,从而充分利用GPT作为序列模型的强大能力。通过大量的实验,我们将该方法与基于预定的交叉口管理系统进行了比较。结果表明,决策Transformer在总行程时间方面优于训练数据,并且可以有效地推广到各种场景,包括噪声引起的车速变化、连续交互环境以及不同的车辆数量和道路配置。

🔬 方法详解

问题定义:论文旨在解决无信号交叉口多车辆协同问题,即如何为多辆车规划最优轨迹,以减少总行程时间并避免碰撞。现有方法,如基于预定的交叉口管理系统,可能难以处理车辆之间的复杂交互,并且泛化能力有限,难以适应不同的交通场景。

核心思路:论文的核心思路是将多车辆协同问题视为一个序列预测问题,并利用GPT强大的序列建模能力来预测车辆的最优轨迹。通过将车辆的状态、动作和奖励作为序列输入到GPT模型中,模型可以学习到车辆之间的交互模式,并生成能够最小化总行程时间的轨迹。

技术框架:该方法的技术框架主要包括以下几个步骤:1) 将交叉口环境建模为多智能体系统,每个车辆为一个智能体;2) 将每个智能体的状态、动作和奖励编码为序列数据;3) 使用决策Transformer模型对序列数据进行训练,学习车辆之间的交互模式;4) 在测试环境中,使用训练好的决策Transformer模型为每个车辆生成最优轨迹。

关键创新:该论文的关键创新在于将决策Transformer应用于多车辆协同问题,并将其建模为序列预测任务。与传统的基于规则或优化的方法相比,该方法能够更好地处理车辆之间的复杂交互,并且具有更强的泛化能力。此外,该方法还能够利用GPT强大的序列建模能力,学习到车辆之间的长期依赖关系。

关键设计:论文中关键的设计包括:1) 使用Transformer架构作为决策模型,以捕捉序列数据中的长期依赖关系;2) 使用奖励函数来指导模型的训练,奖励函数的设计目标是最小化总行程时间并避免碰撞;3) 使用经验回放技术来提高模型的训练效率;4) 对输入数据进行归一化处理,以提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于GPT的决策Transformer在总行程时间方面优于训练数据,并且可以有效地推广到各种场景,包括噪声引起的车速变化、连续交互环境以及不同的车辆数量和道路配置。该方法在复杂交通场景下表现出良好的鲁棒性和泛化能力,验证了其有效性。

🎯 应用场景

该研究成果可应用于智能交通系统,提高交叉口通行效率,减少交通拥堵和事故发生。未来可扩展到更复杂的交通场景,如城市道路网络和高速公路,实现更智能化的交通管理和控制,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

In this paper, we explore the application of the Decision Transformer, a decision-making algorithm based on the Generative Pre-trained Transformer (GPT) architecture, to multi-vehicle coordination at unsignalized intersections. We formulate the coordination problem so as to find the optimal trajectories for multiple vehicles at intersections, modeling it as a sequence prediction task to fully leverage the power of GPTs as a sequence model. Through extensive experiments, we compare our approach to a reservation-based intersection management system. Our results show that the Decision Transformer can outperform the training data in terms of total travel time and can be generalized effectively to various scenarios, including noise-induced velocity variations, continuous interaction environments, and different vehicle numbers and road configurations.