GARField: Addressing the visual Sim-to-Real gap in garment manipulation with mesh-attached radiance fields

作者: Donatien Delehelle, Darwin G. Caldwell, Fei Chen

分类: cs.RO, cs.GR

发布日期: 2024-10-07 (更新: 2025-10-15)

备注: Project site: https://ddonatien.github.io/garfield-website/

DOI: 10.1109/ROBIO64047.2024.10907327

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出GARField,利用网格附加辐射场解决服装操作中的视觉Sim-to-Real差距

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 服装操作 Sim-to-Real 辐射场 可微渲染 机器人视觉

📋 核心要点

- 机器人服装操作面临数据获取难题,高质量、带标签的数据成本高昂,阻碍了机器人建立直觉和连接计划与观察。

- GARField提出了一种新颖的可微渲染架构,从模拟状态(三角形网格)生成真实世界的观测数据,从而解决数据瓶颈。

- GARField是首个服装附加辐射场,通过从模拟数据生成真实感图像,有望缩小Sim-to-Real差距,提升机器人服装操作能力。

📝 摘要(中文)

人类能够迅速而准确地操作服装和其他纺织品,但对于机器人来说,这是一个巨大的挑战。人类表现的关键因素是能够先验地想象操作意图的预期结果,从而预测服装的姿态。这种能力使我们能够从高度受阻的状态进行规划,随着收集更多信息来调整我们的计划,并迅速对不可预见的情况做出反应。相反,机器人难以建立这种直觉,并在计划和观察之间形成紧密的联系。这部分归因于获取高质量和大量纺织品操作密集标记数据的成本高昂。数据收集问题是基于数据的服装操作方法中一个长期存在的问题。目前,生成高质量和标记的服装操作数据主要通过先进的数据捕获程序来实现,这些程序从真实世界的观察中创建简化的状态估计。然而,这项工作提出了一种解决该问题的新方法,即从对象状态生成真实世界的观察。为此,我们提出了GARField(Garment Attached Radiance Field),据我们所知,这是第一个可微渲染架构,用于从存储为三角形网格的模拟状态生成数据。

🔬 方法详解

问题定义:论文旨在解决机器人服装操作中,由于真实数据采集成本高昂,导致的视觉Sim-to-Real差距问题。现有方法依赖于复杂的真实世界数据捕获流程,并进行简化状态估计,效率低且难以泛化。

核心思路:论文的核心思路是从模拟的服装状态(三角形网格)出发,通过可微渲染生成逼真的图像,从而绕过真实数据采集的难题。通过这种方式,可以获得大量带有精确标签的合成数据,用于训练机器人视觉系统。

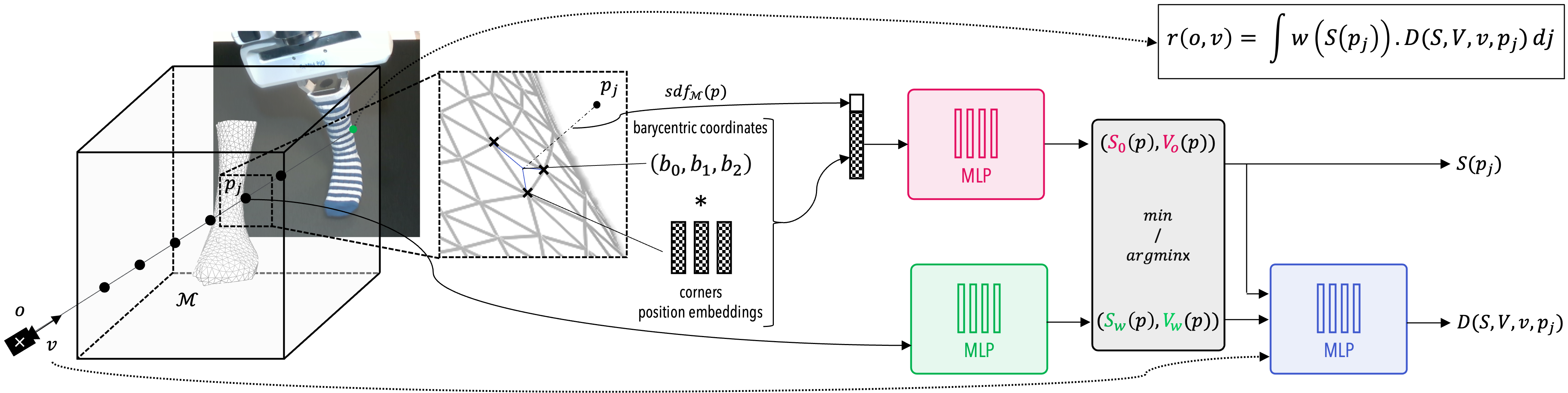

技术框架:GARField的核心是一个可微渲染器,它以服装的三角形网格作为输入,并输出渲染图像。该框架包含以下主要模块:1) 网格表示模块:将服装表示为三角形网格。2) 辐射场模块:为每个三角形面片附加一个辐射场,描述该面片的光照和颜色属性。3) 渲染模块:使用可微的光线追踪算法,将辐射场渲染成图像。

关键创新:GARField的关键创新在于将辐射场与服装的三角形网格相结合,实现了可微的服装渲染。与传统的基于模型的渲染方法相比,GARField能够更好地捕捉服装的复杂光照效果和形变。此外,GARField是可微的,这意味着可以利用梯度下降算法优化辐射场的参数,从而生成更逼真的图像。

关键设计:GARField的关键设计包括:1) 使用神经辐射场(NeRF)作为辐射场模块的基础,并针对服装的特殊性质进行了改进。2) 使用可微的光线追踪算法,保证渲染过程的可微性。3) 设计了专门的损失函数,用于优化辐射场的参数,例如,使用感知损失来提高图像的真实感。

🖼️ 关键图片

📊 实验亮点

论文提出了GARField,一种新颖的服装附加辐射场,用于解决服装操作中的视觉Sim-to-Real差距。实验结果表明,GARField能够生成逼真的服装图像,并且可以用于训练机器人进行服装操作。虽然论文中没有给出具体的性能数据和对比基线,但其提出的框架为解决机器人服装操作问题提供了一种新的思路。

🎯 应用场景

GARField在机器人服装操作、虚拟试衣、游戏和电影制作等领域具有广泛的应用前景。它可以用于生成逼真的服装图像,训练机器人进行服装折叠、整理和穿戴等任务。此外,GARField还可以用于创建虚拟试衣间,让用户可以在家中试穿各种服装,提高购物体验。

📄 摘要(原文)

While humans intuitively manipulate garments and other textile items swiftly and accurately, it is a significant challenge for robots. A factor crucial to human performance is the ability to imagine, a priori, the intended result of the manipulation intents and hence develop predictions on the garment pose. That ability allows us to plan from highly obstructed states, adapt our plans as we collect more information and react swiftly to unforeseen circumstances. Conversely, robots struggle to establish such intuitions and form tight links between plans and observations. We can partly attribute this to the high cost of obtaining densely labelled data for textile manipulation, both in quality and quantity. The problem of data collection is a long-standing issue in data-based approaches to garment manipulation. As of today, generating high-quality and labelled garment manipulation data is mainly attempted through advanced data capture procedures that create simplified state estimations from real-world observations. However, this work proposes a novel approach to the problem by generating real-world observations from object states. To achieve this, we present GARField (Garment Attached Radiance Field), the first differentiable rendering architecture, to our knowledge, for data generation from simulated states stored as triangle meshes. Code is available on https://ddonatien.github.io/garfield-website/