Unsupervised Skill Discovery for Robotic Manipulation through Automatic Task Generation

作者: Paul Jansonnie, Bingbing Wu, Julien Perez, Jan Peters

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-10-07

备注: Accepted at the 2024 IEEE-RAS International Conference on Humanoid Robots

💡 一句话要点

提出一种基于自动任务生成的机器人操作无监督技能发现方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 技能学习 无监督学习 强化学习 自动任务生成

📋 核心要点

- 机器人操作中,学习与物体交互的技能至关重要,这些技能可以作为解决各种操作任务的有效先验。

- 该方法通过自主生成大量任务,学习可组合的行为,并将这些行为嵌入到原语中,结合分层强化学习解决新任务。

- 实验表明,该方法学习到的技能更具交互性,并且能够解决模拟和真实机器人平台上的未见过的操作任务。

📝 摘要(中文)

本文提出了一种新的技能学习方法,通过解决大量且多样化的自主生成任务来发现可组合的行为,从而实现机器人操作的技能学习。该方法学习到的技能使机器人能够持续且稳健地与其环境中的物体进行交互。发现的行为被嵌入到原语中,这些原语可以与分层强化学习相结合,以解决未见过的操作任务。特别地,我们利用非对称自博弈来发现行为,并利用乘法组合策略来嵌入它们。我们将我们的方法与技能学习基线进行比较,发现我们的技能更具交互性。此外,学习到的技能可以用于解决一系列未见过的操作任务,包括在模拟环境和真实的机器人平台上。

🔬 方法详解

问题定义:现有机器人技能学习方法在生成多样化和具有挑战性的任务方面存在困难,导致学习到的技能泛化能力不足,难以适应新的操作任务。此外,如何有效地将学习到的技能进行组合,以解决复杂的任务也是一个挑战。

核心思路:本文的核心思路是通过自动生成大量多样化的任务,让机器人自主探索和学习与物体交互的技能。通过非对称自博弈(Asymmetric Self-Play)来生成任务,并使用乘法组合策略(Multiplicative Compositional Policies)将学习到的技能嵌入到原语中,从而实现技能的组合和泛化。

技术框架:该方法主要包含以下几个阶段:1) 任务生成阶段:使用非对称自博弈生成大量多样化的操作任务。2) 技能学习阶段:通过强化学习算法,学习在每个任务中与物体交互的技能。3) 技能嵌入阶段:使用乘法组合策略将学习到的技能嵌入到原语中。4) 技能组合阶段:使用分层强化学习将原语进行组合,以解决新的操作任务。

关键创新:该方法的主要创新点在于:1) 提出了一种基于自动任务生成的无监督技能发现方法,能够自主生成大量多样化的操作任务。2) 使用非对称自博弈来生成任务,能够有效地探索任务空间,并生成具有挑战性的任务。3) 使用乘法组合策略将学习到的技能嵌入到原语中,能够实现技能的有效组合和泛化。

关键设计:在任务生成阶段,使用两个智能体进行博弈,一个智能体负责生成任务,另一个智能体负责解决任务。任务生成智能体的目标是生成能够最大化解决任务智能体难度和多样性的任务。在技能学习阶段,可以使用各种强化学习算法,如DDPG、SAC等。在技能嵌入阶段,乘法组合策略通过将多个技能的策略进行乘法组合,从而实现技能的组合。损失函数的设计需要考虑技能的交互性和泛化能力。

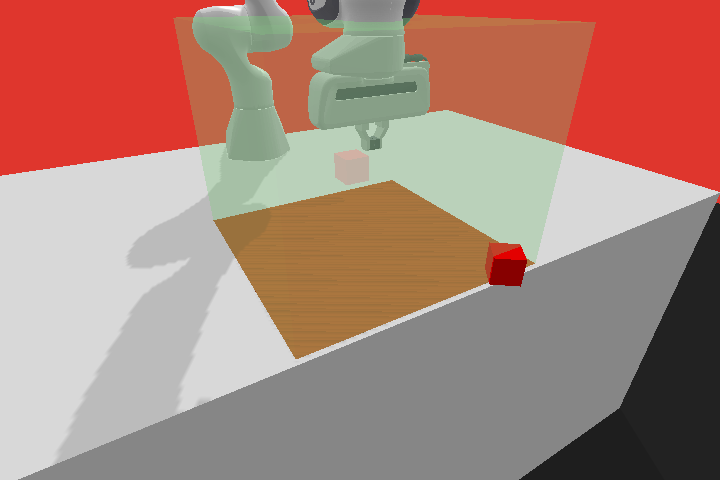

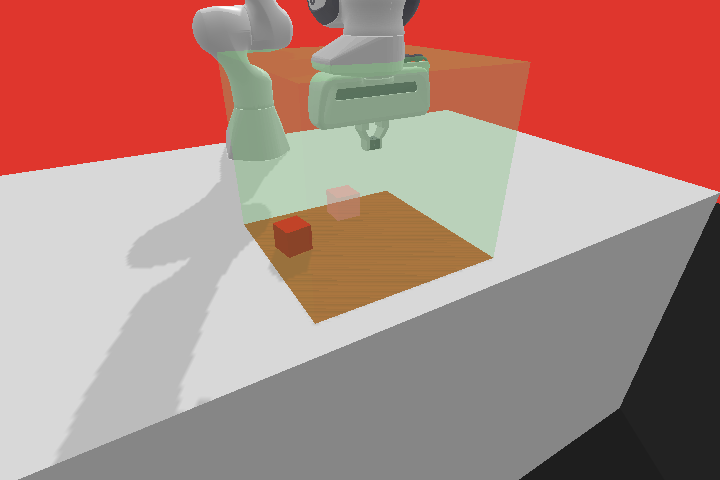

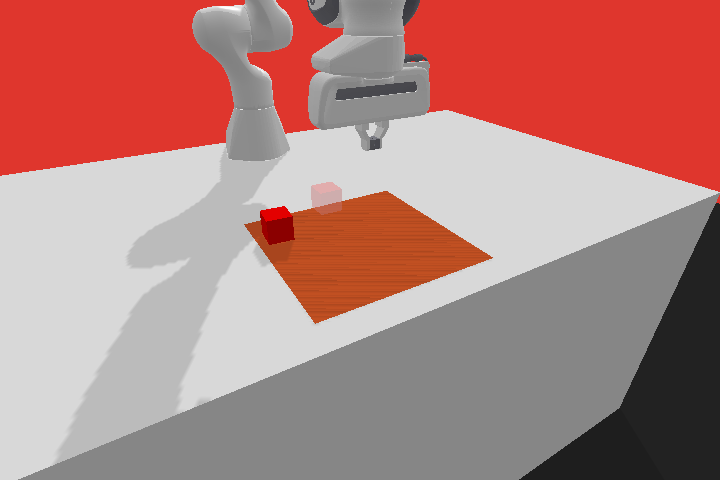

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法学习到的技能比基线方法更具交互性,能够更好地与物体进行交互。此外,学习到的技能可以成功地迁移到未见过的操作任务中,包括在模拟环境和真实的机器人平台上。在真实机器人实验中,该方法能够成功地完成一系列操作任务,验证了其有效性和泛化能力。

🎯 应用场景

该研究成果可应用于各种机器人操作任务,例如:工业自动化中的装配、抓取和放置;家庭服务机器人中的物品整理、清洁和烹饪;医疗机器人中的手术辅助和康复训练。通过自主学习和组合技能,机器人能够更好地适应复杂和动态的环境,提高工作效率和智能化水平,具有广阔的应用前景。

📄 摘要(原文)

Learning skills that interact with objects is of major importance for robotic manipulation. These skills can indeed serve as an efficient prior for solving various manipulation tasks. We propose a novel Skill Learning approach that discovers composable behaviors by solving a large and diverse number of autonomously generated tasks. Our method learns skills allowing the robot to consistently and robustly interact with objects in its environment. The discovered behaviors are embedded in primitives which can be composed with Hierarchical Reinforcement Learning to solve unseen manipulation tasks. In particular, we leverage Asymmetric Self-Play to discover behaviors and Multiplicative Compositional Policies to embed them. We compare our method to Skill Learning baselines and find that our skills are more interactive. Furthermore, the learned skills can be used to solve a set of unseen manipulation tasks, in simulation as well as on a real robotic platform.