ETHcavation: A Dataset and Pipeline for Panoptic Scene Understanding and Object Tracking in Dynamic Construction Environments

作者: Lorenzo Terenzi, Julian Nubert, Pol Eyschen, Pascal Roth, Simin Fei, Edo Jelavic, Marco Hutter

分类: cs.RO

发布日期: 2024-10-05

备注: 9 pages, 7 figures, 4 tables, submitted to 2024 Australasian Conference on Robotics and Automation (ACRA 2024)

🔗 代码/项目: GITHUB | PROJECT_PAGE

💡 一句话要点

ETHcavation:提出动态建筑环境下的全景场景理解与目标跟踪数据集及流程。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 全景场景理解 动态环境 建筑工地 目标跟踪 激光雷达建图

📋 核心要点

- 建筑工地环境复杂且动态,现有自主系统难以有效理解和应对其中的挑战。

- 该研究融合2D全景分割与3D激光雷达建图,结合卡尔曼滤波跟踪,实现动态场景理解。

- 通过微调预训练模型和动态全景建图,并在自主导航中验证了系统的有效性。

📝 摘要(中文)

本文提出了一种综合性的全景场景理解方案,旨在应对建筑工地等非结构化环境中动态行为体的挑战。该方案集成了2D全景分割与3D激光雷达建图,通过融合语义和几何数据实时生成详细的环境表示,并采用基于卡尔曼滤波的跟踪方法进行动态目标检测。此外,本文还提出了一种微调方法,利用少量特定领域的样本,使大型预训练全景分割模型适应建筑工地应用。为此,我们发布了一个首创的包含502张手工标注的全景分割图像数据集。同时,提出了一种动态全景建图技术,以增强非结构化环境中的场景理解。最后,通过自主导航案例研究,展示了该系统在动态场景中利用实时RRT*进行反应式路径规划的应用。数据集和训练部署代码已公开。

🔬 方法详解

问题定义:论文旨在解决建筑工地等动态、非结构化环境中,自主系统难以进行有效场景理解和目标跟踪的问题。现有方法在处理此类环境时,往往面临精度不足、鲁棒性差等问题,难以满足自主导航等应用的需求。

核心思路:论文的核心思路是将2D全景分割与3D激光雷达建图相结合,利用全景分割提供丰富的语义信息,激光雷达提供精确的几何信息,并通过卡尔曼滤波进行动态目标跟踪,从而实现对动态建筑工地环境的全面理解。此外,通过微调预训练模型,降低了对大量标注数据的依赖。

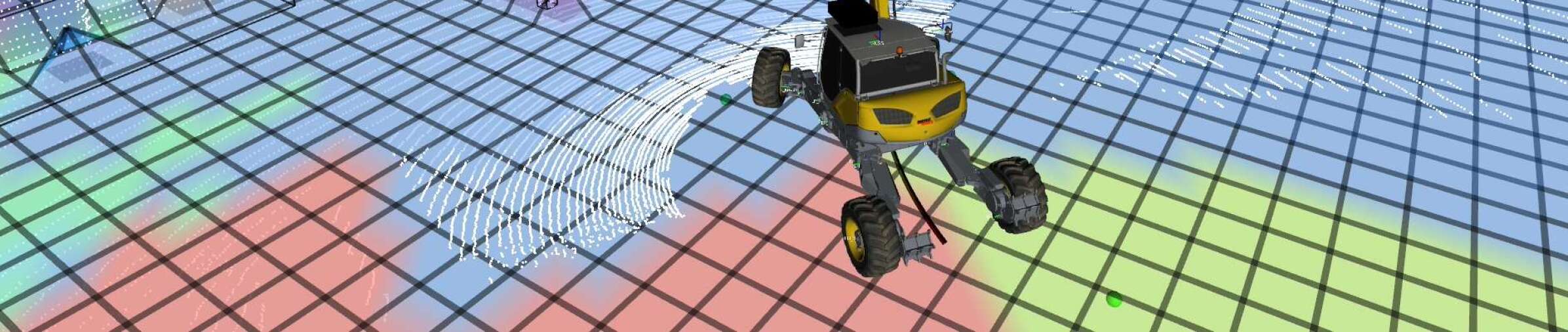

技术框架:整体框架包含以下几个主要模块:1) 数据采集:使用相机和激光雷达获取建筑工地环境的图像和点云数据。2) 2D全景分割:利用预训练的全景分割模型(如Mask R-CNN)对图像进行分割,得到像素级别的语义和实例信息。3) 3D激光雷达建图:使用激光雷达数据构建环境的三维地图。4) 数据融合:将2D全景分割结果投影到3D地图上,融合语义和几何信息。5) 动态目标跟踪:使用卡尔曼滤波对动态目标(如工人、车辆)进行跟踪。6) 动态全景建图:根据动态目标的信息更新地图,实现动态场景的表示。

关键创新:论文的关键创新点在于:1) 提出了一个针对建筑工地环境的全景分割数据集,填补了该领域的空白。2) 提出了一种动态全景建图技术,能够实时更新地图,适应动态环境的变化。3) 提出了一种微调方法,能够利用少量领域特定数据,使预训练模型适应建筑工地应用。

关键设计:微调方法使用了少量建筑工地图像进行训练,损失函数包括分割损失和分类损失。卡尔曼滤波器的状态向量包含目标的位置、速度等信息,观测模型根据激光雷达和视觉信息进行更新。动态全景建图使用体素栅格地图表示环境,并根据动态目标的运动信息更新体素的占据概率。

🖼️ 关键图片

📊 实验亮点

论文发布了一个包含502张手工标注的全景分割图像数据集,为建筑工地场景理解提供了重要的数据基础。通过微调预训练模型,在建筑工地数据集上取得了良好的分割效果,相较于直接应用通用模型,精度有显著提升。在自主导航实验中,系统能够实时生成可行的路径,并避开动态障碍物,验证了其在实际应用中的有效性。

🎯 应用场景

该研究成果可应用于建筑工地的自主导航、安全监控、资源管理等领域。例如,自主机器人可以利用该系统进行路径规划,避开障碍物和动态目标,提高工作效率和安全性。此外,该系统还可以用于实时监控工地人员和设备的位置,优化资源分配,提高管理效率。未来,该技术有望推广到其他动态、非结构化环境中,如矿山、仓库等。

📄 摘要(原文)

Construction sites are challenging environments for autonomous systems due to their unstructured nature and the presence of dynamic actors, such as workers and machinery. This work presents a comprehensive panoptic scene understanding solution designed to handle the complexities of such environments by integrating 2D panoptic segmentation with 3D LiDAR mapping. Our system generates detailed environmental representations in real-time by combining semantic and geometric data, supported by Kalman Filter-based tracking for dynamic object detection. We introduce a fine-tuning method that adapts large pre-trained panoptic segmentation models for construction site applications using a limited number of domain-specific samples. For this use case, we release a first-of-its-kind dataset of 502 hand-labeled sample images with panoptic annotations from construction sites. In addition, we propose a dynamic panoptic mapping technique that enhances scene understanding in unstructured environments. As a case study, we demonstrate the system's application for autonomous navigation, utilizing real-time RRT* for reactive path planning in dynamic scenarios. The dataset (https://leggedrobotics.github.io/panoptic-scene-understanding.github.io/) and code (https://github.com/leggedrobotics/rsl_panoptic_mapping) for training and deployment are publicly available to support future research.