Learning Humanoid Locomotion over Challenging Terrain

作者: Ilija Radosavovic, Sarthak Kamat, Trevor Darrell, Jitendra Malik

分类: cs.RO, cs.LG

发布日期: 2024-10-04

备注: Project page: https://humanoid-challenging-terrain.github.io

💡 一句话要点

提出基于Transformer的强化学习方法,实现复杂地形下人形机器人稳健运动控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人形机器人 运动控制 复杂地形 强化学习 Transformer 序列建模 步态规划

📋 核心要点

- 传统人形机器人控制器难以泛化到复杂地形,而基于学习的方法主要集中在平坦地形,缺乏通用性。

- 利用Transformer模型学习历史观测和动作,预测下一步动作,实现对复杂地形的适应性控制。

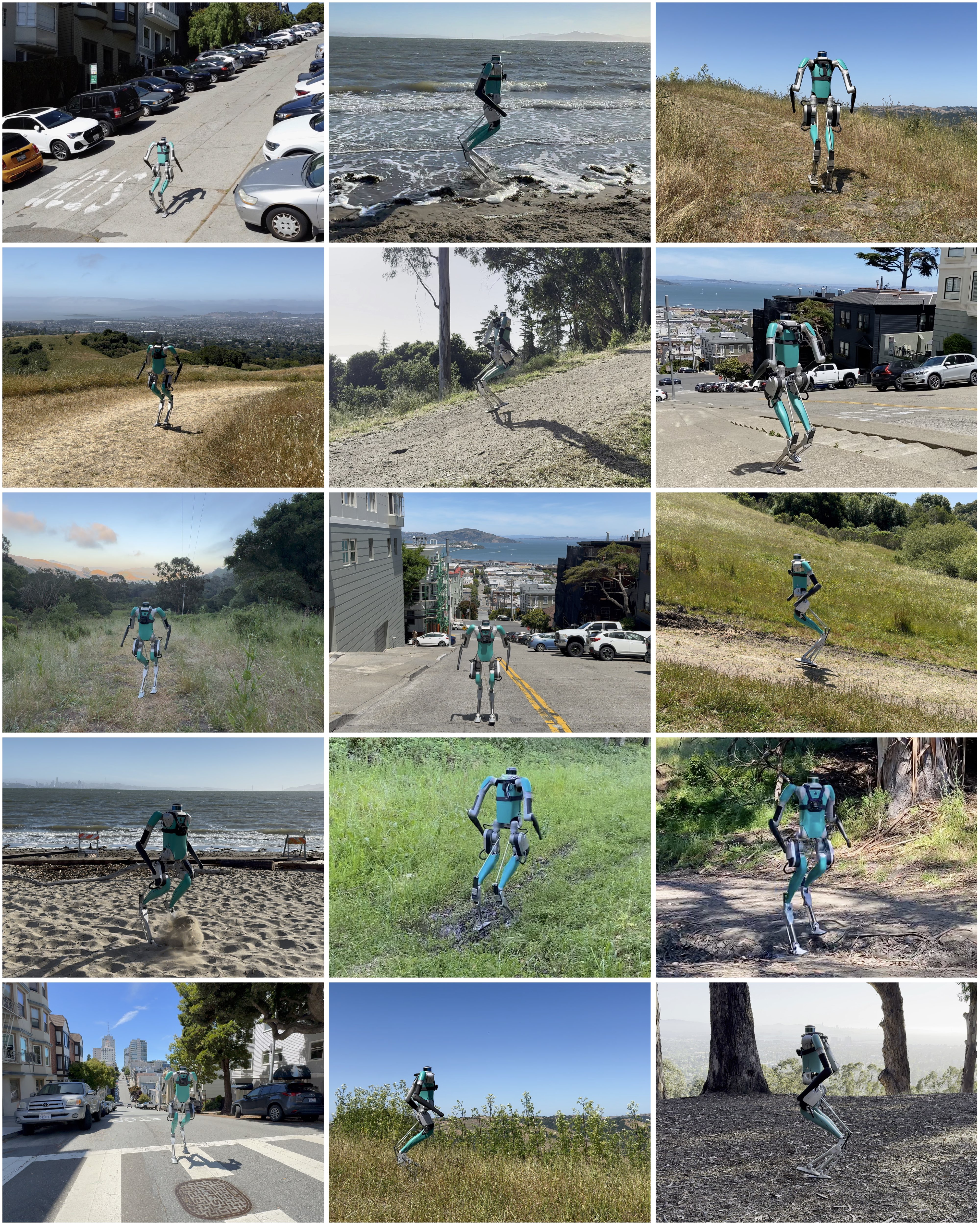

- 在真实机器人上验证,成功穿越多种复杂地形,包括徒步小径和陡峭街道,展示了良好的鲁棒性和泛化能力。

📝 摘要(中文)

本文提出了一种基于学习的人形机器人盲步态控制方法,使其能够在具有挑战性的自然和人造地形中运动。该方法使用Transformer模型,根据本体感受观测和动作的历史记录来预测下一步的动作。首先,使用序列建模在平坦地面轨迹数据集上预训练模型,然后使用强化学习在不平坦地形上进行微调。在真实的人形机器人上,对各种地形(包括粗糙、可变形和倾斜表面)评估了该模型。结果表明,该模型具有鲁棒的性能、上下文适应能力和涌现的地形表征。在真实世界的案例研究中,人形机器人成功地穿越了伯克利超过4英里的徒步小径,并爬上了旧金山一些最陡峭的街道。

🔬 方法详解

问题定义:现有的人形机器人运动控制方法在复杂地形下的泛化能力不足。传统控制器依赖于精确的环境建模,难以适应自然环境的变化。基于学习的方法虽然在平坦地形上取得了进展,但在粗糙、可变形或倾斜等复杂地形上的表现仍然不佳。因此,需要一种能够适应各种复杂地形的人形机器人运动控制方法。

核心思路:本文的核心思路是利用Transformer模型学习人形机器人的运动策略,使其能够根据历史的本体感受观测和动作,预测下一步的动作。Transformer模型具有强大的序列建模能力,可以捕捉运动过程中的时间依赖关系,从而实现对复杂地形的适应。通过预训练和强化学习相结合的方式,提高模型的泛化能力和鲁棒性。

技术框架:该方法主要包含两个阶段:预训练和微调。在预训练阶段,使用大量的平坦地面轨迹数据,通过序列建模的方式训练Transformer模型,使其学习基本的运动模式。在微调阶段,使用强化学习算法,在各种复杂地形上训练模型,使其能够适应不同的地形特征。整体框架包括感知模块(获取本体感受信息)、Transformer模型(预测动作)和控制模块(执行动作)。

关键创新:该方法的关键创新在于使用Transformer模型进行人形机器人的运动控制。与传统的基于规则或优化的控制器相比,Transformer模型可以自动学习运动策略,无需人工设计复杂的控制规则。此外,通过预训练和强化学习相结合的方式,提高了模型的泛化能力和鲁棒性,使其能够适应各种复杂地形。

关键设计:Transformer模型的输入包括历史的本体感受观测(例如关节角度、角速度等)和动作。模型的输出是下一步的动作。在预训练阶段,使用序列到序列的损失函数,例如交叉熵损失函数。在微调阶段,使用强化学习算法,例如PPO(Proximal Policy Optimization),优化奖励函数,奖励函数的设计需要考虑运动的稳定性、速度和能量消耗等因素。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

该方法在真实的人形机器人上进行了验证,成功穿越了伯克利超过4英里的徒步小径,并爬上了旧金山一些最陡峭的街道。这些实验结果表明,该方法具有良好的鲁棒性和泛化能力,能够适应各种复杂地形。具体性能数据未知,但实验结果表明该方法优于现有方法。

🎯 应用场景

该研究成果可应用于搜救、勘探、物流等领域。人形机器人能够在复杂地形下自主行走,可以代替人类完成危险或困难的任务。例如,在地震灾区进行搜救,在矿山进行勘探,或是在崎岖地形上进行物流配送。此外,该技术还可以用于开发更智能的假肢和外骨骼,帮助残疾人或老年人恢复运动能力。

📄 摘要(原文)

Humanoid robots can, in principle, use their legs to go almost anywhere. Developing controllers capable of traversing diverse terrains, however, remains a considerable challenge. Classical controllers are hard to generalize broadly while the learning-based methods have primarily focused on gentle terrains. Here, we present a learning-based approach for blind humanoid locomotion capable of traversing challenging natural and man-made terrain. Our method uses a transformer model to predict the next action based on the history of proprioceptive observations and actions. The model is first pre-trained on a dataset of flat-ground trajectories with sequence modeling, and then fine-tuned on uneven terrain using reinforcement learning. We evaluate our model on a real humanoid robot across a variety of terrains, including rough, deformable, and sloped surfaces. The model demonstrates robust performance, in-context adaptation, and emergent terrain representations. In real-world case studies, our humanoid robot successfully traversed over 4 miles of hiking trails in Berkeley and climbed some of the steepest streets in San Francisco.