STREAMS: An Assistive Multimodal AI Framework for Empowering Biosignal Based Robotic Controls

作者: Ali Rabiee, Sima Ghafoori, Xiangyu Bai, Sarah Ostadabbas, Reza Abiri

分类: cs.RO

发布日期: 2024-10-04 (更新: 2025-06-10)

💡 一句话要点

STREAMS:一种辅助性多模态AI框架,用于增强基于生物信号的机器人控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 辅助机器人 生物信号控制 深度强化学习 多模态融合 DQN 人机交互

📋 核心要点

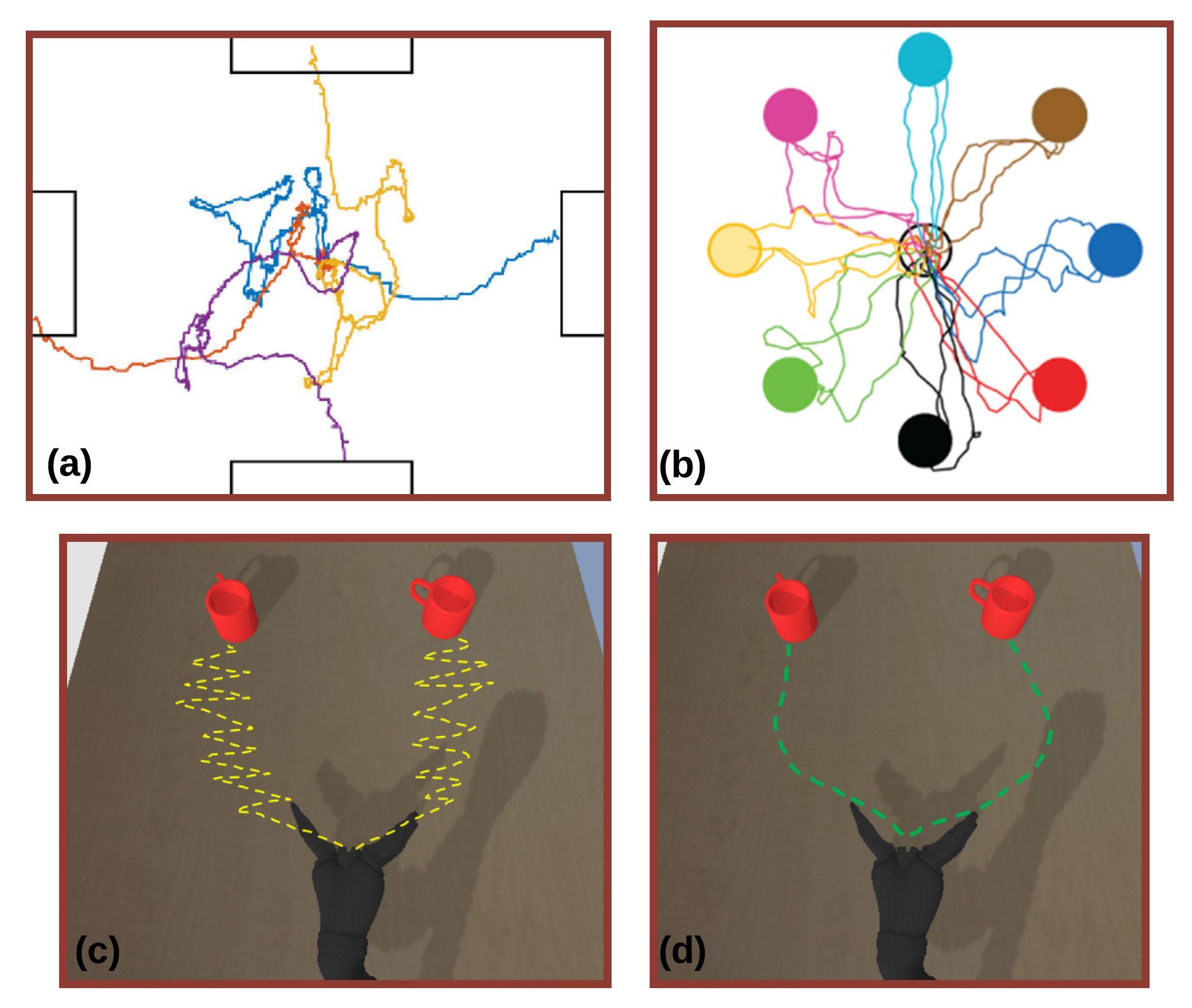

- 基于末端执行器的辅助机器人在使用生物信号控制时,面临轨迹不平滑和鲁棒性差的挑战,难以完成复杂的抓取任务。

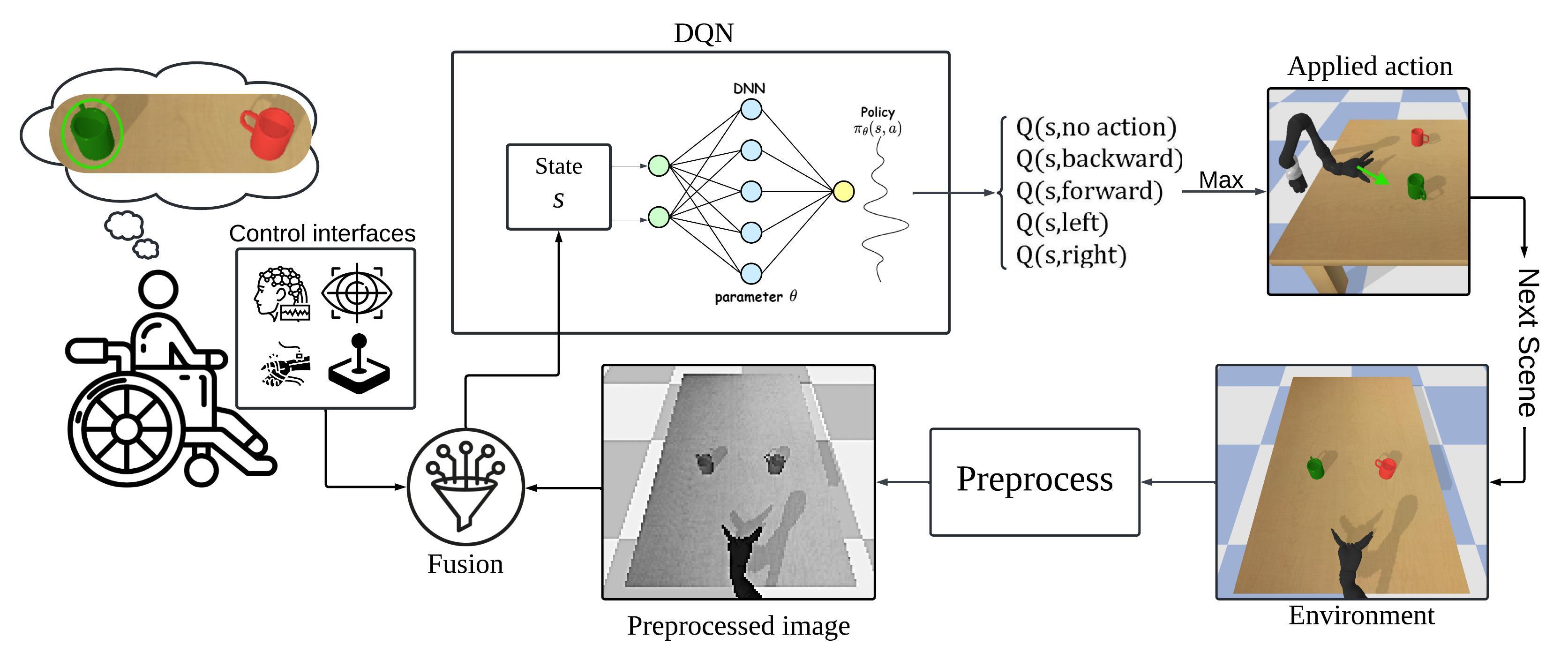

- STREAMS框架融合环境信息和合成用户输入,利用深度强化学习实现端到端的自训练,从而生成平滑的机器人控制轨迹。

- 实验表明,STREAMS在仿真和真实机器人控制中均取得了显著的性能提升,尤其是在轨迹稳定性和任务成功率方面。

📝 摘要(中文)

本文提出STREAMS(自训练机器人端到端自适应多模态共享自主)框架,利用深度强化学习解决基于生物信号(如肌肉活动和脑电波)控制机器人时轨迹生成不平滑和鲁棒性差的问题。STREAMS将环境信息和合成用户输入融入到深度Q学习网络(DQN)流程中,实现交互式的端到端自训练机制,为末端执行器机器人生成平滑的控制轨迹。在仿真环境中,该框架在动态目标估计和获取方面取得了98%的高性能记录,且无需任何预先存在的数据集。通过对五名参与者进行的零样本sim-to-real用户研究,使用嘈杂的头部运动控制物理机械臂,STREAMS(作为辅助模式)在轨迹稳定、用户满意度和任务性能方面表现出显著的改进,成功率达到83%,而没有任务支持的手动模式成功率为44%。STREAMS旨在通过提供交互式的端到端解决方案来稳定末端执行器的轨迹,从而提高基于生物信号的辅助机器人控制,增强任务性能和准确性。

🔬 方法详解

问题定义:论文旨在解决基于生物信号(如肌电信号、脑电信号)控制的辅助机器人系统,其末端执行器轨迹生成不平滑、不鲁棒的问题。现有的方法通常难以处理生物信号的噪声和不确定性,导致机器人动作的精度和稳定性不足,无法完成复杂的任务,例如稳定的抓取。

核心思路:论文的核心思路是利用深度强化学习,构建一个端到端的自训练框架,将环境信息和合成的用户输入融入到学习过程中,从而使机器人能够学习到更加平滑和鲁棒的控制策略。通过模拟环境中的大量训练,机器人可以逐渐适应生物信号的特性,并学会如何根据这些信号来精确地控制末端执行器的运动。

技术框架:STREAMS框架的核心是一个深度Q学习网络(DQN)。该网络接收来自环境的传感器数据和合成的用户输入作为输入,输出是机器人末端执行器的控制指令。整个框架采用端到端的训练方式,通过与环境的交互不断优化DQN的参数。此外,框架还包含一个动态目标估计模块,用于在仿真环境中生成不同的目标位置,从而增加训练数据的多样性。

关键创新:STREAMS的关键创新在于其自训练和多模态融合的特性。传统的机器人控制方法通常需要大量的人工标注数据,而STREAMS可以通过与环境的交互自动生成训练数据,降低了对人工标注的依赖。同时,STREAMS融合了环境信息和合成的用户输入,使得机器人能够更好地理解用户的意图,并根据环境的变化做出相应的调整。这种多模态融合的方式提高了机器人的鲁棒性和适应性。

关键设计:STREAMS使用深度Q网络(DQN)作为其核心控制策略学习器。具体而言,DQN的输入包括机器人的状态(例如,末端执行器的位置和速度)、环境信息(例如,目标的位置)以及合成的用户输入(模拟生物信号)。DQN的输出是机器人可以采取的动作(例如,末端执行器的运动方向和速度)。DQN的训练采用标准的Q学习算法,通过最大化累积奖励来优化网络的参数。奖励函数的设计至关重要,它需要鼓励机器人尽快到达目标位置,同时避免碰撞和其他不期望的行为。论文中使用了ε-greedy策略来平衡探索和利用,以避免陷入局部最优解。

🖼️ 关键图片

📊 实验亮点

STREAMS在仿真环境中取得了98%的任务成功率,无需任何预训练数据集。在零样本sim-to-real用户研究中,与手动控制模式(44%成功率)相比,STREAMS辅助模式将任务成功率显著提升至83%,同时用户满意度和轨迹稳定性也得到了显著改善。这些结果表明,STREAMS框架具有良好的泛化能力和实用价值。

🎯 应用场景

STREAMS框架具有广泛的应用前景,可用于开发各种基于生物信号控制的辅助机器人系统,例如,帮助残疾人完成日常任务的机械臂、用于康复训练的机器人以及在危险环境中进行操作的远程控制机器人。该研究有望提高辅助机器人的智能化水平,改善用户体验,并为残疾人提供更加便捷和高效的辅助工具。

📄 摘要(原文)

End-effector based assistive robots face persistent challenges in generating smooth and robust trajectories when controlled by human's noisy and unreliable biosignals such as muscle activities and brainwaves. The produced endpoint trajectories are often jerky and imprecise to perform complex tasks such as stable robotic grasping. We propose STREAMS (Self-Training Robotic End-to-end Adaptive Multimodal Shared autonomy) as a novel framework leveraged deep reinforcement learning to tackle this challenge in biosignal based robotic control systems. STREAMS blends environmental information and synthetic user input into a Deep Q Learning Network (DQN) pipeline for an interactive end-to-end and self-training mechanism to produce smooth trajectories for the control of end-effector based robots. The proposed framework achieved a high-performance record of 98% in simulation with dynamic target estimation and acquisition without any pre-existing datasets. As a zero-shot sim-to-real user study with five participants controlling a physical robotic arm with noisy head movements, STREAMS (as an assistive mode) demonstrated significant improvements in trajectory stabilization, user satisfaction, and task performance reported as a success rate of 83% compared to manual mode which was 44% without any task support. STREAMS seeks to improve biosignal based assistive robotic controls by offering an interactive, end-to-end solution that stabilizes end-effector trajectories, enhancing task performance and accuracy.