AHA: A Vision-Language-Model for Detecting and Reasoning Over Failures in Robotic Manipulation

作者: Jiafei Duan, Wilbert Pumacay, Nishanth Kumar, Yi Ru Wang, Shulin Tian, Wentao Yuan, Ranjay Krishna, Dieter Fox, Ajay Mandlekar, Yijie Guo

分类: cs.RO

发布日期: 2024-10-01

备注: Appendix and details can be found in project website: https://aha-vlm.github.io/

💡 一句话要点

AHA:用于机器人操作失败检测与推理的视觉-语言模型

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 机器人操作 失败检测 自然语言推理 强化学习

📋 核心要点

- 现有视觉-语言模型在机器人操作中难以识别失败,限制了其在现实世界中的应用。

- AHA通过将失败检测视为自由形式的推理任务,利用自然语言识别失败并提供解释。

- AHA在真实世界数据集和未见任务上表现出良好的泛化能力,并显著提升了机器人操作策略的成功率。

📝 摘要(中文)

本文提出AHA,一个开源的视觉-语言模型(VLM),旨在利用自然语言检测和推理机器人操作中的失败。AHA将失败检测定义为一个自由形式的推理任务,能够识别失败并提供详细、可适应的解释,适用于不同的机器人、任务和环境。AHA使用FailGen框架生成的大规模机器人失败轨迹数据集AHA数据集进行微调。尽管仅在AHA数据集上训练,AHA能够有效地泛化到真实世界的失败数据集、机器人系统和未见过的任务。AHA的性能超越了第二好的模型(GPT-4o的上下文学习)10.3%,并且超过了包括五个最先进的VLM在内的六个对比模型的平均性能35.3%。AHA被集成到三个利用LLM/VLM的操纵框架中,用于强化学习、任务和运动规划以及零样本轨迹生成。AHA的失败反馈通过改进密集奖励函数、优化任务规划和改进子任务验证,从而提升了这些策略的性能,与GPT-4模型相比,所有三个任务的成功率平均提高了21.4%。

🔬 方法详解

问题定义:现有视觉-语言模型在机器人操作任务中,尤其是在开放世界环境中,难以准确识别和推理失败情况。这阻碍了机器人从失败中学习并改进其操作策略,限制了其在实际场景中的应用。现有方法缺乏对失败场景的细粒度理解和解释能力,难以提供有效的反馈信号。

核心思路:AHA的核心思路是将机器人操作中的失败检测问题转化为一个自由形式的推理任务。通过利用视觉信息和自然语言描述,AHA能够识别失败并生成详细的解释,从而为机器人提供更丰富的反馈信息。这种方法允许模型学习不同类型失败的模式,并泛化到新的任务和环境。

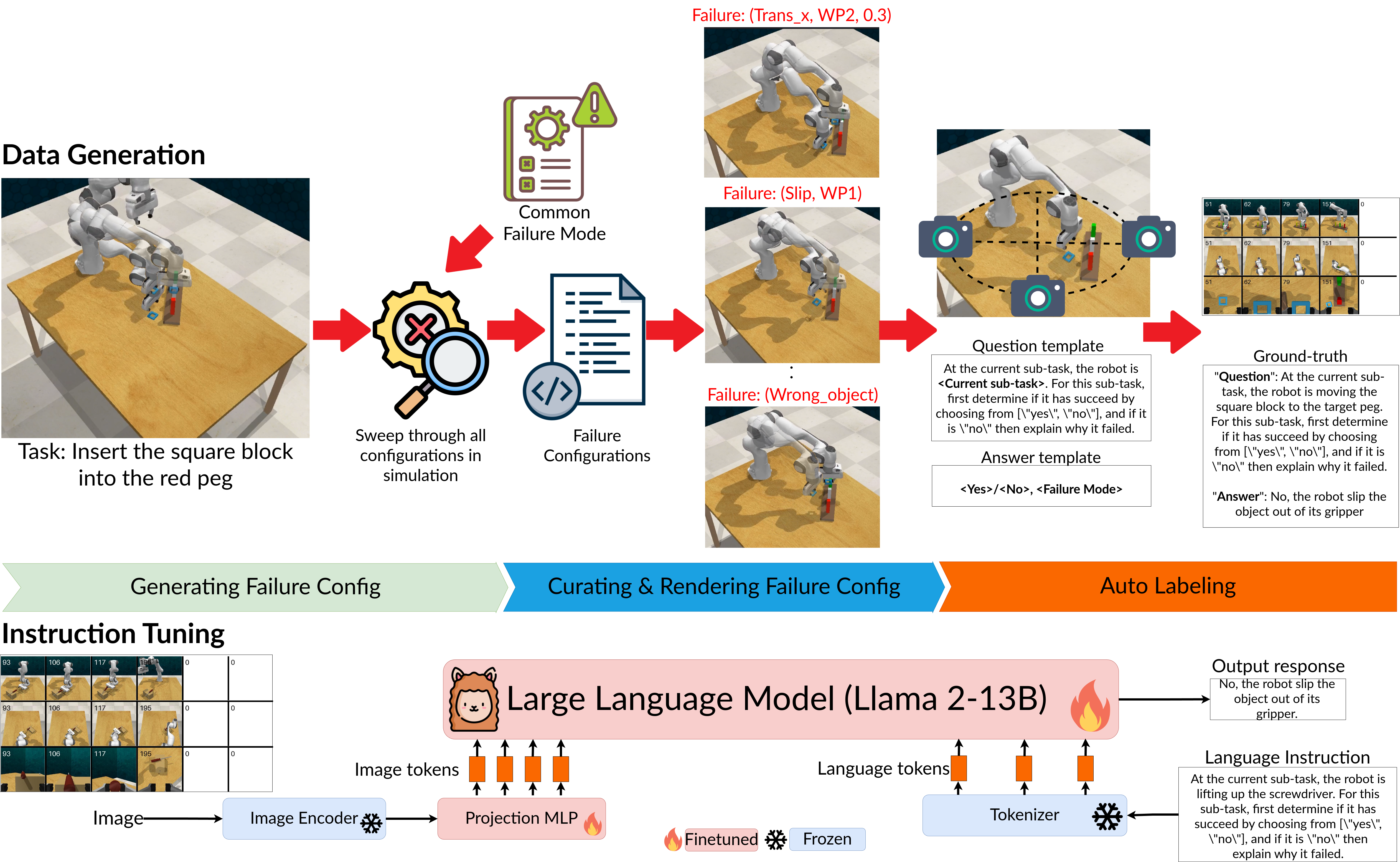

技术框架:AHA是一个视觉-语言模型,其整体架构包含视觉编码器和语言解码器。视觉编码器负责提取机器人操作场景的视觉特征,语言解码器则基于这些特征生成对失败的描述和解释。模型使用FailGen框架生成的大规模数据集AHA进行训练,FailGen通过程序化地扰动成功的演示轨迹来生成失败轨迹。AHA可以集成到不同的机器人操作框架中,例如强化学习、任务和运动规划以及零样本轨迹生成。

关键创新:AHA的关键创新在于其将失败检测视为一个自由形式的推理任务,并利用自然语言生成对失败的详细解释。此外,FailGen框架提供了一种可扩展的方法来生成大规模的机器人失败轨迹数据集,这为AHA的训练提供了充足的数据。AHA的泛化能力和集成到现有机器人框架中的能力也是其重要的创新点。

关键设计:AHA使用了预训练的视觉-语言模型作为基础架构,并在此基础上进行了微调。FailGen框架通过程序化地扰动成功的演示轨迹来生成失败轨迹,包括改变目标位置、施加外部干扰等。AHA的训练目标是最大化生成正确失败描述的概率。在集成到机器人操作框架中时,AHA的输出可以用于改进奖励函数、优化任务规划和验证子任务的执行情况。

🖼️ 关键图片

📊 实验亮点

AHA在多个数据集和任务上都取得了显著的性能提升。例如,AHA超越了GPT-4o(上下文学习)10.3%,并且超过了包括五个最先进的VLM在内的六个对比模型的平均性能35.3%。在集成到机器人操作框架中时,AHA使任务成功率平均提高了21.4%。这些结果表明AHA在机器人失败检测和推理方面具有强大的能力。

🎯 应用场景

AHA可应用于各种机器人操作任务,例如工业自动化、家庭服务机器人和医疗机器人。它可以帮助机器人更好地理解其操作环境,检测和诊断失败,并从中学习以提高其性能。AHA的自然语言解释能力使其易于集成到现有的机器人系统中,并为人类操作员提供有价值的反馈。

📄 摘要(原文)

Robotic manipulation in open-world settings requires not only task execution but also the ability to detect and learn from failures. While recent advances in vision-language models (VLMs) and large language models (LLMs) have improved robots' spatial reasoning and problem-solving abilities, they still struggle with failure recognition, limiting their real-world applicability. We introduce AHA, an open-source VLM designed to detect and reason about failures in robotic manipulation using natural language. By framing failure detection as a free-form reasoning task, AHA identifies failures and provides detailed, adaptable explanations across different robots, tasks, and environments. We fine-tuned AHA using FailGen, a scalable framework that generates the first large-scale dataset of robotic failure trajectories, the AHA dataset. FailGen achieves this by procedurally perturbing successful demonstrations from simulation. Despite being trained solely on the AHA dataset, AHA generalizes effectively to real-world failure datasets, robotic systems, and unseen tasks. It surpasses the second-best model (GPT-4o in-context learning) by 10.3% and exceeds the average performance of six compared models including five state-of-the-art VLMs by 35.3% across multiple metrics and datasets. We integrate AHA into three manipulation frameworks that utilize LLMs/VLMs for reinforcement learning, task and motion planning, and zero-shot trajectory generation. AHA's failure feedback enhances these policies' performances by refining dense reward functions, optimizing task planning, and improving sub-task verification, boosting task success rates by an average of 21.4% across all three tasks compared to GPT-4 models.