UniAff: A Unified Representation of Affordances for Tool Usage and Articulation with Vision-Language Models

作者: Qiaojun Yu, Siyuan Huang, Xibin Yuan, Zhengkai Jiang, Ce Hao, Xin Li, Haonan Chang, Junbo Wang, Liu Liu, Hongsheng Li, Peng Gao, Cewu Lu

分类: cs.RO

发布日期: 2024-09-30 (更新: 2025-02-07)

备注: ICRA 2025

💡 一句话要点

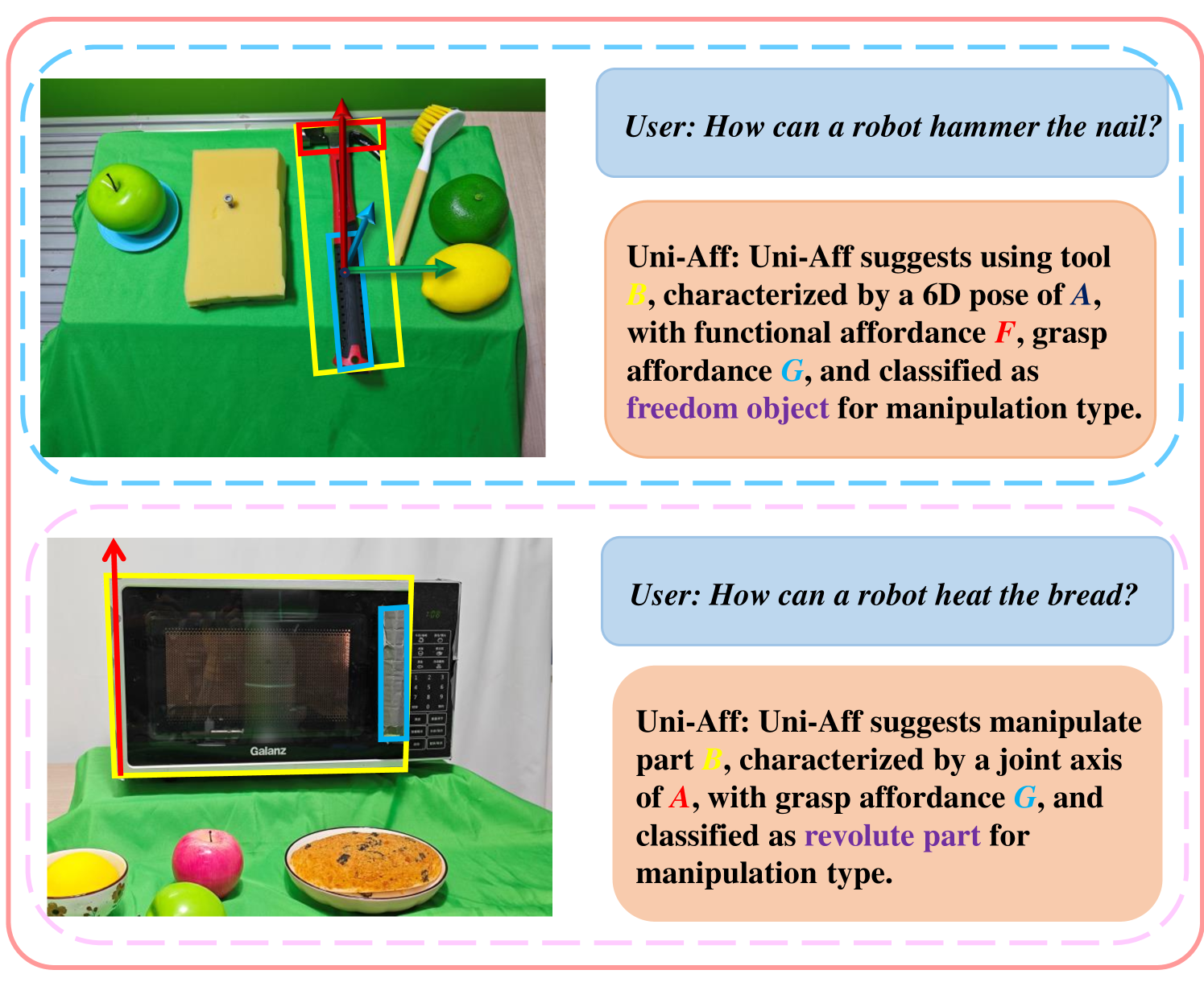

UniAff:利用视觉-语言模型统一工具使用和关节运动的 affordance 表示

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 机器人操纵 Affordance 视觉-语言模型 多模态学习 关节物体 工具使用 3D运动约束 统一表示

📋 核心要点

- 现有机器人操纵研究对底层3D运动约束和 affordance 的理解有限,阻碍了其泛化能力。

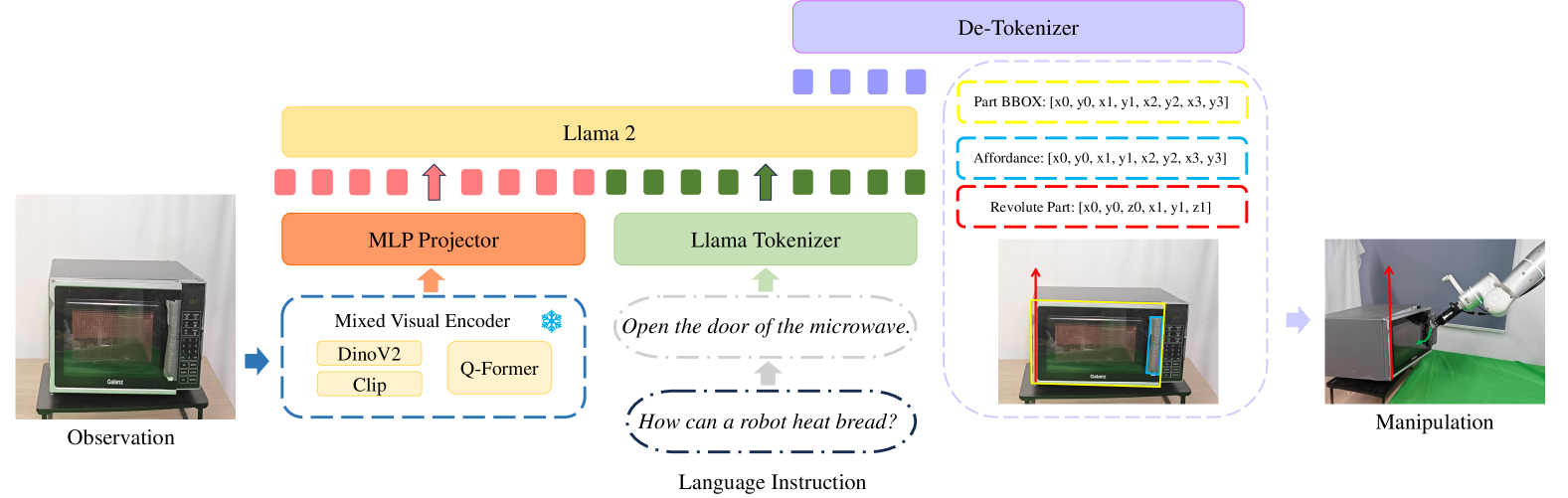

- UniAff 提出了一种统一的框架,整合了3D物体中心操纵和任务理解,利用MLLMs进行 affordance 识别和3D运动约束推理。

- 实验结果表明,UniAff 显著提高了机器人操纵工具和关节物体的泛化能力,为未来的研究奠定了基础。

📝 摘要(中文)

本文提出了一种名为UniAff的综合范式,旨在统一3D以物体为中心的操纵和任务理解。为了实现这一目标,作者构建了一个数据集,该数据集标注了与操纵相关的关键属性,包含来自19个类别的900个关节物体和来自12个类别的600个工具。此外,本文利用多模态大语言模型(MLLMs)来推断用于操纵任务的以物体为中心的表示,包括 affordance 识别和关于3D运动约束的推理。在仿真和真实环境中的综合实验表明,UniAff显著提高了机器人操纵工具和关节物体的泛化能力。UniAff有望成为未来统一机器人操纵任务的通用基线。

🔬 方法详解

问题定义:现有的机器人操纵方法在理解物体 affordance 和 3D 运动约束方面存在局限性,导致泛化能力不足。特别是对于工具的使用和关节物体的操作,缺乏统一的表示和推理框架。

核心思路:UniAff 的核心思路是构建一个统一的 affordance 表示,能够同时处理工具的使用和关节物体的操作。通过利用多模态大语言模型(MLLMs)的强大推理能力,将视觉信息和语言信息结合起来,从而更好地理解物体的 affordance 和 3D 运动约束。

技术框架:UniAff 的整体框架包括以下几个主要模块:1) 数据集构建:构建包含大量工具和关节物体的数据集,并标注与操纵相关的关键属性。2) MLLM 集成:利用 MLLMs 推断以物体为中心的表示,用于 affordance 识别和 3D 运动约束推理。3) 操纵策略学习:基于学习到的 affordance 表示,设计机器人操纵策略。

关键创新:UniAff 的关键创新在于提出了一个统一的 affordance 表示框架,能够同时处理工具的使用和关节物体的操作。此外,利用 MLLMs 进行 affordance 识别和 3D 运动约束推理,提高了机器人对操纵任务的理解能力。

关键设计:数据集包含 900 个关节物体(19 个类别)和 600 个工具(12 个类别),标注了与操纵相关的关键属性。MLLMs 的具体选择和训练方法未知。操纵策略学习的具体方法未知。

🖼️ 关键图片

📊 实验亮点

UniAff 在仿真和真实环境中的实验结果表明,该方法显著提高了机器人操纵工具和关节物体的泛化能力。具体的性能数据和对比基线未知,但摘要中强调了“显著提高”,表明 UniAff 在性能上取得了实质性的提升。该方法为未来的统一机器人操纵任务提供了一个有希望的基线。

🎯 应用场景

UniAff 有望应用于各种机器人操纵任务,例如家庭服务机器人、工业机器人和医疗机器人。它可以帮助机器人更好地理解物体 affordance 和 3D 运动约束,从而更安全、更有效地完成各种操纵任务。该研究的未来影响在于推动机器人操纵技术的进步,使其能够更好地适应复杂和动态的环境。

📄 摘要(原文)

Previous studies on robotic manipulation are based on a limited understanding of the underlying 3D motion constraints and affordances. To address these challenges, we propose a comprehensive paradigm, termed UniAff, that integrates 3D object-centric manipulation and task understanding in a unified formulation. Specifically, we constructed a dataset labeled with manipulation-related key attributes, comprising 900 articulated objects from 19 categories and 600 tools from 12 categories. Furthermore, we leverage MLLMs to infer object-centric representations for manipulation tasks, including affordance recognition and reasoning about 3D motion constraints. Comprehensive experiments in both simulation and real-world settings indicate that UniAff significantly improves the generalization of robotic manipulation for tools and articulated objects. We hope that UniAff will serve as a general baseline for unified robotic manipulation tasks in the future. Images, videos, dataset, and code are published on the project website at:https://sites.google.com/view/uni-aff/home