iWalker: Imperative Visual Planning for Walking Humanoid Robot

作者: Xiao Lin, Yuhao Huang, Taimeng Fu, Xiaobin Xiong, Chen Wang

分类: cs.RO, eess.SY

发布日期: 2024-09-27 (更新: 2025-10-27)

期刊: IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), 2025

💡 一句话要点

iWalker:面向行走人形机器人的命令式视觉规划

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人形机器人 视觉规划 步态规划 全身平衡 命令式学习 自监督学习 端到端学习 机器人控制

📋 核心要点

- 现有的人形机器人通常依赖复杂的模块化框架,导致系统不够灵活,且各模块误差会累积。

- iWalker提出了一种端到端的人形机器人行走系统,通过视觉感知进行避障和步态规划,同时保持全身平衡。

- 该方法采用基于命令式学习的双层优化,实现自监督学习,并在模拟和真实环境中验证了其有效性。

📝 摘要(中文)

人形机器人被设计用于以人为中心的环境中,是广泛任务的基础平台。尽管人形机器人已经进行了数十年的广泛研究,但现有的大多数人形机器人仍然严重依赖复杂的模块化框架,导致灵活性不足,并可能因独立的感知、规划和行动组件而产生复合误差。为此,我们提出了一个端到端的人形感知-规划-行动行走系统,能够同时实现基于视觉的避障和用于全身平衡的步态规划。我们设计了两种基于命令式学习(IL)的双层优化方法,分别用于模型预测步态规划和全身平衡,从而实现人形机器人行走的自监督学习。这使得机器人能够从任意未标记的数据中学习,提高其适应性和泛化能力。我们将我们的方法称为iWalker,并在模拟和真实环境中展示了其有效性,代表了朝着自主人形机器人迈出的重要一步。

🔬 方法详解

问题定义:论文旨在解决人形机器人在复杂环境中自主行走的问题。现有方法通常依赖于模块化的感知、规划和控制框架,这些框架之间相互独立,容易产生误差累积,且难以适应未知的环境变化。此外,依赖人工设计的规则和参数调整也限制了机器人的泛化能力。

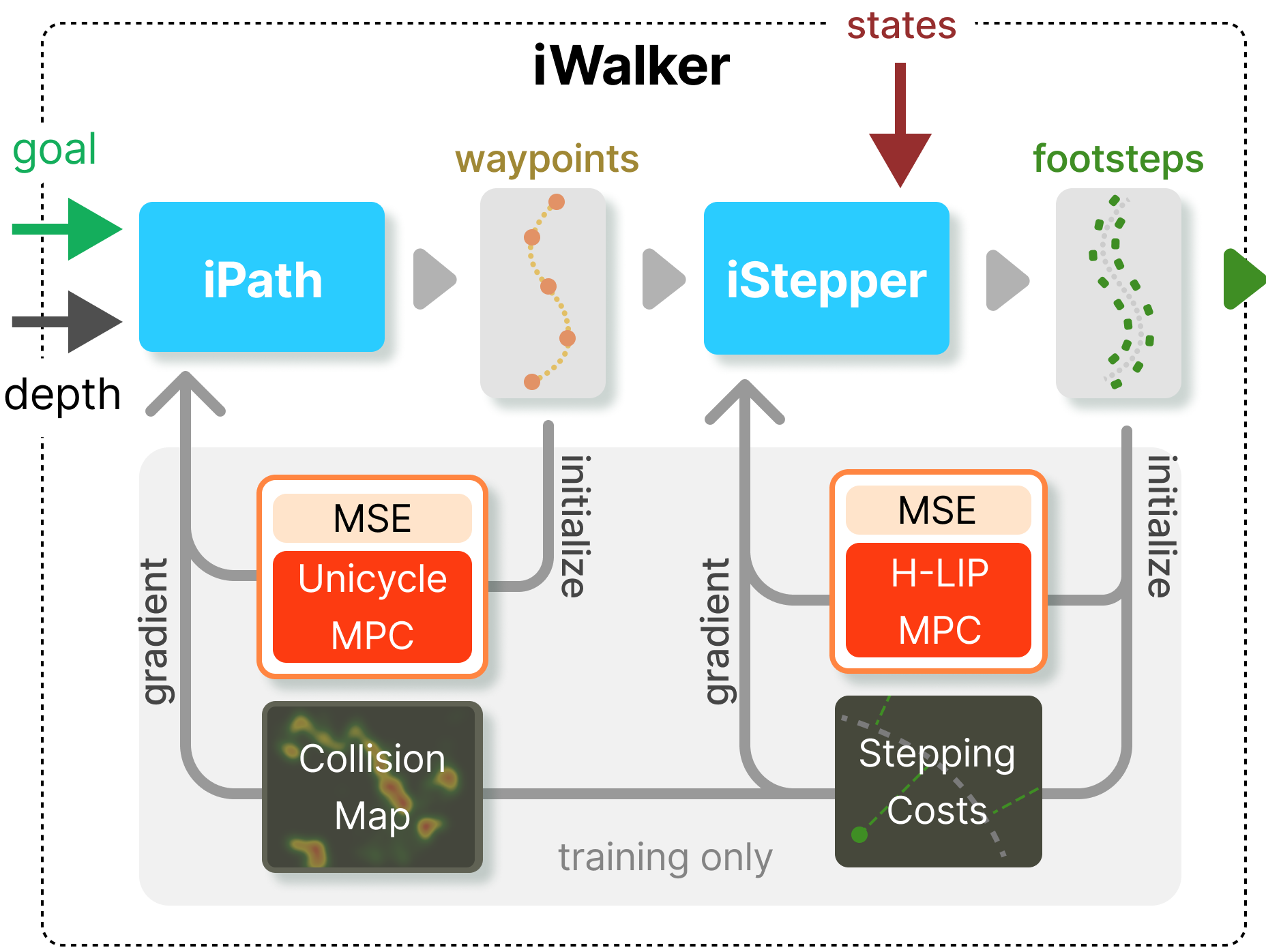

核心思路:论文的核心思路是构建一个端到端的可学习系统,直接从视觉输入到行动输出,避免了模块化框架的误差传递。通过自监督学习,机器人可以从大量未标记的数据中学习行走策略,提高其适应性和泛化能力。命令式学习(Imperative Learning)的使用允许直接指定期望的行为,简化了学习过程。

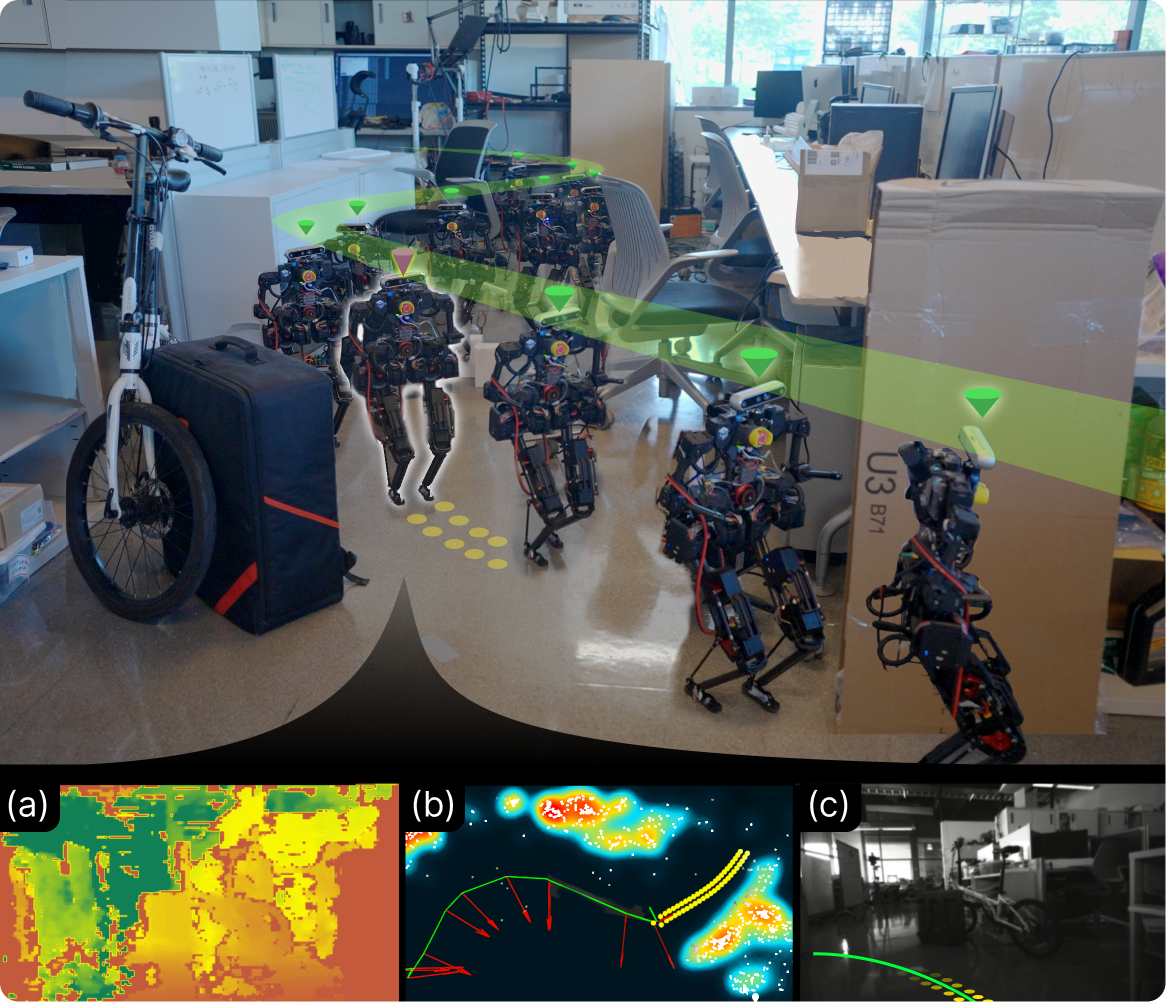

技术框架:iWalker系统包含视觉感知模块、步态规划模块和全身平衡控制模块。视觉感知模块负责从摄像头获取环境信息,例如障碍物的位置。步态规划模块基于模型预测控制(MPC)进行步态规划,生成一系列的脚部落点。全身平衡控制模块则根据步态规划的结果,控制机器人的关节运动,保持身体平衡。这两个模块通过双层优化进行协同训练。

关键创新:该论文的关键创新在于提出了一个端到端的可学习人形机器人行走系统,并采用命令式学习进行自监督训练。与传统的模块化方法相比,该方法能够更好地利用视觉信息,实现更灵活和鲁棒的行走。双层优化框架能够有效地协调步态规划和全身平衡,提高机器人的行走性能。

关键设计:论文采用了两种基于命令式学习(IL)的双层优化方法。第一层优化用于模型预测步态规划,目标是生成一系列的脚部落点,使得机器人能够避开障碍物并到达目标位置。第二层优化用于全身平衡,目标是控制机器人的关节运动,保持身体平衡。损失函数的设计考虑了步态的稳定性、平滑性和能量消耗。网络结构采用了卷积神经网络(CNN)提取视觉特征,以及循环神经网络(RNN)处理时间序列数据。

🖼️ 关键图片

📊 实验亮点

iWalker在模拟和真实环境中进行了实验验证。实验结果表明,iWalker能够有效地避开障碍物,并保持身体平衡,实现自主行走。与传统的基于规则的方法相比,iWalker在复杂环境中的行走性能得到了显著提升。具体而言,iWalker在避障成功率、行走速度和稳定性等方面均优于对比基线。

🎯 应用场景

该研究成果可应用于服务机器人、搜救机器人、医疗机器人等领域。人形机器人能够在复杂的人类环境中执行各种任务,例如搬运物品、照顾病人、进行危险环境的勘探等。通过提高人形机器人的自主行走能力,可以使其更好地适应各种实际应用场景,并为人类提供更便捷的服务。

📄 摘要(原文)

Humanoid robots, designed to operate in human-centric environments, serve as a fundamental platform for a broad range of tasks. Although humanoid robots have been extensively studied for decades, a majority of existing humanoid robots still heavily rely on complex modular frameworks, leading to inflexibility and potential compounded errors from independent sensing, planning, and acting components. In response, we propose an end-to-end humanoid sense-plan-act walking system, enabling vision-based obstacle avoidance and footstep planning for whole body balancing simultaneously. We designed two imperative learning (IL)-based bilevel optimizations for model-predictive step planning and whole body balancing, respectively, to achieve self-supervised learning for humanoid robot walking. This enables the robot to learn from arbitrary unlabeled data, improving its adaptability and generalization capabilities. We refer to our method as iWalker and demonstrate its effectiveness in both simulated and real-world environments, representing a significant advancement toward autonomous humanoid robots.