Language-Embedded Gaussian Splats (LEGS): Incrementally Building Room-Scale Representations with a Mobile Robot

作者: Justin Yu, Kush Hari, Kishore Srinivas, Karim El-Refai, Adam Rashid, Chung Min Kim, Justin Kerr, Richard Cheng, Muhammad Zubair Irshad, Ashwin Balakrishna, Thomas Kollar, Ken Goldberg

分类: cs.RO

发布日期: 2024-09-26

💡 一句话要点

提出LEGS:一种可增量构建的、语言嵌入的高斯溅射方法,用于移动机器人构建房间尺度语义地图。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 语义地图 高斯溅射 语言嵌入 增量式建图 机器人导航

📋 核心要点

- 现有方法难以在机器人移动过程中高效构建包含语义信息的3D地图,限制了其在复杂环境中的应用。

- LEGS通过增量式构建语言嵌入的高斯溅射,将外观和语义信息统一编码到3D场景表示中,实现高效的在线训练。

- 实验表明,LEGS在对象查询任务中与LERF性能相当,但训练速度提升3.5倍,且能有效定位开放词汇对象。

📝 摘要(中文)

本文提出了一种用于增量构建语义3D地图的系统,名为语言嵌入高斯溅射(LEGS)。LEGS是一种详细的3D场景表示,它在统一的表示中编码了外观和语义信息。LEGS在机器人遍历环境时进行在线训练,从而能够定位开放词汇的对象查询。我们在4个房间尺度的场景中评估LEGS,通过查询场景中的对象来评估LEGS捕获语义信息的能力。我们将LEGS与LERF进行比较,发现虽然两个系统具有相当的对象查询成功率,但LEGS的训练速度比LERF快3.5倍以上。结果表明,多摄像头设置和增量式光束法平差可以提高受约束机器人轨迹中的视觉重建质量,并表明LEGS可以定位开放词汇和长尾对象查询,准确率高达66%。

🔬 方法详解

问题定义:论文旨在解决移动机器人在未知环境中构建语义3D地图的问题。现有方法,如LERF,虽然可以实现语义信息的嵌入,但训练速度慢,难以满足机器人实时建图的需求。因此,需要一种能够快速、增量式地构建包含语义信息的3D地图的方法。

核心思路:论文的核心思路是将高斯溅射(Gaussian Splatting)与语言嵌入(Language Embedding)相结合,构建一种新的场景表示方法LEGS。高斯溅射能够高效地表示3D场景,而语言嵌入则可以将语义信息融入到场景表示中。通过增量式地更新高斯溅射的参数和语言嵌入,LEGS可以在机器人移动过程中实时构建语义3D地图。

技术框架:LEGS系统的整体框架包括以下几个主要模块:1) 数据采集模块:使用多摄像头系统采集场景图像和机器人位姿信息。2) 增量式高斯溅射构建模块:基于采集到的图像和位姿信息,增量式地构建高斯溅射模型。3) 语言嵌入模块:使用预训练的语言模型(如CLIP)提取图像的语义特征,并将这些特征嵌入到高斯溅射的参数中。4) 对象查询模块:根据用户输入的文本查询,在LEGS模型中定位目标对象。

关键创新:LEGS的关键创新在于将高斯溅射和语言嵌入相结合,并实现了增量式的构建和更新。与传统的基于体素或点云的语义地图相比,LEGS具有更高的渲染质量和更快的训练速度。此外,LEGS还采用了多摄像头系统和增量式光束法平差,进一步提高了视觉重建的质量。

关键设计:LEGS的关键设计包括:1) 使用3D高斯分布来表示场景中的每个点,每个高斯分布的参数包括位置、协方差、颜色和不透明度。2) 使用CLIP模型提取图像的语义特征,并将这些特征映射到高斯分布的颜色参数中。3) 使用增量式光束法平差来优化高斯分布的参数和机器人位姿。4) 使用基于梯度的优化算法来训练LEGS模型,损失函数包括渲染损失和语义损失。

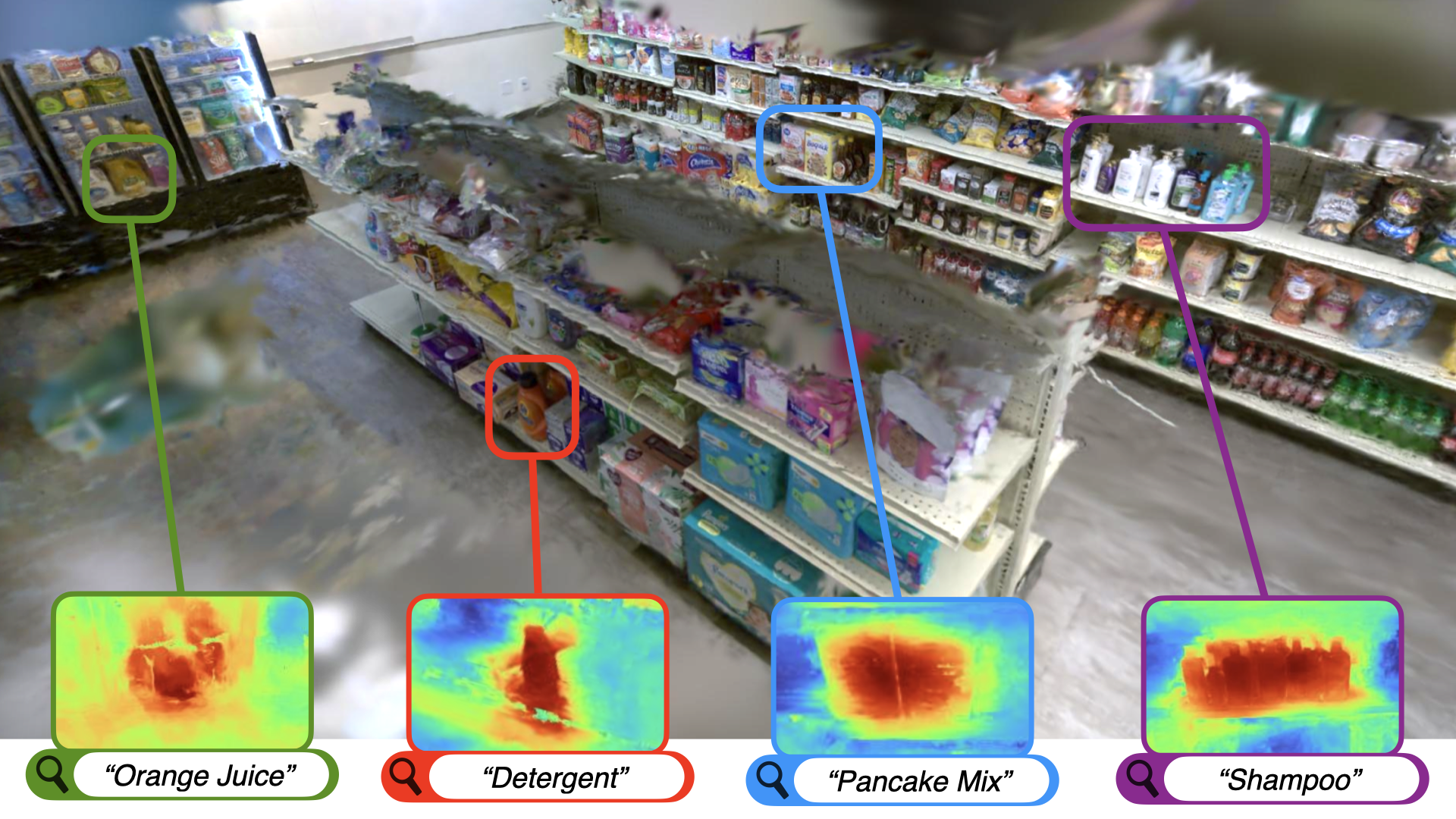

🖼️ 关键图片

📊 实验亮点

LEGS在四个房间尺度的场景中进行了评估,结果表明,LEGS在对象查询任务中取得了与LERF相当的性能,对象查询准确率高达66%。更重要的是,LEGS的训练速度比LERF快3.5倍以上,这使得LEGS更适合于机器人实时建图的应用场景。此外,实验还表明,多摄像头设置和增量式光束法平差可以显著提高视觉重建的质量。

🎯 应用场景

LEGS技术可应用于室内服务机器人、智能家居、仓储物流等领域。例如,服务机器人可以利用LEGS构建的语义地图进行导航、物体识别和人机交互。在智能家居中,LEGS可以用于场景理解和智能控制。在仓储物流中,LEGS可以用于货物盘点和路径规划。该技术有望提升机器人在复杂环境中的自主性和智能化水平。

📄 摘要(原文)

Building semantic 3D maps is valuable for searching for objects of interest in offices, warehouses, stores, and homes. We present a mapping system that incrementally builds a Language-Embedded Gaussian Splat (LEGS): a detailed 3D scene representation that encodes both appearance and semantics in a unified representation. LEGS is trained online as a robot traverses its environment to enable localization of open-vocabulary object queries. We evaluate LEGS on 4 room-scale scenes where we query for objects in the scene to assess how LEGS can capture semantic meaning. We compare LEGS to LERF and find that while both systems have comparable object query success rates, LEGS trains over 3.5x faster than LERF. Results suggest that a multi-camera setup and incremental bundle adjustment can boost visual reconstruction quality in constrained robot trajectories, and suggest LEGS can localize open-vocabulary and long-tail object queries with up to 66% accuracy.