Canonical Representation and Force-Based Pretraining of 3D Tactile for Dexterous Visuo-Tactile Policy Learning

作者: Tianhao Wu, Jinzhou Li, Jiyao Zhang, Mingdong Wu, Hao Dong

分类: cs.RO

发布日期: 2024-09-26 (更新: 2025-06-16)

备注: Accepted to ICRA 2025

💡 一句话要点

提出基于力感知的3D触觉表征与预训练方法,提升灵巧操作策略学习效果

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 3D触觉感知 灵巧操作 机器人学习 自监督学习 力感知 规范化表示 预训练

📋 核心要点

- 现有方法难以有效学习高维3D触觉数据特征,缺乏大型数据集和预训练模型是主要瓶颈。

- 论文提出规范化触觉表示,并设计基于力的自监督预训练任务,提取局部和全局力特征。

- 实验表明,该方法在真实场景的灵巧操作任务中表现出色,成功率达到78%,验证了有效性。

📝 摘要(中文)

触觉感知在机器人执行精细、富接触任务中至关重要。然而,灵巧手覆盖范围广,导致触觉数据维度高,给有效的触觉特征学习带来巨大挑战,特别是对于3D触觉数据,因为缺乏大型标准化数据集和强大的预训练骨干网络。为了解决这些挑战,我们提出了一种新颖的规范化表示,降低了3D触觉特征学习的难度,并进一步引入了基于力的自监督预训练任务,以捕获局部和净力特征,这对于灵巧操作至关重要。在真实世界的实验中,我们的方法在四个精细、富接触的灵巧操作任务中实现了平均78%的成功率,与其他方法相比,展示了有效性和鲁棒性。进一步的分析表明,我们的方法充分利用了3D触觉数据的空间和力信息来完成任务。

🔬 方法详解

问题定义:现有方法在处理高维3D触觉数据时,面临特征学习困难的问题。由于灵巧手触觉传感器覆盖范围广,数据维度高,直接学习策略效率低下。此外,缺乏大规模的3D触觉数据集和有效的预训练模型,进一步限制了触觉感知在灵巧操作中的应用。现有方法难以充分利用触觉数据的空间和力信息,导致操作性能不佳。

核心思路:论文的核心思路是通过规范化触觉表示降低数据维度,简化特征学习过程。同时,设计基于力的自监督预训练任务,使模型能够学习到触觉数据中重要的局部和全局力特征。通过预训练,模型能够更好地理解触觉数据,从而提升灵巧操作策略的学习效率和性能。

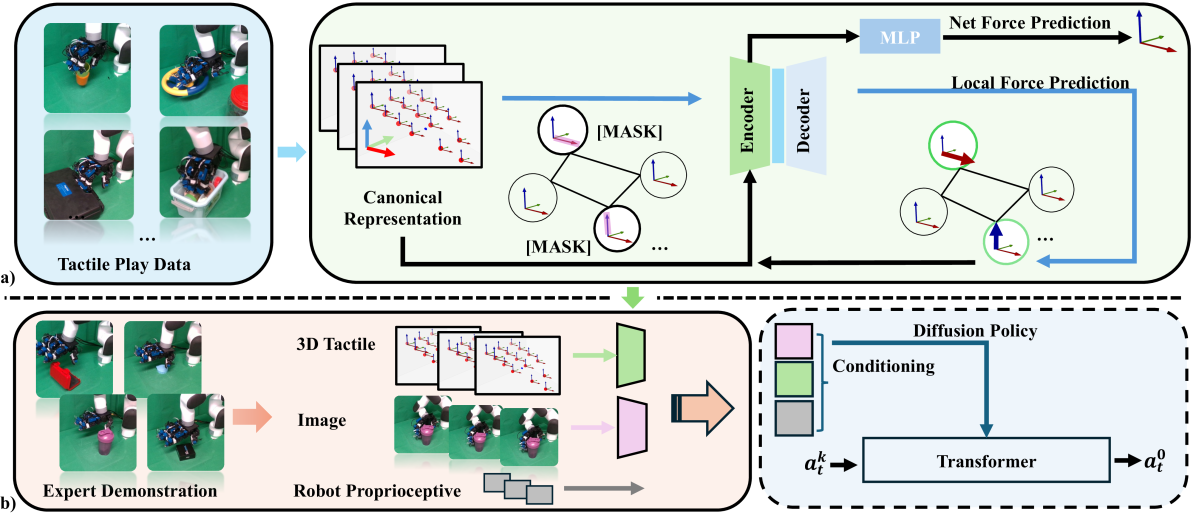

技术框架:该方法主要包含两个阶段:规范化表示和基于力的自监督预训练。首先,将原始3D触觉数据转换为规范化表示,降低数据维度。然后,利用自监督学习方法,基于规范化表示进行预训练,学习触觉特征。最后,将预训练好的模型应用于灵巧操作策略学习中。整体流程为:3D触觉数据 -> 规范化表示 -> 基于力的自监督预训练 -> 灵巧操作策略学习。

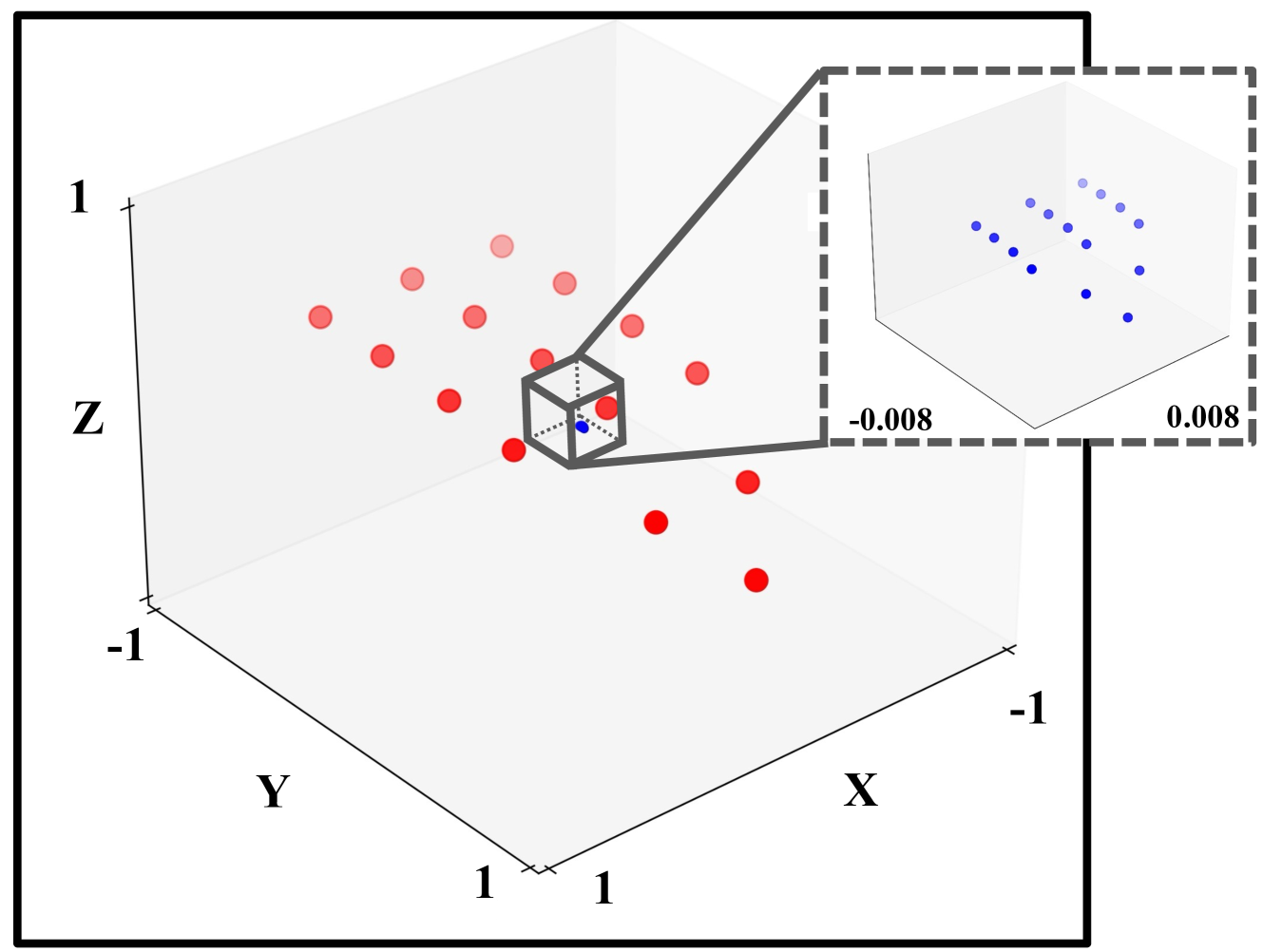

关键创新:该方法最重要的创新点在于提出了规范化触觉表示和基于力的自监督预训练任务。规范化表示能够有效降低数据维度,简化特征学习过程。基于力的自监督预训练任务能够使模型学习到触觉数据中重要的力信息,从而提升灵巧操作性能。与现有方法相比,该方法能够更好地利用触觉数据的空间和力信息。

关键设计:规范化表示的具体实现方式未知,但其目标是降低数据维度。基于力的自监督预训练任务的具体损失函数和网络结构也未知,但其核心思想是利用力信息进行自监督学习。论文中可能使用了对比学习或生成对抗网络等技术来实现自监督预训练。具体的参数设置和网络结构需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

该方法在四个真实世界的灵巧操作任务中取得了显著的成果,平均成功率达到78%。相较于其他方法,该方法在性能和鲁棒性方面均有提升。实验结果表明,该方法能够有效利用3D触觉数据的空间和力信息,从而提升灵巧操作的性能。具体的提升幅度和其他基线方法的性能数据未知,需要在论文中进一步查找。

🎯 应用场景

该研究成果可应用于各种需要精细操作的机器人任务中,例如医疗手术机器人、精密装配机器人、家庭服务机器人等。通过提升机器人对触觉信息的感知能力,可以使其更好地完成复杂的操作任务,提高工作效率和安全性。未来,该技术有望在工业自动化、医疗健康、智能家居等领域发挥重要作用。

📄 摘要(原文)

Tactile sensing plays a vital role in enabling robots to perform fine-grained, contact-rich tasks. However, the high dimensionality of tactile data, due to the large coverage on dexterous hands, poses significant challenges for effective tactile feature learning, especially for 3D tactile data, as there are no large standardized datasets and no strong pretrained backbones. To address these challenges, we propose a novel canonical representation that reduces the difficulty of 3D tactile feature learning and further introduces a force-based self-supervised pretraining task to capture both local and net force features, which are crucial for dexterous manipulation. Our method achieves an average success rate of 78% across four fine-grained, contact-rich dexterous manipulation tasks in real-world experiments, demonstrating effectiveness and robustness compared to other methods. Further analysis shows that our method fully utilizes both spatial and force information from 3D tactile data to accomplish the tasks. The codes and videos can be viewed at https://3dtacdex.github.io.