Blox-Net: Generative Design-for-Robot-Assembly Using VLM Supervision, Physics Simulation, and a Robot with Reset

作者: Andrew Goldberg, Kavish Kondap, Tianshuang Qiu, Zehan Ma, Letian Fu, Justin Kerr, Huang Huang, Kaiyuan Chen, Kuan Fang, Ken Goldberg

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-09-25

备注: 8 pages, 7 Figures

💡 一句话要点

Blox-Net:利用VLM监督、物理仿真和重置机器人实现生成式机器人装配设计

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 生成式设计 机器人装配 视觉语言模型 物理仿真 自动化设计

📋 核心要点

- 现有方法在机器人装配设计中缺乏自动化和通用性,难以根据自然语言指令生成可装配的设计。

- Blox-Net结合视觉语言模型、物理仿真和机器人控制,实现从文本描述到物理装配的自动生成。

- 实验表明,Blox-Net在装配体识别准确率和机器人装配成功率方面均表现出色,无需人工干预。

📝 摘要(中文)

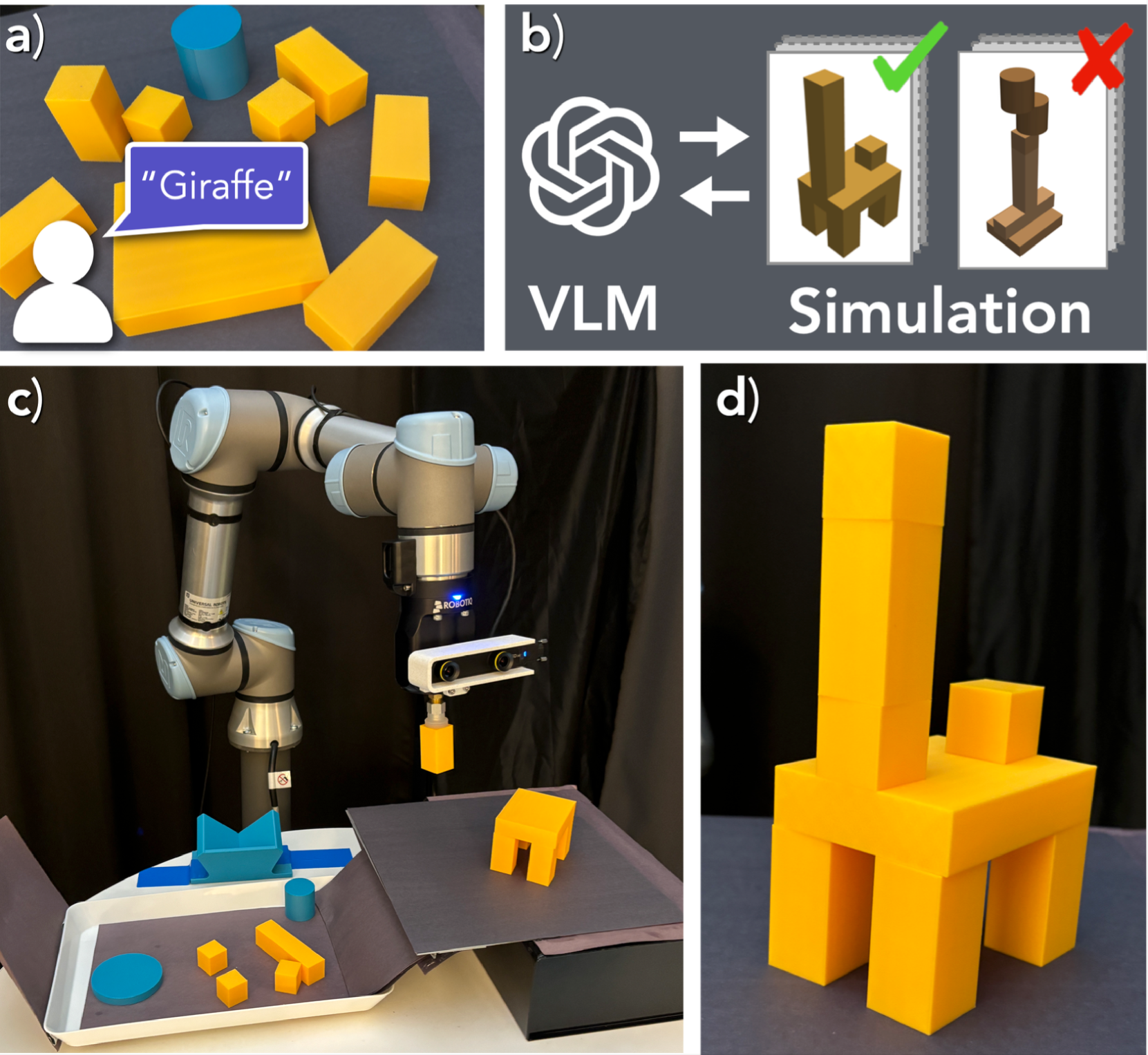

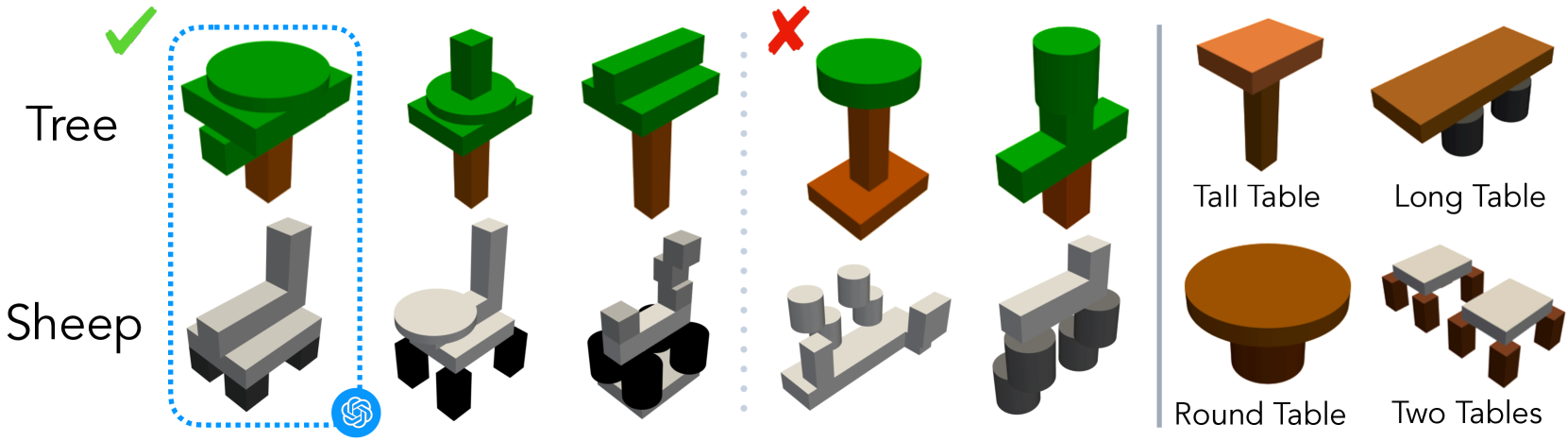

生成式AI系统在创建文本、代码和图像方面表现出令人印象深刻的能力。受工业“面向装配的设计”研究的启发,我们引入了一个新的问题:生成式机器人装配设计(GDfRA)。该任务是基于自然语言提示(例如“长颈鹿”)和可用物理组件(例如3D打印块)的图像来生成一个装配体。输出是一个装配体,即这些组件的空间排列,以及机器人构建该装配体的指令。输出必须1)类似于所请求的对象,并且2)可以由具有吸盘夹具的6自由度机器人手臂可靠地组装。然后,我们提出了Blox-Net,一个GDfRA系统,它结合了生成式视觉语言模型与计算机视觉、仿真、扰动分析、运动规划和物理机器人实验中的成熟方法,以最小的人工监督来解决一类GDfRA问题。Blox-Net在其设计的装配体的“可识别性”(例如,被VLM判断为类似于长颈鹿)方面实现了63.5%的Top-1准确率。这些设计在经过自动扰动重新设计后,可以由机器人可靠地组装,在连续10次装配迭代中实现了接近完美的成功率,仅在装配前进行人工重置。令人惊讶的是,从文本词语(“长颈鹿”)到可靠的物理装配的整个设计过程都是在零人工干预的情况下执行的。

🔬 方法详解

问题定义:论文旨在解决生成式机器人装配设计(GDfRA)问题,即根据自然语言描述和给定的物理组件,自动生成可由机器人可靠装配的结构。现有方法通常需要大量人工干预,且难以保证生成设计的可装配性和识别度。

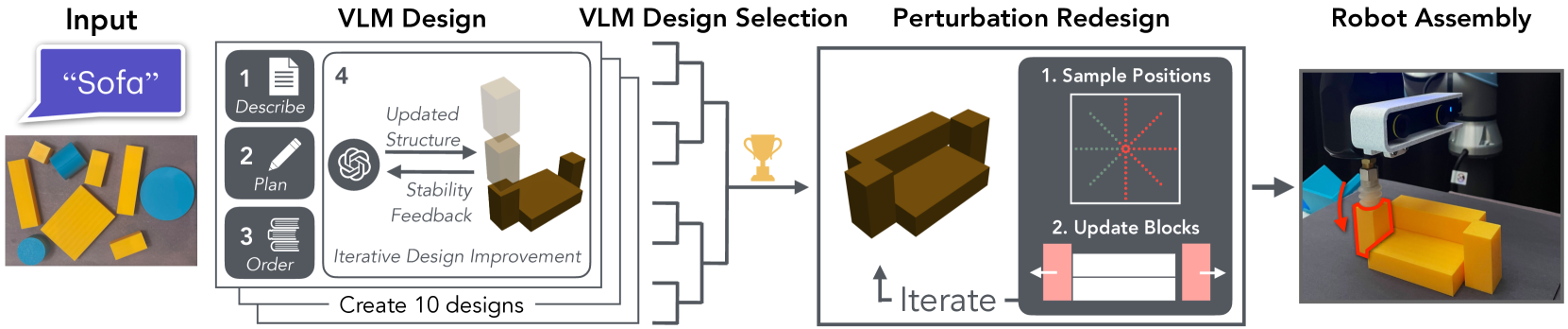

核心思路:论文的核心思路是结合视觉语言模型(VLM)的生成能力、物理仿真的验证能力和机器人的实际装配能力,构建一个端到端的自动化设计流程。通过VLM生成初始设计,利用物理仿真评估其稳定性,并通过机器人装配进行验证和迭代优化。

技术框架:Blox-Net的整体框架包含以下几个主要模块:1) 基于VLM的设计生成器:根据文本提示和组件图像生成初始装配设计。2) 物理仿真器:评估设计的物理稳定性和可装配性。3) 扰动分析与重新设计模块:对不稳定或难以装配的设计进行扰动和重新设计。4) 机器人装配模块:利用机器人手臂进行实际装配,并根据装配结果进行反馈和优化。

关键创新:Blox-Net的关键创新在于将生成式AI与物理仿真和机器人控制相结合,实现了一个完全自动化的GDfRA流程。与传统方法相比,Blox-Net无需人工干预,能够根据自然语言描述生成可识别且可装配的设计。

关键设计:在VLM设计生成器中,使用了预训练的视觉语言模型,并针对GDfRA任务进行了微调。物理仿真器使用PyBullet等成熟的物理引擎。扰动分析与重新设计模块采用基于梯度的优化算法,以提高设计的稳定性和可装配性。机器人装配模块使用6自由度机器人手臂和吸盘夹具,并采用运动规划算法生成装配轨迹。

🖼️ 关键图片

📊 实验亮点

Blox-Net在“长颈鹿”等复杂结构的装配设计中,实现了63.5%的Top-1识别准确率。经过自动扰动重新设计后,机器人能够连续10次成功装配这些设计,且无需人工干预,展示了其在自动化装配方面的强大能力。

🎯 应用场景

该研究成果可应用于自动化装配线设计、定制化产品设计、以及机器人辅助的建筑和制造等领域。通过自然语言描述即可生成可由机器人自动装配的结构,降低了设计门槛,提高了生产效率,并为个性化定制提供了新的可能性。

📄 摘要(原文)

Generative AI systems have shown impressive capabilities in creating text, code, and images. Inspired by the rich history of research in industrial ''Design for Assembly'', we introduce a novel problem: Generative Design-for-Robot-Assembly (GDfRA). The task is to generate an assembly based on a natural language prompt (e.g., ''giraffe'') and an image of available physical components, such as 3D-printed blocks. The output is an assembly, a spatial arrangement of these components, and instructions for a robot to build this assembly. The output must 1) resemble the requested object and 2) be reliably assembled by a 6 DoF robot arm with a suction gripper. We then present Blox-Net, a GDfRA system that combines generative vision language models with well-established methods in computer vision, simulation, perturbation analysis, motion planning, and physical robot experimentation to solve a class of GDfRA problems with minimal human supervision. Blox-Net achieved a Top-1 accuracy of 63.5% in the ''recognizability'' of its designed assemblies (eg, resembling giraffe as judged by a VLM). These designs, after automated perturbation redesign, were reliably assembled by a robot, achieving near-perfect success across 10 consecutive assembly iterations with human intervention only during reset prior to assembly. Surprisingly, this entire design process from textual word (''giraffe'') to reliable physical assembly is performed with zero human intervention.