Dashing for the Golden Snitch: Multi-Drone Time-Optimal Motion Planning with Multi-Agent Reinforcement Learning

作者: Xian Wang, Jin Zhou, Yuanli Feng, Jiahao Mei, Jiming Chen, Shuo Li

分类: cs.RO, cs.LG

发布日期: 2024-09-25 (更新: 2025-03-05)

备注: v2: 7 pages, 6 figures; terminology corrected, algorithmic and equation descriptions revised, references added

💡 一句话要点

提出基于多智能体强化学习的多无人机时间最优运动规划方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多无人机系统 时间最优运动规划 多智能体强化学习 分散式控制 集中训练分散执行

📋 核心要点

- 现有方法在多无人机系统中难以实现时间最优运动规划,尤其是在高机动或动态场景下。

- 论文提出一种基于多智能体强化学习的分散式策略网络,并引入软避碰机制,平衡效率与安全。

- 仿真和真实实验表明,该方法在多无人机系统中实现了接近时间最优的性能,并具有较低的碰撞率。

📝 摘要(中文)

本文提出了一种基于多智能体强化学习的分散式策略网络,用于多无人机时间最优飞行。为了平衡飞行效率和避碰,引入了一种受优化方法启发的软避碰机制。通过以集中训练、分散执行(CTDE)的方式定制PPO算法,提高了训练效率和稳定性,同时确保了轻量级的实现。大量的仿真结果表明,与单无人机系统相比,该多无人机方法在略微牺牲性能的同时,保持了接近时间最优的性能和较低的碰撞率。真实世界的实验验证了该方法,两个四旋翼无人机使用与仿真中相同的网络,在5.5米 * 5.5米 * 2.0米的空间内,在各种轨迹上实现了13.65米/秒的最大速度和13.4弧度/秒的最大本体速率,并且完全依赖于机载计算。

🔬 方法详解

问题定义:论文旨在解决多无人机系统中的时间最优运动规划问题,尤其是在需要高机动性和动态避障的复杂环境中。现有方法要么难以处理多无人机间的复杂交互,要么无法保证时间最优性,或者计算复杂度过高难以实时部署。

核心思路:论文的核心思路是利用多智能体强化学习(MARL)来学习一个分散式的控制策略,使得每个无人机能够根据局部观测做出决策,从而实现整体的时间最优飞行。通过集中训练、分散执行(CTDE)的框架,可以在训练阶段利用全局信息来指导策略学习,而在执行阶段则只需要局部信息,从而保证了算法的实时性和可扩展性。软避碰机制的引入则是在保证安全性的前提下,尽可能地提高飞行效率。

技术框架:整体框架采用集中训练、分散执行(CTDE)的模式。在训练阶段,所有无人机的策略都在一个中心化的环境中进行训练,可以访问全局状态信息。在执行阶段,每个无人机只根据自己的局部观测来做出决策。框架主要包含以下模块:环境模型、策略网络、奖励函数和训练算法。环境模型负责模拟无人机的运动和交互。策略网络负责将无人机的局部观测映射到控制指令。奖励函数负责引导策略学习,包括时间最优性、避碰和控制平滑性等因素。训练算法采用定制的PPO算法,以提高训练效率和稳定性。

关键创新:论文的关键创新在于将多智能体强化学习应用于多无人机时间最优运动规划,并提出了一种软避碰机制。与传统的优化方法相比,该方法能够更好地处理复杂环境和无人机间的交互,并且具有更强的适应性和鲁棒性。与传统的强化学习方法相比,该方法通过集中训练、分散执行的框架,提高了训练效率和稳定性,并且保证了算法的实时性和可扩展性。

关键设计:论文的关键设计包括:1) 软避碰机制:通过引入一个与无人机间距离相关的惩罚项到奖励函数中,鼓励无人机保持一定的安全距离,但又不强制避免所有碰撞,从而在保证安全性的前提下,尽可能地提高飞行效率。2) 定制的PPO算法:通过调整PPO算法的参数,例如clip ratio和entropy coefficient,来提高训练效率和稳定性。3) 策略网络结构:采用多层感知机(MLP)作为策略网络,输入为无人机的局部观测,输出为无人机的控制指令。

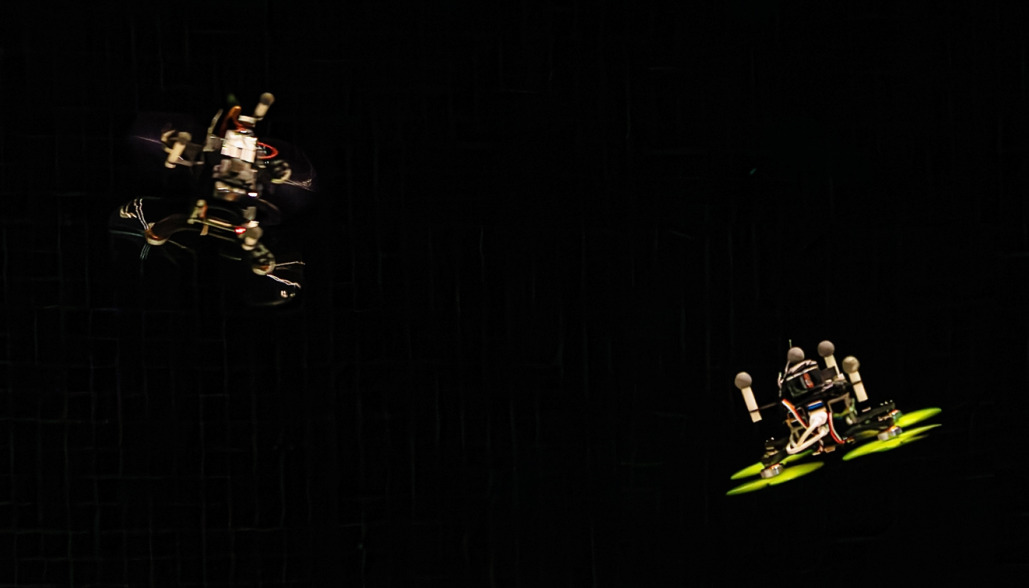

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多无人机系统中实现了接近时间最优的性能,并且具有较低的碰撞率。在真实世界的实验中,两个四旋翼无人机在5.5米 * 5.5米 * 2.0米的空间内,在各种轨迹上实现了13.65米/秒的最大速度和13.4弧度/秒的最大本体速率,并且完全依赖于机载计算。与单无人机系统相比,该多无人机方法在略微牺牲性能的同时,显著提高了系统的整体效率。

🎯 应用场景

该研究成果可应用于无人机编队飞行、物流配送、搜索救援、环境监测等领域。通过实现多无人机系统的时间最优运动规划,可以显著提高任务效率,降低能源消耗,并扩展无人机的应用范围。未来,该方法有望应用于更复杂的环境和更大规模的无人机系统。

📄 摘要(原文)

Recent innovations in autonomous drones have facilitated time-optimal flight in single-drone configurations, and enhanced maneuverability in multi-drone systems by applying optimal control and learning-based methods. However, few studies have achieved time-optimal motion planning for multi-drone systems, particularly during highly agile maneuvers or in dynamic scenarios. This paper presents a decentralized policy network using multi-agent reinforcement learning for time-optimal multi-drone flight. To strike a balance between flight efficiency and collision avoidance, we introduce a soft collision-free mechanism inspired by optimization-based methods. By customizing PPO in a centralized training, decentralized execution (CTDE) fashion, we unlock higher efficiency and stability in training while ensuring lightweight implementation. Extensive simulations show that, despite slight performance trade-offs compared to single-drone systems, our multi-drone approach maintains near-time-optimal performance with a low collision rate. Real-world experiments validate our method, with two quadrotors using the same network as in simulation achieving a maximum speed of 13.65 m/s and a maximum body rate of 13.4 rad/s in a 5.5 m * 5.5 m * 2.0 m space across various tracks, relying entirely on onboard computation.