Context-Based Meta Reinforcement Learning for Robust and Adaptable Peg-in-Hole Assembly Tasks

作者: Ahmed Shokry, Walid Gomaa, Tobias Zaenker, Murad Dawood, Rohit Menon, Shady A. Maged, Mohammed I. Awad, Maren Bennewitz

分类: cs.RO

发布日期: 2024-09-24 (更新: 2025-10-18)

💡 一句话要点

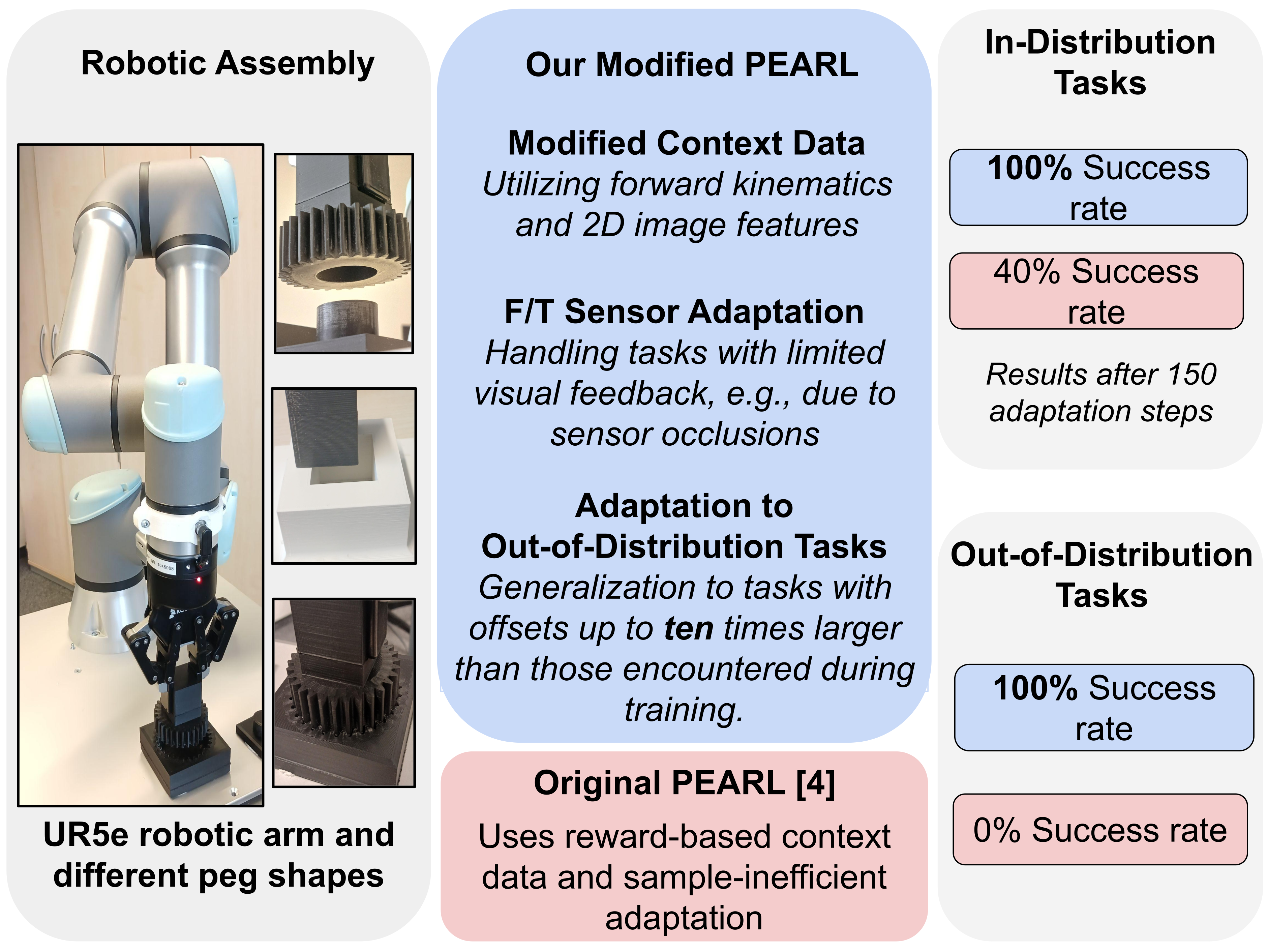

提出基于上下文的元强化学习方法,提升机械臂在孔装配任务中的鲁棒性和适应性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 元强化学习 机器人 孔装配 上下文学习 自主装配 力/扭矩传感器 机器人视觉

📋 核心要点

- 现有孔装配元强化学习方法样本效率低,或依赖人工演示,限制了其在实际场景中的应用。

- 利用机器人正向运动学、未校准相机和力/扭矩传感器信息,训练智能体以适应未知任务参数,提高样本效率。

- 实验表明,该方法在模拟和真实机器人上均能提升元训练样本效率、适应性能和泛化能力。

📝 摘要(中文)

自主装配是工业和服务机器人的关键能力,其中孔装配(PiH)是最核心的任务之一。然而,由于传感器噪声导致孔的位置和方向等任务参数存在不确定性,在未知环境中进行PiH装配仍然具有挑战性。虽然之前已经提出了基于上下文的元强化学习(RL)方法来适应PiH装配任务中未知的任务参数,但其性能依赖于样本效率低的程序或人工演示。因此,为了提高元RL在实际PiH装配任务中的适用性,我们建议训练智能体使用来自机器人正向运动学和未校准相机的信息。此外,我们通过有效地调整元训练的智能体来使用来自力/扭矩传感器的数据,从而提高性能。最后,我们提出了一种针对参数与训练任务不同的分布外任务的适应程序。在模拟和真实机器人上的实验证明,与以前的方法相比,我们的修改提高了元训练期间的样本效率、真实世界适应性能以及基于上下文的元RL智能体在PiH装配任务中的泛化能力。

🔬 方法详解

问题定义:论文旨在解决在未知环境中,由于传感器噪声导致任务参数不确定性,机械臂进行孔装配(Peg-in-Hole, PiH)任务时面临的鲁棒性和适应性问题。现有基于上下文的元强化学习方法存在样本效率低,或依赖人工演示的问题,难以直接应用于实际场景。

核心思路:论文的核心思路是利用机器人自身的状态信息(正向运动学)、视觉信息(未校准相机)以及力/扭矩信息作为上下文,训练一个能够快速适应不同PiH任务参数的元强化学习智能体。通过这种方式,智能体可以学习到一种通用的装配策略,并能够根据当前环境的上下文信息进行调整,从而提高装配的成功率和效率。

技术框架:整体框架包含以下几个主要阶段:1) 元训练阶段:使用模拟环境生成大量不同参数的PiH任务,利用上下文信息(机器人正向运动学、未校准相机数据)训练元强化学习智能体。2) 适应阶段:在真实环境中,利用少量样本数据,结合力/扭矩传感器信息,对元训练好的智能体进行微调,使其适应真实环境的特性。3) 推理阶段:利用适应后的智能体,根据当前环境的上下文信息,执行PiH装配任务。

关键创新:论文的关键创新在于:1) 上下文信息的选择:选择机器人正向运动学、未校准相机和力/扭矩传感器信息作为上下文,这些信息易于获取,且能够有效地描述当前环境的状态。2) 适应策略:提出了一种针对分布外任务的适应程序,使得智能体能够处理训练集中未见过的任务参数。3) 高效的适应方法:通过少量样本数据,即可快速适应真实环境,提高了样本效率。

关键设计:论文中,元强化学习算法采用Model-Agnostic Meta-Learning (MAML) 或其变体。损失函数的设计旨在鼓励智能体学习一种通用的装配策略,并能够根据上下文信息进行调整。网络结构通常采用多层感知机(MLP)或循环神经网络(RNN),用于处理上下文信息和状态信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟和真实机器人上均取得了显著的性能提升。与之前的基于上下文的元强化学习方法相比,该方法在元训练期间的样本效率更高,真实世界适应性能更好,并且在PiH装配任务中具有更强的泛化能力。具体而言,在真实机器人实验中,该方法能够显著提高PiH装配的成功率和效率。

🎯 应用场景

该研究成果可广泛应用于工业自动化、服务机器人等领域,例如:在生产线上实现自主装配,提高生产效率和灵活性;在医疗领域,辅助医生进行微创手术;在航空航天领域,进行复杂部件的装配。该研究有助于推动机器人自主操作技术的发展,实现更智能、更高效的自动化生产。

📄 摘要(原文)

Autonomous assembly is an essential capability for industrial and service robots, with Peg-in-Hole (PiH) insertion being one of the core tasks. However, PiH assembly in unknown environments is still challenging due to uncertainty in task parameters, such as the hole position and orientation, resulting from sensor noise. Although context-based meta reinforcement learning (RL) methods have been previously presented to adapt to unknown task parameters in PiH assembly tasks, the performance depends on a sample-inefficient procedure or human demonstrations. Thus, to enhance the applicability of meta RL in real-world PiH assembly tasks, we propose to train the agent to use information from the robot's forward kinematics and an uncalibrated camera. Furthermore, we improve the performance by efficiently adapting the meta-trained agent to use data from force/torque sensor. Finally, we propose an adaptation procedure for out-of-distribution tasks whose parameters are different from the training tasks. Experiments on simulated and real robots prove that our modifications enhance the sample efficiency during meta training, real-world adaptation performance, and generalization of the context-based meta RL agent in PiH assembly tasks compared to previous approaches.