Walking with Terrain Reconstruction: Learning to Traverse Risky Sparse Footholds

作者: Ruiqi Yu, Qianshi Wang, Yizhen Wang, Zhicheng Wang, Jun Wu, Qiuguo Zhu

分类: cs.RO

发布日期: 2024-09-24 (更新: 2025-03-03)

💡 一句话要点

提出基于局部地形重建的强化学习方法,解决四足机器人稀疏地形上的稳健行走问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 四足机器人 强化学习 地形重建 深度图像 运动控制

📋 核心要点

- 四足机器人穿越稀疏地形的挑战在于需要在安全区域精确落脚,现有方法依赖外部设备或易引入噪声。

- 论文提出局部地形重建,将深度图像转换为高度图,为强化学习策略提供清晰的地形特征和充分的信息。

- 实验表明,该方法在低成本四足机器人上实现了在复杂地形上的敏捷运动,并在真实场景中表现出色。

📝 摘要(中文)

本文提出了一种基于强化学习的端到端方法,仅利用本体感受和深度图像,使四足机器人能够在稀疏且随机的危险地形上行走。该方法引入了局部地形重建,利用高度图的清晰特征和充分信息,作为视觉特征提取和运动生成的中间表示。这使得策略能够有效地表示和记忆关键的地形信息。我们在低成本的四足机器人上部署了该框架,在各种具有挑战性的地形上实现了敏捷和自适应的运动,并在实际场景中展示了出色的性能。

🔬 方法详解

问题定义:四足机器人需要在稀疏且危险的地形上安全行走,现有方法依赖于运动捕捉系统或地图构建技术,这些方法成本高昂,且容易引入额外的噪声。虽然深度图像成本较低,但其有限的视野和稀疏的信息难以将地形结构细节整合到隐式特征中,从而影响精确动作的生成。

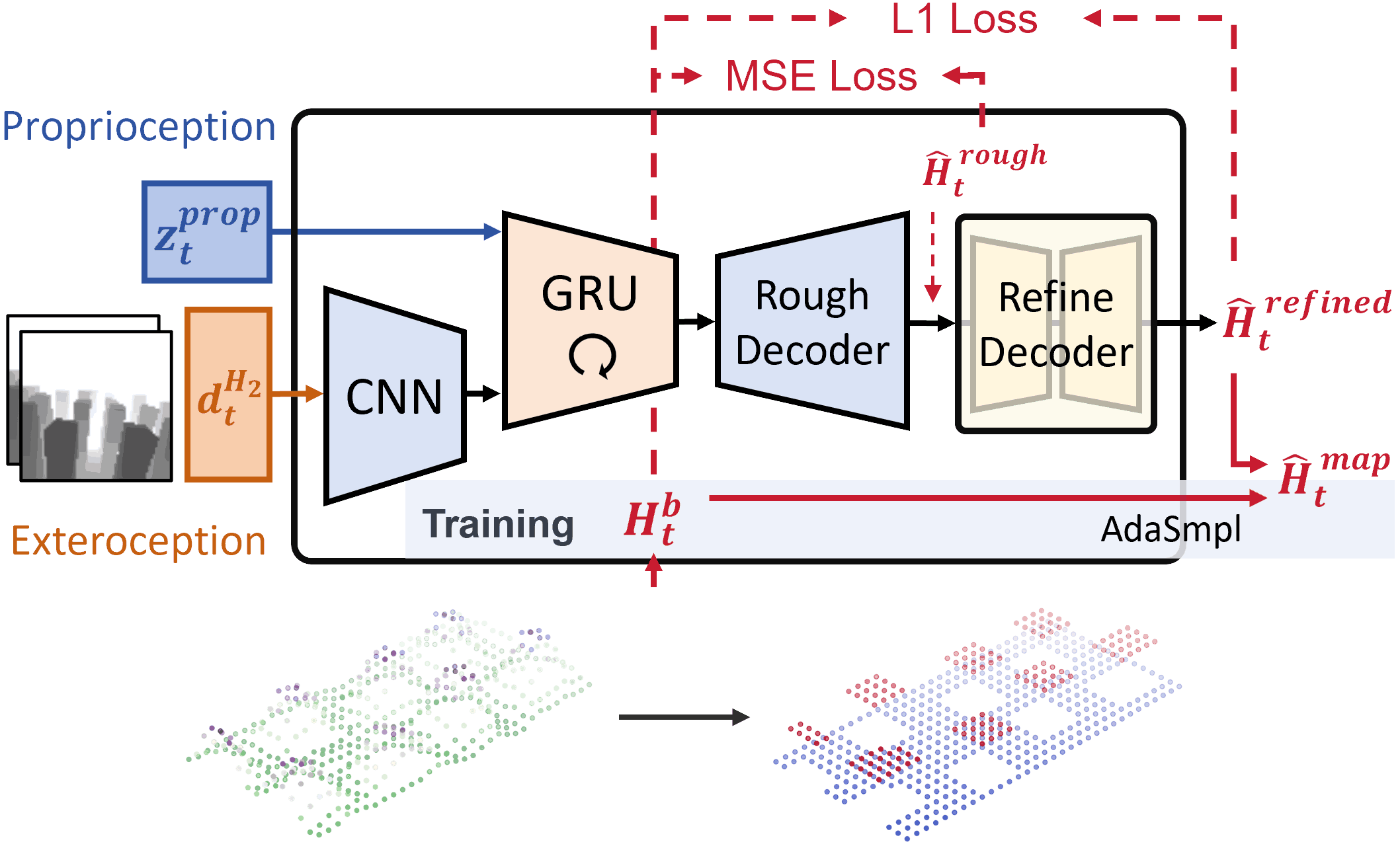

核心思路:论文的核心思路是利用局部地形重建作为深度图像和运动策略之间的桥梁。通过将深度图像转换为局部高度图,可以提取更清晰、更易于理解的地形特征,从而帮助机器人更好地感知周围环境,并做出更精确的运动决策。这种方法旨在克服深度图像的局限性,并避免使用昂贵或易出错的外部传感器。

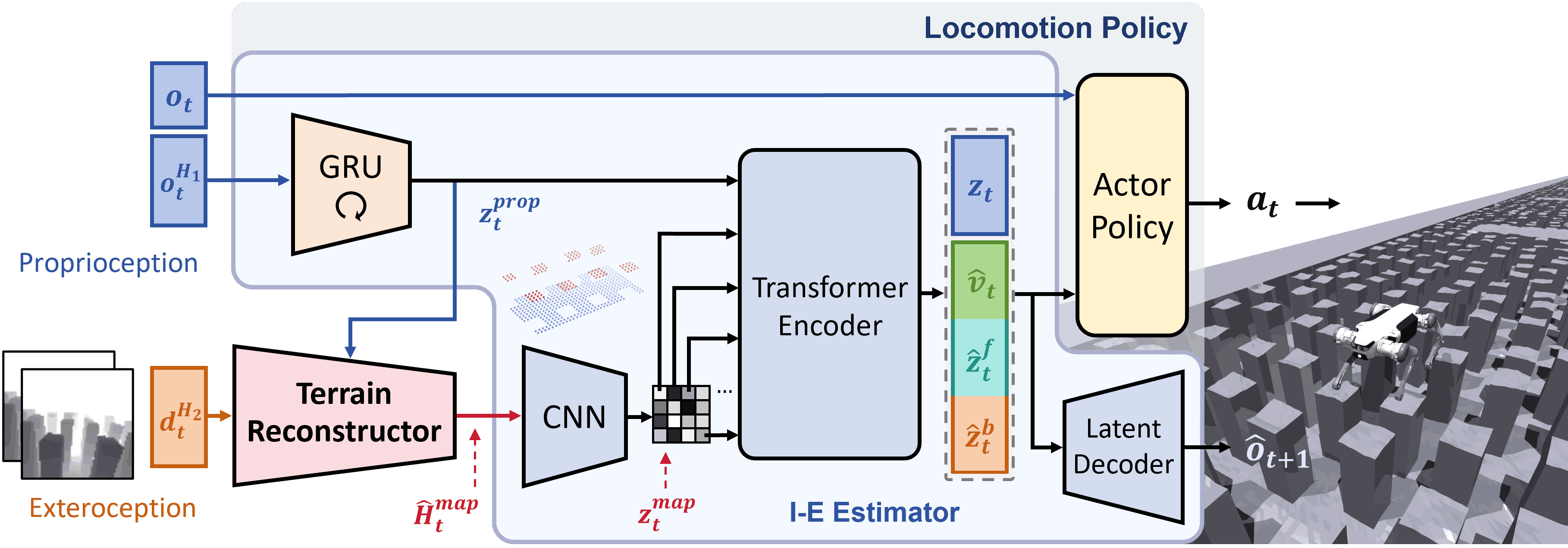

技术框架:该框架主要包含三个模块:深度图像输入、局部地形重建和强化学习策略。首先,机器人通过自身的深度相机获取环境的深度图像。然后,利用深度图像重建局部地形的高度图。最后,将高度图和本体感受信息输入到强化学习策略中,生成控制机器人运动的动作指令。整个过程是端到端可训练的。

关键创新:该方法最重要的创新点在于引入了局部地形重建作为中间表示。与直接使用深度图像或隐式特征相比,高度图提供了更清晰、更易于理解的地形信息,使得强化学习策略能够更好地学习地形特征和运动控制之间的关系。此外,该方法仅依赖于本体感受和深度图像,无需额外的外部传感器,降低了成本和复杂性。

关键设计:论文中使用了深度卷积神经网络来提取高度图的特征,并使用循环神经网络来处理时间序列信息。强化学习策略采用Actor-Critic结构,Actor网络负责生成动作,Critic网络负责评估状态价值。损失函数包括策略梯度损失、价值函数损失和正则化损失。具体的网络结构和参数设置在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

该方法在真实四足机器人上进行了实验验证,结果表明,该方法能够在各种具有挑战性的地形上实现敏捷和自适应的运动。与基线方法相比,该方法在稀疏地形上的行走成功率显著提高(具体数据未知),并且能够更好地适应地形的变化。

🎯 应用场景

该研究成果可应用于搜救机器人、勘探机器人、农业机器人等领域,使其能够在复杂、崎岖的地形中自主行走,完成各种任务。例如,在灾难现场,搜救机器人可以利用该技术在废墟中搜索幸存者;在农业领域,机器人可以在田地中自主导航,进行作物监测和管理。

📄 摘要(原文)

Traversing risky terrains with sparse footholds presents significant challenges for legged robots, requiring precise foot placement in safe areas. To acquire comprehensive exteroceptive information, prior studies have employed motion capture systems or mapping techniques to generate heightmap for locomotion policy. However, these approaches require specialized pipelines and often introduce additional noise. While depth images from egocentric vision systems are cost-effective, their limited field of view and sparse information hinder the integration of terrain structure details into implicit features, which are essential for generating precise actions. In this paper, we demonstrate that end-to-end reinforcement learning relying solely on proprioception and depth images is capable of traversing risky terrains with high sparsity and randomness. Our method introduces local terrain reconstruction, leveraging the benefits of clear features and sufficient information from the heightmap, which serves as an intermediary for visual feature extraction and motion generation. This allows the policy to effectively represent and memorize critical terrain information. We deploy the proposed framework on a low-cost quadrupedal robot, achieving agile and adaptive locomotion across various challenging terrains and showcasing outstanding performance in real-world scenarios. Video at: youtu.be/Rj9v5EZsn-M.