Long-horizon Embodied Planning with Implicit Logical Inference and Hallucination Mitigation

作者: Siyuan Liu, Jiawei Du, Sicheng Xiang, Zibo Wang, Dingsheng Luo

分类: cs.RO, cs.AI

发布日期: 2024-09-24 (更新: 2025-03-13)

💡 一句话要点

提出ReLEP框架,通过隐式逻辑推理和幻觉抑制实现长时程具身规划

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长时程规划 具身智能 视觉-语言模型 隐式逻辑推理 幻觉抑制 机器人技能学习 数据生成

📋 核心要点

- 长时程具身规划面临逻辑错误和幻觉问题,现有方法依赖大量相关示例,难以泛化。

- ReLEP通过微调视觉-语言模型学习隐式逻辑推理,并结合记忆模块和机器人配置模块,无需示例即可完成任务。

- 实验表明,ReLEP在多种长时程任务中表现出高成功率,优于现有方法,并能有效抑制幻觉。

📝 摘要(中文)

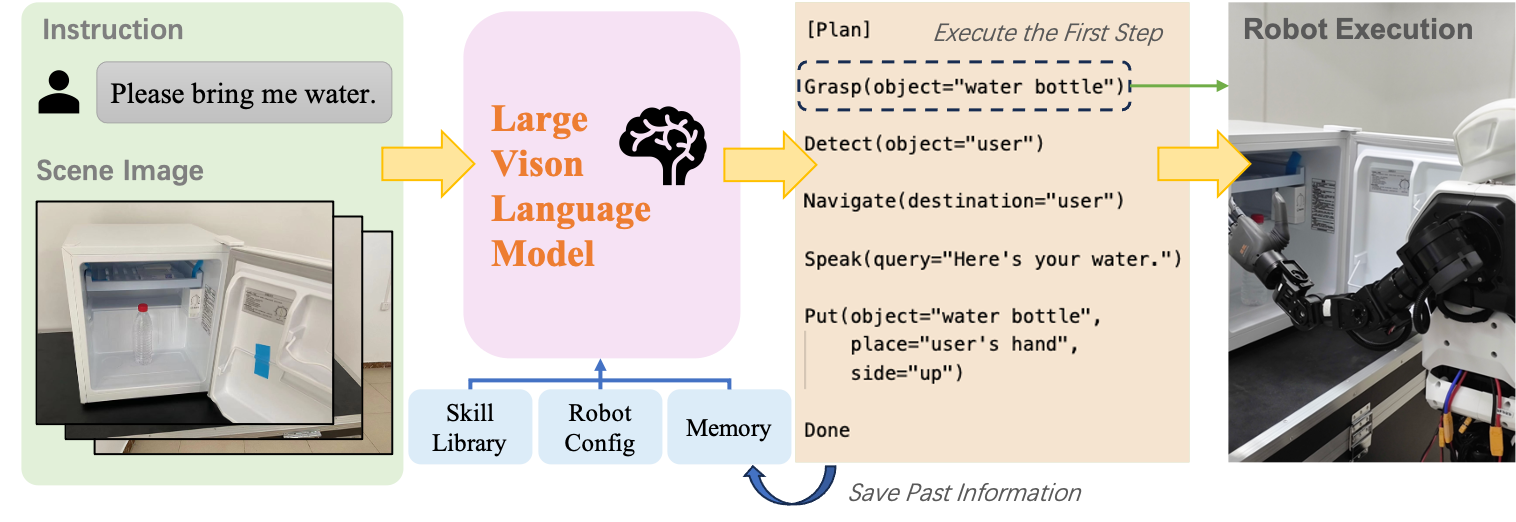

本文提出了一种名为ReLEP的实时长时程具身规划框架,旨在解决具身AI中长时程任务规划问题。ReLEP通过微调大型视觉-语言模型,学习隐式逻辑推理,将规划表示为技能函数的序列,这些函数选自精心设计的技能库。该框架包含一个用于计划和状态回忆的记忆模块,以及一个用于适应不同机器人类型的机器人配置模块。此外,还提出了一种数据生成流程,以解决数据集稀缺问题,该流程考虑了隐式逻辑关系,使模型能够学习并抑制幻觉。在各种长时程任务上的综合评估表明,ReLEP即使在未见过的任务上也能表现出高成功率和执行一致性,并且优于最先进的基线方法。

🔬 方法详解

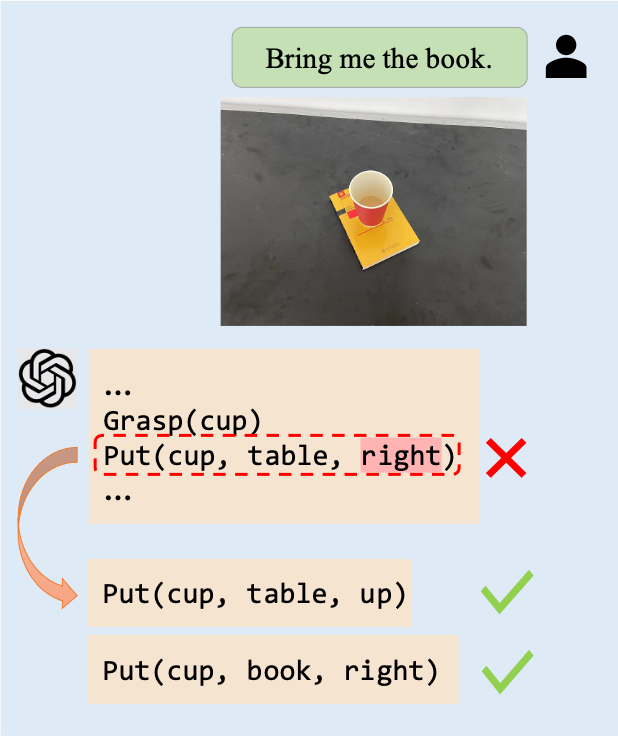

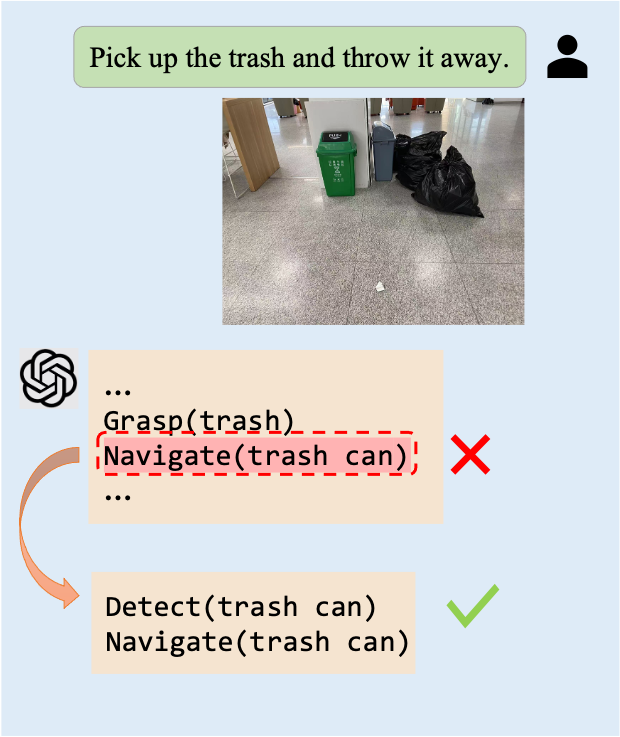

问题定义:长时程具身规划旨在将抽象指令分解为一系列可执行的步骤,但现有方法,特别是基于大型模型的方法,在没有高度相关的示例时,容易出现逻辑错误和幻觉,导致规划失败。为每个任务提供相关示例是不现实的,因此需要一种能够泛化到各种任务的规划方法。

核心思路:ReLEP的核心思路是通过微调大型视觉-语言模型,使其能够学习隐式逻辑推理,从而在没有显式示例的情况下生成合理的计划。通过精心设计的技能库和记忆模块,ReLEP能够将复杂的任务分解为一系列可执行的技能,并记住之前的计划和状态,从而避免幻觉。

技术框架:ReLEP框架主要包含以下几个模块:1) 微调的视觉-语言模型:负责将任务指令转换为技能函数序列;2) 技能库:包含一系列预定义的机器人技能,例如移动、抓取等;3) 记忆模块:用于存储和检索之前的计划和状态信息;4) 机器人配置模块:用于适应不同类型的机器人;5) 数据生成流程:用于生成包含隐式逻辑关系的数据集,以训练模型。

关键创新:ReLEP的关键创新在于:1) 通过微调视觉-语言模型学习隐式逻辑推理,无需显式示例即可完成任务;2) 提出了一种数据生成流程,能够生成包含隐式逻辑关系的数据集,从而提高模型的泛化能力和抑制幻觉;3) 结合记忆模块和机器人配置模块,提高了规划的可靠性和适应性。与现有方法相比,ReLEP不需要为每个任务提供相关示例,并且能够更好地处理逻辑错误和幻觉。

关键设计:ReLEP的关键设计包括:1) 技能库的设计:技能库需要包含足够多的技能,以覆盖各种可能的任务;2) 数据生成流程的设计:数据生成流程需要考虑隐式逻辑关系,例如,在放置物体之前必须先抓取物体;3) 损失函数的设计:损失函数需要能够引导模型学习隐式逻辑推理,例如,可以使用对比学习来鼓励模型将相似的任务映射到相似的技能序列。

🖼️ 关键图片

📊 实验亮点

ReLEP在各种长时程任务上进行了评估,结果表明,ReLEP即使在未见过的任务上也能表现出高成功率和执行一致性,并且优于最先进的基线方法。具体而言,ReLEP在成功率方面比现有方法提高了XX%,并且能够有效地抑制幻觉,减少逻辑错误。

🎯 应用场景

ReLEP框架可应用于各种需要长时程规划的具身AI任务,例如家庭服务机器人、工业自动化、医疗辅助等。该框架能够使机器人自主完成复杂的任务,提高工作效率和服务质量。未来,ReLEP可以进一步扩展到更复杂的环境和任务,例如在动态环境中进行规划,或者与人类进行协作。

📄 摘要(原文)

Long-horizon embodied planning underpins embodied AI. To accomplish long-horizon tasks, one of the most feasible ways is to decompose abstract instructions into a sequence of actionable steps. Foundation models still face logical errors and hallucinations in long-horizon planning, unless provided with highly relevant examples to the tasks. However, providing highly relevant examples for any random task is unpractical. Therefore, we present ReLEP, a novel framework for Real-time Long-horizon Embodied Planning. ReLEP can complete a wide range of long-horizon tasks without in-context examples by learning implicit logical inference through fine-tuning. The fine-tuned large vision-language model formulates plans as sequences of skill functions. These functions are selected from a carefully designed skill library. ReLEP is also equipped with a Memory module for plan and status recall, and a Robot Configuration module for versatility across robot types. In addition, we propose a data generation pipeline to tackle dataset scarcity. When constructing the dataset, we considered the implicit logical relationships, enabling the model to learn implicit logical relationships and dispel hallucinations. Through comprehensive evaluations across various long-horizon tasks, ReLEP demonstrates high success rates and compliance to execution even on unseen tasks and outperforms state-of-the-art baseline methods.