Optimizing Active Perception for Learning Simultaneous Viewpoint Selection and Manipulation with Diffusion Policy

作者: Xiatao Sun, Francis Fan, Yinxing Chen, Daniel Rakita

分类: cs.RO

发布日期: 2024-09-22 (更新: 2025-09-17)

💡 一句话要点

提出基于扩散策略的主动感知优化方法,解决机器人操作中动态视角选择与操作协同问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 主动感知 扩散策略 逆运动学 机器人操作 视角选择

📋 核心要点

- 现有机器人操作任务依赖静态相机,在复杂场景下缺乏灵活性,难以实现动态视角调整。

- 论文提出结合扩散策略和look-at逆运动学求解器的集成框架,优化相机视角选择,简化操作策略学习。

- 实验表明,该方法在性能和学习效率上优于直接应用扩散策略的方法,证明了其有效性。

📝 摘要(中文)

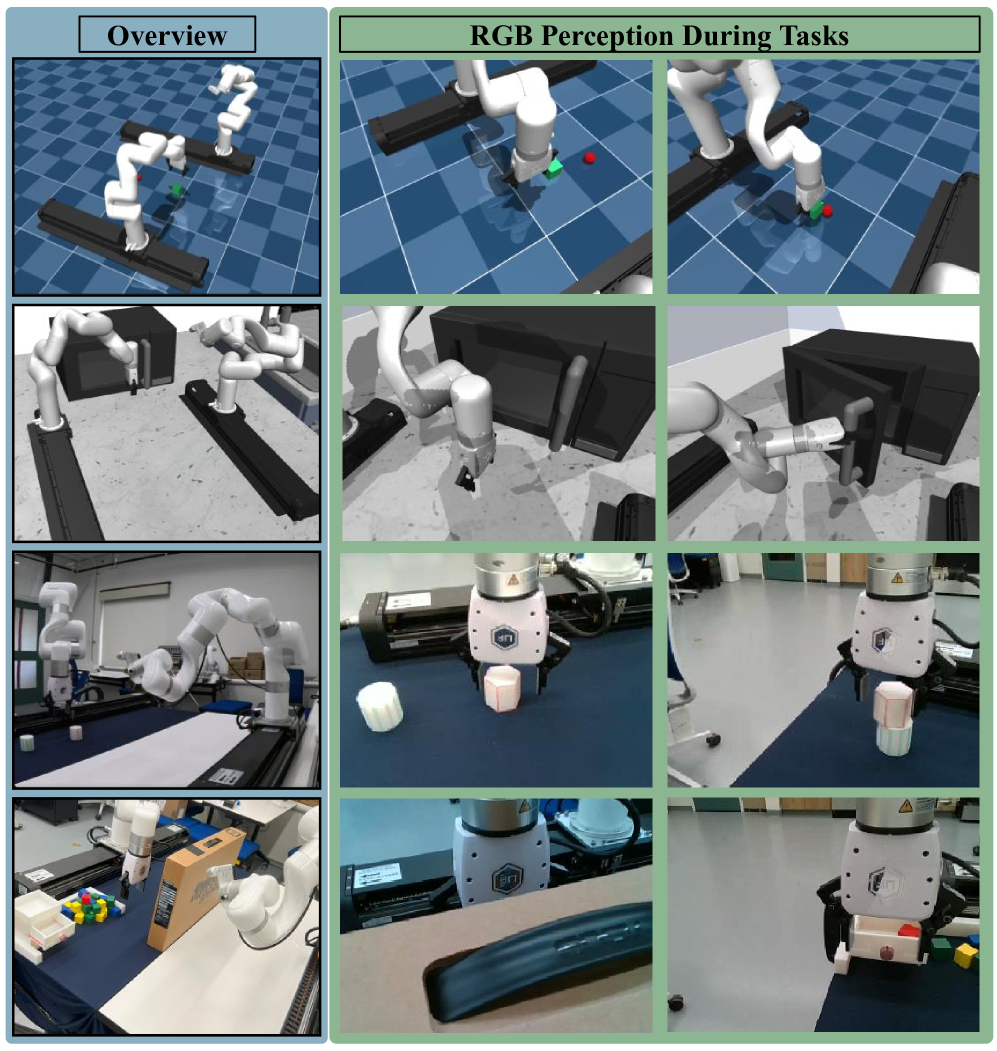

机器人操作任务通常依赖于静态相机进行感知,这限制了其灵活性,尤其是在机器人手术和杂乱环境等难以安装静态相机的场景中。理想情况下,机器人可以联合学习动态视角和操作策略。然而,动态视角控制需要额外的自由度,并与操作进行复杂的协调,这导致策略学习比单臂操作更具挑战性。为了解决这一复杂性,我们提出了一种集成的学习框架,该框架结合了扩散策略和一种新颖的look-at逆运动学求解器,用于主动感知。我们的框架有助于更好地协调感知和操作。它可以自动优化相机方向以进行视角选择,同时允许策略专注于基本的操作和定位决策。我们证明,与直接将扩散策略应用于配置空间或具有各种旋转表示的末端执行器空间相比,我们的集成方法实现了卓越的性能和学习效率。进一步的分析表明,这些性能差异是由不同状态-动作空间中高频分量的固有差异驱动的。

🔬 方法详解

问题定义:现有机器人操作任务,尤其是在机器人手术和杂乱环境中,依赖静态相机进行感知,这限制了其灵活性。动态视角控制需要额外的自由度,并与操作进行复杂的协调,导致策略学习比单臂操作更具挑战性。现有方法难以有效学习动态视角选择和操作的协同策略。

核心思路:论文的核心思路是将扩散策略与look-at逆运动学求解器相结合,实现主动感知。通过look-at逆运动学求解器自动优化相机方向,策略可以专注于基本的操作和定位决策,从而简化了策略学习过程。这种解耦的设计降低了学习难度,提高了学习效率。

技术框架:该框架包含两个主要部分:扩散策略和look-at逆运动学求解器。扩散策略负责生成操作动作,look-at逆运动学求解器根据操作目标自动调整相机视角。整体流程是:首先,扩散策略根据当前状态生成操作动作;然后,look-at逆运动学求解器根据操作动作和目标位置,计算出最佳的相机视角;最后,机器人执行操作动作,并调整相机视角。这个过程不断循环,直到完成任务。

关键创新:该论文的关键创新在于将扩散策略与look-at逆运动学求解器集成,实现主动感知。这种集成方法能够自动优化相机视角,从而简化了操作策略的学习。此外,论文还分析了不同状态-动作空间中高频分量的差异,解释了性能提升的原因。

关键设计:look-at逆运动学求解器的具体实现未知,但其目标是根据操作目标自动调整相机方向,使得目标始终位于相机视野中心。扩散策略的具体网络结构未知,但其输入是当前状态,输出是操作动作。损失函数的设计未知,但应该包含操作动作的损失和相机视角的损失。论文强调了不同状态-动作空间中高频分量的差异对学习的影响,但没有提供具体的参数设置或网络结构细节。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该集成方法在性能和学习效率上优于直接将扩散策略应用于配置空间或具有各种旋转表示的末端执行器空间的方法。具体性能数据未知,但论文强调了性能差异是由不同状态-动作空间中高频分量的固有差异驱动的。

🎯 应用场景

该研究成果可应用于机器人手术、装配、抓取等需要灵活视角调整的场景。通过主动感知,机器人可以更好地理解环境,提高操作的准确性和效率。未来,该方法有望应用于更复杂的机器人任务,例如自主导航、环境探索等。

📄 摘要(原文)

Robotic manipulation tasks often rely on static cameras for perception, which can limit flexibility, particularly in scenarios like robotic surgery and cluttered environments where mounting static cameras is impractical. Ideally, robots could jointly learn a policy for dynamic viewpoint and manipulation. However, dynamic viewpoint control requires additional degrees of freedom and intricate coordination with manipulation, which results in more challenging policy learning than single-arm manipulation. To address this complexity, we propose an integrated learning framework that combines diffusion policy with a novel look-at inverse kinematics solver for active perception. Our framework helps better coordinating between perception and manipulation. It automatically optimizes camera orientation for viewpoint selection, while allowing the policy to focus on essential manipulation and positioning decisions. We demonstrate that our integrated approach achieves superior performance and learning efficiency compared to directly applying diffusion policies to configuration space or end-effector space with various rotation representations. Further analysis suggests that these performance differences are driven by inherent variations in the high-frequency components across different state-action spaces.