Bootstrapping Object-level Planning with Large Language Models

作者: David Paulius, Alejandro Agostini, Benedict Quartey, George Konidaris

分类: cs.RO

发布日期: 2024-09-18 (更新: 2025-03-21)

备注: Accepted to ICRA 2025; 11 pages (6 pages + 1 page references + 4 pages appendix); for demo videos, please see https://davidpaulius.github.io/olp_llm/

💡 一句话要点

利用大型语言模型引导物体级别规划,提升任务与运动规划性能

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 任务与运动规划 物体级别规划 功能性面向对象网络 知识提取

📋 核心要点

- 现有方法依赖LLM直接输出任务规划或生成PDDL目标,但LLM难以完成实际规划或生成可行的目标。

- 该方法从LLM中提取计划模式,以功能性面向对象网络(FOON)表示,并自动生成PDDL子目标。

- 实验表明,该方法在模拟拾取和放置任务中,显著优于其他规划策略,提升了任务完成度。

📝 摘要(中文)

本文提出了一种新方法,该方法从大型语言模型(LLM)中提取知识,以生成物体级别规划,描述物体状态的高级变化,并使用这些规划来引导任务和运动规划(TAMP)。现有工作使用LLM直接输出任务规划或生成PDDL等表示形式的目标。然而,这些方法存在不足,因为它们依赖于LLM来完成实际规划或输出难以满足的目标。我们的方法从LLM中提取计划模式形式的知识,作为一种称为功能性面向对象网络(FOON)的物体级别表示,我们从中自动生成PDDL子目标。我们的方法在模拟环境中完成多个拾取和放置任务时,明显优于其他规划策略。

🔬 方法详解

问题定义:现有方法在利用大型语言模型(LLM)进行任务和运动规划(TAMP)时,通常直接让LLM生成任务规划或PDDL形式的目标。这种方式的痛点在于,LLM本身并不擅长进行精确的规划,或者生成的目标过于理想化,难以在实际环境中实现。因此,如何有效利用LLM的知识,同时避免其规划能力不足的缺点,是需要解决的问题。

核心思路:本文的核心思路是,不直接让LLM进行规划,而是将其视为知识库,从中提取关于物体状态变化的“计划模式”。这些计划模式以功能性面向对象网络(FOON)的形式表示,描述了物体状态的高级变化。然后,利用这些FOON自动生成PDDL子目标,从而引导TAMP过程。这种方式将LLM的知识提取与传统规划方法相结合,既利用了LLM的知识,又避免了其规划能力不足的问题。

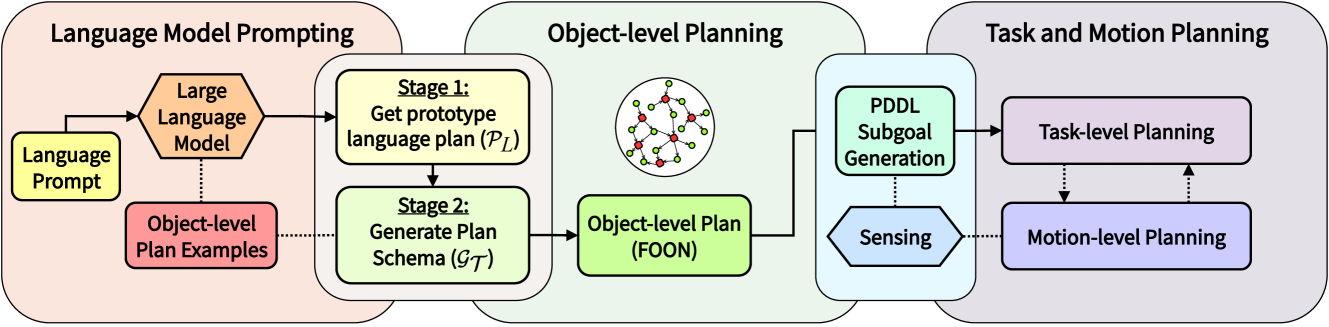

技术框架:整体流程如下:1. 使用LLM生成关于任务的描述,从中提取出FOON形式的计划模式。2. 将FOON转换为PDDL子目标。3. 使用TAMP求解器,以生成的PDDL子目标为指导,进行任务和运动规划。这个框架包含两个主要模块:LLM知识提取模块和TAMP求解模块。LLM知识提取模块负责从LLM中提取FOON,TAMP求解模块负责根据FOON生成的PDDL子目标进行规划。

关键创新:最重要的技术创新点在于使用FOON作为LLM知识的中间表示。FOON是一种物体级别的表示,描述了物体状态的高级变化,例如“拿起物体”、“放下物体”等。与直接使用LLM生成任务规划或PDDL目标相比,FOON更加抽象,更容易从LLM中提取,也更容易转换为PDDL子目标。此外,FOON还具有一定的泛化能力,可以应用于不同的任务和环境。

关键设计:论文中没有详细描述关键的参数设置、损失函数、网络结构等技术细节。FOON的具体结构和提取方法、以及FOON到PDDL子目标的转换规则是关键设计,但文中没有给出具体实现细节。具体LLM的选择和prompt设计也会影响FOON的质量,但文中没有详细讨论。这些细节可能在补充材料或后续工作中给出。

🖼️ 关键图片

📊 实验亮点

论文在模拟环境中进行了实验,结果表明,该方法在多个拾取和放置任务中,明显优于其他规划策略。具体的性能数据和提升幅度在论文中给出,但此处未提供详细数值。实验结果验证了该方法在利用LLM知识进行物体级别规划方面的有效性。

🎯 应用场景

该研究成果可应用于机器人自动化、智能制造、家庭服务等领域。通过利用大型语言模型的知识,机器人可以更好地理解任务目标,并生成合理的规划,从而提高自动化水平和工作效率。例如,在智能制造中,机器人可以根据产品设计图纸,自动生成装配计划;在家庭服务中,机器人可以根据用户的指令,完成各种家务任务。

📄 摘要(原文)

We introduce a new method that extracts knowledge from a large language model (LLM) to produce object-level plans, which describe high-level changes to object state, and uses them to bootstrap task and motion planning (TAMP). Existing work uses LLMs to directly output task plans or generate goals in representations like PDDL. However, these methods fall short because they rely on the LLM to do the actual planning or output a hard-to-satisfy goal. Our approach instead extracts knowledge from an LLM in the form of plan schemas as an object-level representation called functional object-oriented networks (FOON), from which we automatically generate PDDL subgoals. Our method markedly outperforms alternative planning strategies in completing several pick-and-place tasks in simulation.