BEINGS: Bayesian Embodied Image-goal Navigation with Gaussian Splatting

作者: Wugang Meng, Tianfu Wu, Huan Yin, Fumin Zhang

分类: cs.RO

发布日期: 2024-09-16

💡 一句话要点

提出BEINGS,利用高斯溅射和贝叶斯方法实现高效图像目标导航。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 图像目标导航 高斯溅射 贝叶斯方法 模型预测控制 具身智能

📋 核心要点

- 现有图像目标导航方法依赖大量数据和高计算成本的学习方法,或因探索策略不足导致在复杂环境中效率低下。

- BEINGS利用3D高斯溅射作为场景先验,在模型预测控制框架下进行贝叶斯更新,动态优化导航策略。

- 通过仿真和物理实验验证,BEINGS在视觉复杂场景中展现出高效导航的潜力,无需大量先验数据。

📝 摘要(中文)

本文提出了一种名为BEINGS的贝叶斯具身图像目标导航方法,该方法利用高斯溅射作为场景先验,在模型预测控制框架内将图像导航问题建模为最优控制问题。BEINGS能够预测未来观测,从而根据机器人自身的感知经验做出高效、实时的导航决策。通过集成贝叶斯更新,该方法能够动态地优化机器人的策略,而无需大量的先验经验或数据。通过广泛的仿真和物理实验验证了该算法在视觉复杂场景中具身机器人系统的潜力。

🔬 方法详解

问题定义:图像目标导航旨在使机器人能够到达目标图像被拍摄的位置,依赖视觉线索进行引导。现有方法的痛点在于,要么需要大量数据进行训练,计算成本高昂;要么在复杂环境中,由于探索策略不足,导航效率低下。

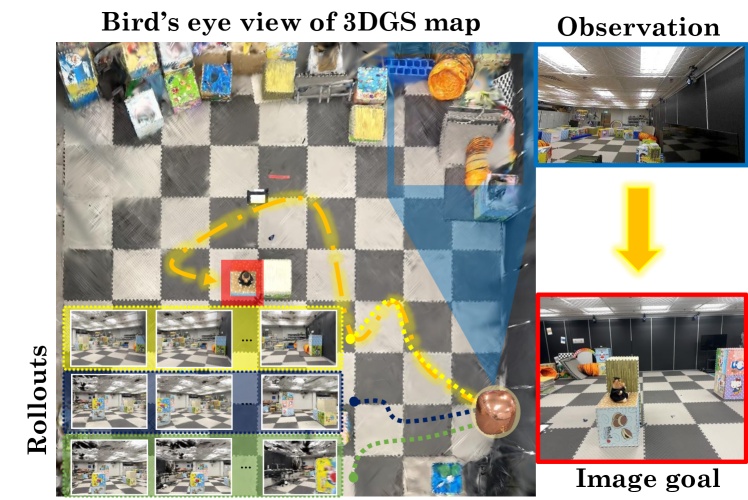

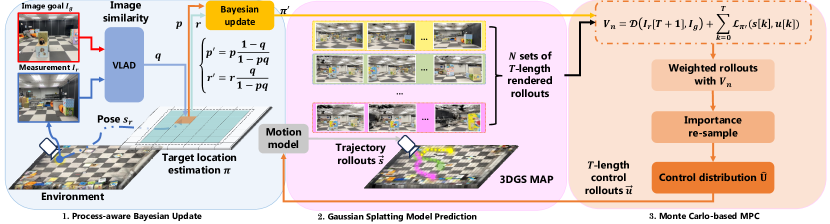

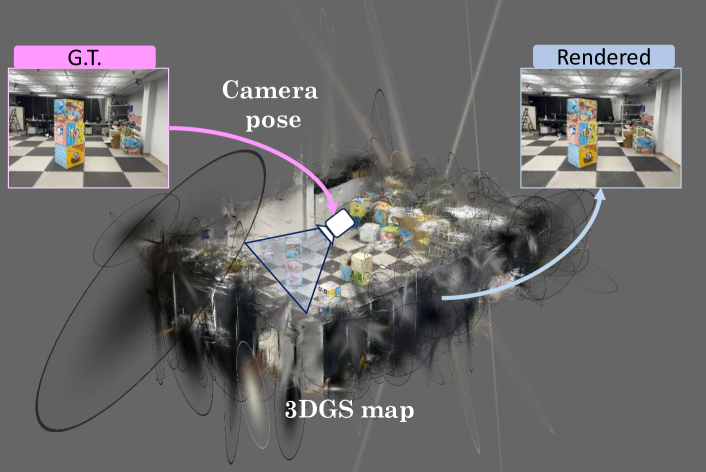

核心思路:BEINGS的核心思路是将图像目标导航问题转化为一个最优控制问题,并在模型预测控制(MPC)框架下求解。利用3D高斯溅射(3D Gaussian Splatting)作为场景的先验知识,预测机器人未来的观测,从而做出更明智的导航决策。通过贝叶斯更新,动态地调整机器人的导航策略,使其能够适应不同的环境和任务,而无需大量的预训练数据。

技术框架:BEINGS的整体框架包含以下几个主要模块:1) 场景表示模块:使用3D高斯溅射来构建场景的3D表示。2) 观测预测模块:利用场景表示和机器人的当前状态,预测未来时刻的观测图像。3) 模型预测控制模块:基于预测的观测图像,计算最优的控制指令,使机器人能够朝着目标图像的方向移动。4) 贝叶斯更新模块:根据实际观测和预测观测之间的差异,更新机器人的状态估计和场景表示,从而提高导航的准确性和鲁棒性。

关键创新:BEINGS的关键创新在于将3D高斯溅射和贝叶斯方法相结合,用于图像目标导航。与现有方法相比,BEINGS不需要大量的预训练数据,并且能够动态地适应不同的环境和任务。此外,BEINGS利用3D场景表示来预测未来的观测,从而能够做出更明智的导航决策。

关键设计:BEINGS的关键设计包括:1) 使用高斯溅射进行场景表示,能够高效地渲染出高质量的图像。2) 使用贝叶斯滤波器进行状态估计和场景更新,能够有效地处理噪声和不确定性。3) 使用模型预测控制来规划机器人的运动轨迹,能够保证导航的效率和安全性。具体的损失函数可能包含图像相似度损失、运动平滑性损失等。具体的网络结构未知。

🖼️ 关键图片

📊 实验亮点

论文通过仿真和物理实验验证了BEINGS的有效性。实验结果表明,BEINGS在视觉复杂场景中能够实现高效的图像目标导航,并且优于现有的方法。具体的性能数据和提升幅度未知,但实验结果表明BEINGS具有很强的潜力。

🎯 应用场景

BEINGS具有广泛的应用前景,例如在家庭服务机器人、仓储物流机器人、自动驾驶汽车等领域。它可以帮助机器人在复杂的环境中自主导航,完成各种任务,例如送货、清洁、巡逻等。此外,BEINGS还可以用于虚拟现实和增强现实等领域,为用户提供更逼真的沉浸式体验。

📄 摘要(原文)

Image-goal navigation enables a robot to reach the location where a target image was captured, using visual cues for guidance. However, current methods either rely heavily on data and computationally expensive learning-based approaches or lack efficiency in complex environments due to insufficient exploration strategies. To address these limitations, we propose Bayesian Embodied Image-goal Navigation Using Gaussian Splatting, a novel method that formulates ImageNav as an optimal control problem within a model predictive control framework. BEINGS leverages 3D Gaussian Splatting as a scene prior to predict future observations, enabling efficient, real-time navigation decisions grounded in the robot's sensory experiences. By integrating Bayesian updates, our method dynamically refines the robot's strategy without requiring extensive prior experience or data. Our algorithm is validated through extensive simulations and physical experiments, showcasing its potential for embodied robot systems in visually complex scenarios.