Embedded Image-to-Image Translation for Efficient Sim-to-Real Transfer in Learning-based Robot-Assisted Soft Manipulation

作者: Jacinto Colan, Keisuke Sugita, Ana Davila, Yutaro Yamada, Yasuhisa Hasegawa

分类: cs.RO, cs.LG

发布日期: 2024-09-16

备注: Accepted at 2024 IEEE International Symposium on Micro-NanoMechatronics and Human Science

期刊: 2024 International Symposium on Micro-NanoMehatronics and Human Science (MHS)

DOI: 10.1109/MHS63891.2024.10856291

💡 一句话要点

提出基于嵌入式图像转换的Sim-to-Real方法,提升软体机器人辅助手术学习效率。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: Sim-to-Real 图像转换 嵌入式表示 机器人辅助手术 软体操作

📋 核心要点

- 机器人学习在模拟环境取得了显著进展,但模拟与现实的差距阻碍了其在自主手术系统中的有效部署。

- 论文提出利用图像转换模型来缩小模拟和现实之间的差距,并使用转换后图像的嵌入表示来提升手术操作模型的训练效率。

- 实验结果表明,该方法显著提高了任务成功率,并减少了任务完成所需的步骤,有效弥合了Sim-to-Real差距。

📝 摘要(中文)

本文提出了一种新颖的方法,利用图像转换模型来缓解模拟环境和真实环境之间的差异,从而促进基于学习的机器人辅助软体操作技能的高效学习。该方法采用对比式非配对图像到图像的转换,允许从转换后的图像中获取嵌入式表示。随后,这些嵌入被用于提高手术操作模型训练的效率。实验结果表明,与传统方法相比,该方法显著提高了任务成功率,并减少了完成任务所需的步骤。结果表明,该系统有效地弥合了Sim-to-Real差距,为推进微创手术中手术机器人的自主性提供了一个强大的框架。

🔬 方法详解

问题定义:论文旨在解决机器人辅助软体操作中,由于模拟环境与真实环境存在差异(Sim-to-Real gap)而导致在模拟环境中训练的模型难以直接应用于真实手术场景的问题。现有方法难以有效弥合这种差异,导致模型泛化能力不足,需要大量的真实数据进行微调,成本高昂。

核心思路:论文的核心思路是利用图像转换模型将模拟环境的图像转换为更接近真实环境的图像,从而减小Sim-to-Real gap。通过学习转换后图像的嵌入式表示,可以提取与任务相关的、对环境差异不敏感的特征,进而提高模型在真实环境中的泛化能力。

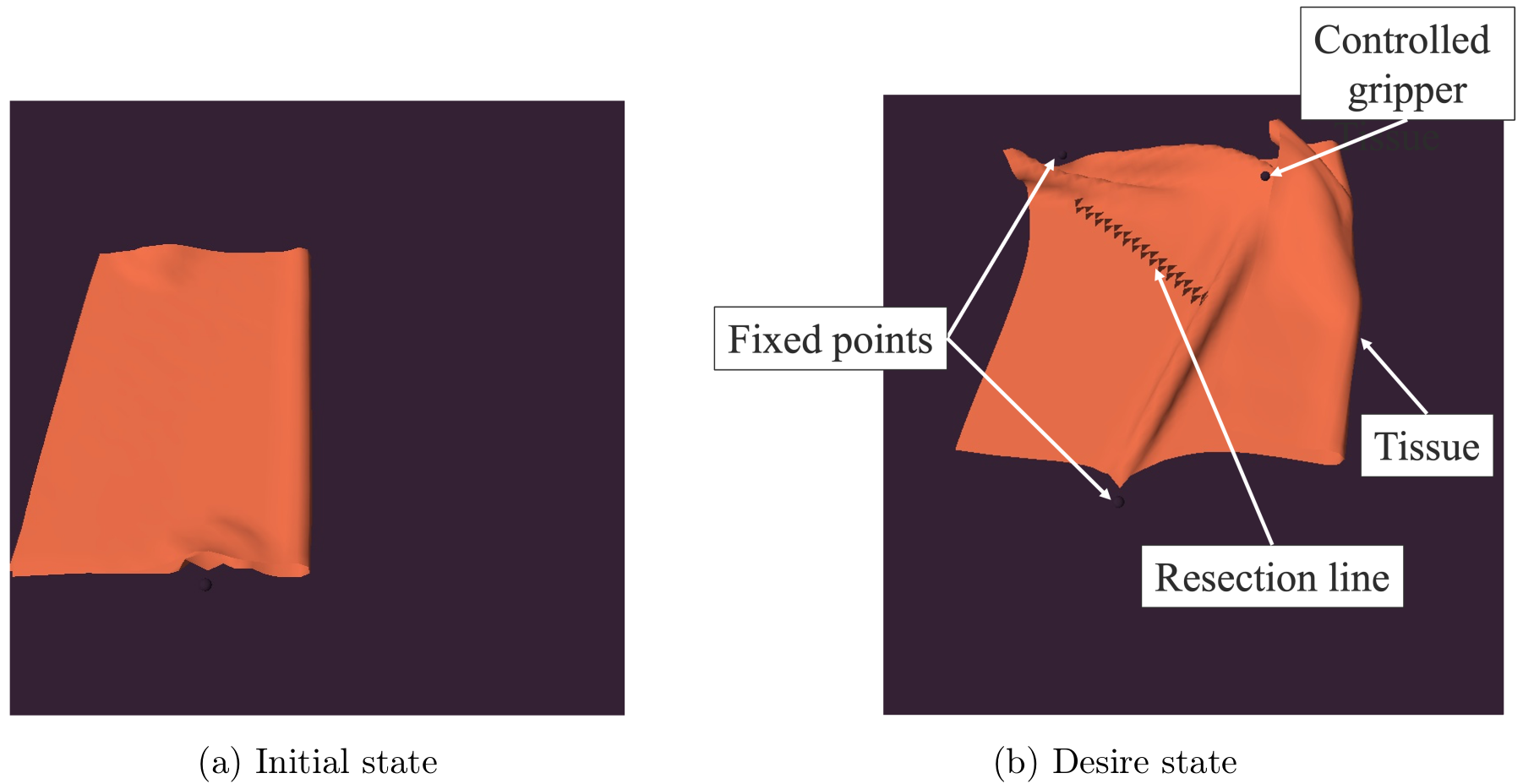

技术框架:整体框架包含以下几个主要阶段:1) 在模拟环境中生成大量图像数据;2) 使用对比式非配对图像到图像转换模型(如CycleGAN或CUT)将模拟图像转换为更真实的图像;3) 从转换后的图像中提取嵌入式表示(例如,通过预训练的CNN提取特征);4) 使用这些嵌入式表示训练手术操作模型(例如,强化学习模型或模仿学习模型);5) 在真实环境中进行测试和验证。

关键创新:论文的关键创新在于将图像转换技术与嵌入式表示学习相结合,用于解决Sim-to-Real问题。与直接使用原始模拟图像训练模型相比,该方法能够学习到对环境差异更鲁棒的特征表示,从而提高模型的泛化能力。此外,使用对比式非配对图像转换模型,无需配对的模拟和真实图像数据,降低了数据收集的难度。

关键设计:论文中可能涉及的关键设计包括:1) 选择合适的图像转换模型(如CycleGAN, CUT等),并针对具体的手术场景进行调整;2) 设计合适的损失函数来训练图像转换模型,例如,对抗损失、循环一致性损失、对比损失等;3) 选择合适的嵌入式表示提取方法,例如,使用预训练的CNN模型(如ResNet, VGG等)提取特征,或者训练专门的嵌入式表示学习网络;4) 设计合适的训练策略来训练手术操作模型,例如,使用强化学习算法(如PPO, DDPG等),或者使用模仿学习算法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与传统方法相比,该方法显著提高了任务成功率,并减少了完成任务所需的步骤。具体的性能数据(例如,任务成功率的提升百分比,完成任务所需步骤的减少量)需要在论文中查找。该方法有效地弥合了Sim-to-Real差距,为推进微创手术中手术机器人的自主性提供了一个强大的框架。

🎯 应用场景

该研究成果可广泛应用于机器人辅助手术领域,尤其是在微创手术中。通过降低Sim-to-Real gap,可以加速手术机器人的自主学习过程,减少对真实数据的依赖,降低开发成本。此外,该方法还可以应用于其他需要跨环境迁移的机器人任务,例如,在虚拟环境中训练自动驾驶汽车,然后在真实道路上进行测试。

📄 摘要(原文)

Recent advances in robotic learning in simulation have shown impressive results in accelerating learning complex manipulation skills. However, the sim-to-real gap, caused by discrepancies between simulation and reality, poses significant challenges for the effective deployment of autonomous surgical systems. We propose a novel approach utilizing image translation models to mitigate domain mismatches and facilitate efficient robot skill learning in a simulated environment. Our method involves the use of contrastive unpaired Image-to-image translation, allowing for the acquisition of embedded representations from these transformed images. Subsequently, these embeddings are used to improve the efficiency of training surgical manipulation models. We conducted experiments to evaluate the performance of our approach, demonstrating that it significantly enhances task success rates and reduces the steps required for task completion compared to traditional methods. The results indicate that our proposed system effectively bridges the sim-to-real gap, providing a robust framework for advancing the autonomy of surgical robots in minimally invasive procedures.