Friction-Aware Safety Locomotion for Wheeled-legged Robots using Vision Language Models and Reinforcement Learning

作者: Bo Peng, Donghoon Baek, Qijie Wang, Joao Ramos

分类: cs.RO

发布日期: 2024-09-15 (更新: 2025-08-04)

备注: Accepted to Humanoids 2025

💡 一句话要点

提出基于视觉语言模型和强化学习的轮腿机器人摩擦感知安全运动框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 轮腿机器人 视觉语言模型 强化学习 摩擦感知 安全运动

📋 核心要点

- 轮腿机器人在湿滑表面易打滑,传统方法依赖本体感受反馈,难以应对突发的地面摩擦变化。

- 利用视觉语言模型预测地面摩擦系数,并将其融入强化学习策略,使机器人能提前调整运动策略。

- 实验表明,该方法在湿滑表面轨迹跟踪任务中优于传统方法,验证了预测摩擦信息对安全运动的有效性。

📝 摘要(中文)

本文提出了一种摩擦感知的安全运动框架,该框架集成了视觉语言模型(VLM)和强化学习(RL)策略,用于控制轮腿机器人,尤其是在湿滑表面上。该方法采用检索增强生成(RAG)方法来估计摩擦系数(CoF),并将其显式地纳入RL策略中。这使得机器人能够根据预测的摩擦条件调整其速度。通过在仿真和物理定制的轮式倒立摆(WIP)上进行的实验验证了该框架。实验结果表明,我们的方法成功地完成了在湿滑表面上的轨迹跟踪任务,而仅依赖于本体感受反馈的基线方法则失败了。这些发现突出了显式预测和利用地面摩擦信息对于安全运动的重要性和有效性。它们也指出了探索使用VLM来估计地面条件这一有希望的研究方向,这对于纯粹基于视觉的方法来说仍然是一个重大挑战。

🔬 方法详解

问题定义:轮腿机器人在光滑表面上的运动控制是一个具有挑战性的问题。传统的控制方法主要依赖于本体感受信息,例如电机编码器和IMU,但这些信息无法直接感知地面的摩擦情况。当机器人遇到光滑表面时,容易发生打滑,导致运动轨迹偏离甚至失稳。现有方法缺乏对环境摩擦的预判能力,难以提前调整运动策略,从而影响了运动的安全性。

核心思路:本文的核心思路是利用视觉语言模型(VLM)来预测地面的摩擦系数(CoF),并将预测的CoF信息融入到强化学习(RL)策略中。通过VLM,机器人可以提前感知地面的光滑程度,从而调整运动速度和姿态,降低打滑的风险。这种方法将环境感知与运动控制相结合,提高了机器人在复杂环境下的适应性和安全性。

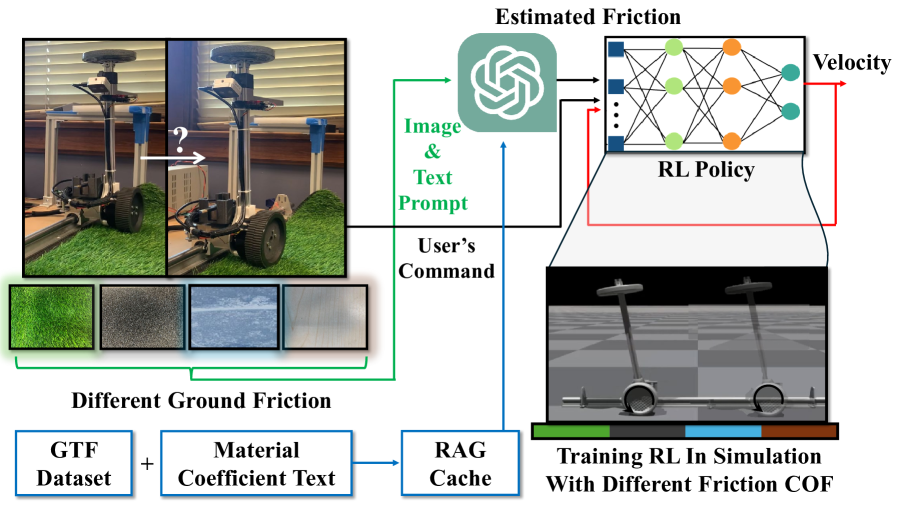

技术框架:该框架主要包含两个模块:摩擦系数预测模块和强化学习控制模块。摩擦系数预测模块使用检索增强生成(RAG)方法,通过视觉输入和语言描述来估计地面的摩擦系数。强化学习控制模块则利用预测的摩擦系数作为输入,训练一个能够根据摩擦情况调整运动策略的RL策略。整体流程是:机器人首先通过摄像头获取环境图像,然后利用VLM预测地面的摩擦系数,最后将预测的摩擦系数输入到RL策略中,控制机器人的运动。

关键创新:该方法最重要的创新点在于将视觉语言模型与强化学习相结合,实现了对地面摩擦的预测和利用。与传统的基于本体感受的控制方法相比,该方法能够提前感知环境信息,从而做出更合理的运动决策。此外,使用RAG方法来估计摩擦系数也是一个创新点,它能够利用大量的视觉和语言数据来提高预测的准确性。

关键设计:在摩擦系数预测模块中,使用了预训练的视觉语言模型,并通过微调来适应地面摩擦预测任务。RAG方法的关键在于构建一个包含大量地面图像和对应摩擦系数的数据库,并通过检索相似图像来提高预测的准确性。在强化学习控制模块中,使用了Actor-Critic算法,并将预测的摩擦系数作为状态的一部分输入到Actor网络中。损失函数的设计考虑了运动轨迹的跟踪误差和能量消耗,以实现高效安全的运动。

🖼️ 关键图片

📊 实验亮点

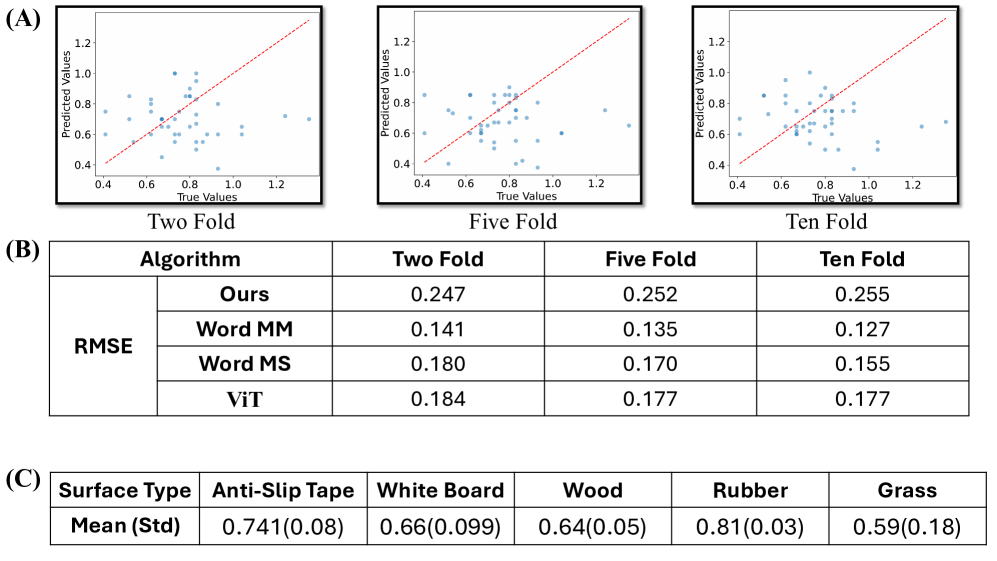

实验结果表明,该方法在湿滑表面上的轨迹跟踪任务中取得了显著的成功。与仅依赖于本体感受反馈的基线方法相比,该方法能够更准确地跟踪目标轨迹,并显著降低了打滑的风险。在仿真和物理实验中,该方法都表现出了良好的性能,验证了其有效性和可行性。具体而言,在相同的湿滑条件下,该方法能够成功完成轨迹跟踪任务,而基线方法则经常出现失稳或轨迹偏离。

🎯 应用场景

该研究成果可应用于各种需要在复杂地面环境下运动的轮腿机器人,例如物流机器人、巡检机器人、搜救机器人等。通过提前感知地面摩擦情况,机器人可以更安全、更高效地完成任务。此外,该方法还可以扩展到其他类型的机器人,例如四足机器人和人形机器人,提高它们在复杂环境下的适应性和鲁棒性。未来,该技术有望在智能交通、智能制造等领域发挥重要作用。

📄 摘要(原文)

Controlling Wheeled-legged robots is challenging especially on slippery surfaces due to their dependence on continuous ground contact. Unlike quadrupeds or bipeds, which can leverage multiple fixed contact points for recovery, wheeled-legged robots are highly susceptible to slip, where even momentary loss of traction can result in irrecoverable instability. Anticipating ground physical properties such as friction before contact would allow proactive control adjustments, reducing slip risk. In this paper, we propose a friction-aware safety locomotion framework that integrates Vision-Language Models (VLMs) with a Reinforcement Learning (RL) policy. Our method employs a Retrieval-Augmented Generation (RAG) approach to estimate the Coefficient of Friction (CoF), which is then explicitly incorporated into the RL policy. This enables the robot to adapt its speed based on predicted friction conditions before contact. The framework is validated through experiments in both simulation and on a physical customized Wheeled Inverted Pendulum (WIP). Experimental results show that our approach successfully completes trajectory tracking tasks on slippery surfaces, whereas baseline methods relying solely on proprioceptive feedback fail. These findings highlight the importance and effectiveness of explicitly predicting and utilizing ground friction information for safe locomotion. They also point to a promising research direction in exploring the use of VLMs for estimating ground conditions, which remains a significant challenge for purely vision-based methods.