Touch2Touch: Cross-Modal Tactile Generation for Object Manipulation

作者: Samanta Rodriguez, Yiming Dou, Miquel Oller, Andrew Owens, Nima Fazeli

分类: cs.RO

发布日期: 2024-09-12

💡 一句话要点

提出Touch2Touch,通过跨模态触觉生成实现通用物体操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 触觉感知 跨模态学习 生成模型 扩散模型 机器人操作 传感器融合

📋 核心要点

- 现有触觉传感器种类繁多,模型通常与特定传感器设计绑定,缺乏通用性。

- 提出Touch2Touch,利用生成模型实现不同触觉传感器信号间的跨模态转换,从而实现触觉信息的泛化。

- 通过扩散模型在GelSlim和Soft Bubble传感器上验证,并在手中物体姿态估计任务上验证了有效性。

📝 摘要(中文)

现有的触觉传感器种类繁多,这给通用触觉处理方法的发展带来了挑战,因为模型通常与特定的传感器设计绑定。本文通过执行触觉传感器之间的跨模态预测来解决这个问题:给定来自一个传感器的触觉信号,我们使用生成模型来估计相同的物理接触如何被另一个传感器感知。这允许我们将特定于传感器的方法应用于生成的信号。我们通过训练扩散模型在流行的GelSlim和Soft Bubble传感器之间进行转换来实现这一想法。作为一个下游任务,我们使用GelSlim传感器执行手中物体姿态估计,同时使用仅在Soft Bubble信号上运行的算法。数据集、代码和其他详细信息可在https://www.mmintlab.com/research/touch2touch/找到。

🔬 方法详解

问题定义:现有触觉传感器种类繁多,针对特定传感器设计的触觉处理方法难以泛化到其他类型的传感器上。这限制了触觉感知技术在机器人操作等领域的应用,因为需要为每种传感器单独开发算法。因此,如何实现触觉信息的跨传感器泛化是一个关键问题。

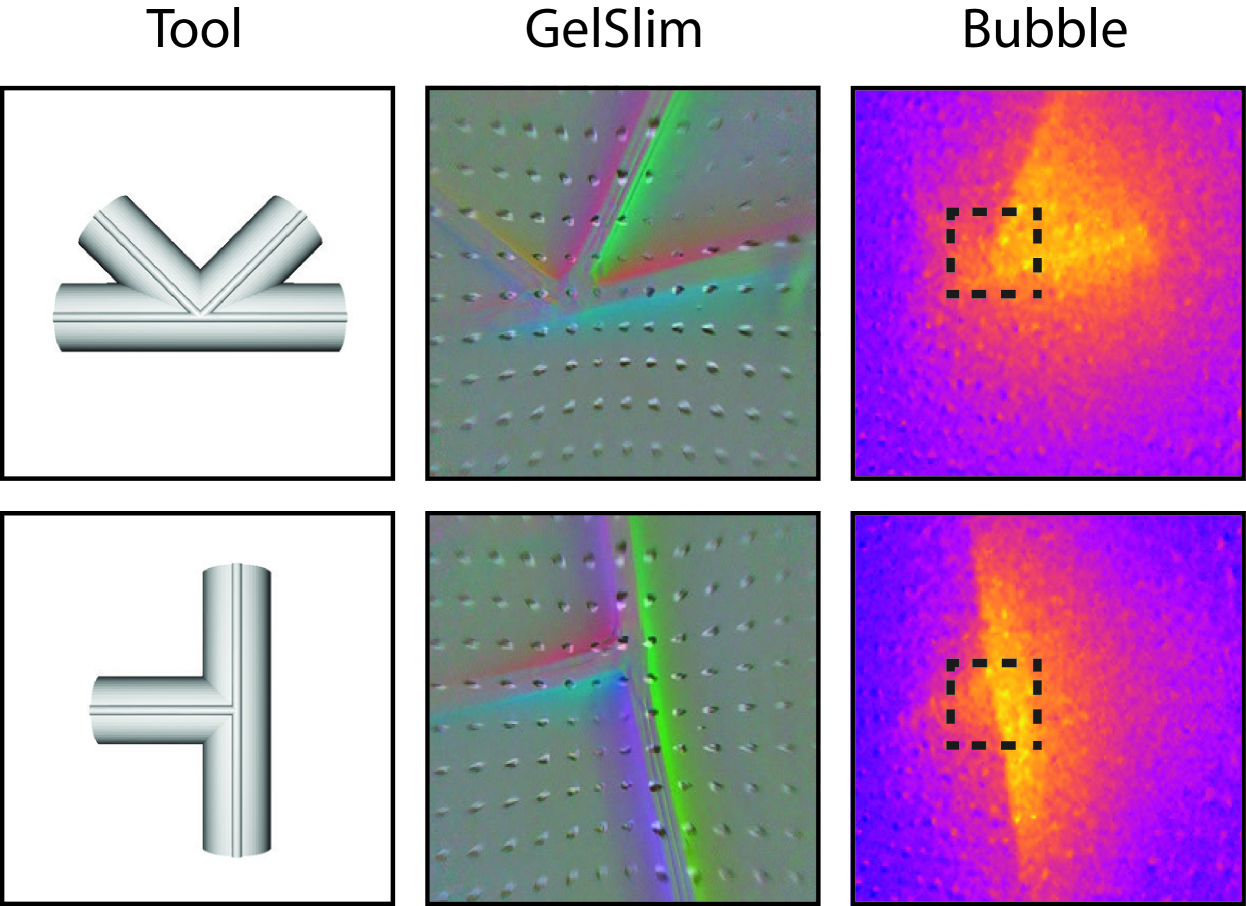

核心思路:论文的核心思路是利用生成模型学习不同触觉传感器之间的映射关系,实现跨模态触觉信号的转换。具体来说,给定一个传感器的触觉信号,模型能够生成另一个传感器在相同物理接触下的触觉信号。这样,就可以将针对特定传感器设计的算法应用于生成的信号,从而实现触觉信息的泛化。

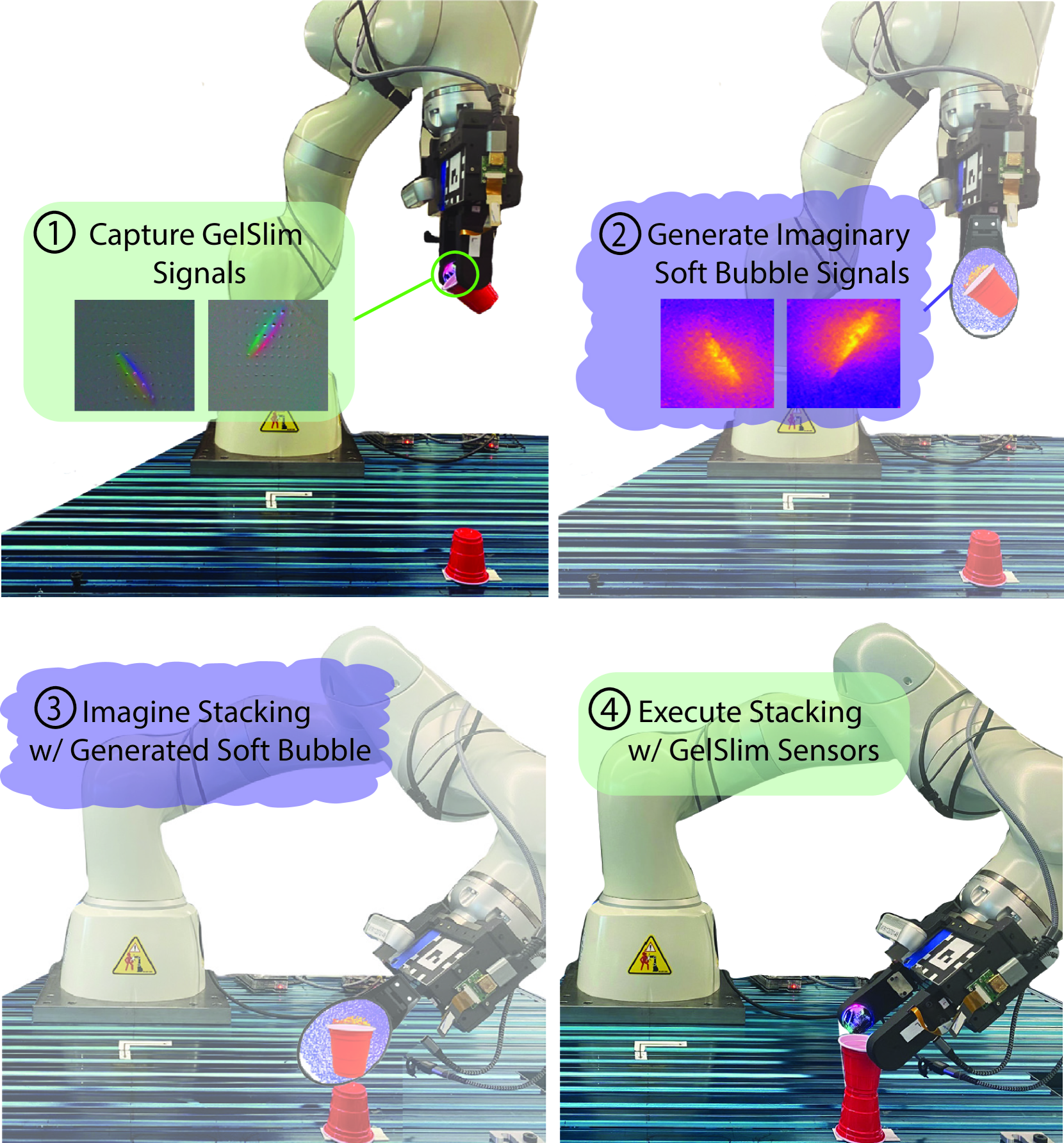

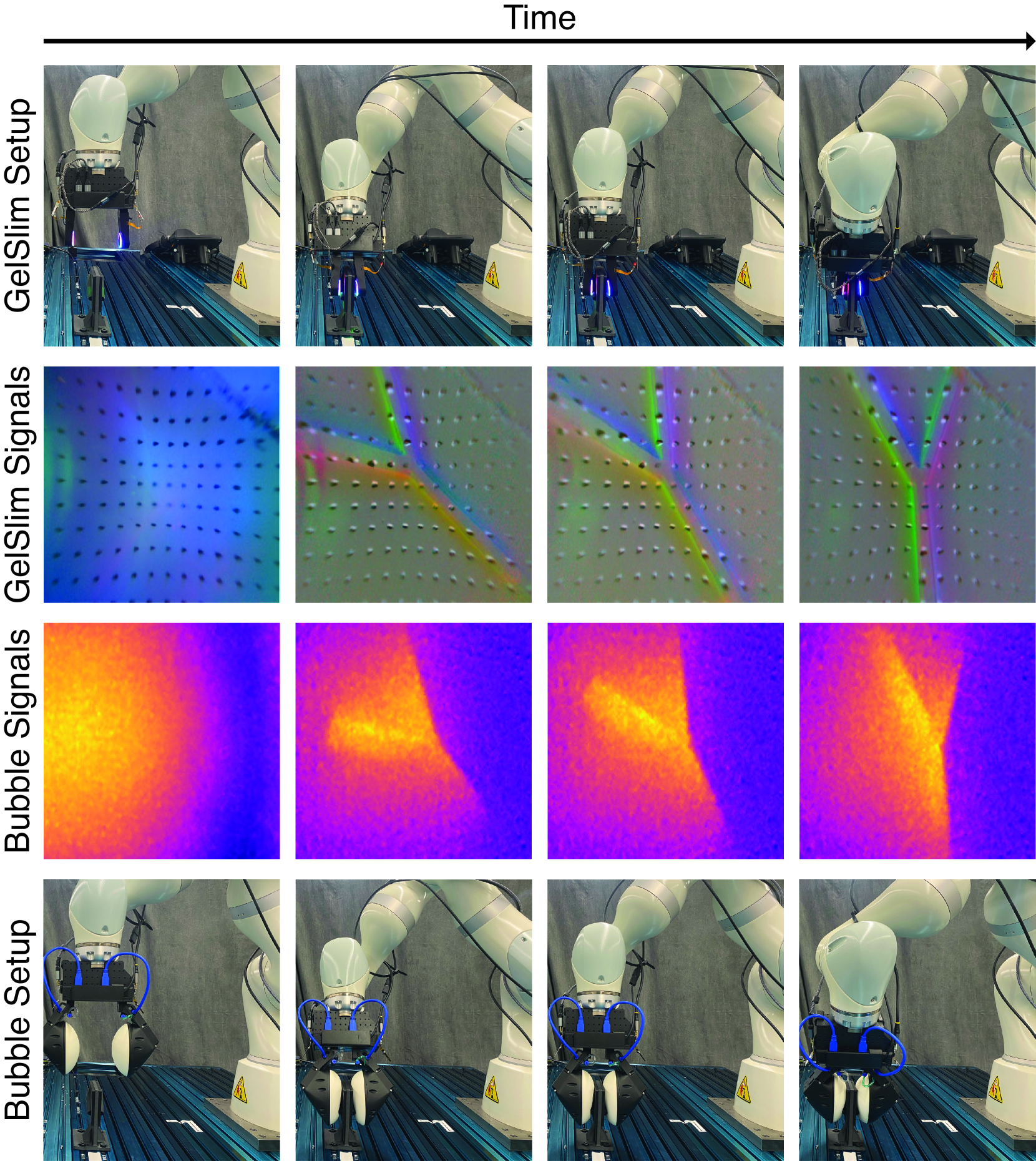

技术框架:Touch2Touch 的整体框架包含以下几个主要步骤:1) 数据收集:收集不同触觉传感器在相同物理接触下的触觉信号数据。2) 模型训练:使用收集到的数据训练一个生成模型,学习不同传感器之间的映射关系。论文采用扩散模型作为生成模型。3) 信号转换:给定一个传感器的触觉信号,使用训练好的生成模型将其转换为另一个传感器的信号。4) 应用:将转换后的信号应用于下游任务,例如物体姿态估计。

关键创新:该论文的关键创新在于提出了跨模态触觉生成的概念,并利用扩散模型实现了不同触觉传感器信号之间的转换。与以往针对特定传感器设计的触觉处理方法不同,Touch2Touch 能够实现触觉信息的跨传感器泛化,从而提高了触觉感知技术的通用性和灵活性。

关键设计:论文使用扩散模型作为生成模型,扩散模型通过逐步添加噪声将数据转换为噪声,然后学习如何从噪声中恢复数据。在训练过程中,论文使用了均方误差(MSE)损失函数来衡量生成信号与目标信号之间的差异。此外,论文还探索了不同的网络结构和参数设置,以提高生成模型的性能。具体来说,使用了U-Net结构,并调整了扩散步骤的数量和噪声水平。

🖼️ 关键图片

📊 实验亮点

论文通过在GelSlim和Soft Bubble传感器上进行实验,验证了Touch2Touch的有效性。在手中物体姿态估计任务中,使用Touch2Touch将GelSlim信号转换为Soft Bubble信号后,可以直接应用针对Soft Bubble传感器设计的算法,取得了与直接使用Soft Bubble传感器相当的性能。这表明Touch2Touch能够有效地实现触觉信息的跨传感器泛化。

🎯 应用场景

Touch2Touch技术可应用于机器人灵巧操作、虚拟现实触觉反馈、医疗触诊等领域。通过实现触觉信息的跨传感器泛化,可以降低触觉感知系统的开发成本,提高系统的鲁棒性和适应性。未来,该技术有望推动触觉感知技术在更广泛领域的应用,例如智能制造、康复机器人等。

📄 摘要(原文)

Today's touch sensors come in many shapes and sizes. This has made it challenging to develop general-purpose touch processing methods since models are generally tied to one specific sensor design. We address this problem by performing cross-modal prediction between touch sensors: given the tactile signal from one sensor, we use a generative model to estimate how the same physical contact would be perceived by another sensor. This allows us to apply sensor-specific methods to the generated signal. We implement this idea by training a diffusion model to translate between the popular GelSlim and Soft Bubble sensors. As a downstream task, we perform in-hand object pose estimation using GelSlim sensors while using an algorithm that operates only on Soft Bubble signals. The dataset, the code, and additional details can be found at https://www.mmintlab.com/research/touch2touch/.