Robot Utility Models: General Policies for Zero-Shot Deployment in New Environments

作者: Haritheja Etukuru, Norihito Naka, Zijin Hu, Seungjae Lee, Julian Mehu, Aaron Edsinger, Chris Paxton, Soumith Chintala, Lerrel Pinto, Nur Muhammad Mahi Shafiullah

分类: cs.RO, cs.LG

发布日期: 2024-09-09

备注: Project website https://robotutilitymodels.com

💡 一句话要点

提出机器人通用模型(RUMs),实现零样本泛化至新环境的机器人策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人通用模型 零样本泛化 多模态模仿学习 机器人操作 数据驱动 机器人自省 移动操作 环境适应

📋 核心要点

- 现有机器人模型需要针对每个新环境进行微调,这与语言或视觉模型可以零样本部署到开放世界问题形成鲜明对比。

- 论文提出机器人通用模型(RUMs)框架,通过多模态模仿学习训练机器人策略,使其能够零样本泛化到新环境。

- 实验表明,RUMs在未见过的环境中与未见过的物体交互时,平均成功率达到90%,且适用于不同的机器人和相机设置。

📝 摘要(中文)

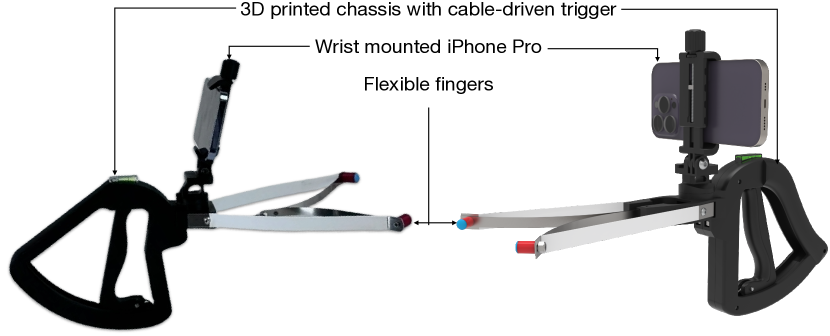

本文提出机器人通用模型(RUMs),一个用于训练和部署零样本机器人策略的框架,该策略可以直接泛化到新环境中,无需任何微调。为了高效地创建RUMs,我们开发了新的工具,用于快速收集移动操作任务的数据,将这些数据通过多模态模仿学习集成到策略中,并在廉价的商用机器人Hello Robot Stretch上进行设备端部署,同时使用外部mLLM验证器进行重试。我们训练了五个这样的通用模型,用于打开柜门、打开抽屉、捡起餐巾、捡起纸袋和重新调整倒下的物体。我们的系统在未见过的、新颖的环境中与未见过的物体交互时,平均成功率达到90%。此外,通用模型还可以在不同的机器人和相机设置中成功运行,无需进一步的数据、训练或微调。我们的主要经验包括训练数据比训练算法和策略类更重要,关于数据缩放的指导,多样化但高质量的演示的必要性,以及用于机器人自省和重试以提高单个环境性能的方法。我们的代码、数据、模型、硬件设计以及实验和部署视频都是开源的,可以在我们的项目网站上找到。

🔬 方法详解

问题定义:现有机器人模型在特定环境中训练后,难以直接泛化到新的、未知的环境中。每次部署到新环境都需要进行微调,这限制了机器人模型的通用性和部署效率。现有方法的痛点在于缺乏一种能够实现零样本泛化的通用机器人策略。

核心思路:论文的核心思路是通过大规模、多样化的数据训练机器人通用模型(RUMs),使其能够学习到通用的操作技能和环境适应能力。RUMs通过模仿学习从人类演示中学习,并利用多模态信息(例如视觉、触觉)来提高策略的鲁棒性和泛化能力。此外,RUMs还集成了机器人自省和重试机制,以提高在复杂环境中的性能。

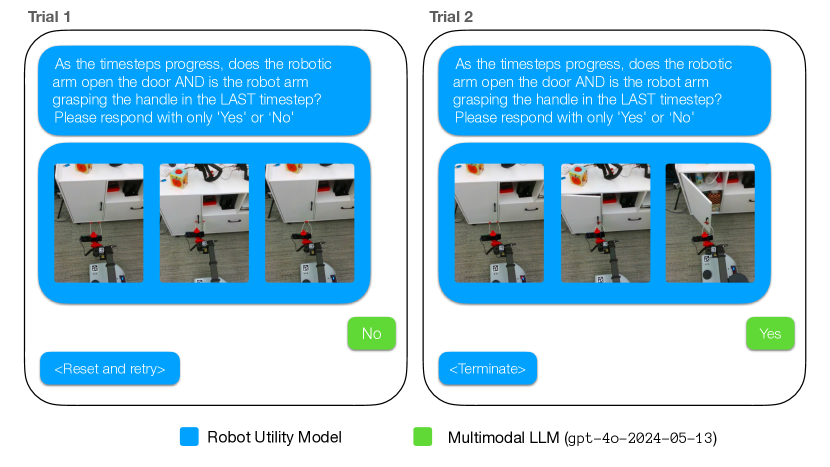

技术框架:RUMs的整体框架包括数据收集、策略训练和部署三个主要阶段。数据收集阶段利用新的工具快速收集移动操作任务的数据。策略训练阶段使用多模态模仿学习将数据集成到策略中。部署阶段将策略部署在Hello Robot Stretch机器人上,并使用外部mLLM验证器进行重试。该框架的关键在于数据驱动的训练方式和机器人自省机制。

关键创新:RUMs最重要的技术创新点在于其零样本泛化能力。与需要针对每个新环境进行微调的传统方法不同,RUMs可以直接部署到新的、未知的环境中,无需任何额外的训练或微调。这种零样本泛化能力是通过大规模、多样化的数据训练和多模态模仿学习实现的。此外,RUMs还集成了机器人自省和重试机制,进一步提高了其在复杂环境中的性能。

关键设计:RUMs的关键设计包括:1) 使用多模态数据(例如视觉、触觉)进行模仿学习,以提高策略的鲁棒性和泛化能力。2) 集成机器人自省和重试机制,以提高在复杂环境中的性能。3) 使用外部mLLM验证器来评估策略的执行结果,并根据评估结果进行重试。4) 采用数据增强技术来增加训练数据的多样性,提高模型的泛化能力。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RUMs在未见过的、新颖的环境中与未见过的物体交互时,平均成功率达到90%。此外,RUMs还可以在不同的机器人和相机设置中成功运行,无需进一步的数据、训练或微调。这些结果表明,RUMs具有很强的泛化能力和鲁棒性。

🎯 应用场景

该研究成果具有广泛的应用前景,例如在家庭服务、物流仓储、医疗护理等领域。RUMs可以用于开发能够自主完成各种任务的通用机器人,从而提高工作效率和服务质量。此外,RUMs还可以用于开发能够适应各种环境的机器人,例如在灾难救援、太空探索等领域。

📄 摘要(原文)

Robot models, particularly those trained with large amounts of data, have recently shown a plethora of real-world manipulation and navigation capabilities. Several independent efforts have shown that given sufficient training data in an environment, robot policies can generalize to demonstrated variations in that environment. However, needing to finetune robot models to every new environment stands in stark contrast to models in language or vision that can be deployed zero-shot for open-world problems. In this work, we present Robot Utility Models (RUMs), a framework for training and deploying zero-shot robot policies that can directly generalize to new environments without any finetuning. To create RUMs efficiently, we develop new tools to quickly collect data for mobile manipulation tasks, integrate such data into a policy with multi-modal imitation learning, and deploy policies on-device on Hello Robot Stretch, a cheap commodity robot, with an external mLLM verifier for retrying. We train five such utility models for opening cabinet doors, opening drawers, picking up napkins, picking up paper bags, and reorienting fallen objects. Our system, on average, achieves 90% success rate in unseen, novel environments interacting with unseen objects. Moreover, the utility models can also succeed in different robot and camera set-ups with no further data, training, or fine-tuning. Primary among our lessons are the importance of training data over training algorithm and policy class, guidance about data scaling, necessity for diverse yet high-quality demonstrations, and a recipe for robot introspection and retrying to improve performance on individual environments. Our code, data, models, hardware designs, as well as our experiment and deployment videos are open sourced and can be found on our project website: https://robotutilitymodels.com