Affordance-based Robot Manipulation with Flow Matching

作者: Fan Zhang, Michael Gienger

分类: cs.RO, cs.AI

发布日期: 2024-09-02 (更新: 2025-11-07)

💡 一句话要点

提出基于Flow Matching的机器人操作框架,解决日常场景下的可供性学习与动作生成问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 机器人操作 可供性学习 Flow Matching Prompt Tuning 视觉运动策略 多任务学习 日常活动

📋 核心要点

- 现有方法难以高效地将大规模模型应用于日常场景下的可供性理解任务,且收集多任务数据成本高昂。

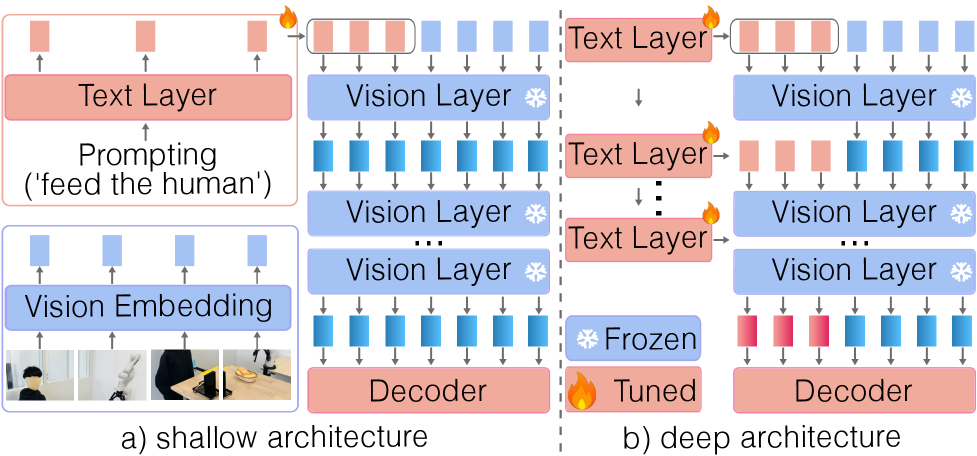

- 采用参数高效的prompt tuning方法,通过可学习的文本提示来预测多任务场景中的操作可供性。

- 提出基于可供性引导的flow matching方法学习机器人动作轨迹,实现更稳定的训练和更快的推理。

📝 摘要(中文)

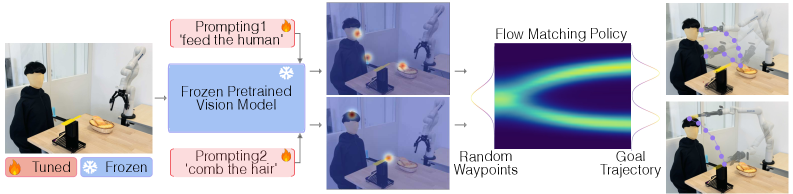

本文提出了一个辅助机器人操作的框架,专注于两个基本挑战:一是高效地将大规模模型适应于下游场景的可供性理解任务,尤其是在日常生活中,收集涉及人类的多任务数据需要付出巨大努力;二是有效地学习机器人动作轨迹,通过对视觉可供性模型进行grounding。我们通过采用参数高效的prompt tuning方法来应对第一个挑战,该方法将可学习的文本提示添加到冻结的视觉模型中,以预测多任务场景中的操作可供性。然后,我们提出通过有监督的flow matching方法学习由可供性引导的机器人动作轨迹。Flow matching将机器人视觉运动策略表示为随机路点流向期望机器人动作轨迹的条件过程。最后,我们引入了一个包含日常活动中10个任务的真实世界数据集来测试我们的框架。大量的评估表明,所提出的用于学习操作可供性的prompt tuning方法实现了有竞争力的性能,甚至在不同的数据规模上优于其他一些微调协议,同时满足了参数效率。与一些替代的行为克隆方法相比,使用flow matching学习多任务机器人动作轨迹在几个机器人操作基准测试中始终如一地获得了良好的结果。这包括更稳定的训练和评估,以及明显更快的推理速度,同时保持了与扩散策略相当的泛化性能,在大多数情况下,flow matching的性能略好。我们的框架无缝地统一了可供性学习和动作生成,并使用flow matching进行机器人操作。

🔬 方法详解

问题定义:论文旨在解决机器人操作中两个关键问题:一是如何高效地将大规模视觉模型适应于下游场景的可供性理解任务,尤其是在数据收集成本高昂的日常环境中;二是如何有效地学习机器人动作轨迹,并将其与视觉可供性模型相结合。现有方法在数据效率、训练稳定性和推理速度方面存在不足。

核心思路:论文的核心思路是利用prompt tuning来高效学习可供性,并使用flow matching来生成机器人动作轨迹。Prompt tuning通过少量可学习参数调整预训练模型,降低了数据需求和计算成本。Flow matching将动作生成视为一个连续的流动过程,提高了训练的稳定性和推理速度。

技术框架:该框架包含两个主要模块:可供性学习模块和动作生成模块。可供性学习模块使用prompt tuning来预测场景中的操作可供性。动作生成模块使用flow matching,将随机路点逐步引导至期望的机器人动作轨迹。整个框架通过可供性信息将视觉感知和动作生成连接起来。

关键创新:该论文的关键创新在于:1) 提出了一种参数高效的prompt tuning方法,用于学习多任务场景下的操作可供性;2) 使用flow matching来学习机器人动作轨迹,提高了训练的稳定性和推理速度;3) 将可供性学习和动作生成统一到一个框架中,实现了端到端的机器人操作。

关键设计:Prompt tuning模块在冻结的视觉模型前添加可学习的文本提示,通过优化这些提示来适应下游任务。Flow matching模块使用连续归一化流(Continuous Normalizing Flows, CNF)来建模动作轨迹的流动过程,损失函数基于flow matching的目标,鼓励随机路点沿着期望轨迹流动。数据集包含10个日常活动任务,用于评估框架的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的prompt tuning方法在学习操作可供性方面取得了有竞争力的性能,甚至在不同数据规模上优于其他微调方法,同时保持了参数效率。使用flow matching学习多任务机器人动作轨迹在多个机器人操作基准测试中表现优异,训练和评估更稳定,推理速度更快,泛化性能与扩散策略相当,甚至略有优势。

🎯 应用场景

该研究成果可应用于各种辅助机器人操作场景,例如家庭服务机器人、医疗辅助机器人和工业自动化。通过理解场景中的可供性并生成相应的动作轨迹,机器人可以更好地协助人类完成各种任务,提高工作效率和生活质量。未来,该技术有望进一步扩展到更复杂的环境和任务中。

📄 摘要(原文)

We present a framework for assistive robot manipulation, which focuses on two fundamental challenges: first, efficiently adapting large-scale models to downstream scene affordance understanding tasks, especially in daily living scenarios where gathering multi-task data involving humans requires strenuous effort; second, effectively learning robot action trajectories by grounding the visual affordance model. We tackle the first challenge by employing a parameter-efficient prompt tuning method that prepends learnable text prompts to the frozen vision model to predict manipulation affordances in multi-task scenarios. Then we propose to learn robot action trajectories guided by affordances in a supervised flow matching method. Flow matching represents a robot visuomotor policy as a conditional process of flowing random waypoints to desired robot action trajectories. Finally, we introduce a real-world dataset with 10 tasks across Activities of Daily Living to test our framework. Our extensive evaluation highlights that the proposed prompt tuning method for learning manipulation affordance achieves competitive performance and even outperforms some other finetuning protocols across data scales, while satisfying parameter efficiency. Learning multi-task robot action trajectories with flow matching leads to consistently favorable results in several robot manipulation benchmarks than some alternative behavior cloning methods. This includes more stable training and evaluation, and noticeably faster inference, while maintaining comparable generalization performance to diffusion policy, where flow matching performs marginally better in most cases. Our framework seamlessly unifies affordance learning and action generation with flow matching for robot manipulation.