ReMoBot: Retrieval-Based Few-Shot Imitation Learning for Mobile Manipulation with Vision Foundation Models

作者: Yuying Zhang, Wenyan Yang, Francesco Verdoja, Ville Kyrki, Joni Pajarinen

分类: cs.RO

发布日期: 2024-08-28 (更新: 2025-09-18)

💡 一句话要点

ReMoBot:基于检索的少样本模仿学习用于移动操作,利用视觉基础模型

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 少样本学习 模仿学习 移动操作 视觉基础模型 机器人 检索增强学习 视觉伺服 机器人学习

📋 核心要点

- 现有模仿学习方法在少样本和部分可观察性下,难以生成准确的机器人动作,限制了其在复杂环境中的应用。

- ReMoBot通过检索与当前视觉观察相似的演示轨迹,直接复用专家经验,避免了从少量数据中学习复杂策略。

- 实验表明,ReMoBot仅需20个演示即可在真实机器人上成功完成移动操作任务,优于现有基线方法,并具备一定的泛化能力。

📝 摘要(中文)

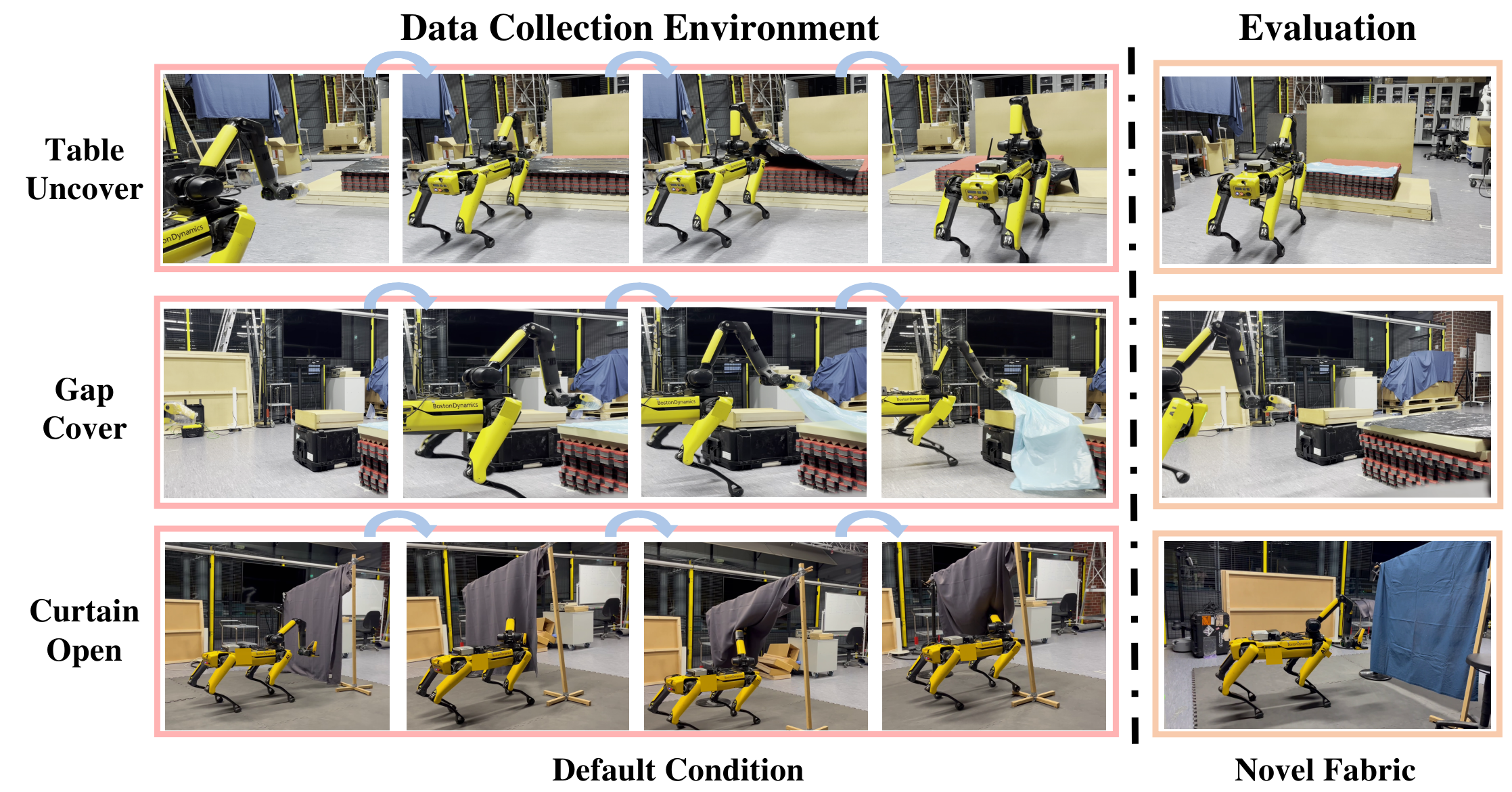

模仿学习(IL)算法通常将经验提炼成参数化的行为策略,以模仿专家演示。然而,在演示数据有限的情况下,现有方法通常难以生成准确的动作,尤其是在部分可观察性下。为了解决这个问题,我们提出了一种少样本IL方法,ReMoBot,它直接从演示中检索信息,以解决具有自我中心视觉观察的移动操作任务。给定当前的观察,ReMoBot利用视觉基础模型来识别相关的演示,考虑个体观察和历史轨迹的视觉相似性。然后,运动选择策略选择适当的命令,直到任务成功完成。ReMoBot的性能在模拟和真实世界的三个移动操作任务中,使用Boston Dynamics Spot机器人进行评估。在模拟环境中对五种方法进行基准测试后,我们将我们的方法与真实环境中的两个基线进行比较,直接在真实世界数据集上进行训练,而无需进行sim-to-real迁移。仅使用20个演示,ReMoBot优于基线,在Table Uncover(70%)和Gap Cover(80%)中实现了高成功率,同时在更具挑战性的真实世界环境中的Curtain Open任务中也显示出良好的性能。此外,ReMoBot展示了在不同机器人位置、物体大小和材料类型上的泛化能力。更多细节请访问:https://sites.google.com/view/remobot/home

🔬 方法详解

问题定义:论文旨在解决少样本模仿学习在移动操作任务中的挑战,尤其是在机器人只能获得自我中心视觉观察的情况下。现有方法通常依赖于从少量演示数据中学习参数化的行为策略,这在数据有限和环境复杂的情况下容易过拟合,导致泛化能力差。此外,部分可观察性使得学习过程更加困难,因为机器人无法获得完整的环境状态信息。

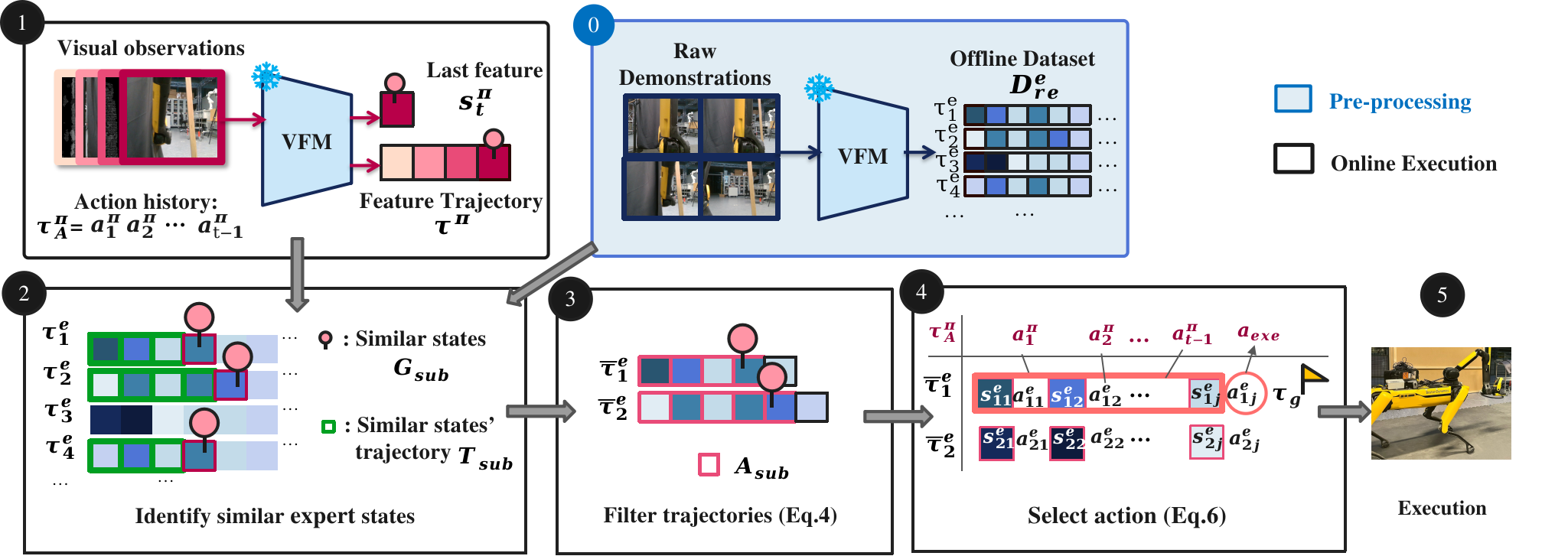

核心思路:ReMoBot的核心思路是利用检索增强模仿学习,避免直接学习复杂的策略。它通过视觉基础模型提取视觉特征,并基于视觉相似性从演示数据集中检索相关的轨迹片段。然后,通过运动选择策略选择合适的动作,从而实现任务目标。这种方法的核心在于利用已有的专家经验,而不是从头开始学习,从而提高了在少样本情况下的学习效率和泛化能力。

技术框架:ReMoBot的整体框架包含以下几个主要模块:1) 视觉特征提取:使用视觉基础模型(如CLIP)从自我中心的视觉观察中提取特征。2) 演示检索:基于视觉相似性度量(例如,余弦相似度),从演示数据集中检索与当前观察最相关的轨迹片段。检索过程考虑了单个观察和历史轨迹的相似性。3) 运动选择:根据检索到的轨迹片段,使用运动选择策略选择下一步的机器人动作。运动选择策略可以是简单的最近邻方法,也可以是更复杂的学习模型。4) 任务执行:机器人执行选定的动作,并重复上述过程,直到任务成功完成。

关键创新:ReMoBot的关键创新在于将检索增强学习应用于少样本移动操作任务,并利用视觉基础模型提取视觉特征。与传统的模仿学习方法相比,ReMoBot避免了从少量数据中学习复杂的参数化策略,而是直接复用专家经验,从而提高了学习效率和泛化能力。此外,ReMoBot还考虑了历史轨迹的视觉相似性,从而更好地捕捉了任务的动态特性。

关键设计:ReMoBot的关键设计包括:1) 视觉特征提取模型的选择:论文使用了CLIP作为视觉基础模型,因为它具有强大的视觉表征能力和跨模态学习能力。2) 相似性度量方法的选择:论文使用了余弦相似度作为视觉特征之间的相似性度量,因为它简单有效。3) 运动选择策略的设计:论文使用了简单的最近邻方法作为运动选择策略,但也可以使用更复杂的学习模型,例如,基于检索到的轨迹片段训练一个局部策略。

🖼️ 关键图片

📊 实验亮点

ReMoBot在真实世界的移动操作任务中取得了显著的成果。在Table Uncover任务中,ReMoBot的成功率达到了70%,在Gap Cover任务中达到了80%。与基线方法相比,ReMoBot在少样本情况下表现出更强的泛化能力。此外,ReMoBot还展示了在不同机器人位置、物体大小和材料类型上的鲁棒性。这些实验结果表明,ReMoBot是一种有效的少样本模仿学习方法,可以应用于实际的机器人应用。

🎯 应用场景

ReMoBot具有广泛的应用前景,例如在家庭服务机器人、工业自动化和医疗辅助机器人等领域。它可以帮助机器人在复杂和动态的环境中执行各种移动操作任务,例如物体抓取、放置和操作。通过利用少量的演示数据,ReMoBot可以快速适应新的任务和环境,降低了机器人部署和维护的成本。此外,ReMoBot还可以与其他机器人学习方法相结合,例如强化学习和主动学习,从而进一步提高机器人的学习能力和泛化能力。

📄 摘要(原文)

Imitation learning (IL) algorithms typically distill experience into parametric behavior policies to mimic expert demonstrations. However, with limited demonstrations, existing methods often struggle to generate accurate actions, particularly under partial observability. To address this problem, we introduce a few-shot IL approach, ReMoBot, which directly retrieves information from demonstrations to solve Mobile manipulation tasks with ego-centric visual observations. Given the current observation, ReMoBot utilizes vision foundation models to identify relevant demonstrations, considering visual similarity w.r.t. both individual observations and history trajectories. A motion selection policy then selects the proper command for the robot until the task is successfully completed. The performance of ReMoBot is evaluated on three mobile manipulation tasks with a Boston Dynamics Spot robot in both simulation and the real world. After benchmarking five approaches in simulation, we compare our method with two baselines in the real world, training directly on the real-world dataset without sim-to-real transfer. With only 20 demonstrations, ReMoBot outperforms the baselines, achieving high success rates in Table Uncover (70%) and Gap Cover (80%), while also showing promising performance on the more challenging Curtain Open task in the real-world setting. Furthermore, ReMoBot demonstrates generalization across varying robot positions, object sizes, and material types. Additional details are available at: https://sites.google.com/view/remobot/home