FlowAct: A Proactive Multimodal Human-robot Interaction System with Continuous Flow of Perception and Modular Action Sub-systems

作者: Timothée Dhaussy, Bassam Jabaian, Fabrice Lefèvre

分类: cs.RO

发布日期: 2024-08-28 (更新: 2025-09-17)

备注: Paper accepted at ICPRAM 2025

💡 一句话要点

FlowAct:一种基于连续感知流和模块化动作子系统的主动多模态人机交互系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 多模态融合 机器人 主动感知 动作规划 环境状态跟踪 模块化架构

📋 核心要点

- 现有的人机交互系统在环境感知和动作执行之间缺乏协同,难以实现自主系统的持续交互。

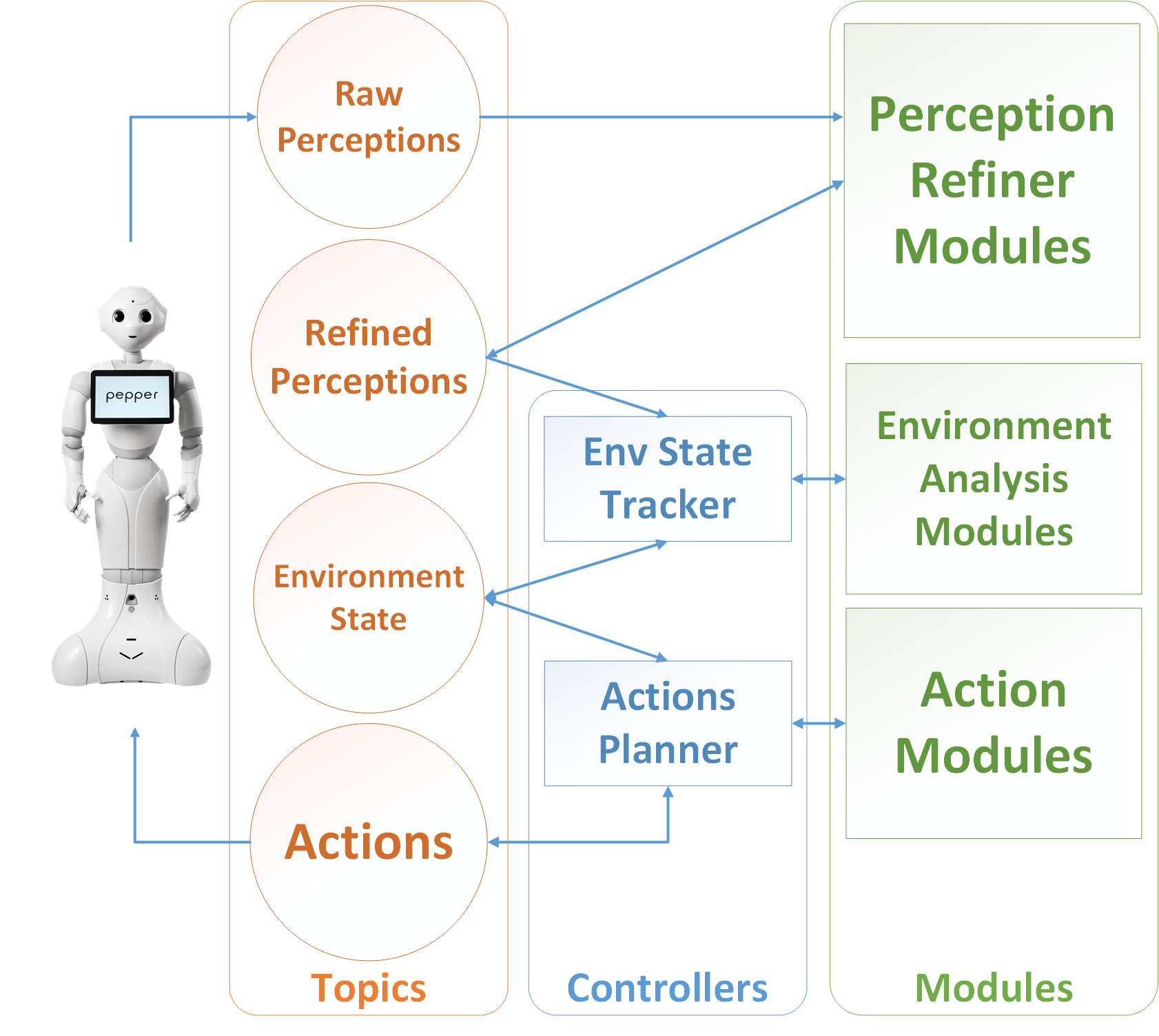

- FlowAct通过环境状态跟踪(EST)和动作规划器,构建了连续的感知流和模块化的动作子系统。

- 实验表明,FlowAct能够有效维持连续的感知-动作循环,提升了自主代理的响应性和适应性。

📝 摘要(中文)

本文提出FlowAct,一种主动多模态人机交互架构,该架构以异步无限循环的方式运行,将机器人传感器数据转化为执行器动作,并由环境状态跟踪(EST)和动作规划器两个控制器协调。EST持续收集并发布操作环境的表征,确保稳定的感知数据流。这种持久的感知流对于高级动作规划器至关重要,后者协调一系列模块化动作子系统(如运动和语音模块),并根据不断变化的环境叙事来控制它们的启动或停止。EST融合了多种感觉模态,构建了丰富的实时环境表征,并将其分发给动作规划器。动作规划器使用决策框架动态协调动作模块,使其能够主动且连贯地响应环境变化。通过一系列真实世界的实验,验证了该系统在维持连续感知-动作循环方面的有效性,从而显著提高了自主主动代理的响应性和适应性。动作子系统的模块化架构有助于轻松扩展和适应各种任务和场景。

🔬 方法详解

问题定义:现有的人机交互系统通常在感知和动作之间存在割裂,难以实现自主系统对环境变化的快速响应和持续交互。缺乏一个统一的框架来整合多模态感知信息,并根据环境变化动态调整动作策略。

核心思路:FlowAct的核心思路是构建一个连续的感知-动作循环,通过环境状态跟踪(EST)模块持续感知环境,并将感知信息传递给动作规划器。动作规划器根据环境状态动态协调模块化的动作子系统,从而实现对环境变化的快速响应和主动交互。

技术框架:FlowAct的整体架构包含两个主要模块:环境状态跟踪(EST)和动作规划器。EST负责持续收集和融合来自各种传感器(如摄像头、麦克风等)的数据,构建环境的实时表征。动作规划器接收EST提供的环境表征,并使用决策框架动态协调一系列模块化的动作子系统(如运动、语音等)。整个系统以异步无限循环的方式运行,确保感知和动作的连续性。

关键创新:FlowAct的关键创新在于其连续的感知-动作循环和模块化的动作子系统。传统的人机交互系统通常采用离散的感知和动作步骤,而FlowAct通过EST模块实现了对环境的持续感知,并通过动作规划器动态协调动作子系统,从而实现了对环境变化的快速响应和主动交互。模块化的动作子系统使得系统易于扩展和适应不同的任务和场景。

关键设计:EST模块的关键设计在于如何有效地融合来自不同传感器的数据,构建环境的实时表征。动作规划器的关键设计在于如何根据环境状态动态协调动作子系统,并确保动作的连贯性和一致性。论文中可能涉及具体的融合算法、决策框架和动作协调机制,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

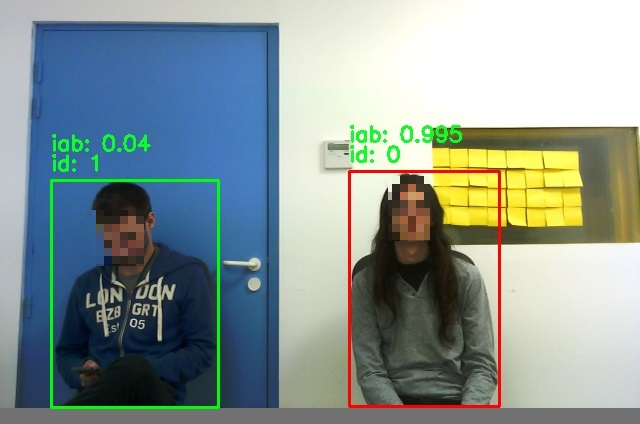

论文通过一系列真实世界的实验验证了FlowAct的有效性。实验结果表明,FlowAct能够维持连续的感知-动作循环,并显著提高自主代理的响应性和适应性。具体的性能数据、对比基线和提升幅度未知,但实验结果表明FlowAct在实际应用中具有很大的潜力。

🎯 应用场景

FlowAct适用于各种需要主动人机交互的场景,例如:服务机器人、智能家居、自动驾驶等。该系统可以帮助机器人更好地理解环境,并根据环境变化做出相应的动作,从而提高人机交互的效率和自然性。未来,FlowAct可以进一步扩展到更复杂的任务和场景,例如:医疗辅助、工业自动化等。

📄 摘要(原文)

The evolution of autonomous systems in the context of human-robot interaction systems necessitates a synergy between the continuous perception of the environment and the potential actions to navigate or interact within it. We present Flowact, a proactive multimodal human-robot interaction architecture, working as an asynchronous endless loop of robot sensors into actuators and organized by two controllers, the Environment State Tracking (EST) and the Action Planner. The EST continuously collects and publishes a representation of the operative environment, ensuring a steady flow of perceptual data. This persistent perceptual flow is pivotal for our advanced Action Planner which orchestrates a collection of modular action subsystems, such as movement and speaking modules, governing their initiation or cessation based on the evolving environmental narrative. The EST employs a fusion of diverse sensory modalities to build a rich, real-time representation of the environment that is distributed to the Action Planner. This planner uses a decision-making framework to dynamically coordinate action modules, allowing them to respond proactively and coherently to changes in the environment. Through a series of real-world experiments, we exhibit the efficacy of the system in maintaining a continuous perception-action loop, substantially enhancing the responsiveness and adaptability of autonomous pro-active agents. The modular architecture of the action subsystems facilitates easy extensibility and adaptability to a broad spectrum of tasks and scenarios.