Scaling Cross-Embodied Learning: One Policy for Manipulation, Navigation, Locomotion and Aviation

作者: Ria Doshi, Homer Walke, Oier Mees, Sudeep Dasari, Sergey Levine

分类: cs.RO, cs.LG

发布日期: 2024-08-21

备注: Project website at https://crossformer-model.github.io/

💡 一句话要点

提出CrossFormer,用于多形态机器人通用策略学习,实现操控、导航、运动和飞行控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 跨形态学习 机器人学习 Transformer 通用策略 多机器人系统

📋 核心要点

- 机器人学习面临数据稀缺问题,难以训练出泛化性强的策略,尤其是在不同机器人形态之间。

- CrossFormer通过Transformer架构,无需手动对齐,即可处理来自多种机器人形态的数据,实现通用策略学习。

- 实验表明,CrossFormer在多种机器人上表现出色,与专家策略相当,并超越了现有的跨形态学习方法。

📝 摘要(中文)

现代机器学习系统依赖于大型数据集来实现广泛的泛化,这在机器人学习中通常是一个挑战,因为每个机器人平台和任务可能只有少量数据集。通过在多种不同类型的机器人上训练单个策略,机器人学习方法可以利用更广泛和更多样化的数据集,从而带来更好的泛化和鲁棒性。然而,在多机器人数据上训练单个策略具有挑战性,因为机器人可能具有差异很大的传感器、执行器和控制频率。我们提出了CrossFormer,一种可扩展且灵活的基于Transformer的策略,可以处理来自任何形态的数据。我们在迄今为止最大且最多样化的数据集上训练了CrossFormer,该数据集包含来自20种不同机器人形态的90万条轨迹。我们证明了相同的网络权重可以控制截然不同的机器人,包括单臂和双臂操作系统、轮式机器人、四旋翼飞行器和四足机器人。与之前的工作不同,我们的模型不需要手动对齐观察或动作空间。大量的真实世界实验表明,我们的方法与为每种形态量身定制的专家策略的性能相匹配,同时显著优于先前最先进的跨形态学习方法。

🔬 方法详解

问题定义:现有机器人学习方法通常针对特定机器人和任务,难以泛化到其他机器人形态。不同机器人具有不同的传感器、执行器和控制频率,导致难以构建通用的学习策略。先前方法需要手动对齐观察和动作空间,限制了其可扩展性。

核心思路:CrossFormer的核心思路是利用Transformer架构的强大表示能力,学习一个通用的策略,该策略可以处理来自不同机器人形态的数据,而无需手动对齐。通过大规模的多样化数据集训练,CrossFormer能够学习到不同机器人之间的共性,从而实现跨形态的泛化。

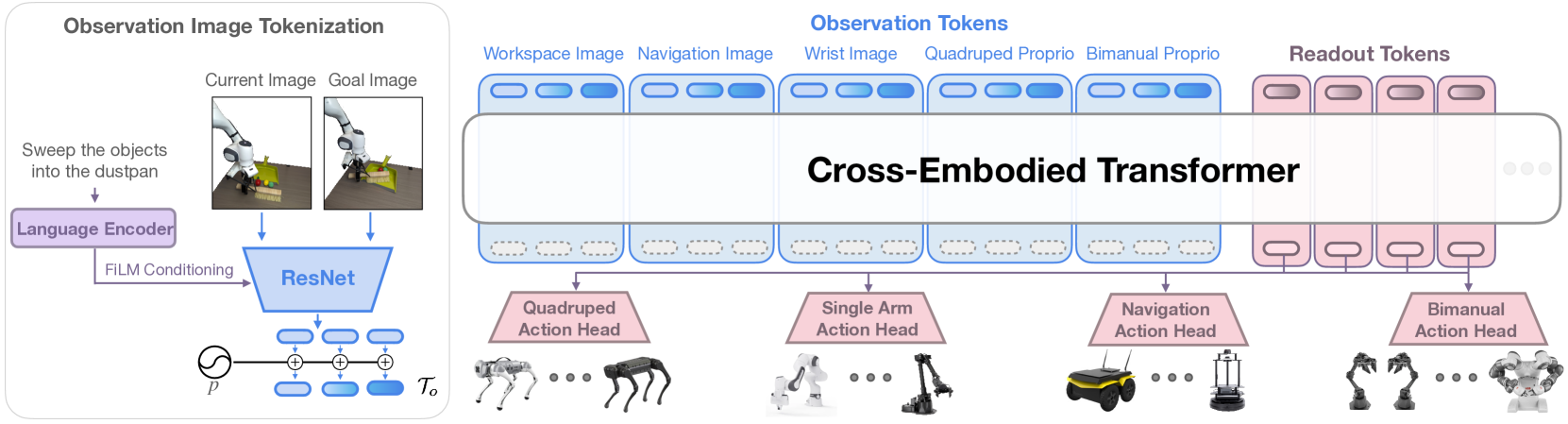

技术框架:CrossFormer采用Transformer编码器-解码器架构。编码器处理来自不同机器人的观察数据,将其编码为统一的表示。解码器根据编码后的表示生成相应的动作指令。整个框架通过端到端的方式进行训练,直接从原始观察数据到动作指令。

关键创新:CrossFormer的关键创新在于其能够处理来自不同机器人形态的数据,而无需手动对齐观察和动作空间。这得益于Transformer架构的自注意力机制,它可以自动学习不同传感器和执行器之间的关系。此外,CrossFormer还采用了大规模的多样化数据集进行训练,进一步提高了其泛化能力。

关键设计:CrossFormer使用标准的Transformer架构,包括多头自注意力机制和前馈神经网络。输入数据包括机器人的传感器读数和先前的动作指令。输出数据是机器人的动作指令。损失函数采用行为克隆损失,即最小化模型预测的动作指令与真实动作指令之间的差异。为了提高训练效率,采用了数据并行和模型并行等技术。

🖼️ 关键图片

📊 实验亮点

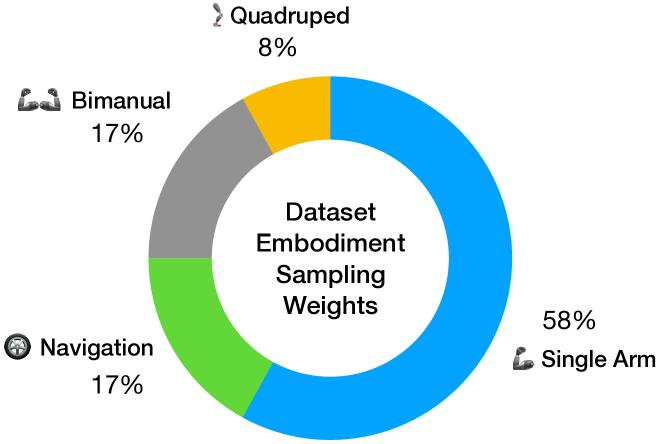

CrossFormer在包含20种不同机器人形态的90万条轨迹的大规模数据集上进行了训练。实验结果表明,CrossFormer在多种机器人上表现出色,与为每种形态量身定制的专家策略的性能相匹配。此外,CrossFormer还显著优于先前最先进的跨形态学习方法,表明其具有强大的泛化能力。

🎯 应用场景

CrossFormer具有广泛的应用前景,可用于开发通用的机器人控制系统,降低机器人开发的成本和复杂度。例如,可以利用CrossFormer训练一个策略,使其能够控制不同类型的机器人完成各种任务,如家庭服务、工业自动化和灾难救援。该研究还有助于推动机器人学习的标准化和模块化。

📄 摘要(原文)

Modern machine learning systems rely on large datasets to attain broad generalization, and this often poses a challenge in robot learning, where each robotic platform and task might have only a small dataset. By training a single policy across many different kinds of robots, a robot learning method can leverage much broader and more diverse datasets, which in turn can lead to better generalization and robustness. However, training a single policy on multi-robot data is challenging because robots can have widely varying sensors, actuators, and control frequencies. We propose CrossFormer, a scalable and flexible transformer-based policy that can consume data from any embodiment. We train CrossFormer on the largest and most diverse dataset to date, 900K trajectories across 20 different robot embodiments. We demonstrate that the same network weights can control vastly different robots, including single and dual arm manipulation systems, wheeled robots, quadcopters, and quadrupeds. Unlike prior work, our model does not require manual alignment of the observation or action spaces. Extensive experiments in the real world show that our method matches the performance of specialist policies tailored for each embodiment, while also significantly outperforming the prior state of the art in cross-embodiment learning.