Body Transformer: Leveraging Robot Embodiment for Policy Learning

作者: Carmelo Sferrazza, Dun-Ming Huang, Fangchen Liu, Jongmin Lee, Pieter Abbeel

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-08-12

💡 一句话要点

提出Body Transformer,利用机器人结构信息提升策略学习性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人学习 Transformer 策略学习 归纳偏置 机器人结构 掩码注意力 模仿学习 强化学习

📋 核心要点

- 传统Transformer在机器人学习中未能充分利用机器人自身的结构信息。

- Body Transformer (BoT) 通过将机器人身体建模为传感器和执行器的图,并使用掩码注意力机制来引入结构化的归纳偏置。

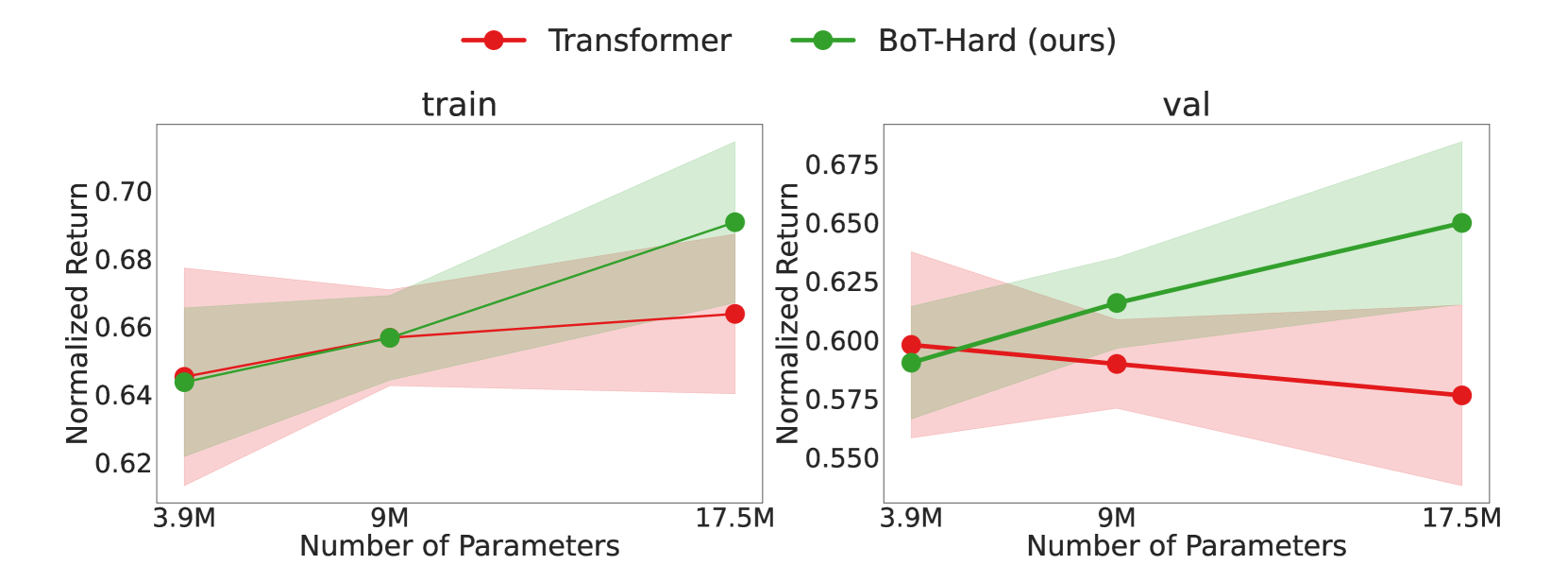

- 实验表明,BoT在任务完成度、扩展性和计算效率方面优于传统Transformer和多层感知机。

📝 摘要(中文)

近年来,Transformer架构已成为自然语言处理和计算机视觉领域机器学习算法的事实标准。尽管在机器人学习中成功部署Transformer架构已有显著证据,但我们认为,原始Transformer并未充分利用机器人学习问题的结构。因此,我们提出了Body Transformer (BoT),该架构通过提供引导学习过程的归纳偏置来利用机器人结构信息。我们将机器人身体表示为传感器和执行器的图,并依靠掩码注意力机制在整个架构中汇集信息。在表示模仿学习或强化学习策略时,所提出的架构在任务完成度、扩展性和计算效率方面均优于原始Transformer以及经典的多层感知机。开源代码和其他材料可在https://sferrazza.cc/bot_site获取。

🔬 方法详解

问题定义:论文旨在解决机器人策略学习中,如何更有效地利用机器人自身结构信息的问题。现有方法,特别是直接应用Transformer架构的方法,未能充分挖掘机器人身体的内在结构,导致学习效率和泛化能力受限。

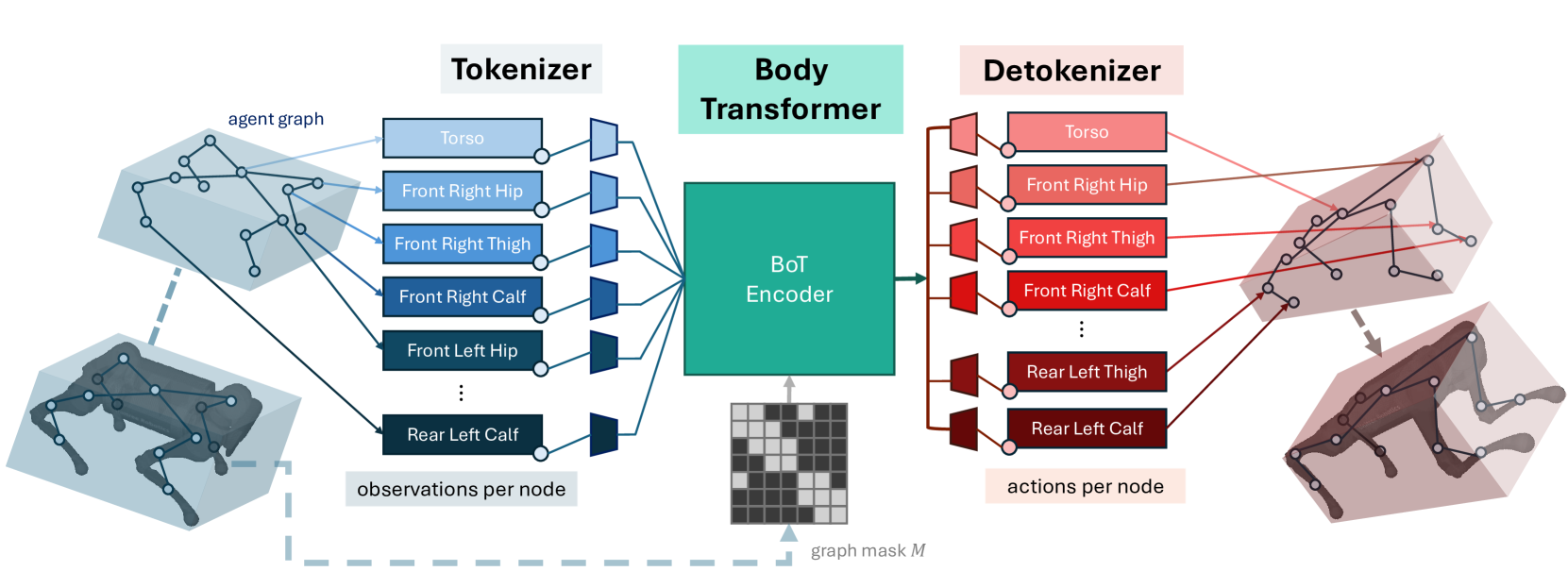

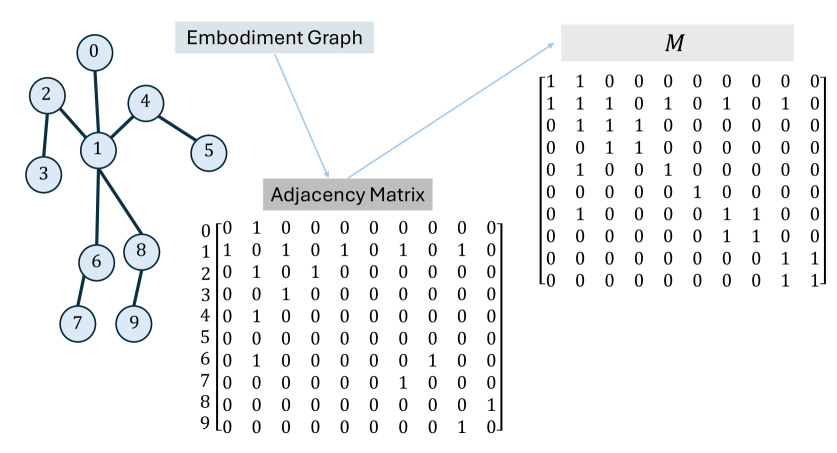

核心思路:论文的核心思路是将机器人身体建模为一个图,其中节点代表传感器和执行器,边代表它们之间的连接关系。通过这种方式,将机器人结构信息显式地编码到模型中,并利用掩码注意力机制来学习节点之间的关系,从而为策略学习提供更强的归纳偏置。

技术框架:Body Transformer (BoT) 的整体架构基于Transformer,但引入了机器人身体图的表示。首先,将机器人状态表示为节点特征,然后使用图神经网络(GNN)或类似方法对节点特征进行编码。接下来,使用掩码注意力机制来学习节点之间的关系,其中掩码矩阵根据机器人身体图的连接关系生成,以限制信息传播。最后,将学习到的节点表示输入到策略网络中,以生成动作。

关键创新:BoT的关键创新在于将机器人身体结构信息显式地融入到Transformer架构中。通过将机器人身体建模为图,并使用掩码注意力机制,BoT能够更有效地学习机器人状态之间的关系,从而提高策略学习的效率和泛化能力。与现有方法相比,BoT能够更好地利用机器人自身的结构信息,从而在复杂任务中表现出更好的性能。

关键设计:BoT的关键设计包括:1) 机器人身体图的构建方式,例如使用哪些传感器和执行器作为节点,以及如何定义节点之间的连接关系;2) 掩码矩阵的生成方式,例如使用邻接矩阵或更复杂的图结构信息;3) 策略网络的结构,例如使用多层感知机或循环神经网络。此外,损失函数的设计也至关重要,例如可以使用模仿学习损失或强化学习奖励函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Body Transformer在各种机器人控制任务中均优于传统Transformer和多层感知机。例如,在模仿学习任务中,BoT能够更快地学习到高质量的策略,并且具有更好的泛化能力。在强化学习任务中,BoT能够获得更高的奖励,并且能够更好地适应不同的环境。

🎯 应用场景

Body Transformer具有广泛的应用前景,可应用于各种机器人控制任务,例如操作、导航和运动规划。通过利用机器人自身的结构信息,BoT能够提高策略学习的效率和泛化能力,从而使机器人能够更好地适应复杂环境和完成各种任务。未来,BoT可以进一步扩展到多机器人协作和人机交互等领域。

📄 摘要(原文)

In recent years, the transformer architecture has become the de facto standard for machine learning algorithms applied to natural language processing and computer vision. Despite notable evidence of successful deployment of this architecture in the context of robot learning, we claim that vanilla transformers do not fully exploit the structure of the robot learning problem. Therefore, we propose Body Transformer (BoT), an architecture that leverages the robot embodiment by providing an inductive bias that guides the learning process. We represent the robot body as a graph of sensors and actuators, and rely on masked attention to pool information throughout the architecture. The resulting architecture outperforms the vanilla transformer, as well as the classical multilayer perceptron, in terms of task completion, scaling properties, and computational efficiency when representing either imitation or reinforcement learning policies. Additional material including the open-source code is available at https://sferrazza.cc/bot_site.