Faster Model Predictive Control via Self-Supervised Initialization Learning

作者: Zhaoxin Li, Xiaoke Wang, Letian Chen, Rohan Paleja, Subramanya Nageshrao, Matthew Gombolay

分类: cs.RO

发布日期: 2024-08-06 (更新: 2025-10-31)

💡 一句话要点

提出自监督初始化学习加速模型预测控制,提升优化速度与控制精度。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模型预测控制 强化学习 行为克隆 机器人控制 初始猜测 优化加速

📋 核心要点

- 复杂动力学和非凸成本函数导致MPC计算耗时,限制了其在实时机器人控制中的应用。

- 提出一种warm-start框架,通过学习策略生成高质量的MPC初始猜测,并使用强化学习在线微调以最小化优化时间。

- 实验表明,该方法显著加速了确定性和基于采样的MPC,并在路径跟踪、导航等任务中提升了控制性能。

📝 摘要(中文)

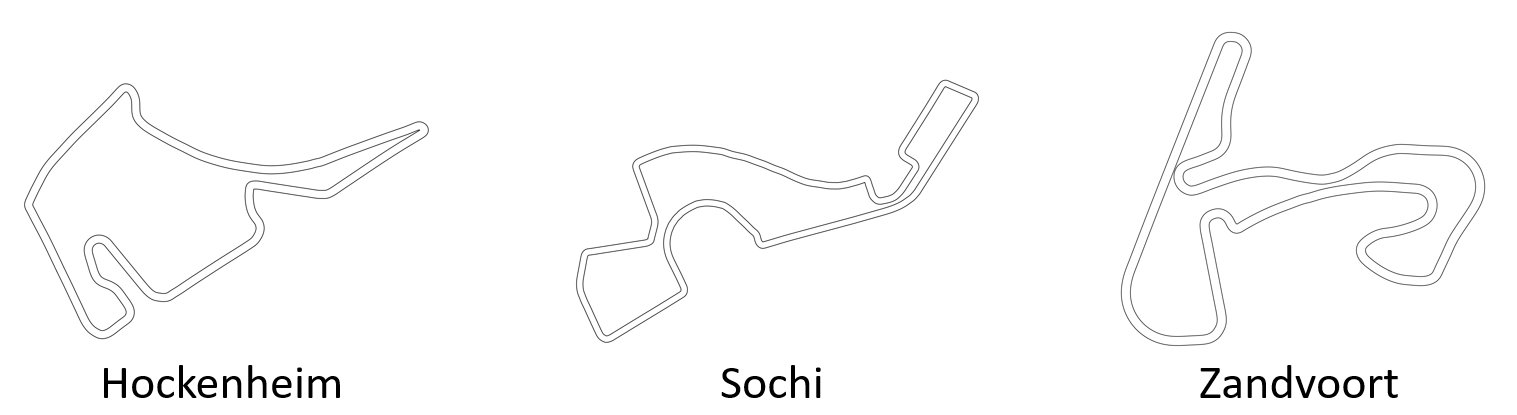

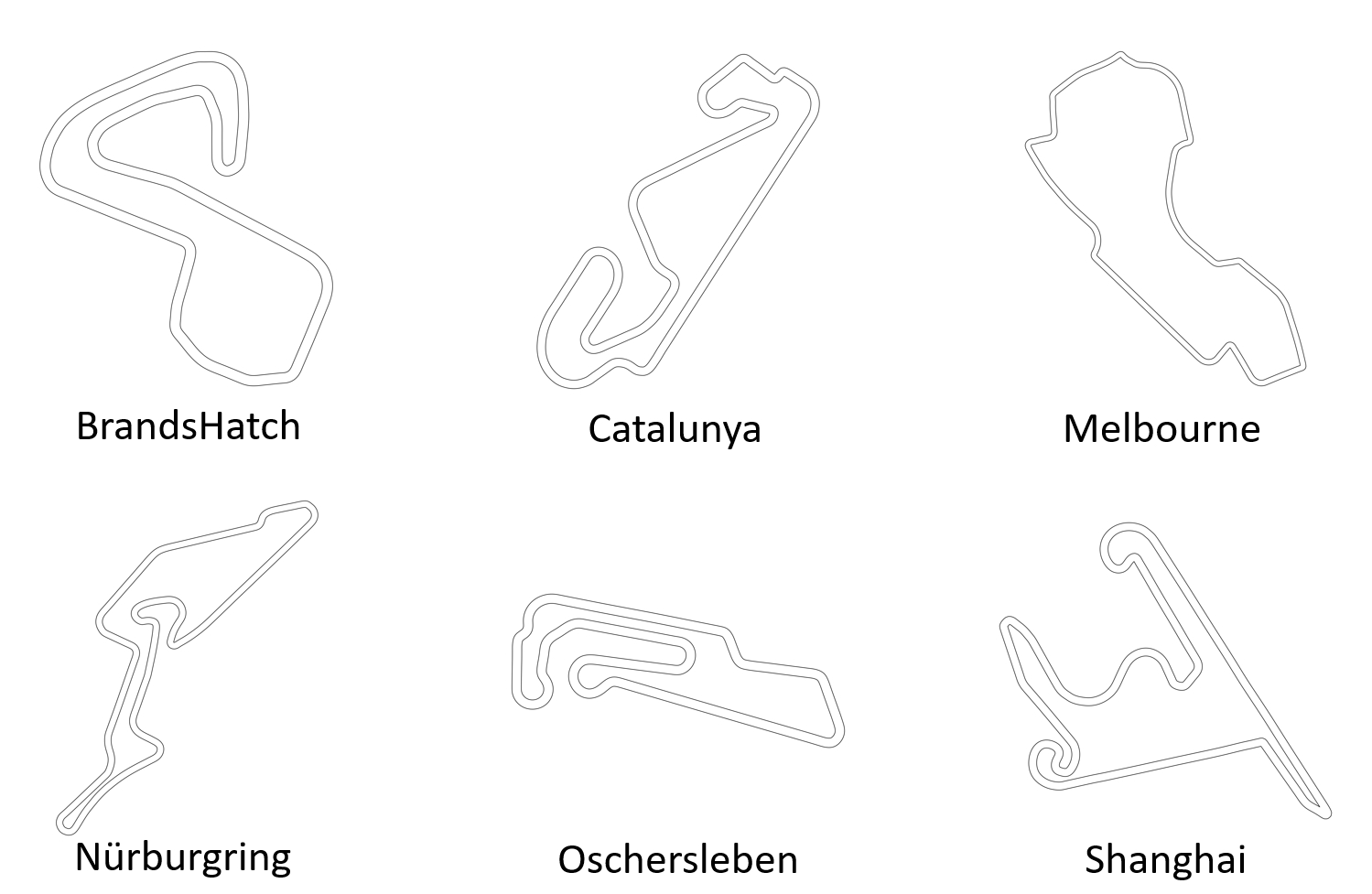

模型预测控制(MPC)通过优化有限时间范围内的控制输出来广泛应用于机器人控制。MPC的计算方法包括确定性方法(如iLQR和COBYLA)以及基于采样的方法(如MPPI和CEM)。然而,复杂的系统动力学和非凸或不可微的成本项通常导致过高的优化时间,限制了实际部署。为了加速MPC,现有方法存在局限性:(i)在状态急剧变化时,重用先前的解决方案会失效;(ii)纯粹的模仿学习不能直接针对计算效率,并且会受到训练数据次优性的影响。为了解决这些问题,我们提出了一个warm-start框架,该框架学习一种策略,为MPC求解器生成高质量的初始猜测。该策略首先通过专家MPC rollouts的行为克隆进行训练,然后通过强化学习在线进行微调,以直接最小化MPC优化时间。实验验证表明,我们的方法改进了确定性和基于采样的MPC方法,在Formula 1赛道路径跟踪领域,确定性MPC的优化速度提高了21.6%,跟踪精度提高了34.1%;在障碍丰富的导航领域,基于采样的MPC的安全性提高了100%,路径效率提高了12.8%,转向平滑度提高了7.2%。这些结果表明,我们的框架不仅加速了MPC,而且提高了整体控制性能。此外,它可以应用于更广泛的控制算法,这些算法可以从良好的初始猜测中受益。

🔬 方法详解

问题定义:论文旨在解决模型预测控制(MPC)在复杂系统和非凸优化问题中计算耗时的问题。现有方法,如重用先前解在状态突变时失效,模仿学习无法直接优化计算效率,导致MPC难以在实时性要求高的场景中应用。

核心思路:论文的核心思路是利用学习到的策略为MPC提供一个高质量的初始猜测(warm-start)。通过学习一个策略网络,该网络能够根据当前状态快速生成一个较好的控制序列,从而减少MPC求解器所需的迭代次数和计算时间。这种方法结合了模仿学习和强化学习的优点,既能利用专家轨迹的先验知识,又能通过在线微调来优化计算效率。

技术框架:整体框架包含两个主要阶段:1) 策略网络预训练阶段:使用行为克隆(Behavior Cloning)从专家MPC rollouts中学习一个初始策略。专家数据由运行耗时但性能优越的MPC生成。2) 策略网络在线微调阶段:使用强化学习(Reinforcement Learning)对预训练的策略进行微调,目标是直接最小化MPC的优化时间。该阶段使用实际环境或仿真环境进行训练。MPC求解器在每次迭代时都使用策略网络生成的初始猜测。

关键创新:该方法最重要的创新点在于将策略学习与MPC优化过程紧密结合,通过强化学习直接优化MPC的计算效率。与传统的模仿学习方法不同,该方法的目标不是简单地模仿专家策略,而是生成能够加速MPC求解过程的初始猜测。此外,该方法可以同时提升MPC的控制性能,例如跟踪精度和安全性。

关键设计:策略网络可以使用各种神经网络结构,例如多层感知机(MLP)或循环神经网络(RNN)。损失函数包括行为克隆损失(用于预训练)和强化学习奖励函数(用于在线微调)。强化学习奖励函数的设计至关重要,需要能够反映MPC的优化时间和控制性能。例如,可以使用负的优化时间作为奖励,并结合跟踪误差、安全性等指标。参数设置方面,需要仔细调整学习率、折扣因子等超参数,以保证训练的稳定性和收敛性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在Formula 1赛道路径跟踪任务中,使确定性MPC的优化速度提高了21.6%,跟踪精度提高了34.1%。在障碍丰富的导航任务中,基于采样的MPC的安全性提高了100%,路径效率提高了12.8%,转向平滑度提高了7.2%。这些结果验证了该方法在加速MPC和提升控制性能方面的有效性。

🎯 应用场景

该研究成果可广泛应用于机器人控制领域,尤其适用于需要实时性和高精度的场景,如自动驾驶、无人机控制、机器人操作等。通过加速MPC的计算过程,可以使机器人能够更快地响应环境变化,提高控制性能和安全性。此外,该方法还可以推广到其他需要良好初始猜测的优化算法中。

📄 摘要(原文)

Model Predictive Control (MPC) is widely used in robot control by optimizing a sequence of control outputs over a finite-horizon. Computational approaches for MPC include deterministic methods (e.g., iLQR and COBYLA), as well as sampling-based methods (e.g., MPPI and CEM). However, complex system dynamics and non-convex or non-differentiable cost terms often lead to prohibitive optimization times that limit real-world deployment. Prior efforts to accelerate MPC have limitations on: (i) reusing previous solutions fails under sharp state changes and (ii) pure imitation learning does not target compute efficiency directly and suffers from suboptimality in the training data. To address these, We propose a warm-start framework that learns a policy to generate high-quality initial guesses for MPC solver. The policy is first trained via behavior cloning from expert MPC rollouts and then fine-tuned online with reinforcement learning to directly minimize MPC optimization time. We empirically validate that our approach improves both deterministic and sampling-based MPC methods, achieving up to 21.6% faster optimization and 34.1% more tracking accuracy for deterministic MPC in Formula 1 track path-tracking domain, and improving safety by 100%, path efficiency by 12.8%, and steering smoothness by 7.2% for sampling-based MPC in obstacle-rich navigation domain. These results demonstrate that our framework not only accelerates MPC but also improves overall control performance. Furthermore, it can be applied to a broader range of control algorithms that benefit from good initial guesses.