ReplanVLM: Replanning Robotic Tasks with Visual Language Models

作者: Aoran Mei, Guo-Niu Zhu, Huaxiang Zhang, Zhongxue Gan

分类: cs.RO

发布日期: 2024-07-31

💡 一句话要点

ReplanVLM:利用视觉语言模型进行机器人任务重规划,提升容错性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人任务规划 视觉语言模型 任务重规划 错误纠正 开放世界 自主导航 人工智能

📋 核心要点

- 现有大型语言模型在机器人任务规划中缺乏视觉感知能力,难以准确理解当前世界状态。

- ReplanVLM框架通过集成视觉语言模型,并设计内部和外部纠错机制,实现任务的动态重规划。

- 实验表明,ReplanVLM在真实机器人和仿真环境中均表现出更高的任务成功率和鲁棒的纠错能力。

📝 摘要(中文)

大型语言模型(LLM)在机器人任务规划中因其卓越的文本分析和生成能力以及广泛的世界知识而日益普及。然而,它们在解码视觉线索方面存在不足,对世界的直接感知有限,导致对当前世界状态的理解不足。相比之下,视觉语言模型(VLM)通过集成视觉感知模块填补了这一空白,从而增强了机器人任务规划的自主性。尽管取得了这些进步,VLM仍然面临挑战,例如即使在提供准确指令的情况下也可能出现任务执行错误。为了解决这些问题,本文提出了一种用于机器人任务规划的ReplanVLM框架。本研究侧重于纠错干预,提出了内部纠错机制和外部纠错机制,以纠正相应阶段的错误。开发了一种重规划策略,用于在任务执行失败时重新规划任务或纠正错误代码。在真实机器人和仿真环境中的实验结果表明,所提出的框架具有优越性,在开放世界任务中具有更高的成功率和强大的纠错能力。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)在机器人任务规划中,虽然具备强大的文本理解和生成能力,但缺乏直接的视觉感知能力,无法准确理解环境状态,导致任务执行过程中容易出错。即使提供了准确的指令,仍然可能因为环境变化或模型理解偏差而导致任务失败。现有方法缺乏有效的纠错和重规划机制,难以应对复杂和动态的开放世界任务。

核心思路:ReplanVLM的核心思路是利用视觉语言模型(VLM)弥补LLM在视觉感知方面的不足,通过VLM直接感知环境状态,并结合内部和外部纠错机制,在任务执行过程中动态地检测和纠正错误,并根据需要重新规划任务。这种方法旨在提高机器人任务规划的鲁棒性和适应性。

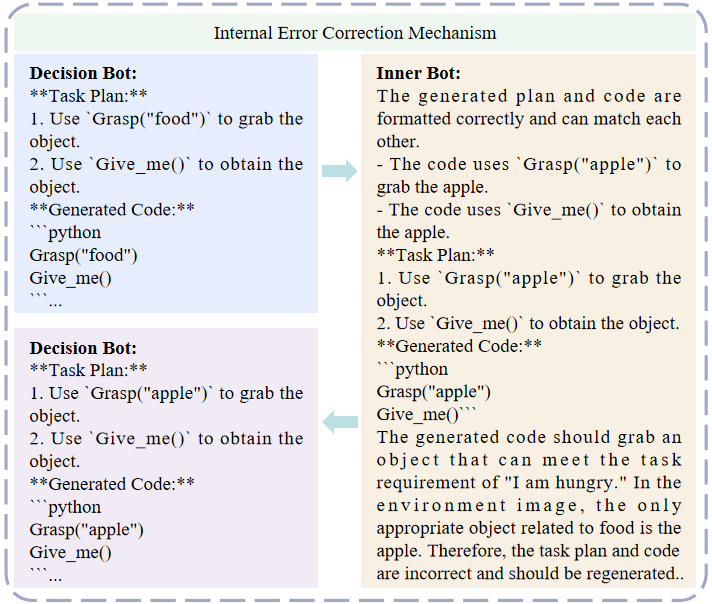

技术框架:ReplanVLM框架包含以下主要模块:1) VLM感知模块:用于从视觉输入中提取环境信息。2) 任务规划模块:基于VLM的感知结果和用户指令生成初始任务计划。3) 内部纠错机制:在任务执行过程中,监控执行状态,检测潜在错误,并尝试通过内部调整进行纠正。4) 外部纠错机制:当内部纠错失败时,利用VLM重新评估环境状态,并生成新的任务计划或纠正错误代码。5) 任务执行模块:执行任务计划,并与纠错机制进行交互。

关键创新:ReplanVLM的关键创新在于集成了视觉感知和纠错机制,实现了机器人任务的动态重规划。与传统的基于LLM的任务规划方法相比,ReplanVLM能够更好地理解环境状态,并在任务执行过程中及时纠正错误,从而提高了任务的成功率和鲁棒性。内部和外部纠错机制的设计,使得系统能够根据错误的严重程度选择不同的纠错策略。

关键设计:具体的VLM模型选择未知,但需要具备强大的视觉理解和推理能力。内部纠错机制的具体实现方式未知,可能包括基于规则的调整或基于模型的预测。外部纠错机制需要设计合适的提示工程,引导VLM生成新的任务计划或纠正错误代码。重规划策略需要考虑任务的整体目标和当前状态,避免陷入局部最优。

🖼️ 关键图片

📊 实验亮点

论文在真实机器人和仿真环境中进行了实验,验证了ReplanVLM框架的有效性。实验结果表明,与传统的基于LLM的任务规划方法相比,ReplanVLM能够显著提高任务的成功率和鲁棒性。具体的性能数据未知,但强调了在开放世界任务中具有更强的纠错能力。

🎯 应用场景

ReplanVLM框架可应用于各种需要机器人自主完成任务的场景,例如智能家居、仓储物流、医疗辅助、灾难救援等。通过提升机器人的任务执行成功率和鲁棒性,可以降低人工干预的需求,提高工作效率,并扩展机器人的应用范围。未来,该技术有望应用于更复杂的开放世界任务,例如自动驾驶、智能制造等。

📄 摘要(原文)

Large language models (LLMs) have gained increasing popularity in robotic task planning due to their exceptional abilities in text analytics and generation, as well as their broad knowledge of the world. However, they fall short in decoding visual cues. LLMs have limited direct perception of the world, which leads to a deficient grasp of the current state of the world. By contrast, the emergence of visual language models (VLMs) fills this gap by integrating visual perception modules, which can enhance the autonomy of robotic task planning. Despite these advancements, VLMs still face challenges, such as the potential for task execution errors, even when provided with accurate instructions. To address such issues, this paper proposes a ReplanVLM framework for robotic task planning. In this study, we focus on error correction interventions. An internal error correction mechanism and an external error correction mechanism are presented to correct errors under corresponding phases. A replan strategy is developed to replan tasks or correct error codes when task execution fails. Experimental results on real robots and in simulation environments have demonstrated the superiority of the proposed framework, with higher success rates and robust error correction capabilities in open-world tasks. Videos of our experiments are available at https://youtu.be/NPk2pWKazJc.