SuperVINS: A Real-Time Visual-Inertial SLAM Framework for Challenging Imaging Conditions

作者: Hongkun Luo, Yang Liu, Chi Guo, Zengke Li, Weiwei Song

分类: cs.RO

发布日期: 2024-07-31 (更新: 2024-11-03)

💡 一句话要点

SuperVINS:面向复杂光照环境的实时视觉惯性SLAM框架

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 视觉惯性SLAM 深度学习 特征提取 特征匹配 鲁棒性 复杂光照 运动模糊

📋 核心要点

- 传统VINS在低光照、运动模糊等场景下鲁棒性不足,易丢失轨迹,限制了其应用。

- SuperVINS利用深度学习提取图像隐式信息,增强特征提取和匹配,提升系统在复杂环境下的鲁棒性。

- 实验表明,SuperVINS在EuRoC数据集上,精度和鲁棒性与现有VINS系统相当,并已开源。

📝 摘要(中文)

传统的视觉惯性SLAM系统在低光照或运动模糊条件下通常难以保持稳定,导致轨迹跟踪丢失。SLAM系统长期稳定的定位能力需要高精度和鲁棒性。为了提高视觉惯性SLAM的鲁棒性和精度,本文提出了SuperVINS,一个为应对复杂成像条件而设计的实时视觉惯性SLAM框架。与几何建模不同,深度学习特征能够充分利用图像中蕴含的隐式信息,而这些信息通常无法被几何特征捕获。因此,SuperVINS作为VINS-Fusion的增强版本,集成了深度学习神经网络模型SuperPoint用于特征点提取和回环检测。同时,在前端特征匹配中集成了深度学习神经网络LightGlue模型。提出了一种基于RANSAC算法的特征匹配增强策略。该系统允许为各种环境设置不同的掩码和RANSAC阈值,从而平衡计算成本和定位精度。此外,它还允许灵活训练特定的SuperPoint词袋,专门用于特定环境中的回环检测。该系统能够实现实时定位和建图。在著名的EuRoC数据集上的实验验证表明,SuperVINS在最具挑战性的序列中,其精度和鲁棒性与其他视觉惯性SLAM系统相当。本文分析了SuperVINS在精度、实时性和鲁棒性方面的优势。为了促进该领域的知识交流,我们已公开发布了本文的代码。

🔬 方法详解

问题定义:传统视觉惯性SLAM系统在光照条件差或存在运动模糊时,特征提取和匹配的准确性会显著下降,导致定位精度降低甚至跟踪失败。现有方法依赖手工设计的几何特征,难以充分利用图像中的上下文信息,对环境变化适应性较差。

核心思路:SuperVINS的核心思路是利用深度学习强大的特征提取能力,替代或增强传统几何特征,从而提高系统在复杂光照和运动条件下的鲁棒性。通过引入SuperPoint和LightGlue等深度学习模型,系统能够提取更具判别性的特征,并实现更准确的特征匹配。

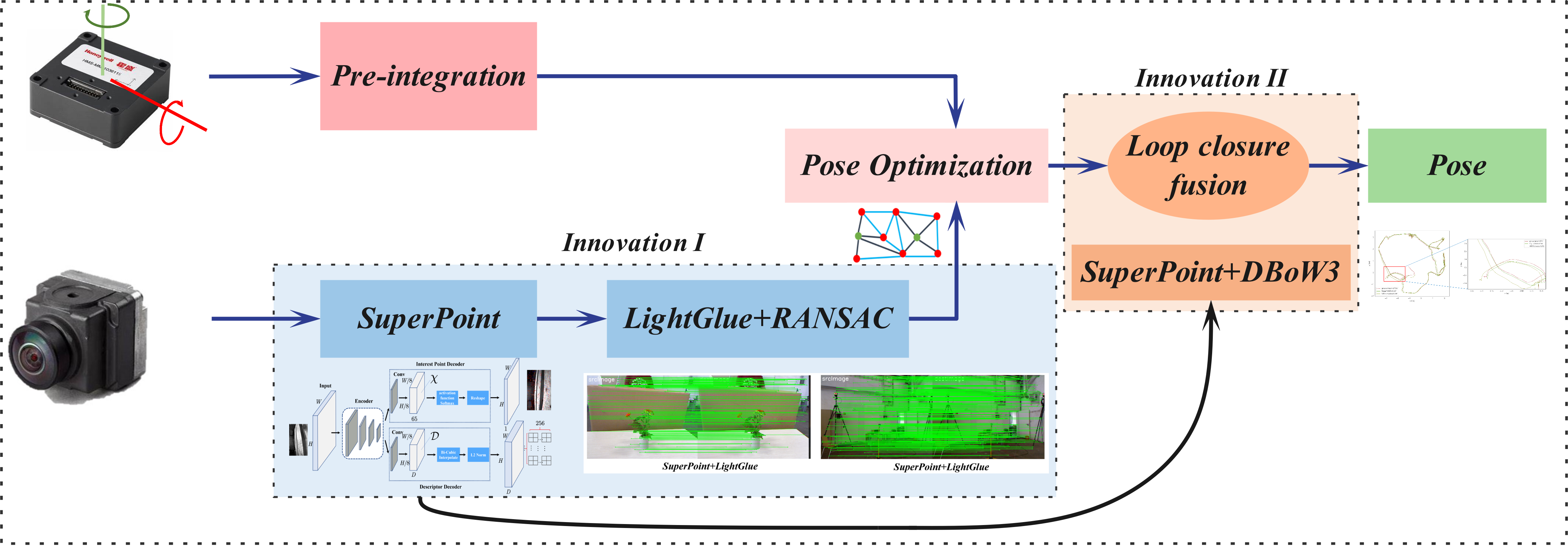

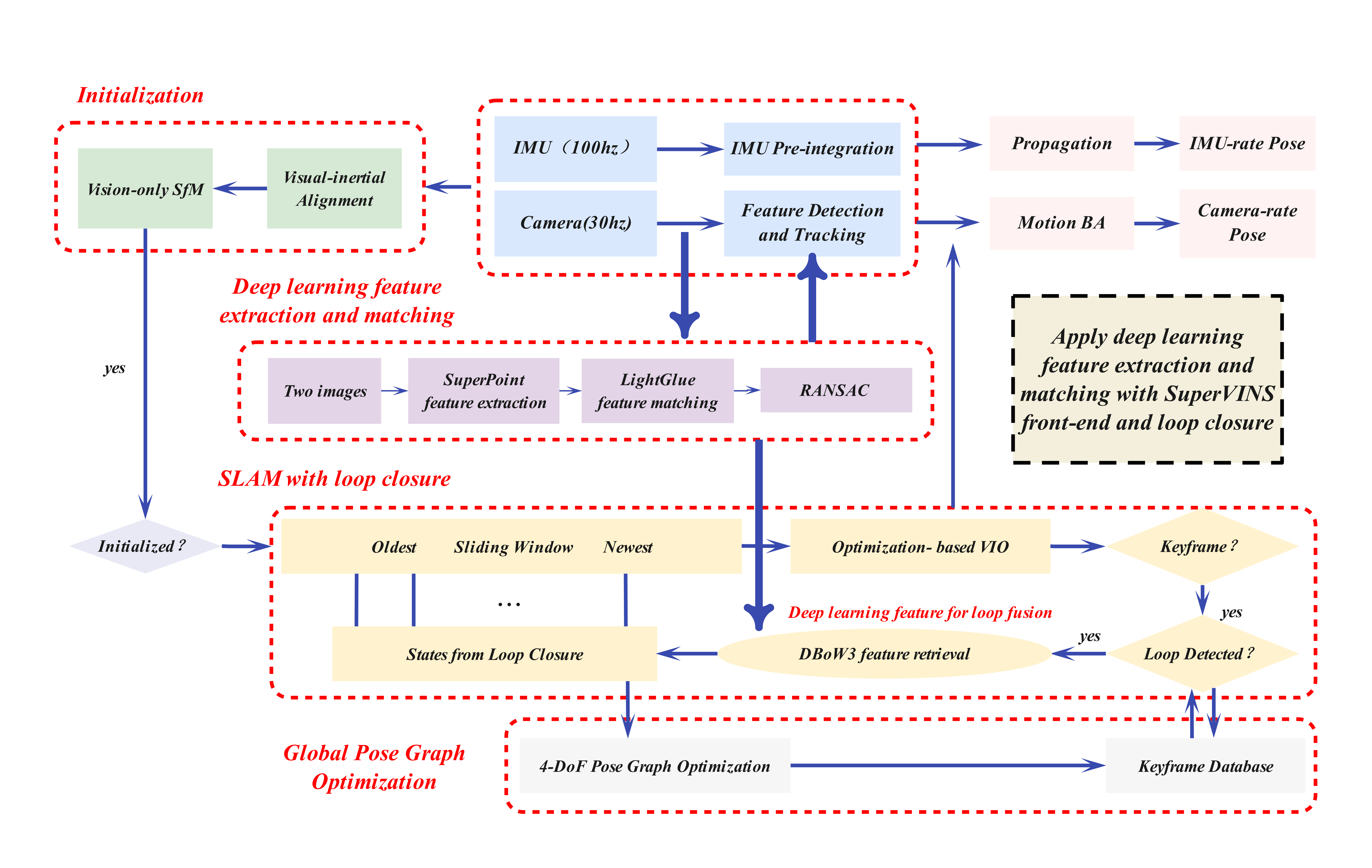

技术框架:SuperVINS基于VINS-Fusion框架,主要包含以下模块:1) 预处理:图像去畸变等;2) 特征提取:使用SuperPoint提取特征点;3) 特征匹配:使用LightGlue进行特征匹配;4) RANSAC优化:使用RANSAC算法剔除错误匹配;5) 视觉惯性里程计(VIO):融合视觉和IMU数据进行状态估计;6) 回环检测:使用SuperPoint词袋模型进行回环检测和优化。

关键创新:SuperVINS的关键创新在于将深度学习特征提取和匹配引入到视觉惯性SLAM系统中,并针对复杂环境设计了特征匹配增强策略。具体来说,使用SuperPoint提取对光照和运动模糊更鲁棒的特征,使用LightGlue进行更准确的特征匹配,并结合RANSAC算法进一步剔除错误匹配。此外,系统还允许针对特定环境训练SuperPoint词袋模型,以提高回环检测的准确性。

关键设计:SuperVINS的关键设计包括:1) SuperPoint和LightGlue模型的选择和集成;2) 基于RANSAC的特征匹配增强策略,允许为不同环境设置不同的掩码和RANSAC阈值,以平衡计算成本和定位精度;3) 针对特定环境训练SuperPoint词袋模型,以提高回环检测的准确性。具体参数设置和损失函数等细节未在摘要中详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

SuperVINS在EuRoC数据集上进行了实验验证,结果表明其在最具挑战性的序列中,精度和鲁棒性与其他视觉惯性SLAM系统相当。具体性能数据和对比基线未在摘要中给出,属于未知信息。论文强调了SuperVINS在精度、实时性和鲁棒性方面的优势。

🎯 应用场景

SuperVINS适用于光照条件复杂、运动剧烈的场景,如无人机低空飞行、机器人夜间导航、增强现实等。该研究成果有助于提升SLAM系统在恶劣环境下的稳定性和可靠性,为相关应用提供更可靠的定位和建图能力,具有重要的实际应用价值。

📄 摘要(原文)

The traditional visual-inertial SLAM system often struggles with stability under low-light or motion-blur conditions, leading to potential lost of trajectory tracking. High accuracy and robustness are essential for the long-term and stable localization capabilities of SLAM systems. Addressing the challenges of enhancing robustness and accuracy in visual-inertial SLAM, this paper propose SuperVINS, a real-time visual-inertial SLAM framework designed for challenging imaging conditions. In contrast to geometric modeling, deep learning features are capable of fully leveraging the implicit information present in images, which is often not captured by geometric features. Therefore, SuperVINS, developed as an enhancement of VINS-Fusion, integrates the deep learning neural network model SuperPoint for feature point extraction and loop closure detection. At the same time, a deep learning neural network LightGlue model for associating feature points is integrated in front-end feature matching. A feature matching enhancement strategy based on the RANSAC algorithm is proposed. The system is allowed to set different masks and RANSAC thresholds for various environments, thereby balancing computational cost and localization accuracy. Additionally, it allows for flexible training of specific SuperPoint bag of words tailored for loop closure detection in particular environments. The system enables real-time localization and mapping. Experimental validation on the well-known EuRoC dataset demonstrates that SuperVINS is comparable to other visual-inertial SLAM system in accuracy and robustness across the most challenging sequences. This paper analyzes the advantages of SuperVINS in terms of accuracy, real-time performance, and robustness. To facilitate knowledge exchange within the field, we have made the code for this paper publicly available.