DEF-oriCORN: efficient 3D scene understanding for robust language-directed manipulation without demonstrations

作者: Dongwon Son, Sanghyeon Son, Jaehyung Kim, Beomjoon Kim

分类: cs.RO, cs.AI, cs.CV

发布日期: 2024-07-31

💡 一句话要点

DEF-oriCORN:无需演示,实现高效鲁棒的语言引导三维场景理解操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 语言引导操作 三维场景理解 扩散模型 可微欧拉特征 机器人操作

📋 核心要点

- 现有方法在复杂场景中,难以实现高效的语言引导操作,尤其是在遮挡严重和缺乏演示的情况下。

- DEF-oriCORN利用基于对象的场景表示和扩散模型进行状态估计,从而实现高效的碰撞检测和语言对齐。

- 该框架在稀疏RGB图像下表现出色,并在真实世界场景中实现了零样本泛化,超越了现有技术水平。

📝 摘要(中文)

本文提出DEF-oriCORN,一个用于语言引导操作任务的框架。通过利用一种新颖的基于对象的场景表示和基于扩散模型的姿态估计算法,我们的框架能够在稀疏相机视角和紧密堆叠的环境中,高效且鲁棒地规划响应口头命令的操作,且无需任何演示。与传统表示相比,我们的表示能够实现高效的碰撞检测和语言对齐。与最先进的基线相比,我们的框架在稀疏RGB图像下实现了卓越的估计和运动规划性能,并且零样本泛化到具有各种材料(包括透明和反射物体)的真实世界场景,尽管它完全在模拟中训练。

🔬 方法详解

问题定义:论文旨在解决在复杂、拥挤的3D场景中,如何仅通过语言指令,在没有人工演示的情况下,实现机器人对物体的精确操作。现有方法在处理遮挡、透明/反射物体以及缺乏训练数据的情况下表现不佳,且计算效率较低。

核心思路:核心在于提出一种新的场景表示方法,即基于可微欧拉特征(DEF)的对象表示,并结合扩散模型进行状态估计。这种表示方法能够高效地进行碰撞检测和语言 grounding,同时扩散模型能够处理不确定性和噪声,从而提高鲁棒性。

技术框架:DEF-oriCORN框架主要包含以下几个模块:1) 场景感知模块:利用RGB图像提取场景信息,并将其转换为基于DEF的对象表示。2) 状态估计模块:使用扩散模型对场景中物体的姿态进行估计,该模型以语言指令和场景表示作为输入。3) 运动规划模块:根据估计的物体姿态和语言指令,生成机器人的运动轨迹,实现对目标物体的操作。

关键创新:主要创新点在于:1) 提出了一种新的基于可微欧拉特征(DEF)的对象表示方法,该方法能够高效地进行碰撞检测和语言 grounding。2) 将扩散模型应用于三维场景理解和状态估计,提高了对不确定性和噪声的鲁棒性。3) 实现了在没有人工演示的情况下,仅通过语言指令进行机器人操作。

关键设计:DEF表示的关键在于使用可微的欧拉特征来描述物体的几何形状,这使得碰撞检测和梯度计算更加高效。扩散模型采用条件扩散过程,以语言指令和场景表示作为条件,逐步优化物体姿态的估计。损失函数包括姿态估计损失、碰撞损失和语言对齐损失,以确保估计的准确性和操作的安全性。

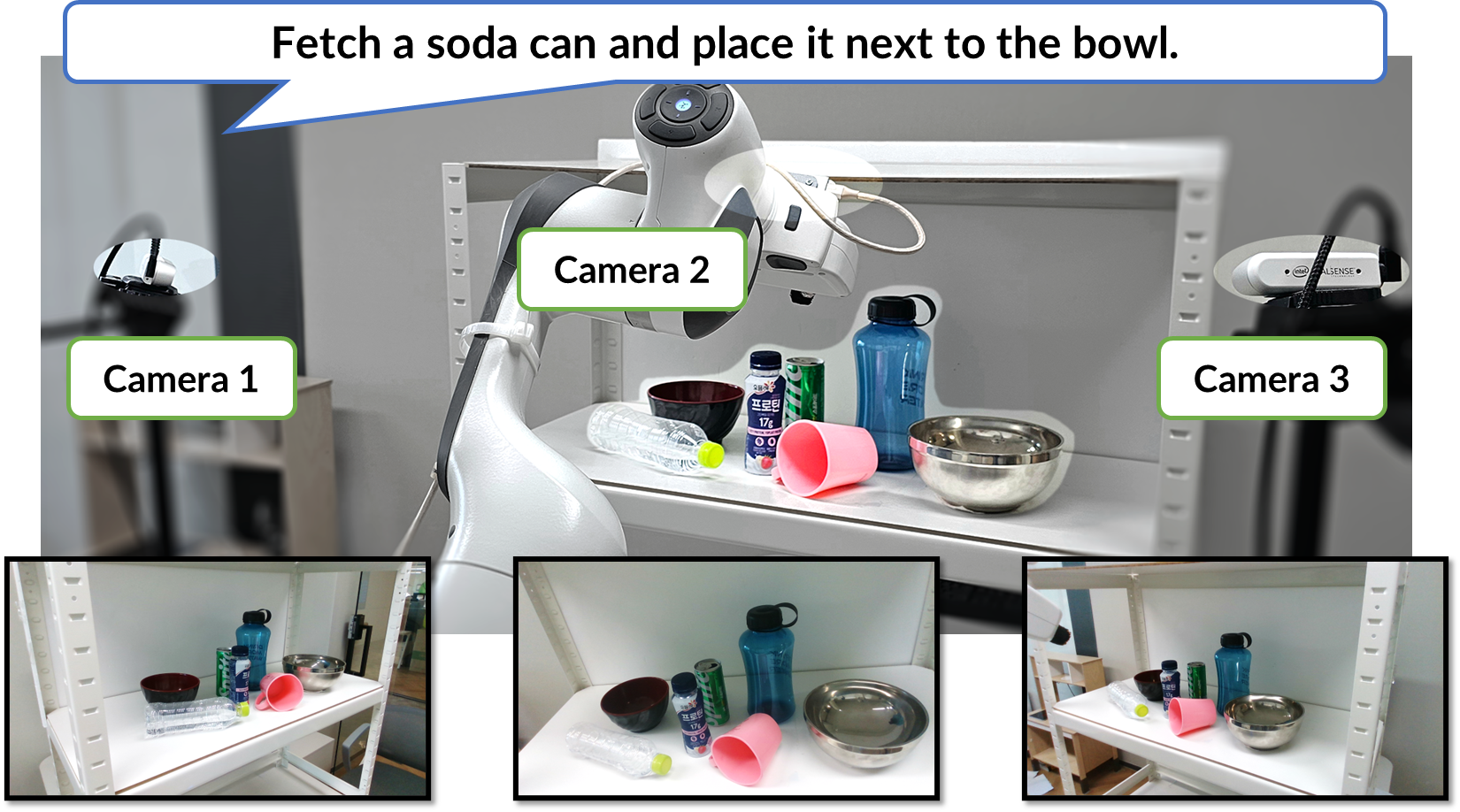

🖼️ 关键图片

📊 实验亮点

DEF-oriCORN在模拟环境中进行了大量实验,结果表明,该框架在姿态估计和运动规划方面均优于现有基线方法。更重要的是,该框架在真实世界场景中实现了零样本泛化,即使面对透明和反射物体,也能成功完成操作任务。这表明该框架具有很强的鲁棒性和泛化能力。

🎯 应用场景

该研究成果可应用于智能家居、工业自动化、医疗机器人等领域。例如,在智能家居中,机器人可以根据用户的语音指令,完成物品的整理、清洁等任务。在工业自动化中,机器人可以根据生产指令,完成零件的装配、搬运等任务。该技术有望提升机器人的智能化水平,使其能够更好地服务于人类。

📄 摘要(原文)

We present DEF-oriCORN, a framework for language-directed manipulation tasks. By leveraging a novel object-based scene representation and diffusion-model-based state estimation algorithm, our framework enables efficient and robust manipulation planning in response to verbal commands, even in tightly packed environments with sparse camera views without any demonstrations. Unlike traditional representations, our representation affords efficient collision checking and language grounding. Compared to state-of-the-art baselines, our framework achieves superior estimation and motion planning performance from sparse RGB images and zero-shot generalizes to real-world scenarios with diverse materials, including transparent and reflective objects, despite being trained exclusively in simulation. Our code for data generation, training, inference, and pre-trained weights are publicly available at: https://sites.google.com/view/def-oricorn/home.