Radiance Fields for Robotic Teleoperation

作者: Maximum Wilder-Smith, Vaishakh Patil, Marco Hutter

分类: cs.RO

发布日期: 2024-07-29 (更新: 2025-05-16)

备注: 8 pages, 10 figures, Accepted to IROS 2024

💡 一句话要点

提出基于辐射场的机器人遥操作方法,实现高机动性与逼真视觉效果

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 机器人遥操作 辐射场 神经辐射场 NeRF 3D高斯溅射 在线学习 虚拟现实

📋 核心要点

- 传统机器人遥操作方法在高保真和高机动性之间存在权衡,直接相机遥操作保真度高但机动性差,重建方法则相反。

- 该论文提出使用在线训练的辐射场来替代传统重建-可视化组件,旨在实现高机动性和照片级真实感的可视化效果。

- 通过多种机器人配置的实验和用户研究,验证了该方法在不同辐射场方法和机器人上的有效性,并与网格重建基线进行了定量比较。

📝 摘要(中文)

辐射场方法,如神经辐射场(NeRFs)或3D高斯溅射(3DGS),彻底改变了图形学和新视角合成领域。它们能够以照片般逼真的质量合成新的视角,并捕获复杂的体积和镜面场景,使其成为机器人遥操作设置的理想可视化方案。直接相机遥操作虽然提供了高保真度的操作,但牺牲了机动性;而基于重建的方法虽然提供了可控的场景,但保真度较低。鉴于此,我们提出用在线辐射场取代机器人遥操作管道中传统的重建-可视化组件,从而提供具有照片般逼真质量的高度机动场景。因此,本文对现有技术做出了三个主要贡献:(1)使用来自多个摄像头的实时数据在线训练辐射场;(2)支持各种辐射场方法,包括NeRF和3DGS;(3)用于这些方法的可视化套件,包括虚拟现实场景。为了与现有设置无缝集成,这些组件已在多种配置的多个机器人上进行了测试,并使用传统工具以及VR头显进行了显示。对不同方法和机器人的结果与网格重建的基线进行了定量比较,并进行了一项用户研究,以比较不同的可视化方法。视频和代码请访问https://rffr.leggedrobotics.com/works/teleoperation/。

🔬 方法详解

问题定义:机器人遥操作需要高质量、高机动性的场景可视化。现有方法要么依赖直接相机视角,限制了操作的灵活性;要么通过三维重建生成场景,但重建质量难以保证,影响操作的沉浸感和精确性。因此,如何在保证场景逼真度的同时,提供灵活的视角控制,是本研究要解决的核心问题。

核心思路:利用辐射场(Radiance Fields)技术,特别是NeRF和3DGS,能够从多视角图像中学习场景的连续表示,并合成任意视角的逼真图像。通过在线训练辐射场,可以实时更新场景模型,从而适应动态环境变化,并提供高度可控的虚拟视角。

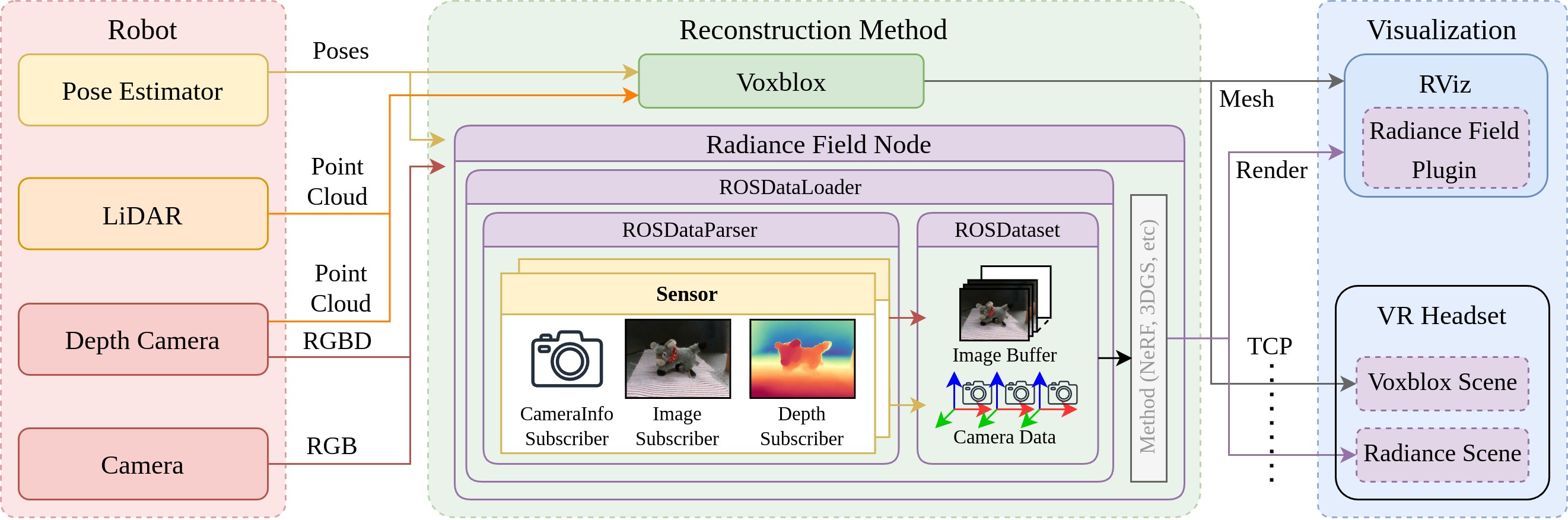

技术框架:该方法的核心在于将传统的机器人遥操作流程中的重建和可视化模块替换为在线训练的辐射场。整个流程包括:1. 多相机数据采集:使用多个相机实时获取场景图像。2. 辐射场在线训练:利用采集到的图像数据,在线训练辐射场模型(NeRF或3DGS)。3. 虚拟视角渲染:根据操作者的视角控制,渲染出逼真的虚拟场景。4. 可视化呈现:将渲染结果通过传统显示器或VR头显呈现给操作者。

关键创新:该方法的主要创新在于将辐射场技术引入机器人遥操作领域,并实现了辐射场的在线训练。这使得系统能够实时适应环境变化,并提供高质量、高机动性的场景可视化。此外,该方法还支持多种辐射场方法(NeRF和3DGS),并提供了一套完整的可视化工具。

关键设计:为了实现辐射场的在线训练,需要考虑计算效率和内存占用。论文可能采用了优化策略,例如:1. 增量式训练:只更新场景中发生变化的区域。2. 数据选择:选择信息量大的图像进行训练。3. 模型压缩:使用轻量级的辐射场模型。具体的损失函数和网络结构取决于所使用的辐射场方法(NeRF或3DGS)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于辐射场的遥操作方法在场景逼真度和视角控制方面优于传统的网格重建方法。用户研究表明,操作者更喜欢使用基于辐射场的VR可视化界面,因为它提供了更强的沉浸感和更精确的操作体验。具体的性能数据(例如,图像质量指标、操作时间、错误率等)需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于各种需要远程操作的场景,例如:危险环境下的机器人操作(核电站、化工厂)、太空探索、远程医疗手术、以及虚拟现实游戏等。通过提供高质量、高机动性的场景可视化,可以提高操作的效率和安全性,并增强操作者的沉浸感。

📄 摘要(原文)

Radiance field methods such as Neural Radiance Fields (NeRFs) or 3D Gaussian Splatting (3DGS), have revolutionized graphics and novel view synthesis. Their ability to synthesize new viewpoints with photo-realistic quality, as well as capture complex volumetric and specular scenes, makes them an ideal visualization for robotic teleoperation setups. Direct camera teleoperation provides high-fidelity operation at the cost of maneuverability, while reconstruction-based approaches offer controllable scenes with lower fidelity. With this in mind, we propose replacing the traditional reconstruction-visualization components of the robotic teleoperation pipeline with online Radiance Fields, offering highly maneuverable scenes with photorealistic quality. As such, there are three main contributions to state of the art: (1) online training of Radiance Fields using live data from multiple cameras, (2) support for a variety of radiance methods including NeRF and 3DGS, (3) visualization suite for these methods including a virtual reality scene. To enable seamless integration with existing setups, these components were tested with multiple robots in multiple configurations and were displayed using traditional tools as well as the VR headset. The results across methods and robots were compared quantitatively to a baseline of mesh reconstruction, and a user study was conducted to compare the different visualization methods. For videos and code, check out https://rffr.leggedrobotics.com/works/teleoperation/.