PlantTrack: Task-Driven Plant Keypoint Tracking with Zero-Shot Sim2Real Transfer

作者: Samhita Marri, Arun N. Sivakumar, Naveen K. Uppalapati, Girish Chowdhary

分类: cs.RO, cs.CV

发布日期: 2024-07-23

💡 一句话要点

PlantTrack:基于DINOv2和TAPIR的零样本Sim2Real植物关键点跟踪

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 植物关键点跟踪 零样本Sim2Real DINOv2 TAPIR 精准农业

📋 核心要点

- 植物环境复杂,现有方法难以准确跟踪植物特征,限制了农业自动化应用。

- PlantTrack利用DINOv2提取特征,训练关键点预测器,结合TAPIR实现跨帧跟踪。

- 仅需少量合成数据训练,即可在真实场景实现零样本迁移,有效跟踪植物特征。

📝 摘要(中文)

植物特征跟踪对于农业任务至关重要,但植物环境的非结构化、杂乱和可变形特性使其成为一项具有挑战性的任务。本文提出了PlantTrack,利用DINOv2提供的高维特征,训练一个关键点热图预测网络来识别语义特征(如水果和叶子)的位置,然后使用这些位置作为TAPIR的提示,以在视频帧中跟踪这些点。实验表明,仅使用20张合成图像训练关键点预测器,即可实现零样本Sim2Real迁移,从而在真实环境中有效跟踪植物特征。

🔬 方法详解

问题定义:论文旨在解决在复杂、非结构化的植物环境中,准确跟踪植物关键点(如叶片、果实等)的问题。现有方法在真实场景中泛化能力差,需要大量标注数据进行训练,成本高昂。

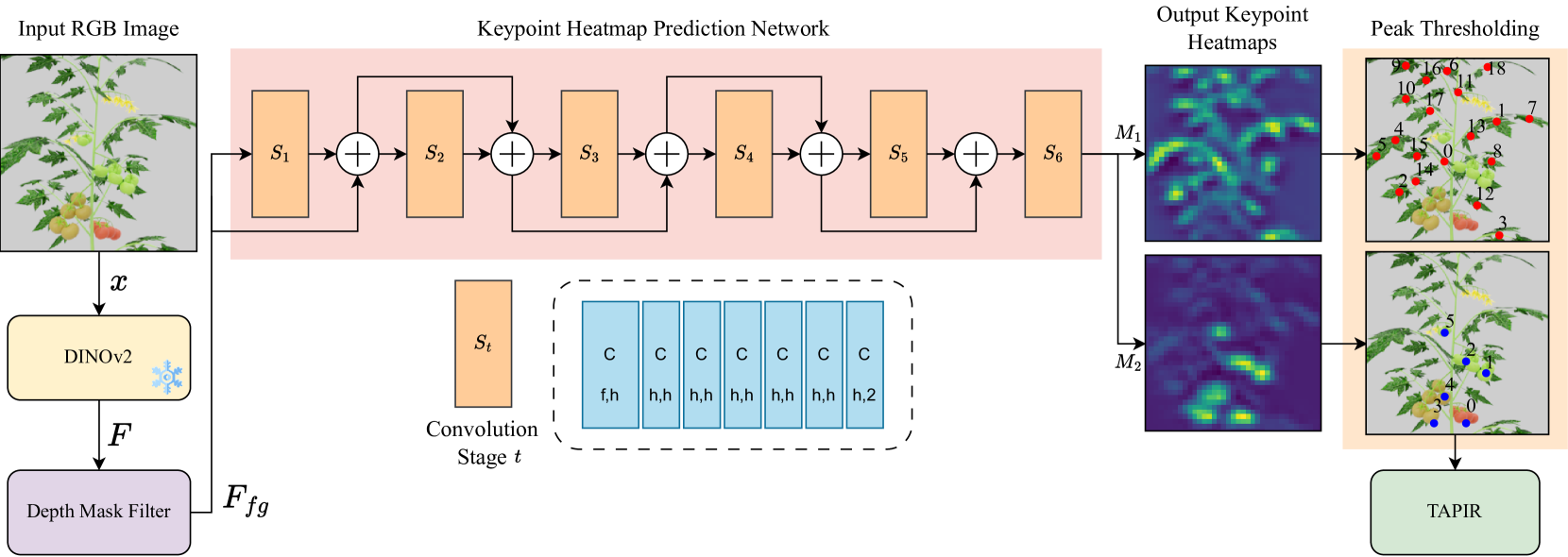

核心思路:论文的核心思路是利用预训练的视觉基础模型DINOv2提取植物图像的鲁棒特征,并在此基础上训练一个轻量级的关键点预测器。然后,利用预测的关键点作为提示,驱动TAPIR进行跨帧跟踪。这种方法结合了DINOv2的强大特征提取能力和TAPIR的精确跟踪能力,同时降低了对大量真实标注数据的依赖。

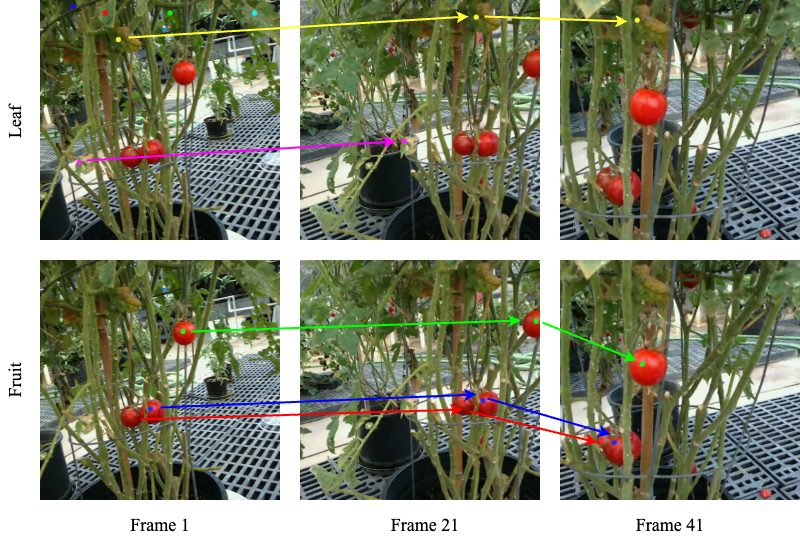

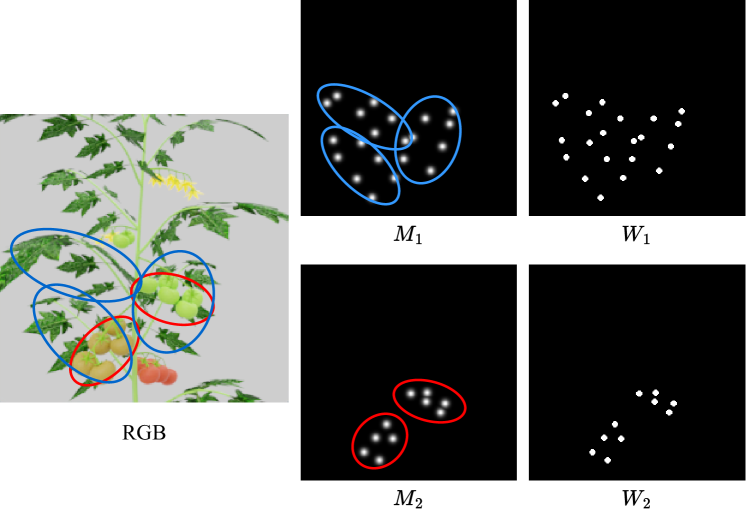

技术框架:PlantTrack的整体框架包括三个主要模块:1) DINOv2特征提取:使用DINOv2提取输入图像的高维特征表示。2) 关键点热图预测:训练一个轻量级的神经网络,以DINOv2特征作为输入,预测植物关键点的热图。该网络使用少量合成数据进行训练。3) 基于TAPIR的关键点跟踪:利用预测的关键点热图,得到关键点位置,将其作为TAPIR的提示,在视频帧序列中跟踪这些关键点。

关键创新:PlantTrack的关键创新在于实现了零样本Sim2Real迁移。通过在合成数据上训练关键点预测器,可以直接将其应用于真实场景,而无需在真实数据上进行微调。这大大降低了数据标注成本,并提高了模型的泛化能力。

关键设计:关键点预测器是一个轻量级的卷积神经网络,输入是DINOv2提取的特征图,输出是关键点热图。损失函数采用均方误差(MSE)损失,用于衡量预测热图与真实热图之间的差异。TAPIR使用默认参数设置,关键点位置作为TAPIR的初始提示。

🖼️ 关键图片

📊 实验亮点

PlantTrack仅使用20张合成图像进行训练,即可在真实场景中实现有效的植物关键点跟踪。实验结果表明,该方法具有良好的零样本Sim2Real迁移能力,无需在真实数据上进行微调。这大大降低了数据标注成本,并提高了模型的泛化能力,为实际应用奠定了基础。

🎯 应用场景

PlantTrack可应用于精准农业领域,例如植物表型分析、自动化修剪、机器人采摘等。通过准确跟踪植物特征,可以实现对植物生长状态的监测和控制,提高农业生产效率和质量。该研究为农业机器人和智能农业系统的发展提供了新的技术方案。

📄 摘要(原文)

Tracking plant features is crucial for various agricultural tasks like phenotyping, pruning, or harvesting, but the unstructured, cluttered, and deformable nature of plant environments makes it a challenging task. In this context, the recent advancements in foundational models show promise in addressing this challenge. In our work, we propose PlantTrack where we utilize DINOv2 which provides high-dimensional features, and train a keypoint heatmap predictor network to identify the locations of semantic features such as fruits and leaves which are then used as prompts for point tracking across video frames using TAPIR. We show that with as few as 20 synthetic images for training the keypoint predictor, we achieve zero-shot Sim2Real transfer, enabling effective tracking of plant features in real environments.