Self-Adaptive Robust Motion Planning for High DoF Robot Manipulator using Deep MPC

作者: Ye Zhang, Kangtong Mo, Fangzhou Shen, Xuanzhen Xu, Xingyu Zhang, Jiayue Yu, Chang Yu

分类: cs.RO

发布日期: 2024-07-17

💡 一句话要点

提出基于深度MPC的自适应鲁棒运动规划方法,用于高自由度机器人

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 深度MPC 自适应控制 鲁棒控制 运动规划 高自由度机器人

📋 核心要点

- 传统自适应控制对模型精度要求高,且易受约束限制,深度学习虽有强大的逼近能力,但训练时面临梯度消失/爆炸问题。

- 提出一种基于深度MPC的自适应控制方案,通过创新的权重更新法则,仅使用梯度符号来缓解梯度消失/爆炸问题。

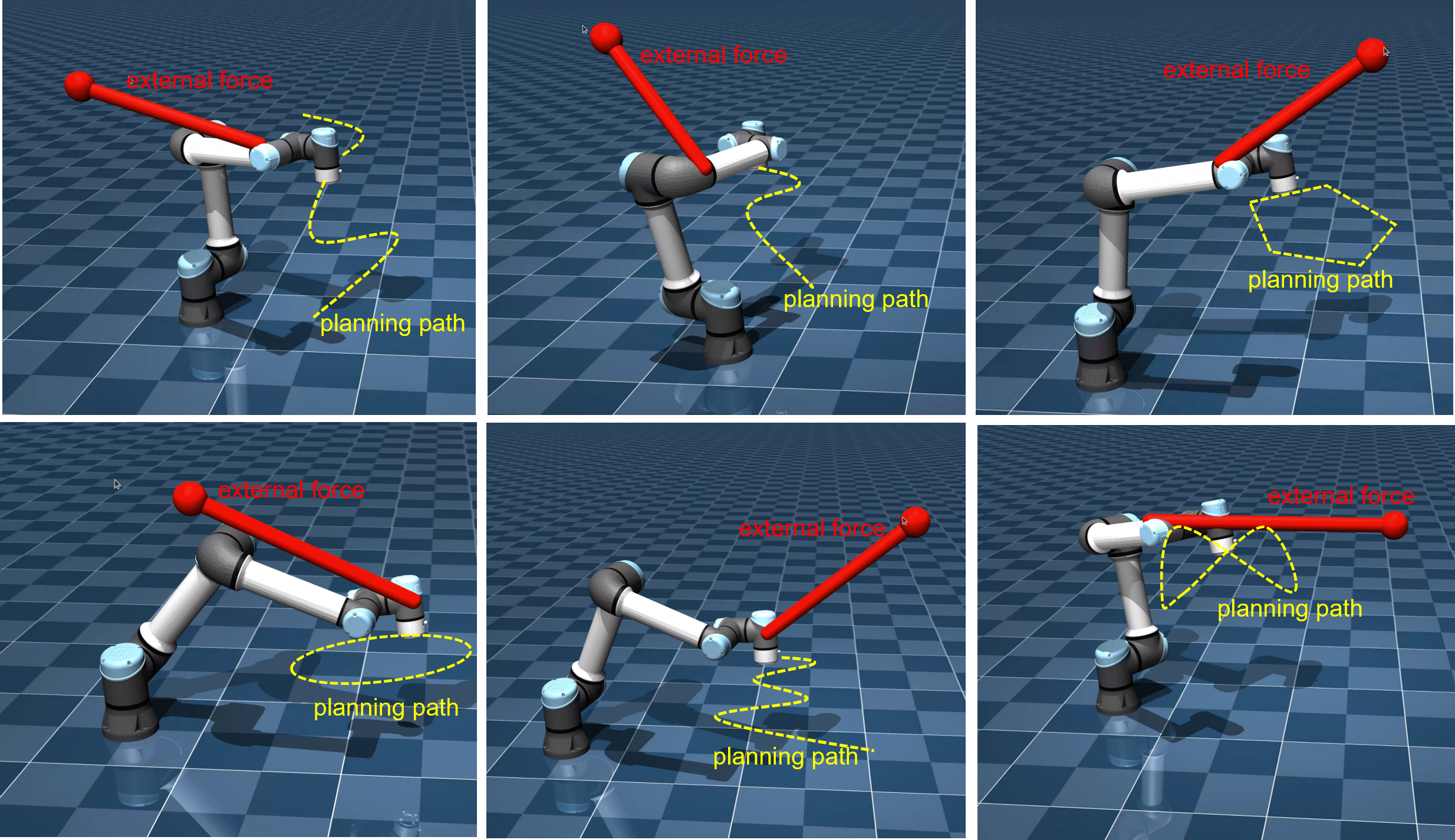

- 通过高自由度机器人机械手的仿真实验,验证了该控制器能够快速学习非线性动力学,并在运动规划任务中表现良好。

📝 摘要(中文)

在现代控制理论中,自适应方法因其在处理建模不确定性方面的灵活性和鲁棒性而备受推崇。特别是,鲁棒自适应控制通过利用鲁棒优化算法来近似成本函数并放宽与传统自适应控制范例相关的严格约束而脱颖而出。深度学习方法以其广泛的分层架构为特征,提供了显着增强的逼近能力。然而,深度学习的实施充满了挑战,尤其是在训练过程中遇到的梯度消失和爆炸现象。本文提出了一种自适应控制方案,该方案集成了深度MPC,并由一种创新的权重更新定律控制,该定律旨在通过仅使用梯度符号来减轻梯度消失和爆炸的困境。所提供的控制器是一种自适应动态逆机制,它在辅助估计电路中集成了增强状态观测器,以增强训练阶段。这种方法使深度MPC能够实时学习整个工厂模型,并且通过涉及高自由度机器人机械手的仿真证明了控制器的有效性,其中控制器熟练地快速学习非线性工厂动力学,并在运动规划任务中表现出值得称赞的性能。

🔬 方法详解

问题定义:论文旨在解决高自由度机器人机械臂在运动规划中,由于模型不确定性和非线性动力学带来的控制难题。传统方法难以兼顾鲁棒性和自适应性,而直接应用深度学习又面临训练不稳定的问题。

核心思路:论文的核心在于将深度学习的强大函数逼近能力与模型预测控制(MPC)的优化控制框架相结合,并引入自适应机制来应对模型不确定性。通过设计特定的权重更新策略,解决深度学习训练中的梯度消失和爆炸问题,从而实现鲁棒且高效的运动规划。

技术框架:整体框架包含以下几个主要模块:1) 深度MPC:使用深度神经网络来近似系统的动态模型,并用于预测未来状态。2) 自适应动态逆:利用动态逆控制的思想,结合深度MPC的预测结果,实现对系统的精确控制。3) 增强状态观测器:用于估计系统的状态,并将其反馈给深度MPC进行训练。4) 权重更新法则:基于梯度符号的创新权重更新策略,用于缓解梯度消失和爆炸问题。

关键创新:最重要的技术创新在于基于梯度符号的权重更新法则。传统的梯度下降方法容易受到梯度幅值的影响,导致训练不稳定。而该方法仅使用梯度符号,忽略了梯度幅值,从而有效地缓解了梯度消失和爆炸问题,提高了训练的鲁棒性。

关键设计:论文中,深度MPC的网络结构选择需要根据具体任务进行调整,损失函数的设计需要考虑控制精度和稳定性。基于梯度符号的权重更新法则的具体形式需要根据实验结果进行调整,以达到最佳的训练效果。增强状态观测器的设计需要保证状态估计的准确性和实时性。

🖼️ 关键图片

📊 实验亮点

论文通过高自由度机器人机械手的仿真实验验证了所提出方法的有效性。实验结果表明,该控制器能够快速学习非线性动力学,并在运动规划任务中表现出良好的性能。虽然论文中没有给出具体的性能数据和对比基线,但强调了控制器在学习速度和运动规划精度方面的优势。

🎯 应用场景

该研究成果可应用于各种需要高精度运动控制的机器人系统,例如工业机器人、服务机器人和医疗机器人。通过自适应地学习和补偿系统动态,该方法可以提高机器人的运动精度、鲁棒性和适应性,从而扩展其应用范围和提升其性能。未来,该方法有望应用于更复杂的机器人系统和更具挑战性的环境。

📄 摘要(原文)

In contemporary control theory, self-adaptive methodologies are highly esteemed for their inherent flexibility and robustness in managing modeling uncertainties. Particularly, robust adaptive control stands out owing to its potent capability of leveraging robust optimization algorithms to approximate cost functions and relax the stringent constraints often associated with conventional self-adaptive control paradigms. Deep learning methods, characterized by their extensive layered architecture, offer significantly enhanced approximation prowess. Notwithstanding, the implementation of deep learning is replete with challenges, particularly the phenomena of vanishing and exploding gradients encountered during the training process. This paper introduces a self-adaptive control scheme integrating a deep MPC, governed by an innovative weight update law designed to mitigate the vanishing and exploding gradient predicament by employing the gradient sign exclusively. The proffered controller is a self-adaptive dynamic inversion mechanism, integrating an augmented state observer within an auxiliary estimation circuit to enhance the training phase. This approach enables the deep MPC to learn the entire plant model in real-time and the efficacy of the controller is demonstrated through simulations involving a high-DoF robot manipulator, wherein the controller adeptly learns the nonlinear plant dynamics expeditiously and exhibits commendable performance in the motion planning task.