GRUtopia: Dream General Robots in a City at Scale

作者: Hanqing Wang, Jiahe Chen, Wensi Huang, Qingwei Ben, Tai Wang, Boyu Mi, Tao Huang, Siheng Zhao, Yilun Chen, Sizhe Yang, Peizhou Cao, Wenye Yu, Zichao Ye, Jialun Li, Junfeng Long, Zirui Wang, Huiling Wang, Ying Zhao, Zhongying Tu, Yu Qiao, Dahua Lin, Jiangmiao Pang

分类: cs.RO, cs.CV

发布日期: 2024-07-15

🔗 代码/项目: GITHUB

💡 一句话要点

GRUtopia:构建大规模城市级别交互式3D模拟环境,助力通用机器人研究。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 模拟环境 机器人 大型语言模型 社交互动 数据集 基准测试

📋 核心要点

- 具身智能模型学习面临真实世界数据收集成本高昂的挑战,Sim2Real范式是关键。

- GRUtopia项目旨在构建一个大规模、交互式的3D模拟环境,包含多样化的场景和社交互动。

- 该项目提供GRScenes数据集、GRResidents NPC系统和GRBench基准测试,促进具身智能研究。

📝 摘要(中文)

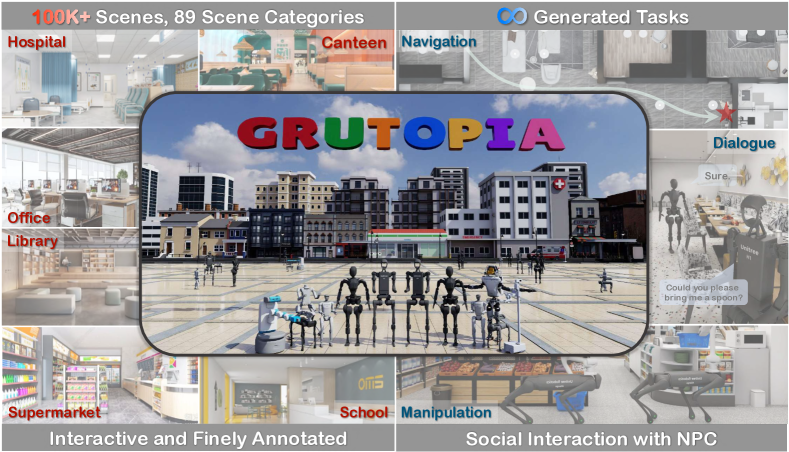

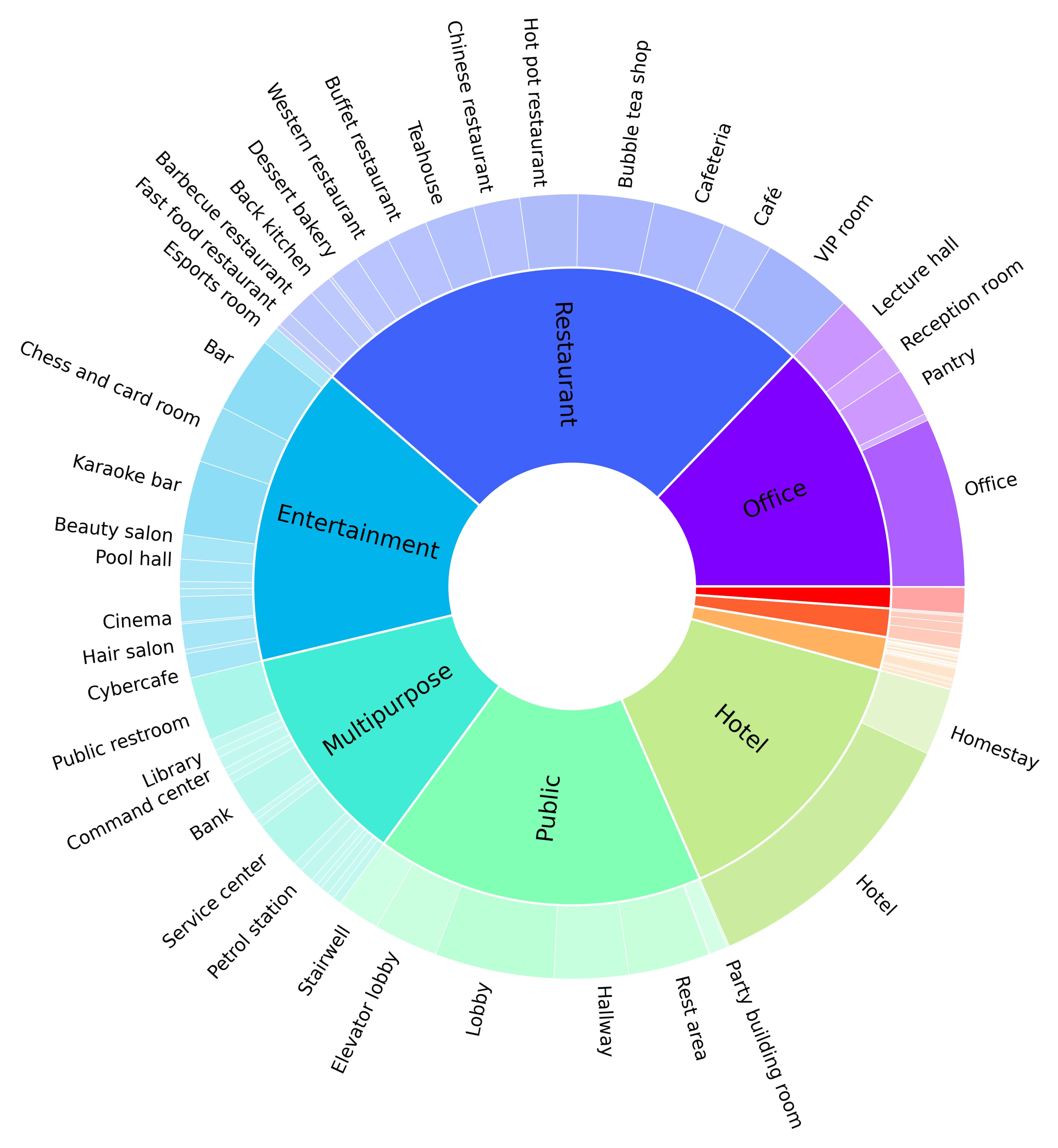

本文介绍了GRUtopia项目,这是一个为各种机器人设计的首个模拟交互式3D社会。该项目包含以下几个方面的创新:(a) 场景数据集GRScenes,包含10万个交互式、精细标注的场景,可以自由组合成城市规模的环境。与之前主要关注家庭环境的工作不同,GRScenes涵盖了89个不同的场景类别,弥补了通用机器人最初部署的服务型环境的差距。(b) GRResidents,一个由大型语言模型(LLM)驱动的非玩家角色(NPC)系统,负责社交互动、任务生成和任务分配,从而模拟具身人工智能应用的社会场景。(c) 基准测试GRBench,支持各种机器人,但主要关注腿式机器人作为主要代理,并提出涉及物体定位导航、社交定位导航和定位操作等具有一定挑战性的任务。希望这项工作能够缓解该领域高质量数据的稀缺性,并为具身人工智能研究提供更全面的评估。

🔬 方法详解

问题定义:现有具身智能研究面临高质量、多样化训练数据匮乏的问题,尤其缺乏服务型环境和社会交互场景的数据。真实世界数据收集成本高昂,限制了模型规模的扩展和泛化能力。

核心思路:通过构建大规模的模拟环境,提供丰富的交互式场景和社交互动,降低数据获取成本,促进具身智能模型的学习和评估。利用大型语言模型驱动的NPC系统模拟社会行为,增强环境的真实感和复杂性。

技术框架:GRUtopia项目包含三个主要组成部分:GRScenes(场景数据集)、GRResidents(NPC系统)和GRBench(基准测试)。GRScenes提供10万个交互式场景,涵盖89个类别。GRResidents利用LLM生成NPC的行为和对话,模拟社交互动。GRBench提供了一系列具身智能任务,包括物体定位导航、社交定位导航和定位操作。

关键创新:GRUtopia的关键创新在于构建了一个大规模、多样化的交互式3D模拟社会,并引入了LLM驱动的NPC系统,从而能够模拟更复杂的社会场景。与以往主要关注家庭环境的模拟环境不同,GRUtopia涵盖了服务型环境,更贴近通用机器人的实际应用场景。

关键设计:GRScenes数据集包含精细的场景标注,支持场景的自由组合,从而构建城市规模的环境。GRResidents系统利用LLM生成NPC的行为和对话,并根据环境和任务进行调整。GRBench基准测试针对腿式机器人设计了一系列具有挑战性的任务,并提供了统一的评估指标。

🖼️ 关键图片

📊 实验亮点

GRUtopia项目构建了包含10万个场景的数据集,涵盖89个场景类别,远超以往的模拟环境。GRResidents系统能够生成逼真的NPC行为和对话,模拟复杂的社会互动。GRBench基准测试为腿式机器人提供了一系列具有挑战性的任务,为评估具身智能模型的性能提供了标准。

🎯 应用场景

GRUtopia项目为具身智能的研究和开发提供了强大的平台,可应用于服务机器人、自动驾驶、虚拟现实等领域。通过在模拟环境中训练和评估机器人,可以降低开发成本,提高机器人的安全性和可靠性。该项目还有助于研究人类与机器人之间的交互,促进人机协作的发展。

📄 摘要(原文)

Recent works have been exploring the scaling laws in the field of Embodied AI. Given the prohibitive costs of collecting real-world data, we believe the Simulation-to-Real (Sim2Real) paradigm is a crucial step for scaling the learning of embodied models. This paper introduces project GRUtopia, the first simulated interactive 3D society designed for various robots. It features several advancements: (a) The scene dataset, GRScenes, includes 100k interactive, finely annotated scenes, which can be freely combined into city-scale environments. In contrast to previous works mainly focusing on home, GRScenes covers 89 diverse scene categories, bridging the gap of service-oriented environments where general robots would be initially deployed. (b) GRResidents, a Large Language Model (LLM) driven Non-Player Character (NPC) system that is responsible for social interaction, task generation, and task assignment, thus simulating social scenarios for embodied AI applications. (c) The benchmark, GRBench, supports various robots but focuses on legged robots as primary agents and poses moderately challenging tasks involving Object Loco-Navigation, Social Loco-Navigation, and Loco-Manipulation. We hope that this work can alleviate the scarcity of high-quality data in this field and provide a more comprehensive assessment of Embodied AI research. The project is available at https://github.com/OpenRobotLab/GRUtopia.