Visual-tactile manipulation to collect household waste in outdoor

作者: Julio Castaño-Amorós, Ignacio de Loyola Páez-Ubieta, Pablo Gil, Santiago Timoteo Puente

分类: cs.RO

发布日期: 2024-07-15

备注: in Spanish language

期刊: Revista Iberoamericana de Automática e Informática Industrial (RIAI), Volume 20, Article number 2, 2022, Pages 163-174

💡 一句话要点

提出一种基于视觉-触觉融合的机器人操作系统,用于户外家庭垃圾分类与收集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人操作 视觉触觉融合 垃圾分类 卷积神经网络 户外环境

📋 核心要点

- 现有户外垃圾收集机器人缺乏对复杂环境的适应性和精确操作能力,难以有效处理家庭垃圾。

- 该系统融合视觉和触觉信息,利用CNN进行垃圾识别、定位和抓取点估计,并根据触觉反馈调整抓取动作。

- 实验结果表明,该系统在垃圾定位、识别和抓取稳定性方面表现良好,且整体运行时间较短。

📝 摘要(中文)

本文提出了一种应用于机器人操作的感知系统,该系统能够辅助机器人在户外环境中进行导航、家庭垃圾分类和收集。该系统集成了光学触觉传感器、RGBD相机和激光雷达,并安装在带有机器人机械臂和机械抓手的移动平台上。我们的系统分为三个软件模块,其中两个基于视觉,一个基于触觉。基于视觉的模块使用卷积神经网络(CNN)来定位和识别固体家庭垃圾,并估计抓取点。基于触觉的模块也使用CNN和图像处理,调整抓手开口以根据触觉数据控制抓取。我们的方案实现了约6%的定位误差,98%的识别准确率,并确保了91%的抓取尝试的稳定性。三个模块的总运行时间小于750毫秒。

🔬 方法详解

问题定义:论文旨在解决户外环境下家庭垃圾的自动分类和收集问题。现有方法在复杂户外环境中,对垃圾的精确定位、识别以及稳定抓取存在挑战,尤其是在光照变化、遮挡等情况下,仅依赖视觉信息难以保证抓取的可靠性。

核心思路:论文的核心思路是融合视觉和触觉信息,利用视觉信息进行垃圾的初步定位和识别,然后通过触觉传感器获取的触觉反馈来调整抓取动作,从而提高抓取的稳定性和成功率。这种融合的方式可以弥补单一视觉信息在复杂环境下的不足。

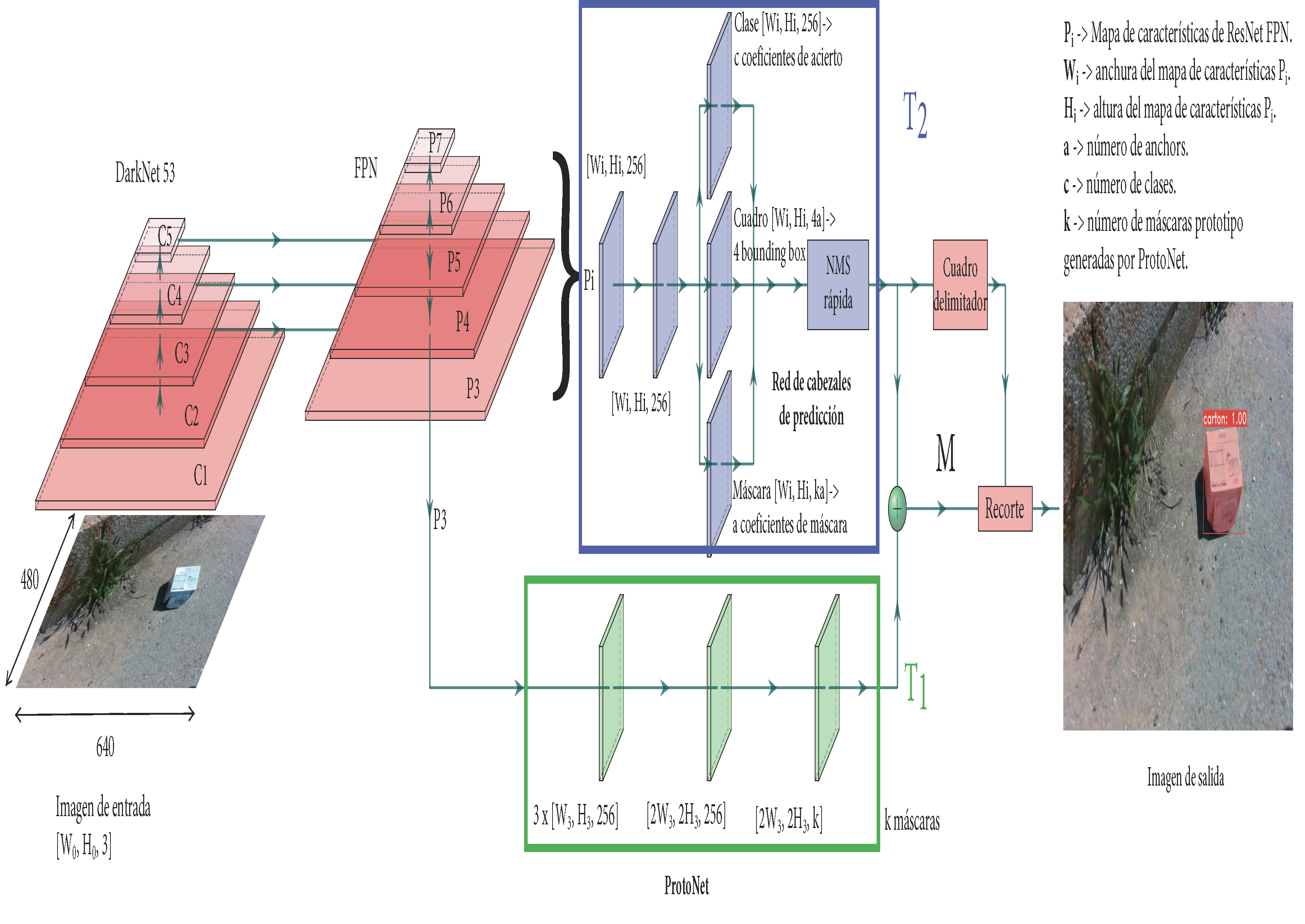

技术框架:该系统包含三个主要模块:1) 基于视觉的垃圾定位模块,使用CNN定位垃圾;2) 基于视觉的垃圾识别模块,使用CNN识别垃圾类别并估计抓取点;3) 基于触觉的抓取调整模块,利用触觉传感器数据和CNN调整抓手开口,控制抓取力度。这三个模块协同工作,完成垃圾的分类和收集任务。整体流程是先通过视觉模块进行初步定位和识别,然后利用触觉模块进行精细调整,最终完成抓取。

关键创新:该论文的关键创新在于将视觉和触觉信息融合,用于户外家庭垃圾的自动分类和收集。通过触觉反馈来调整抓取动作,提高了抓取的稳定性和成功率。此外,系统集成了多种传感器(光学触觉传感器、RGBD相机和激光雷达),实现了对环境的全面感知。

关键设计:论文中使用了CNN进行垃圾定位、识别和触觉数据处理。具体的网络结构和训练细节(如损失函数、优化器等)在摘要中未提及,属于未知信息。触觉模块的关键设计在于如何将触觉传感器获取的图像数据转化为抓取动作的调整策略,这部分涉及图像处理和控制算法的设计。

🖼️ 关键图片

📊 实验亮点

该系统实现了约6%的垃圾定位误差,98%的垃圾识别准确率,并确保了91%的抓取尝试的稳定性。三个模块的总运行时间小于750毫秒,表明该系统具有较高的实时性和可靠性。这些结果表明,视觉-触觉融合的方法在机器人操作领域具有显著优势。

🎯 应用场景

该研究成果可应用于智能垃圾分类机器人、家庭服务机器人等领域,提高垃圾处理效率,降低人工成本。未来可进一步扩展到更复杂的环境和任务,例如灾后救援、危险品处理等,具有重要的社会和经济价值。

📄 摘要(原文)

This work presents a perception system applied to robotic manipulation, that is able to assist in navigation, household waste classification and collection in outdoor environments. This system is made up of optical tactile sensors, RGBD cameras and a LiDAR. These sensors are integrated on a mobile platform with a robot manipulator and a robotic gripper. Our system is divided in three software modules, two of them are vision-based and the last one is tactile-based. The vision-based modules use CNNs to localize and recognize solid household waste, together with the grasping points estimation. The tactile-based module, which also uses CNNs and image processing, adjusts the gripper opening to control the grasping from touch data. Our proposal achieves localization errors around 6 %, a recognition accuracy of 98% and ensures the grasping stability the 91% of the attempts. The sum of runtimes of the three modules is less than 750 ms.