Adaptive Autopilot: Constrained DRL for Diverse Driving Behaviors

作者: Dinesh Cyril Selvaraj, Christian Vitale, Tania Panayiotou, Panayiotis Kolios, Carla Fabiana Chiasserini, Georgios Ellinas

分类: cs.RO, cs.LG

发布日期: 2024-07-02

备注: 8 pages, 9 figures

💡 一句话要点

提出自适应自动驾驶仪,利用约束DRL实现多样化驾驶行为

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动驾驶 深度强化学习 约束优化 车辆跟随 驾驶行为建模

📋 核心要点

- 现有自动驾驶系统难以模拟人类驾驶的多样性和安全性,导致驾驶员频繁干预。

- 提出自适应自动驾驶仪,通过约束深度强化学习模仿人类驾驶行为,提升自动驾驶的自然性和安全性。

- 实验结果表明,该方法能有效区分驾驶风格,准确预测加速度,并学习类人驾驶策略。

📝 摘要(中文)

本研究提出了一种名为自适应自动驾驶仪(AA)的独特框架,该框架利用约束深度强化学习(C-DRL)安全地模拟人类驾驶行为,以减少驾驶员干预的必要性。该方法专注于车辆跟随场景,首先从highD自然驾驶研究中提取数据,并使用基于规则的分类器将其分为三种驾驶风格。然后,采用深度神经网络(DNN)回归器来预测不同风格下类人的加速度。最后,使用C-DRL,特别是软演员-评论家拉格朗日技术,来学习类人安全驾驶策略。结果表明,该方法在每个步骤都有效,基于规则的分类器能够区分驾驶风格,回归模型能够准确预测加速度,优于传统的车辆跟随模型,并且C-DRL智能体能够学习针对不同风格的类人驾驶的最佳策略。

🔬 方法详解

问题定义:现有自动驾驶系统在车辆跟随场景中,难以兼顾安全性、舒适性和类人驾驶风格。传统方法通常依赖于预定义的规则或模型,无法适应驾驶员的个性化行为和复杂交通环境,导致驾驶体验不佳,需要驾驶员频繁介入。

核心思路:本研究的核心在于利用约束深度强化学习(C-DRL)来学习人类驾驶行为。通过模仿人类驾驶数据,训练智能体在保证安全约束的前提下,学习不同驾驶风格下的最优策略。这种方法能够使自动驾驶系统更加自然、安全,并减少驾驶员的干预。

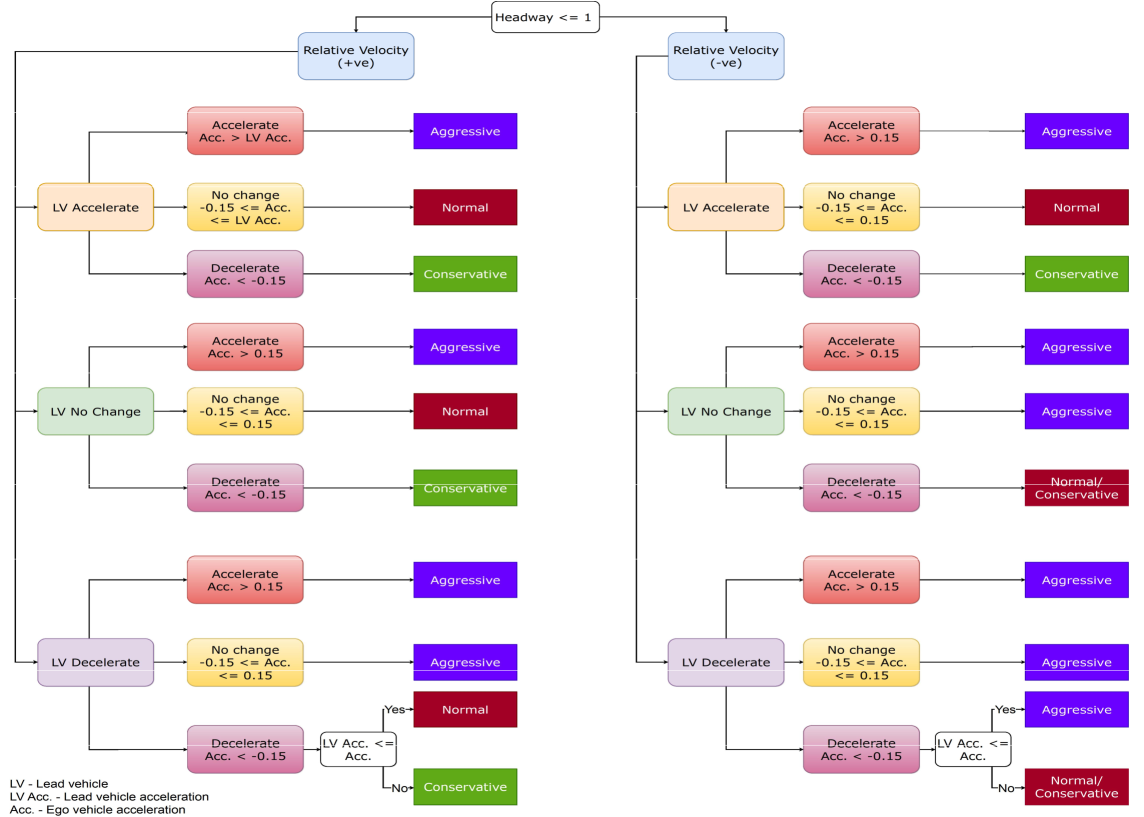

技术框架:该框架包含三个主要阶段:(1) 驾驶风格分类:使用基于规则的分类器将highD数据集中的驾驶行为分为三种风格。(2) 加速度预测:使用深度神经网络(DNN)回归器,针对每种驾驶风格,预测类人的加速度。(3) 策略学习:使用软演员-评论家拉格朗日(SAC-Lagrangian)算法,训练C-DRL智能体,学习在满足安全约束条件下的类人驾驶策略。

关键创新:该研究的关键创新在于将约束深度强化学习应用于自动驾驶领域,并结合驾驶风格分类和加速度预测,实现了更加个性化和安全的自动驾驶。与传统的基于规则或模型的自动驾驶方法相比,C-DRL能够更好地适应复杂环境和驾驶员行为,并保证安全性。

关键设计:在驾驶风格分类阶段,设计了一套基于车辆速度、加速度和车头时距等特征的规则。在加速度预测阶段,使用了多层感知机(MLP)作为DNN回归器。在策略学习阶段,使用了SAC-Lagrangian算法,其中拉格朗日乘子用于约束安全指标,例如碰撞风险。损失函数包括模仿学习损失和强化学习奖励,以鼓励智能体学习类人驾驶行为并优化驾驶性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够有效区分三种驾驶风格,DNN回归器能够准确预测加速度,优于传统的车辆跟随模型。C-DRL智能体能够学习在满足安全约束条件下的类人驾驶策略,显著提升了自动驾驶的自然性和安全性。具体性能数据未知,但论文强调了其优于传统方法的表现。

🎯 应用场景

该研究成果可应用于自动驾驶汽车的车辆跟随系统,提升驾驶的舒适性和安全性,减少驾驶员的干预。此外,该方法还可以扩展到其他自动驾驶场景,例如变道、超车等,实现更加智能和个性化的自动驾驶体验。未来,该研究可以进一步探索不同驾驶员的个性化建模,实现更加定制化的自动驾驶服务。

📄 摘要(原文)

In pursuit of autonomous vehicles, achieving human-like driving behavior is vital. This study introduces adaptive autopilot (AA), a unique framework utilizing constrained-deep reinforcement learning (C-DRL). AA aims to safely emulate human driving to reduce the necessity for driver intervention. Focusing on the car-following scenario, the process involves (i) extracting data from the highD natural driving study and categorizing it into three driving styles using a rule-based classifier; (ii) employing deep neural network (DNN) regressors to predict human-like acceleration across styles; and (iii) using C-DRL, specifically the soft actor-critic Lagrangian technique, to learn human-like safe driving policies. Results indicate effectiveness in each step, with the rule-based classifier distinguishing driving styles, the regressor model accurately predicting acceleration, outperforming traditional car-following models, and C-DRL agents learning optimal policies for humanlike driving across styles.