Non-Prehensile Aerial Manipulation using Model-Based Deep Reinforcement Learning

作者: Cora A. Dimmig, Marin Kobilarov

分类: cs.RO

发布日期: 2024-07-01

备注: ©2024 IEEE. Personal use of this material is permitted. Permission from IEEE must be obtained for all other uses, in any current or future media, including reprinting/republishing this material for advertising or promotional purposes, creating new collective works, for resale or redistribution to servers or lists, or reuse of any copyrighted component of this work in other works

💡 一句话要点

提出基于模型深度强化学习的非抓取式无人机空中操作方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 无人机 空中操作 非抓取式 深度强化学习 模型学习 鲁棒控制 未知环境

📋 核心要点

- 空中操作面临环境物体动力学属性未知以及交互影响飞行器控制的挑战。

- 利用基于模型的深度强化学习,同时学习环境的世界模型和交互策略。

- 实验表明,该方法在不同摩擦系数下推动物体至目标位置时表现出可重复性。

📝 摘要(中文)

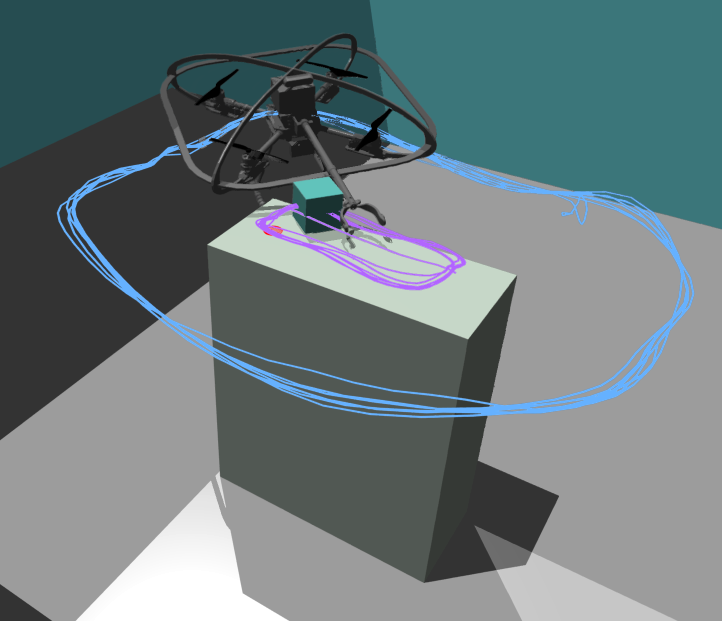

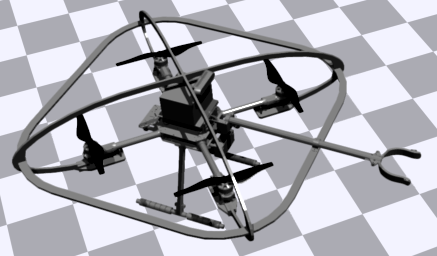

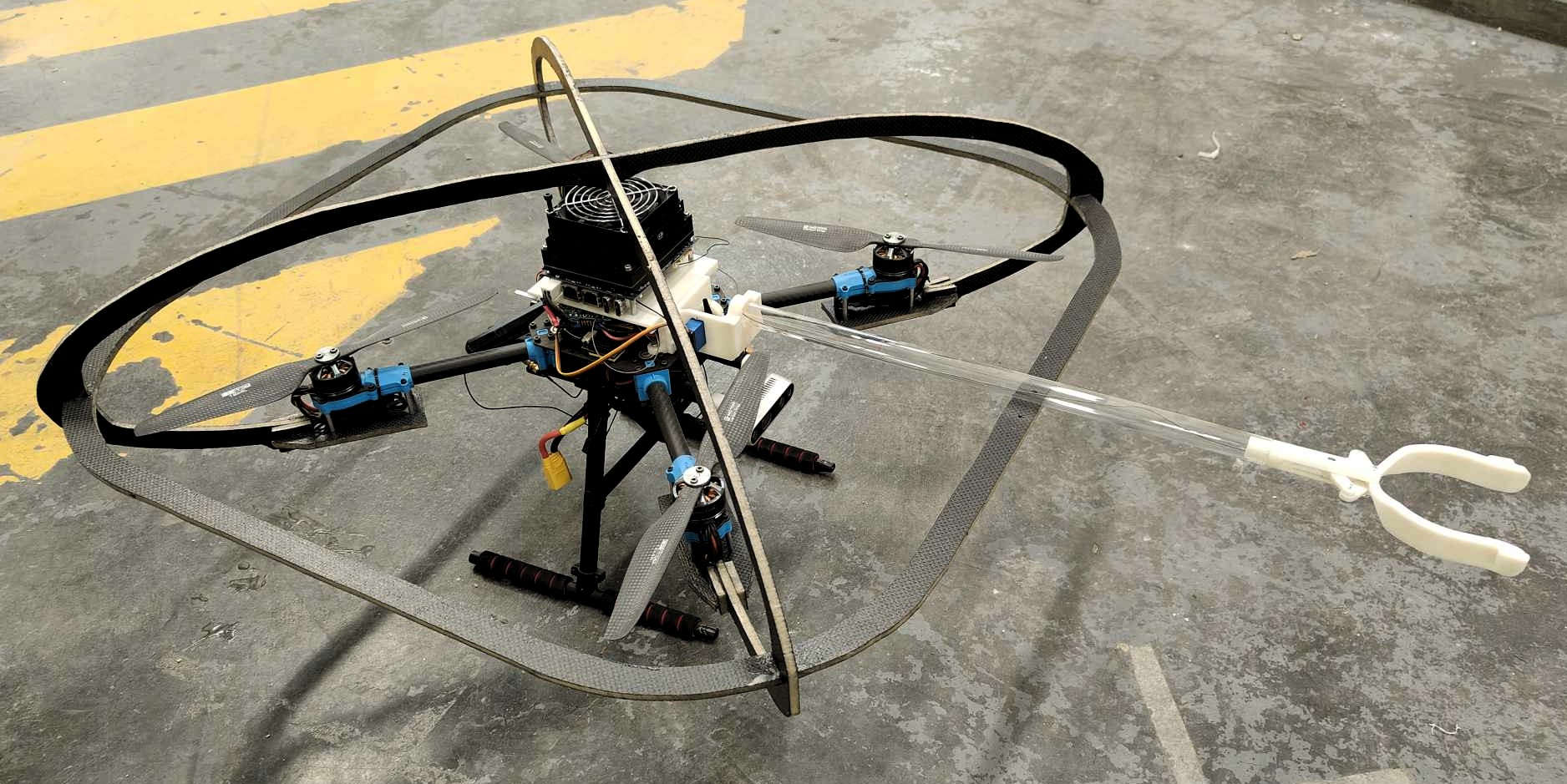

本文研究了在未知环境中进行鲁棒控制和非抓取式空中操作的方法。空中操作任务需要在与环境中的物体交互,通常事先不知道它们的动力学属性,如质量和摩擦力。此外,与这些物体的交互会对飞行器的控制和稳定性产生重大影响。本文采用基于模型的深度强化学习(DRL)来学习环境的世界模型,同时学习与环境交互的策略。通过在一系列推动任务中移动目标位置之间的物体来评估该方法,并展示了在各种摩擦值下可重复的行为。

🔬 方法详解

问题定义:论文旨在解决无人机在未知环境中进行非抓取式空中操作的鲁棒控制问题。现有方法难以应对物体动力学属性未知以及交互对飞行器控制产生影响的情况。这使得无人机难以稳定地与环境交互,完成诸如推动物体等任务。

核心思路:论文的核心思路是利用基于模型的深度强化学习(Model-Based DRL),让无人机在与环境交互的过程中,同时学习环境的世界模型和控制策略。通过学习世界模型,无人机可以预测其行为对环境的影响,从而更好地进行控制。

技术框架:整体框架包含两个主要部分:世界模型学习和策略学习。世界模型学习模块利用深度神经网络来预测无人机动作后的环境状态。策略学习模块则利用学习到的世界模型,通过强化学习算法(具体算法未知)来优化无人机的控制策略。这两个模块是同时学习和相互促进的。

关键创新:关键创新在于将基于模型的深度强化学习应用于非抓取式空中操作。传统方法通常依赖于精确的物体动力学模型,而本文的方法可以在物体动力学属性未知的情况下,通过学习来适应环境。此外,同时学习世界模型和策略可以提高学习效率和鲁棒性。

关键设计:论文中没有明确给出关键参数设置、损失函数和网络结构的具体细节。但是,可以推测世界模型的损失函数可能包括预测状态与真实状态之间的误差。策略学习模块可能采用Actor-Critic等算法,并设计合适的奖励函数来引导无人机完成推动物体的任务。网络结构可能采用卷积神经网络(CNN)或循环神经网络(RNN)来处理环境信息和历史状态。

🖼️ 关键图片

📊 实验亮点

论文通过一系列推动任务验证了该方法的有效性。实验结果表明,该方法能够在不同摩擦系数下实现可重复的物体推动行为。虽然论文中没有给出具体的性能数据和对比基线,但实验结果表明该方法具有一定的鲁棒性和泛化能力。

🎯 应用场景

该研究成果可应用于物流、建筑、农业等领域。例如,无人机可以用于在仓库中移动货物,在建筑工地搬运材料,或在农田中进行精准作业。此外,该技术还可以用于灾难救援,例如在危险环境中移动障碍物或运送物资。该研究为无人机在复杂和未知环境中的应用提供了新的可能性。

📄 摘要(原文)

With the continual adoption of Uncrewed Aerial Vehicles (UAVs) across a wide-variety of application spaces, robust aerial manipulation remains a key research challenge. Aerial manipulation tasks require interacting with objects in the environment, often without knowing their dynamical properties like mass and friction a priori. Additionally, interacting with these objects can have a significant impact on the control and stability of the vehicle. We investigated an approach for robust control and non-prehensile aerial manipulation in unknown environments. In particular, we use model-based Deep Reinforcement Learning (DRL) to learn a world model of the environment while simultaneously learning a policy for interaction with the environment. We evaluated our approach on a series of push tasks by moving an object between goal locations and demonstrated repeatable behaviors across a range of friction values.