When Robots Get Chatty: Grounding Multimodal Human-Robot Conversation and Collaboration

作者: Philipp Allgeuer, Hassan Ali, Stefan Wermter

分类: cs.RO

发布日期: 2024-06-29

期刊: International Conference on Artificial Neural Networks, Sep 2024 (pp. 306-321)

DOI: 10.1007/978-3-031-72341-4_21

💡 一句话要点

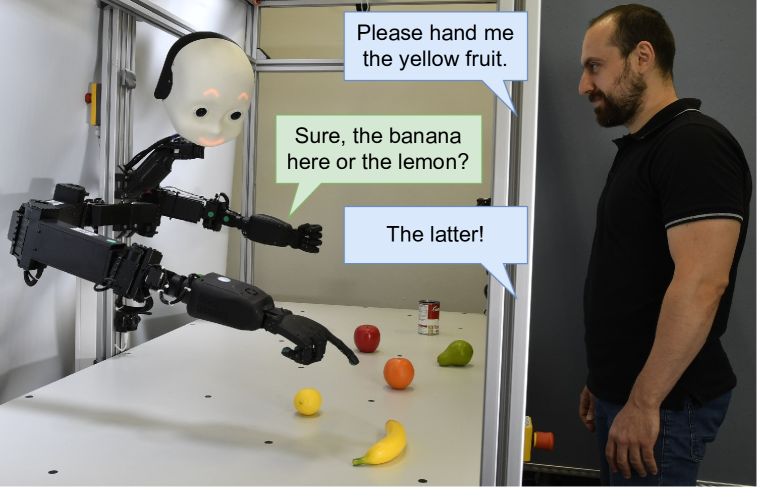

提出基于LLM的多模态人机交互框架,实现开放式对话与协作

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 大型语言模型 机器人 多模态融合 开放式对话

📋 核心要点

- 现有机器人交互缺乏自然性和社交性,难以进行开放式对话和协作。

- 论文提出一种模块化框架,利用LLM作为核心,整合多种感知和控制模型。

- 实验结果表明,该框架能有效提升机器人的人机交互能力,实现自然对话。

📝 摘要(中文)

本文研究了如何利用大型语言模型(LLM)赋予神经机器人智能体类人的社交和认知能力,以实现开放式的人机对话与协作。我们提出了一种模块化和可扩展的方法,将LLM与物理机器人的感知和能力相结合,并在整个架构中集成了多个深度学习模型,形成系统集成。集成的模型涵盖了语音识别、语音生成、开放词汇目标检测、人体姿态估计和手势检测等多种功能,LLM作为中心文本协调单元。定性和定量的结果表明,LLM在以自然和社交的方式提供机器人涌现认知和交互式语言控制方面具有巨大的潜力。

🔬 方法详解

问题定义:现有的人机交互系统通常依赖于预定义的规则和有限的词汇,难以处理开放式的对话和协作任务。痛点在于缺乏对复杂环境的感知能力,以及对人类意图的理解和推理能力。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的语言理解和生成能力,作为机器人交互的中心协调器。通过将LLM与机器人的各种感知和控制模块集成,实现对环境的理解、对人类意图的推断,以及自然流畅的对话。

技术框架:该框架包含以下主要模块:1) 语音识别模块,将人类语音转换为文本;2) 开放词汇目标检测模块,识别环境中的物体;3) 人体姿态估计模块,识别人类的姿态;4) 手势检测模块,识别人类的手势;5) LLM,作为中心协调器,接收来自各个模块的信息,并生成回复;6) 语音生成模块,将LLM生成的文本转换为语音。整个流程是:人类输入语音,语音识别模块将其转换为文本,然后LLM结合其他感知模块的信息进行理解和推理,生成回复文本,最后语音生成模块将回复文本转换为语音输出。

关键创新:最重要的技术创新点在于将LLM作为机器人交互的中心协调器,并将其与多种感知和控制模块集成。这种集成方式使得机器人能够更好地理解人类的意图,并生成更自然、更流畅的回复。与现有方法相比,该方法能够处理更复杂的对话和协作任务。

关键设计:论文中没有明确给出关键参数设置、损失函数、网络结构等技术细节。各个模块可以使用现有的成熟模型,例如,目标检测可以使用YOLO,姿态估计可以使用OpenPose。LLM的选择也很重要,需要根据具体的应用场景进行选择。如何设计合适的prompt,引导LLM生成符合要求的回复,也是一个关键的设计问题。(部分内容为推测,因为原文未详细说明)

🖼️ 关键图片

📊 实验亮点

论文通过定性和定量实验验证了该框架的有效性。定性实验展示了机器人与人类进行自然对话和协作的能力。定量实验则评估了各个模块的性能,例如语音识别的准确率、目标检测的精度等。实验结果表明,该框架能够显著提升机器人的人机交互能力。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如:智能家居助手、医疗康复机器人、工业协作机器人等。通过自然语言交互,机器人可以更好地理解人类的需求,并提供更个性化的服务。未来,该技术有望促进人与机器人之间的无缝协作,提高工作效率和生活质量。

📄 摘要(原文)

We investigate the use of Large Language Models (LLMs) to equip neural robotic agents with human-like social and cognitive competencies, for the purpose of open-ended human-robot conversation and collaboration. We introduce a modular and extensible methodology for grounding an LLM with the sensory perceptions and capabilities of a physical robot, and integrate multiple deep learning models throughout the architecture in a form of system integration. The integrated models encompass various functions such as speech recognition, speech generation, open-vocabulary object detection, human pose estimation, and gesture detection, with the LLM serving as the central text-based coordinating unit. The qualitative and quantitative results demonstrate the huge potential of LLMs in providing emergent cognition and interactive language-oriented control of robots in a natural and social manner.