Human-centered In-building Embodied Delivery Benchmark

作者: Zhuoqun Xu, Yang Liu, Xiaoqi Li, Jiyao Zhang, Hao Dong

分类: cs.RO, cs.AI

发布日期: 2024-06-25

💡 一句话要点

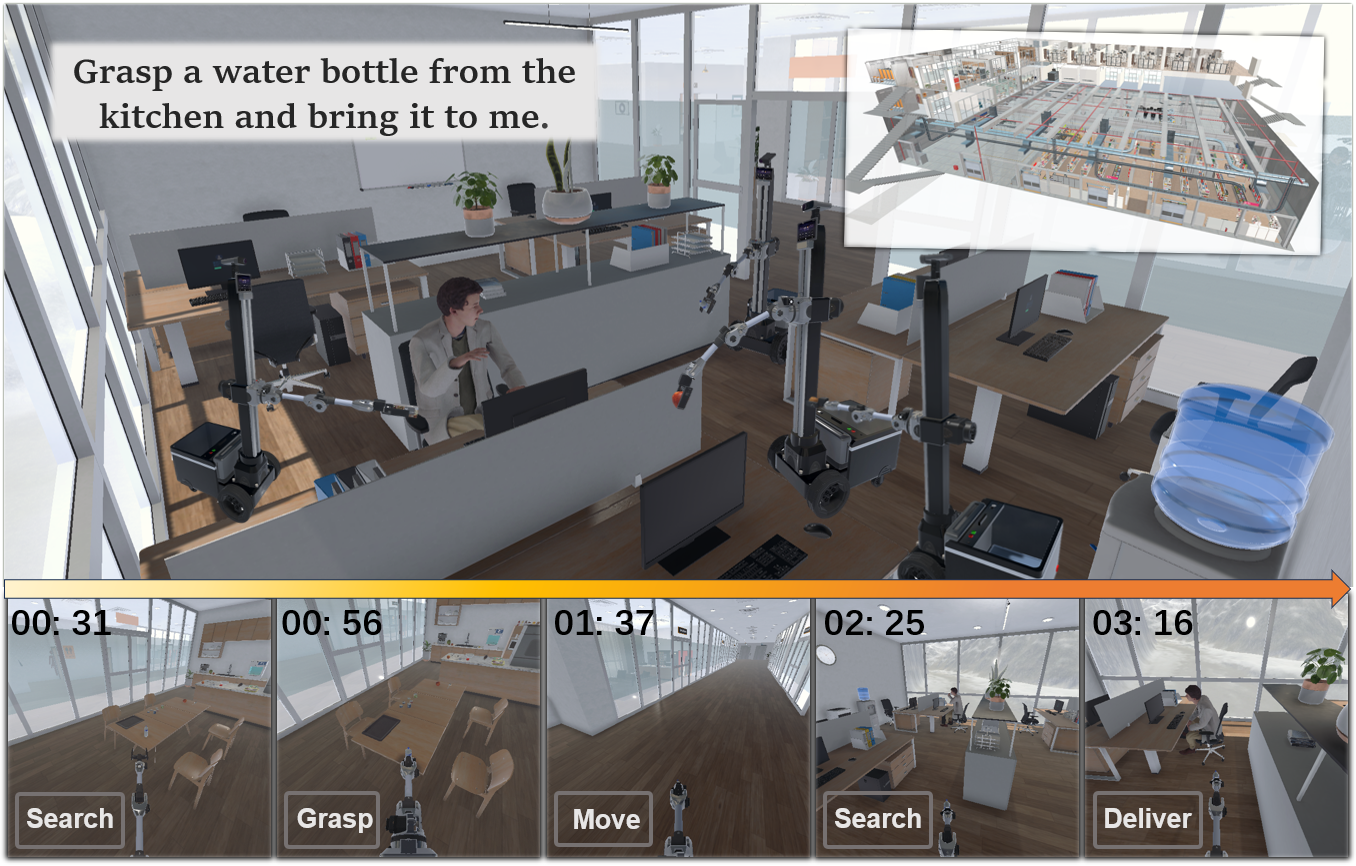

提出人机交互室内配送基准,构建多模态大模型驱动的虚拟环境

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 人机交互 室内配送 虚拟环境 多模态大模型

📋 核心要点

- 现有具身智能研究缺乏针对商业场景中人机交互的关注,限制了其落地应用。

- 构建了以人为中心的室内配送虚拟环境,包含人类角色、机器人和交互物品,并生成了配送指令数据集。

- 提出基于多模态大模型的基线方法,为该数据集提供初步解决方案,并为后续研究提供参考。

📝 摘要(中文)

本文提出了一种特定商业场景模拟:以人为中心的室内具身配送。为此,作者从零开始开发了一个全新的虚拟环境系统,构建了一个模仿极地研究站的多层互联建筑空间。该环境包括自主的人类角色和具有抓取和移动能力的机器人,以及大量的交互物品。基于此环境,作者构建了一个包含1.3万条语言指令的配送数据集,用于指导机器人提供服务。通过人类角色模拟人类行为,并采样他们在日常生活中的各种需求。最后,作者提出了一种以大型多模态模型为中心的方法,作为该数据集的基线系统。与过去的具身数据工作相比,本文侧重于以人机交互为中心的商业场景虚拟环境。相信这将为具身社区带来新的视角和探索角度。

🔬 方法详解

问题定义:论文旨在解决具身智能在商业场景,特别是室内配送场景中的应用问题。现有方法通常缺乏对人机交互的充分考虑,难以模拟真实商业环境中的复杂性和不确定性。因此,需要一个能够模拟人、机器人和环境之间交互的平台,并提供相应的数据集来训练和评估具身智能算法。

核心思路:论文的核心思路是构建一个虚拟环境,该环境能够模拟真实的室内配送场景,并包含人类角色、机器人和交互物品。通过模拟人类的行为和需求,可以生成用于训练机器人的人机交互数据。同时,利用多模态大模型作为基线方法,探索如何利用语言指令指导机器人在虚拟环境中完成配送任务。

技术框架:该技术框架主要包含三个部分:虚拟环境构建、数据集生成和基线方法。虚拟环境是一个多层互联的建筑空间,包含人类角色、机器人和交互物品。数据集包含1.3万条语言指令,用于指导机器人在虚拟环境中完成配送任务。基线方法是一个以大型多模态模型为中心的系统,用于理解语言指令并控制机器人执行相应的动作。

关键创新:该论文的关键创新在于构建了一个以人为中心的室内配送虚拟环境,并生成了相应的数据集。该环境能够模拟真实的人机交互场景,为具身智能的研究提供了新的平台和数据。此外,利用多模态大模型作为基线方法,探索了如何利用语言指令指导机器人在虚拟环境中完成配送任务。

关键设计:虚拟环境的设计考虑了真实室内环境的复杂性和多样性,包括多层结构、不同类型的房间和大量的交互物品。人类角色的行为模拟考虑了人类的日常需求和习惯,例如取餐、送货等。数据集的生成采用了多种策略,包括人工标注和程序生成,以保证数据的质量和多样性。基线方法采用了预训练的多模态大模型,并针对室内配送任务进行了微调。

🖼️ 关键图片

📊 实验亮点

论文构建了一个包含1.3万条语言指令的配送数据集,并提出了基于多模态大模型的基线方法。虽然论文中没有给出具体的性能数据,但该基线方法为后续研究提供了一个起点,并为评估不同算法的性能提供了一个标准。

🎯 应用场景

该研究成果可应用于机器人室内配送、智能家居、人机协作等领域。通过构建逼真的虚拟环境和数据集,可以加速具身智能算法的开发和验证,提高机器人在真实世界中的适应性和可靠性。未来,该研究有望推动机器人技术在商业和服务领域的广泛应用。

📄 摘要(原文)

Recently, the concept of embodied intelligence has been widely accepted and popularized, leading people to naturally consider the potential for commercialization in this field. In this work, we propose a specific commercial scenario simulation, human-centered in-building embodied delivery. Furthermore, for this scenario, we have developed a brand-new virtual environment system from scratch, constructing a multi-level connected building space modeled after a polar research station. This environment also includes autonomous human characters and robots with grasping and mobility capabilities, as well as a large number of interactive items. Based on this environment, we have built a delivery dataset containing 13k language instructions to guide robots in providing services. We simulate human behavior through human characters and sample their various needs in daily life. Finally, we proposed a method centered around a large multimodal model to serve as the baseline system for this dataset. Compared to past embodied data work, our work focuses on a virtual environment centered around human-robot interaction for commercial scenarios. We believe this will bring new perspectives and exploration angles to the embodied community.