SlideSLAM: Sparse, Lightweight, Decentralized Metric-Semantic SLAM for Multi-Robot Navigation

作者: Xu Liu, Jiuzhou Lei, Ankit Prabhu, Yuezhan Tao, Igor Spasojevic, Pratik Chaudhari, Nikolay Atanasov, Vijay Kumar

分类: cs.RO

发布日期: 2024-06-25 (更新: 2025-10-03)

备注: Xu Liu, Jiuzhou Lei, and Ankit Prabhu contributed equally to this work

🔗 代码/项目: GITHUB

💡 一句话要点

SlideSLAM:用于多机器人导航的稀疏、轻量级、去中心化度量语义SLAM

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多机器人SLAM 度量语义地图 实例分割 地点识别 去中心化 机器人导航 闭环检测

📋 核心要点

- 现有SLAM方法在多机器人协作时面临信息融合和计算效率的挑战,尤其是在构建语义地图时。

- SlideSLAM利用对象级别的度量语义信息,设计了语义驱动的地点识别算法,实现机器人间的闭环检测和信息融合。

- 实验结果表明,SlideSLAM在室内外环境中均表现出良好的性能,并与现有方法相比具有竞争力,适用于多种机器人平台。

📝 摘要(中文)

本文提出了一种实时的、去中心化的度量语义SLAM算法,使异构机器人团队能够协同构建基于对象的度量语义地图。该框架集成了数据驱动的前端,用于从RGBD相机或激光雷达进行实例分割,以及定制的后端,用于优化地图中的机器人轨迹和对象地标。为了允许多个机器人合并它们的信息,我们设计了语义驱动的地点识别算法,该算法利用对象级度量语义地图的信息性和视点不变性进行机器人间的闭环检测。设计了一个通信模块来跟踪每个机器人的观测结果以及其他机器人的观测结果(在通信链路可用时)。该框架支持机器人上的实时、去中心化操作,并已与三种类型的空中和地面平台集成。我们通过室内和室外环境中的实验,以及在公共数据集上的基准测试和与现有方法的比较,验证了其有效性。该框架是开源的,适用于单智能体和多机器人实时度量语义SLAM应用。代码可在https://github.com/KumarRobotics/SLIDE_SLAM获取。

🔬 方法详解

问题定义:现有的多机器人SLAM方法在构建大规模、语义丰富的地图时,面临着计算资源瓶颈和通信带宽限制。尤其是在异构机器人团队中,不同传感器和平台的数据融合更加困难。此外,传统的基于特征点的SLAM方法难以提供高级的语义信息,限制了机器人在复杂环境中的理解和交互能力。

核心思路:SlideSLAM的核心思路是利用对象级别的度量语义信息,构建稀疏但信息丰富的地图。通过实例分割提取场景中的对象,并将这些对象作为地标进行优化。这种方法降低了地图的复杂度,提高了计算效率,同时提供了高级的语义信息,便于机器人进行场景理解和任务规划。语义驱动的地点识别算法利用对象级别的视点不变性,实现机器人间的闭环检测和信息融合。

技术框架:SlideSLAM框架主要包含三个模块:数据驱动的前端、定制的后端和通信模块。前端负责从RGBD相机或激光雷达数据中进行实例分割,提取场景中的对象。后端负责优化机器人轨迹和对象地标,构建度量语义地图。通信模块负责跟踪每个机器人的观测结果以及其他机器人的观测结果,实现机器人间的信息共享和协同。整体流程是每个机器人独立进行前端处理和局部地图构建,然后通过语义驱动的地点识别算法进行闭环检测,并通过通信模块进行全局地图优化。

关键创新:SlideSLAM的关键创新在于:1) 提出了基于对象级别的度量语义SLAM方法,降低了地图的复杂度,提高了计算效率;2) 设计了语义驱动的地点识别算法,利用对象级别的视点不变性,实现机器人间的闭环检测和信息融合;3) 实现了实时的、去中心化的多机器人SLAM系统,支持异构机器人团队的协同工作。与传统的基于特征点的SLAM方法相比,SlideSLAM提供了高级的语义信息,便于机器人进行场景理解和任务规划。

关键设计:在前端,使用了数据驱动的实例分割方法,可以灵活地适应不同的传感器类型(RGBD相机或激光雷达)。在后端,使用了定制的优化算法,可以有效地优化机器人轨迹和对象地标。语义驱动的地点识别算法的关键在于选择合适的语义特征,例如对象的类别、大小和位置等。通信模块的设计需要考虑通信带宽的限制,选择合适的通信协议和数据压缩方法。

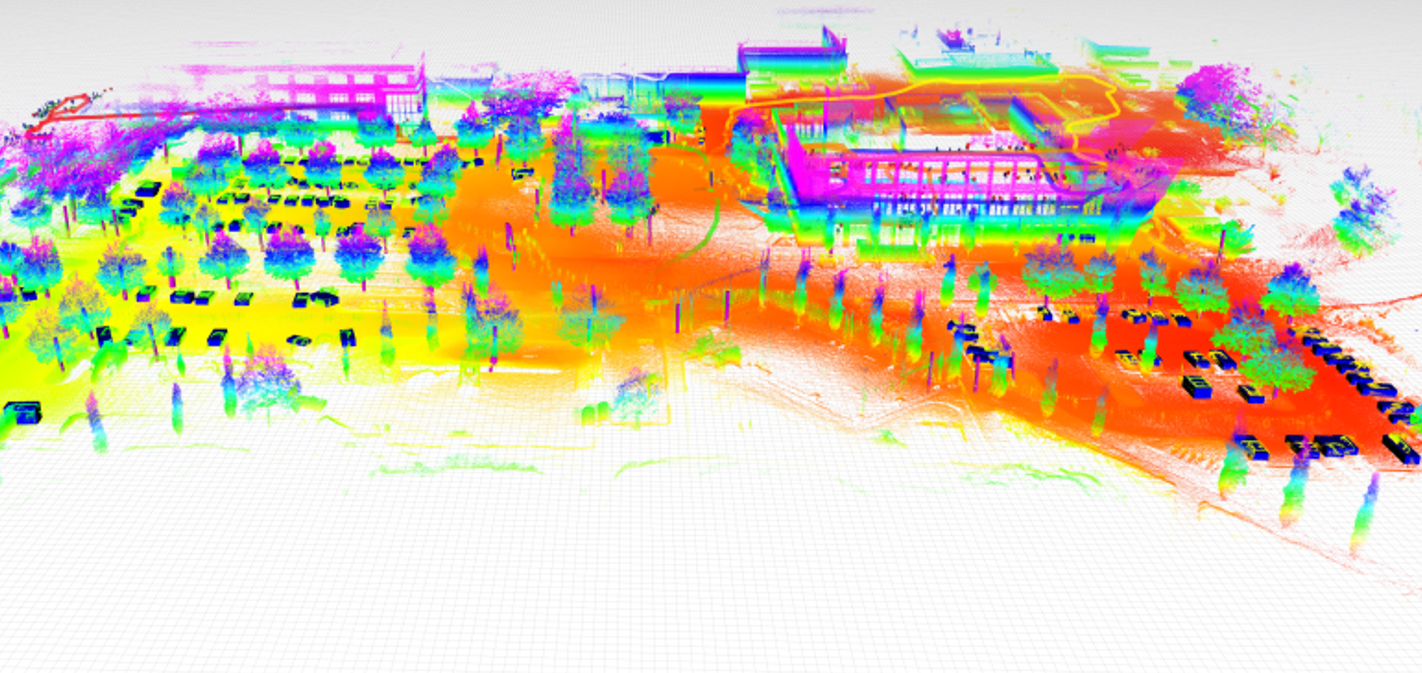

🖼️ 关键图片

📊 实验亮点

SlideSLAM在室内和室外环境中进行了实验验证,并与现有方法进行了比较。实验结果表明,SlideSLAM在精度和效率方面均表现出良好的性能。例如,在公共数据集上的基准测试中,SlideSLAM的定位精度优于其他方法。此外,SlideSLAM还成功地应用于三种类型的空中和地面平台,验证了其在不同机器人平台上的适用性。开源代码的发布也为其他研究者提供了便利。

🎯 应用场景

SlideSLAM适用于多机器人协同的场景,例如仓库管理、灾难救援、环境监测等。通过构建度量语义地图,机器人可以更好地理解环境,进行导航、避障和任务规划。该研究的实际价值在于提高了多机器人SLAM的效率和鲁棒性,为机器人应用提供了更强大的支持。未来,可以进一步研究如何将SlideSLAM与其他机器人技术(例如强化学习、自然语言处理)相结合,实现更智能的机器人系统。

📄 摘要(原文)

This paper develops a real-time decentralized metric-semantic SLAM algorithm that enables a heterogeneous robot team to collaboratively construct object-based metric-semantic maps. The proposed framework integrates a data-driven front-end for instance segmentation from either RGBD cameras or LiDARs and a custom back-end for optimizing robot trajectories and object landmarks in the map. To allow multiple robots to merge their information, we design semantics-driven place recognition algorithms that leverage the informativeness and viewpoint invariance of the object-level metric-semantic map for inter-robot loop closure detection. A communication module is designed to track each robot's observations and those of other robots whenever communication links are available. The framework supports real-time, decentralized operation onboard the robots and has been integrated with three types of aerial and ground platforms. We validate its effectiveness through experiments in both indoor and outdoor environments, as well as benchmarks on public datasets and comparisons with existing methods. The framework is open-sourced and suitable for both single-agent and multi-robot real-time metric-semantic SLAM applications. The code is available at: https://github.com/KumarRobotics/SLIDE_SLAM.