Towards Natural Language-Driven Assembly Using Foundation Models

作者: Omkar Joglekar, Tal Lancewicki, Shir Kozlovsky, Vladimir Tchuiev, Zohar Feldman, Dotan Di Castro

分类: cs.RO, cs.AI, cs.CV, cs.LG

发布日期: 2024-06-23

💡 一句话要点

提出基于LLM的机器人组装控制框架,实现自然语言驱动的高精度任务

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人组装 大型语言模型 自然语言驱动 动态上下文切换 高精度控制

📋 核心要点

- 通用机器人控制策略在处理高精度组装任务时面临挑战,难以有效处理接触、摩擦等复杂因素。

- 提出一种基于LLM的全局控制策略,通过动态上下文切换,将控制权转移到专门训练的高精度技能上。

- 该方法强调LLM在解释语言输入和增强复杂机器人操作控制机制方面的重要作用。

📝 摘要(中文)

大型语言模型(LLMs)和强大的视觉模型推动了视觉-语言-动作模型领域的快速发展,从而实现了机器人控制。这些方法的主要目标是开发一种能够控制具有各种形态的机器人的通用策略。然而,在诸如自动组装和拆卸等工业机器人应用中,诸如插入之类的任务需要更高的精度,并且涉及复杂的因素,如接触啮合、摩擦处理和精细的运动技能。使用通用策略来实现这些技能具有挑战性,因为这些策略可能需要集成更多的传感器数据,包括力或扭矩测量,以提高精度。本文提出了一种基于LLM的全局控制策略,该策略可以将控制策略转移到一组专门训练用于通过动态上下文切换执行高精度任务的技能。将LLM集成到该框架中,突显了它们在不仅解释和处理语言输入,而且丰富各种复杂机器人操作的控制机制方面的重要性。

🔬 方法详解

问题定义:现有通用机器人控制策略在工业机器人组装应用中,尤其是在插入等高精度任务上表现不足。这些任务需要精确的接触啮合、摩擦处理和精细运动控制,而通用策略难以有效整合力/扭矩等额外传感器数据,从而限制了其精度和可靠性。

核心思路:论文的核心思路是利用大型语言模型(LLMs)作为全局控制器,负责理解自然语言指令并进行任务分解。LLM不直接控制机器人执行具体动作,而是根据指令动态地将控制权切换到预先训练好的、专门用于执行特定高精度技能的专家策略上。这种分层控制结构结合了LLM的语言理解能力和专家策略的精确执行能力。

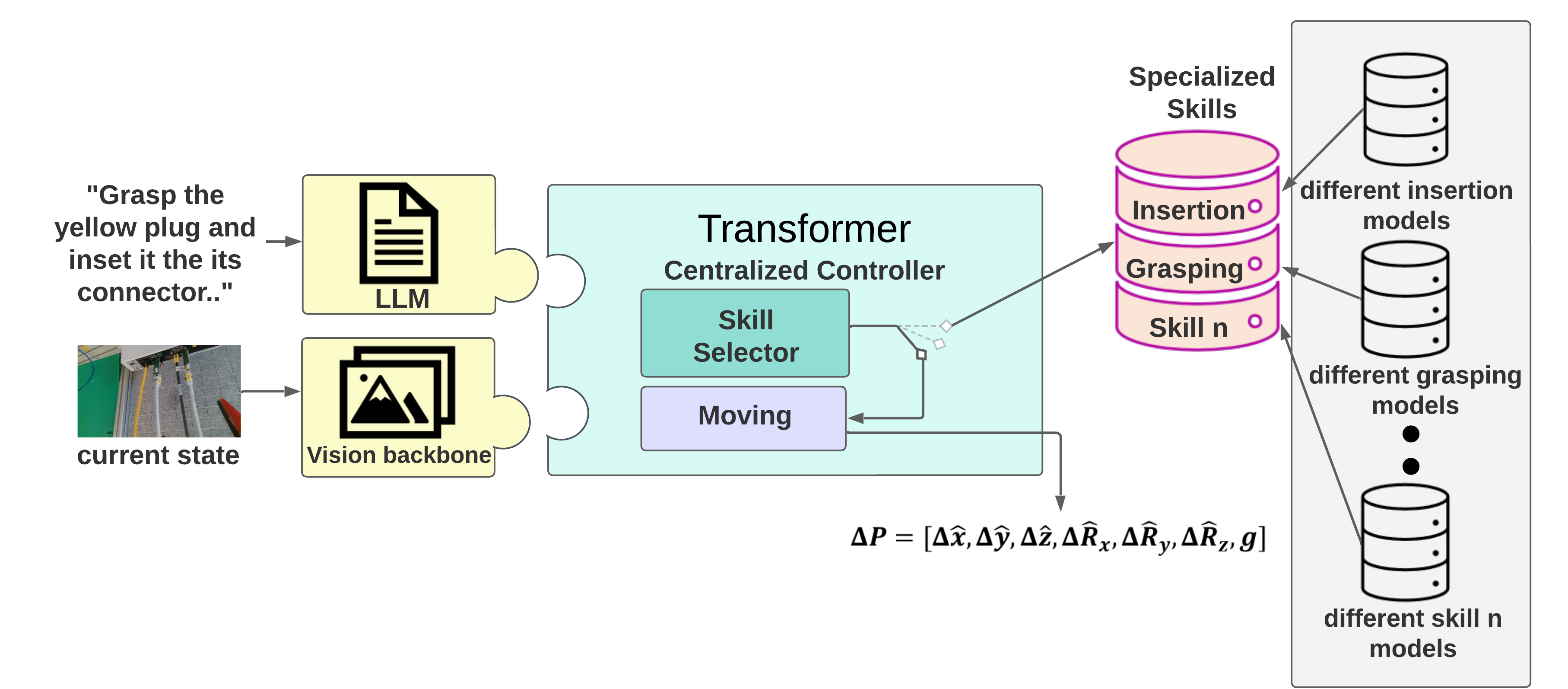

技术框架:该框架包含以下主要模块:1) 自然语言指令输入模块:接收用户输入的自然语言指令。2) LLM全局控制模块:LLM解析指令,确定需要执行的技能序列,并负责动态上下文切换,将控制权交给相应的专家策略。3) 专家技能策略模块:包含一组预先训练好的专家策略,每个策略专门用于执行特定的高精度任务,例如插入、拧螺丝等。这些策略可能依赖于力/扭矩传感器数据。4) 机器人控制模块:接收专家策略的输出,控制机器人的具体动作。

关键创新:该方法最重要的创新点在于利用LLM进行动态上下文切换,将通用语言理解能力与专家技能策略的高精度执行能力相结合。与直接使用LLM控制所有动作相比,该方法能够更好地处理需要高精度和复杂物理交互的任务。

关键设计:关键设计包括:1) LLM的选择和微调:选择合适的LLM,并针对机器人组装任务进行微调,使其能够更好地理解相关指令。2) 专家技能策略的训练:设计和训练一组专家策略,每个策略负责执行特定的高精度任务。训练方法可能包括强化学习、模仿学习等。3) 上下文切换机制:设计有效的上下文切换机制,确保LLM能够准确地将控制权交给合适的专家策略。这可能涉及到状态估计、任务规划等技术。

🖼️ 关键图片

📊 实验亮点

论文的主要亮点在于提出了一个基于LLM的机器人组装控制框架,该框架能够将自然语言指令转化为具体的机器人动作。虽然论文摘要中没有提供具体的性能数据,但其核心思想——利用LLM进行动态上下文切换,结合通用语言理解能力与专家技能策略的高精度执行能力——具有显著的优势,有望在实际应用中取得良好的效果。

🎯 应用场景

该研究成果可应用于自动化装配线、精密仪器制造、医疗机器人等领域。通过自然语言指令驱动机器人完成复杂装配任务,降低了操作难度,提高了生产效率和灵活性。未来,该技术有望实现更智能、更自主的机器人组装系统,推动制造业的智能化升级。

📄 摘要(原文)

Large Language Models (LLMs) and strong vision models have enabled rapid research and development in the field of Vision-Language-Action models that enable robotic control. The main objective of these methods is to develop a generalist policy that can control robots with various embodiments. However, in industrial robotic applications such as automated assembly and disassembly, some tasks, such as insertion, demand greater accuracy and involve intricate factors like contact engagement, friction handling, and refined motor skills. Implementing these skills using a generalist policy is challenging because these policies might integrate further sensory data, including force or torque measurements, for enhanced precision. In our method, we present a global control policy based on LLMs that can transfer the control policy to a finite set of skills that are specifically trained to perform high-precision tasks through dynamic context switching. The integration of LLMs into this framework underscores their significance in not only interpreting and processing language inputs but also in enriching the control mechanisms for diverse and intricate robotic operations.