HYPERmotion: Learning Hybrid Behavior Planning for Autonomous Loco-manipulation

作者: Jin Wang, Rui Dai, Weijie Wang, Luca Rossini, Francesco Ruscelli, Nikos Tsagarakis

分类: cs.RO, cs.AI, cs.LG

发布日期: 2024-06-20

备注: Project page: https://hy-motion.github.io/

💡 一句话要点

HYPERmotion:学习混合行为规划,实现自主的腿手协同操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 腿手协同操作 强化学习 全身优化 大型语言模型 行为规划 机器人控制 视觉语言模型

📋 核心要点

- 现有的人形全身控制能力在通用性和适应新任务方面存在不足,难以应对复杂环境下的长时任务。

- HYPERmotion框架结合强化学习、全身优化和大型语言模型,学习、选择和规划不同场景下的行为。

- 实验表明,学习到的运动能够有效适应新任务,并在真实场景中通过自由文本命令展示出高度的自主性。

📝 摘要(中文)

本文提出HYPERmotion框架,旨在使机器人能够在不同环境中自主执行混合运动,从而服务于物料搬运、家务和工作辅助等长时任务。该框架充分利用机器人自身运动能力,从丰富的环境信息中提取可供性,并规划物理交互行为。HYPERmotion结合强化学习与全身优化,为38个驱动关节生成运动,并构建运动库存储学习到的技能。利用大型语言模型(LLM)的规划和推理能力处理复杂的腿手协同操作任务,构建分层任务图,将底层执行与高层规划连接起来。通过视觉语言模型(VLM)将提炼的空间几何和2D观测信息与机器人形态选择器相结合,从而在单臂或双臂、腿式或轮式运动中选择合适的动作。仿真和真实世界的实验表明,学习到的运动能够有效地适应新任务,并在非结构化场景中通过自由文本命令展示出高度的自主性。

🔬 方法详解

问题定义:论文旨在解决机器人如何在复杂环境中自主执行长时腿手协同操作任务的问题。现有方法通常难以兼顾通用性和适应性,无法灵活应对新任务和非结构化环境。痛点在于如何有效地利用机器人自身运动能力,从环境信息中提取可供性,并规划物理交互行为。

核心思路:论文的核心思路是结合强化学习、全身优化和大型语言模型,构建一个分层的行为规划框架。通过强化学习和全身优化学习低级别的运动技能,并利用大型语言模型进行高层次的任务规划和推理,从而实现机器人自主完成复杂任务。这样设计的目的是将低层次的运动控制与高层次的任务理解相结合,提高机器人的通用性和适应性。

技术框架:HYPERmotion框架包含以下主要模块:1) 运动技能学习模块:利用强化学习和全身优化生成运动,并存储到运动库中。2) 任务规划模块:利用大型语言模型构建分层任务图,将复杂任务分解为一系列基本行为。3) 行为选择模块:利用视觉语言模型将提炼的空间几何和2D观测信息与机器人形态选择器相结合,选择合适的动作。整体流程是:首先,接收任务指令;然后,利用大型语言模型进行任务规划;接着,根据环境信息和机器人形态选择合适的行为;最后,执行选定的行为,并重复以上步骤直到任务完成。

关键创新:论文的关键创新在于将强化学习、全身优化和大型语言模型相结合,构建了一个完整的腿手协同操作框架。与现有方法相比,HYPERmotion能够更好地利用机器人自身运动能力,从环境信息中提取可供性,并规划物理交互行为。此外,利用视觉语言模型进行行为选择,使得机器人能够更好地适应不同的环境和任务。

关键设计:论文的关键设计包括:1) 使用强化学习训练运动技能,奖励函数的设计至关重要,需要平衡任务完成度和运动的自然性。2) 使用全身优化生成运动,需要仔细调整优化目标和约束条件,以保证运动的可行性和稳定性。3) 使用大型语言模型进行任务规划,需要设计合适的提示词和任务分解策略,以保证规划的有效性和效率。4) 使用视觉语言模型进行行为选择,需要训练模型识别环境中的物体和关系,并将其与机器人形态和运动技能相结合。

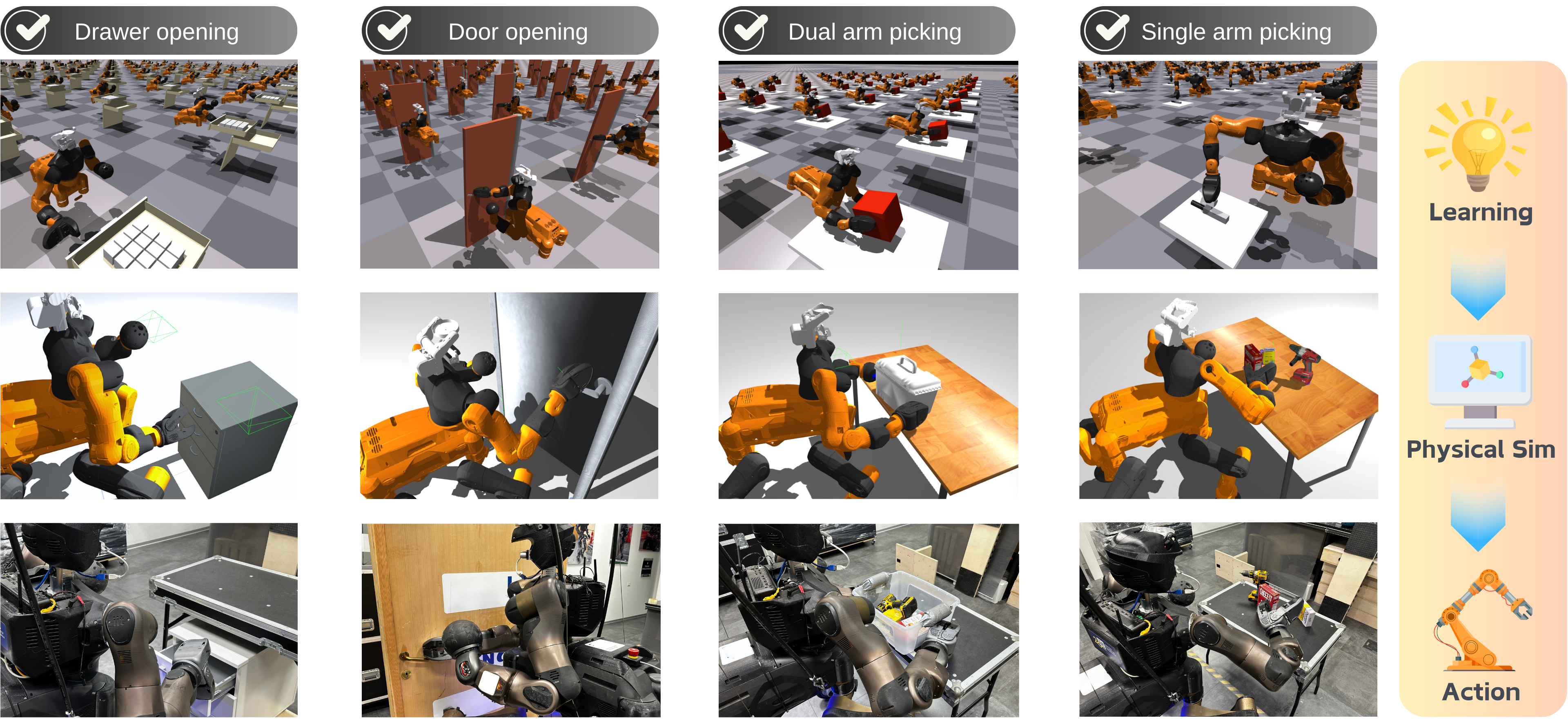

🖼️ 关键图片

📊 实验亮点

在仿真和真实世界的实验中,HYPERmotion框架展示了其在腿手协同操作方面的强大能力。实验结果表明,学习到的运动能够有效地适应新任务,并在非结构化场景中通过自由文本命令展示出高度的自主性。具体性能数据未知,但论文强调了其框架在适应性和自主性方面的显著优势。

🎯 应用场景

HYPERmotion框架具有广泛的应用前景,可应用于物料搬运、家务服务、工作辅助等领域。例如,在智能工厂中,机器人可以利用该框架自主完成物料的抓取、放置和组装等任务;在家庭环境中,机器人可以利用该框架帮助人们完成家务,如清洁、整理和烹饪;在医疗领域,机器人可以利用该框架辅助医生进行手术和康复治疗。该研究的实际价值在于提高机器人的自主性和适应性,使其能够更好地服务于人类。

📄 摘要(原文)

Enabling robots to autonomously perform hybrid motions in diverse environments can be beneficial for long-horizon tasks such as material handling, household chores, and work assistance. This requires extensive exploitation of intrinsic motion capabilities, extraction of affordances from rich environmental information, and planning of physical interaction behaviors. Despite recent progress has demonstrated impressive humanoid whole-body control abilities, they struggle to achieve versatility and adaptability for new tasks. In this work, we propose HYPERmotion, a framework that learns, selects and plans behaviors based on tasks in different scenarios. We combine reinforcement learning with whole-body optimization to generate motion for 38 actuated joints and create a motion library to store the learned skills. We apply the planning and reasoning features of the large language models (LLMs) to complex loco-manipulation tasks, constructing a hierarchical task graph that comprises a series of primitive behaviors to bridge lower-level execution with higher-level planning. By leveraging the interaction of distilled spatial geometry and 2D observation with a visual language model (VLM) to ground knowledge into a robotic morphology selector to choose appropriate actions in single- or dual-arm, legged or wheeled locomotion. Experiments in simulation and real-world show that learned motions can efficiently adapt to new tasks, demonstrating high autonomy from free-text commands in unstructured scenes. Videos and website: hy-motion.github.io/