IRASim: A Fine-Grained World Model for Robot Manipulation

作者: Fangqi Zhu, Hongtao Wu, Song Guo, Yuxiao Liu, Chilam Cheang, Tao Kong

分类: cs.RO, cs.AI, cs.CV

发布日期: 2024-06-20 (更新: 2025-07-29)

备注: Opensource, project website: https://gen-irasim.github.io

期刊: ICCV 2025

💡 一句话要点

IRASim:用于机器人操作的细粒度世界模型,提升交互预测精度

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 世界模型 扩散模型 Transformer 动作条件 视频生成 策略评估

📋 核心要点

- 现有世界模型在机器人操作中难以准确建模视觉空间中细粒度的机器人-物体交互,忽略了动作与帧之间的精确对齐。

- IRASim通过训练扩散Transformer,并在Transformer块中引入帧级别动作条件模块,显式建模和加强动作-帧对齐。

- 实验表明IRASim在视频生成质量、策略评估相关性以及策略性能方面均优于现有方法,并在Push-T任务上IoU提升至0.961。

📝 摘要(中文)

本文提出了一种名为IRASim的新型世界模型,旨在生成具有细粒度机器人-物体交互细节的视频,其生成过程以历史观测和机器人动作轨迹为条件。现有方法忽略了每个动作和对应帧之间的精确对齐,难以准确建模视觉空间中细粒度的机器人操作。IRASim训练了一个扩散Transformer,并在每个Transformer块中引入了一种新颖的帧级别动作条件模块,以显式地建模和加强动作-帧对齐。大量实验表明:(1)IRASim生成的视频质量超过了所有基线方法,并能随着模型规模和计算量的增加而有效扩展;(2)使用IRASim进行的策略评估与使用真实模拟器的策略评估表现出很强的相关性,突显了其加速真实世界策略评估的潜力;(3)通过IRASim进行基于模型的规划的测试时扩展显著提高了策略性能,例如在Push-T基准测试中,IoU指标从0.637提高到0.961;(4)IRASim提供了灵活的动作可控性,允许通过键盘或VR控制器控制数据集中的虚拟机械臂。

🔬 方法详解

问题定义:现有世界模型在机器人操作任务中,难以精确捕捉机器人与物体之间细微的交互细节。主要痛点在于,这些模型通常忽略了动作序列中每个动作与对应视频帧之间的精确对齐关系,导致预测的视觉效果不够精细,无法用于精确的策略学习和规划。

核心思路:IRASim的核心思路是显式地建模和加强动作与视频帧之间的对齐关系。通过在Transformer架构中引入帧级别的动作条件模块,模型能够更准确地理解每个动作对当前帧的影响,从而生成更逼真、更精细的交互视频。这种设计使得模型能够更好地捕捉机器人操作中的细微变化。

技术框架:IRASim基于扩散Transformer架构。整体流程包括:首先,将历史观测和机器人动作轨迹输入到模型中;然后,扩散Transformer逐步生成未来的视频帧,其中每个Transformer块都包含一个帧级别的动作条件模块;最后,通过训练使得生成的视频尽可能接近真实视频。该框架的关键在于动作条件模块的设计,它负责将动作信息融入到每一帧的生成过程中。

关键创新:IRASim最重要的技术创新点在于其帧级别的动作条件模块。与以往方法不同,该模块不是简单地将动作信息作为全局条件输入,而是将其融入到每个Transformer块中,从而实现动作与每一帧的精细对齐。这种设计使得模型能够更准确地预测动作对视觉效果的影响,从而生成更逼真的交互视频。

关键设计:IRASim的关键设计包括:1) 扩散Transformer的架构选择,使其能够生成高质量的视频;2) 帧级别动作条件模块的具体实现,例如如何将动作信息编码并融入到Transformer块中;3) 损失函数的设计,例如如何衡量生成视频与真实视频之间的差异,以及如何鼓励动作与帧之间的对齐。具体的参数设置和网络结构细节在论文中应该有更详细的描述。

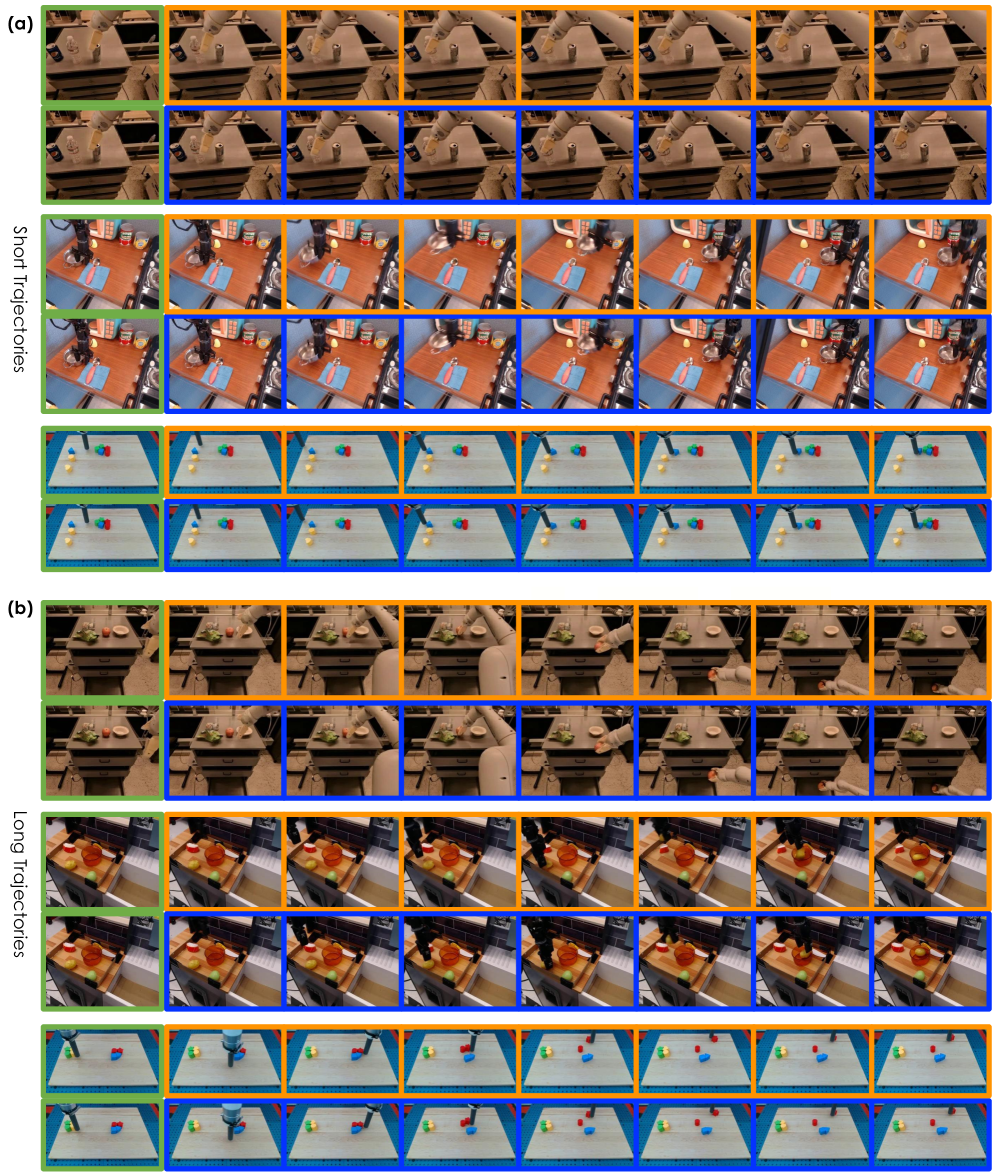

🖼️ 关键图片

📊 实验亮点

IRASim在多个实验中表现出色。视频生成质量显著优于基线方法,并且随着模型规模的增加,性能持续提升。策略评估实验表明,使用IRASim进行的策略评估与真实模拟器具有很强的相关性。在Push-T基准测试中,通过IRASim进行基于模型的规划,IoU指标从0.637显著提升至0.961,表明IRASim能够有效提升策略性能。

🎯 应用场景

IRASim具有广泛的应用前景,包括机器人操作策略的学习与评估、虚拟环境中的机器人训练、以及人机交互设计等。通过IRASim,研究人员可以在虚拟环境中快速评估不同的机器人控制策略,而无需在真实环境中进行昂贵的实验。此外,IRASim还可以用于创建更逼真的虚拟环境,从而改善人机交互体验,例如远程操作和虚拟现实。

📄 摘要(原文)

World models allow autonomous agents to plan and explore by predicting the visual outcomes of different actions. However, for robot manipulation, it is challenging to accurately model the fine-grained robot-object interaction within the visual space using existing methods which overlooks precise alignment between each action and the corresponding frame. In this paper, we present IRASim, a novel world model capable of generating videos with fine-grained robot-object interaction details, conditioned on historical observations and robot action trajectories. We train a diffusion transformer and introduce a novel frame-level action-conditioning module within each transformer block to explicitly model and strengthen the action-frame alignment. Extensive experiments show that: (1) the quality of the videos generated by our method surpasses all the baseline methods and scales effectively with increased model size and computation; (2) policy evaluations using IRASim exhibit a strong correlation with those using the ground-truth simulator, highlighting its potential to accelerate real-world policy evaluation; (3) testing-time scaling through model-based planning with IRASim significantly enhances policy performance, as evidenced by an improvement in the IoU metric on the Push-T benchmark from 0.637 to 0.961; (4) IRASim provides flexible action controllability, allowing virtual robotic arms in datasets to be controlled via a keyboard or VR controller.