Learning the Approach During the Short-loading Cycle Using Reinforcement Learning

作者: Carl Borngrund, Ulf Bodin, Henrik Andreasson, Fredrik Sandin

分类: cs.RO

发布日期: 2024-06-19

💡 一句话要点

利用强化学习优化短周期装载中的接近策略

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 自主导航 短周期装载 工程车辆 模拟迁移

📋 核心要点

- 短周期装载任务复杂,人工操作难以兼顾效率与能耗,传统规则系统难以应对复杂交互。

- 提出基于强化学习的方法,在模拟环境中训练智能体学习接近和定位,优化导航策略。

- 实验结果表明,该方法在模拟和真实环境中均能有效导航,无需额外训练即可迁移。

📝 摘要(中文)

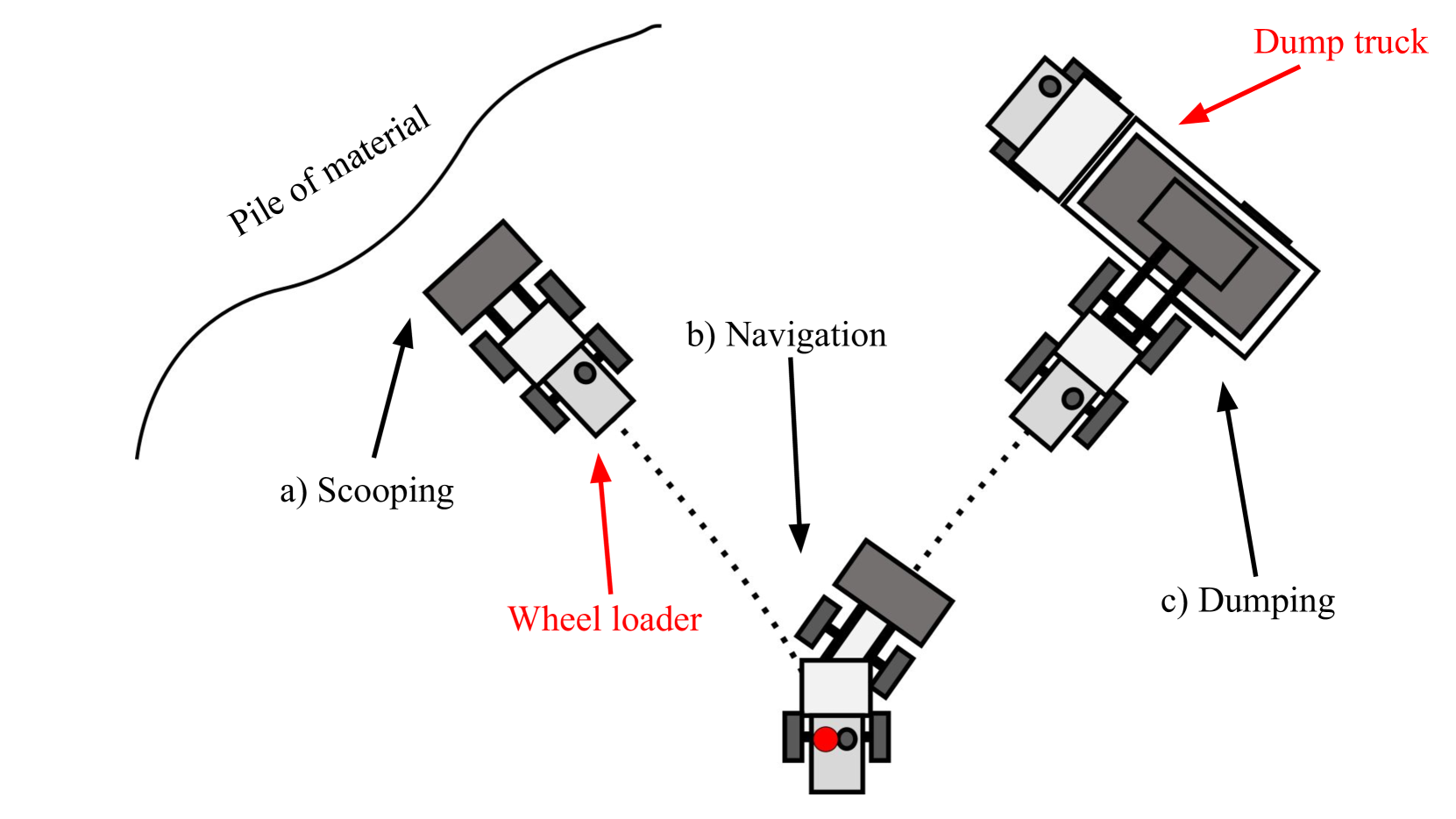

短周期装载是一个重复性高、适合自动化的任务。该周期中,操作员需驾驶车辆接近物料堆,装满铲斗,然后导航至自卸卡车,将物料倾倒至车厢。操作员需要在生产效率和燃油消耗之间取得平衡,以最大化周期效率。此外,轮胎与地面的复杂交互也增加了难度。这些难以建模的交互以及效率要求,促使我们探索数据驱动方法的潜力。本文研究了通过强化学习训练智能体,使其学习接近自卸卡车的车厢并定位以倾倒物料的可能性。智能体在3D模拟环境中接受训练,执行简化的导航任务。训练后的智能体直接迁移到真实车辆上执行相同任务,无需额外训练。结果表明,智能体可以在模拟环境中通过有限的控制信号成功学习导航至自卸卡车,并且在迁移到真实车辆时,表现出正确的行为。

🔬 方法详解

问题定义:论文旨在解决短周期装载过程中,装载机如何高效、精准地接近自卸卡车并完成卸料准备的问题。现有方法,如人工规则或传统控制算法,难以应对复杂环境交互和优化效率需求,需要人工调试,泛化性差。

核心思路:论文的核心思路是利用强化学习,通过与模拟环境的交互,让智能体自主学习最优的接近和定位策略。这种方法无需人工设计规则,能够自适应环境变化,并优化效率目标。

技术框架:整体框架包括:1) 3D模拟环境的构建,用于智能体的训练;2) 强化学习算法的设计,包括状态空间、动作空间、奖励函数等;3) 智能体训练过程,通过与环境交互不断优化策略;4) 训练好的智能体直接迁移到真实车辆上进行测试。

关键创新:最重要的创新点在于直接将模拟环境中训练的智能体迁移到真实车辆上,无需额外的真实环境训练。这表明该方法具有良好的泛化能力和实用价值。

关键设计:论文中,状态空间可能包括车辆的位置、速度、与自卸卡车的距离和角度等信息。动作空间可能包括车辆的油门、转向等控制信号。奖励函数的设计至关重要,需要综合考虑接近速度、精度、燃油消耗等因素。具体的强化学习算法(如DQN、PPO等)和网络结构(如CNN、RNN等)的选择在论文中可能没有详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过强化学习训练的智能体能够在模拟环境中成功学习导航至自卸卡车,并且在没有经过任何真实环境训练的情况下,直接迁移到真实车辆上也能表现出正确的行为。具体的性能数据和对比基线在摘要中未提及,属于未知信息。

🎯 应用场景

该研究成果可应用于工程车辆的自动化驾驶,提高短周期装载的效率和安全性,降低燃油消耗和人工成本。未来可扩展到其他类型的工程车辆和作业场景,例如矿山开采、港口装卸等,具有广阔的应用前景。

📄 摘要(原文)

The short-loading cycle is a repetitive task performed in high quantities, making it a great alternative for automation. In the short-loading cycle, an expert operator navigates towards a pile, fills the bucket with material, navigates to a dump truck, and dumps the material into the tipping body. The operator has to balance the productivity goal while minimising the fuel usage, to maximise the overall efficiency of the cycle. In addition, difficult interactions, such as the tyre-to-surface interaction further complicate the cycle. These types of hard-to-model interactions that can be difficult to address with rule-based systems, together with the efficiency requirements, motivate us to examine the potential of data-driven approaches. In this paper, the possibility of teaching an agent through reinforcement learning to approach a dump truck's tipping body and get in position to dump material in the tipping body is examined. The agent is trained in a 3D simulated environment to perform a simplified navigation task. The trained agent is directly transferred to a real vehicle, to perform the same task, with no additional training. The results indicate that the agent can successfully learn to navigate towards the dump truck with a limited amount of control signals in simulation and when transferred to a real vehicle, exhibits the correct behaviour.